强化学习算法成功控制核聚变装置;元宇宙里的AI玩出新花样

近期业内发布了这些有趣且重要的AI应用:

-

Nature重磅:DeepMind利用强化学习算法成功控制核聚变装置

-

突破原有技术应用形态,Meta元宇宙这样玩AI

-

2D图片生成3D新模型,NeROIC让你的手办更精致

1、Nature重磅:DeepMind利用强化学习算法成功控制核聚变装置

如果你看过2004年上映的《蜘蛛侠 2》,也许还记得其中一个场景——反派奥克博士创造了一个由AI驱动的外骨骼来控制实验性聚变反应堆,如今这一场景已经成为现实。

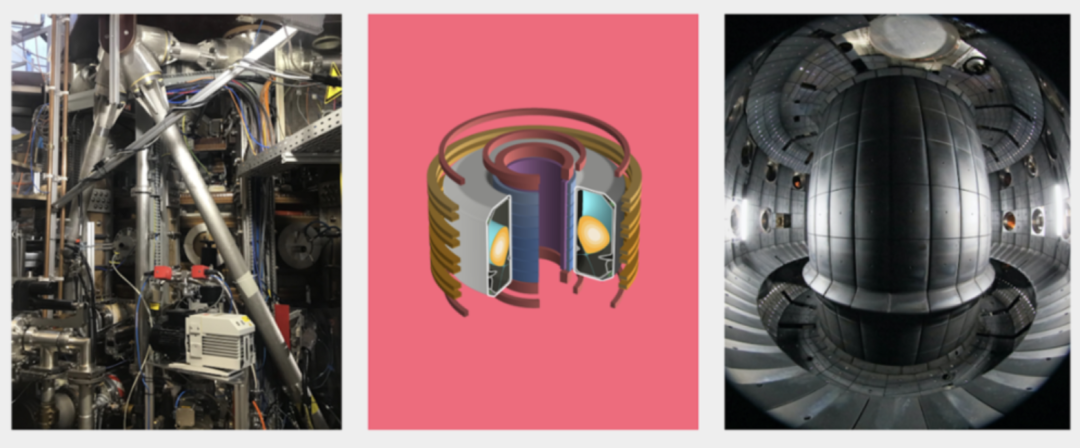

EPFL(瑞士洛桑联邦理工学院)和DeepMind 使用深度强化学习成功控制核聚变装置(托卡马克装置等离子体),这一研究近期登上了Nature杂志。

据了解,托卡马克的中央是一个环形的真空室,外面缠绕着线圈。在通电的时候托卡马克的内部会产生巨大的螺旋型磁场,将其中的等离子体加热到很高的温度,以达到核聚变的目的。找到控制和限制等离子体的方法将是释放核聚变潜力的关键,这被认为是未来几十年清洁能源的源泉。

要想改变等离子体的配置并尝试不同的形状,以产生更多能量或更纯的等离子体时,都需要大量的工程和设计工作。传统的系统是由计算机控制的,并基于模型和模拟,但参与该研究的瑞士等离子体中心(SPC)主任Ambrogio Fasoli表示,传统方法比较复杂且不一定能起到优化的作用。而人工智能,特别是强化学习,特别适合解决托卡马克中控制等离子体的复杂问题。

研究表明,无论是做模拟还是在托卡马克装置进行实验验证,DeepMind的人工智能够以正确的方式操纵磁线圈来自主计算出如何创建等离子体的形状。Fasoli表示,这一研究是“重要的一步”,可能会影响未来托卡马克装置的设计,甚至可以加快通往可控核聚变反应堆的道路。

圣地亚哥能源研究中心的副研究科学家Dmitri Orlov表示,托卡马克装置越复杂,性能越高,就越需要通过越来越高的可靠性和准确性来控制更多数量。AI控制的托卡马克装置可以通过优化,以控制热量从反应中转移到容器壁上,并防止破坏性的“等离子体不稳定性”。反应堆本身可以重新设计,以利用强化学习提供的更严格的控制。

这并不是科学家第一次使用人工智能来控制核聚变。自2014年以来,谷歌一直与总部位于加州的一家聚变公司TAE Technologies合作,将机器学习应用于不同类型的聚变反应堆,从而加速实验数据的分析。欧洲联合环状反应堆(JET)聚变项目的研究已经使用AI来尝试预测等离子体的行为。上周,在JET项目的聚变实验中,5秒内产生了59兆焦耳的能量,这是一项新纪录。

相关链接:

1. https://www.nature.com/articles/s41586-021-04301-9

2. https://www.wired.com/story/deepmind-ai-nuclear-fusion/

2、突破原有技术应用形态,Meta元宇宙这样玩AI

在近日Meta举办的“用人工智能构建元宇宙”的讨论会上,扎克伯格公开了诸多新技术,包括对话AI系统CAIRaoke、Builder Bot、通用语言翻译系统,并且开源了AI推荐系统TorchRec库等。

其中,不同于用基于文本生产图像的DALL-E、CLIP等项目,Builder Bot能让用户仅通过语音命令来生成或将事物导入虚拟世界。比如在元宇宙中以3D形象出现,并且发出语音命令来创造海滩、人物等,还可以添加不同的场景。不过,Builder Bot暂未开放。

CAIRAOKE则是一个超级AI对话系统,与人们现在熟悉的会话系统相比,它能够支持更加个性化、符合语境的对话。不同于那些使用NLU、DST、DT、NLG模型的传统方法,Meta为此采用了一套全新的AI端到端训练模式,建立了新数据库,CAIRaoke训练速度、开发速度也大幅提高。扎克伯格表示,CAIRaoke项目将是Meta的核心。

此外,Meta正在开发一款通用语音翻译器,旨在创建适用于“世界上所有语言”的翻译软件,该公司此前已为其人工智能系统设定了翻译所有书面语言的目标,但其一大挑战在于,目前部分语言缺乏语料库或者没有标准化书写系统。

3、告别渣画质动漫视频,B站开源动漫超分辨率模型

受限于设备及后期技术的要求,用户在各视频平台发布的内容画质很难达到超高清视频的程度。而现在的AI超分辨率技术可以帮助图像在指定分辨率实现高清化。

其中,为了提升动漫UGC视频内容画质,B站开源了自研的动漫超分辨率模型Real-CUGAN,这是一个使用了与Waifu2x相同的动漫模型结构,但因为使用了新的训练数据与训练方法,导致形成了不同参数和推理方式的模型。

Real-CUGAN可以先行对动漫帧进行切块处理,使用图像质量打分模型对候选块进行打分过滤,得到一个百万级的高质量动漫图像块训练集。然后使用多阶段降质算法,将高清图像块降采样得到低质图像,让AI模型学习、优化从低质图像到高质图像的重建过程,训练完毕后即可对真实的二次元低质图像进行高清化处理。

与目前广为流行的、针对动漫有特别优化的开源模型Waifu2x(使用最新版CUNet-Noise3模式)与Real-ESRGAN(使用最新动漫特别优化版RRDB_Anime6B)进行对比,Real-CUGAN在速度和兼容性等方面都有一定的提升。

目前B站的OGV国创剧《镇魂街第二季》 (https://www.bilibili.com/bangumi/play/ss5626)已经上线了动漫超分4K清晰度,部分UP主也能体验到超分功能。

Github链接:

https://github.com/bilibili/ailab/tree/main/Real-CUGAN

4、2D图片生成3D新模型,NeROIC让你的手办更精致

神经渲染(Neural Rendering)是一种在空间中利用各种深度神经网络生成逼真模型的技术,例如给定几张不同角度拍摄的二维图像,神经渲染模型能够生成三维模型,无需人工介入。这种技术一般应用于手办制作、游戏动画等场景。

不过,通过二维照片还原为3D模型一直是图形学的难题,并且照片的不同光线、清新度、拍照机型等都会影响到最终的生成效果,也限制了模型的实际应用场景。

此前常用的经典模型NeRF对输入图片的要求较高,也无法改变渲染的光照条件,而南加州大学华人博士提出的新模型NeROIC,在相对使用更少量图片数据的情况下,通过利用深度提取网络和渲染网络,就可以改变光照效果,甚至用网络照片就可渲染出细节和清晰度更高的三维模型。

相关链接:

1. https://www.louisbouchard.ai/neroic/

2. https://arxiv.org/pdf/2201.02533.pdf

题团源自geralt, Pixabay

其他人都在看

-

一个黑客“沦落”为搬砖的CVer

-

岁末年初,为你打包了一份技术合订本

-

对抗软件系统复杂性:恰当分层,不多不少

-

计算机史最疯狂一幕:“蓝色巨人”奋身一跃

-

30年做成三家独角兽公司,AI芯片创业的底层逻辑

欢迎下载体验OneFlow新一代开源深度学习框架:

GitHub - Oneflow-Inc/oneflow: OneFlow is a performance-centered and open-source deep learning framework.![]() https://github.com/Oneflow-Inc/oneflow/

https://github.com/Oneflow-Inc/oneflow/