AIGC工具平台-LiveTalking实时交互的数字人

在数字人技术持续演进的背景下,实时语音与视频交互逐渐成为开发者关注的热点方向。LiveTalking 模块以其简单易用的配置方式和可扩展的本地部署能力,为初学者提供了数字人交互的入门路径。

本文围绕 LiveTalking 的本地部署与交互流程进行介绍,涵盖整合包的使用方法、脚本配置逻辑及界面交互过程,聚焦于模块的核心运行机制与实际操作体验。

文章目录

- 操作使用

- 应用示例

- 总结

操作使用

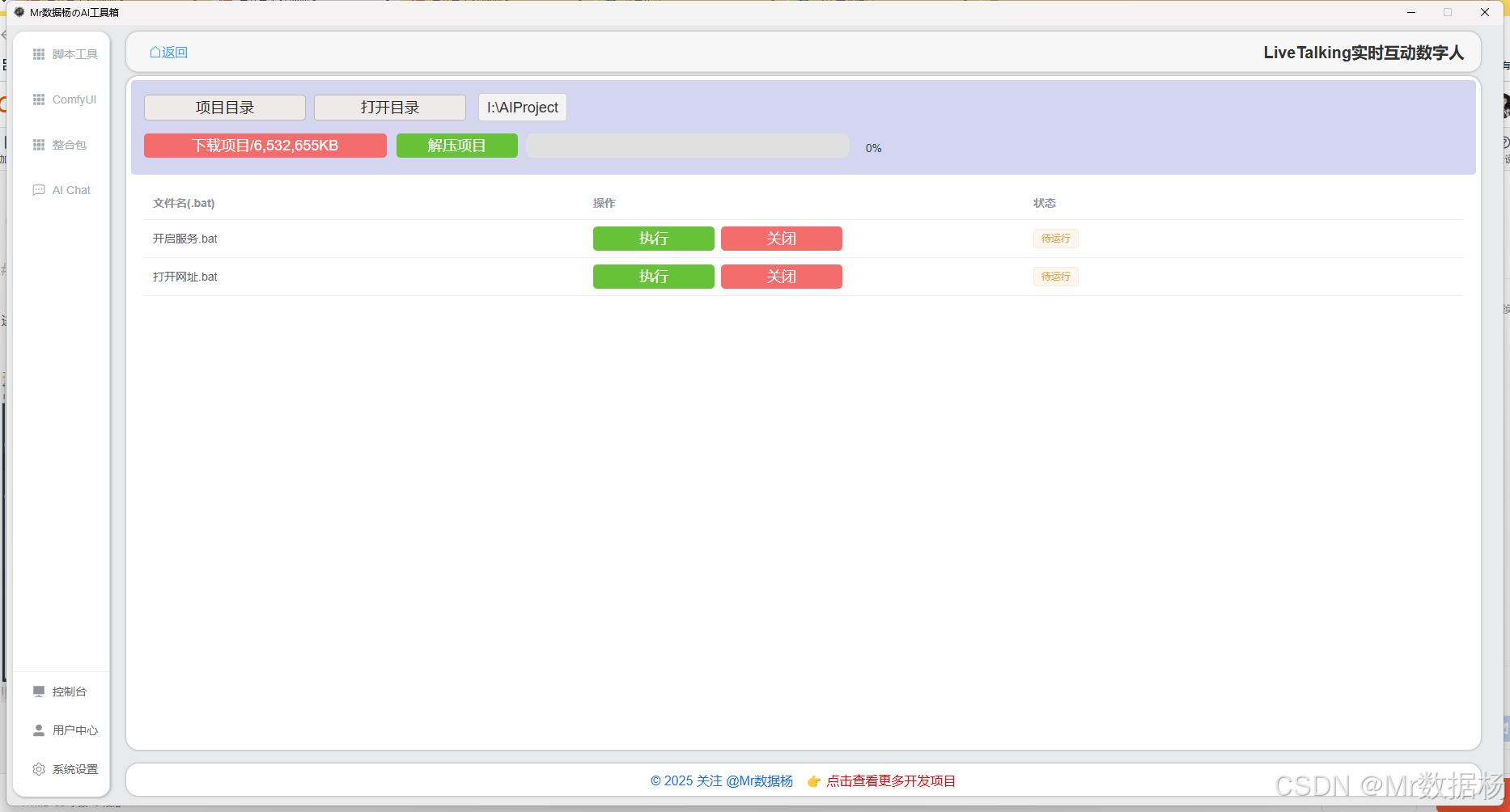

进入软件后在 整合包 里可以直接搜索 LiveTalking 进入该模块。

点击【下载选项卡】可获取完整项目整合包的下载地址,或直接使用下方链接下载。将文件保存至项目目录下后,点击解压按钮,等待解压完成即可开始使用。

项目脚本配置

通过 Gradio 或其他本地可视化工具提供图形化界面,用户可上传视频与音频并实时查看唇形同步效果,适合在本地测试与调整模型效果。只需运行脚本,待界面加载完成后即可在浏览器中访问操作界面,无需手动配置环境或命令行调用。

应用示例

点击 启动服务.bat 启动成功后点击 打开网址.bat。

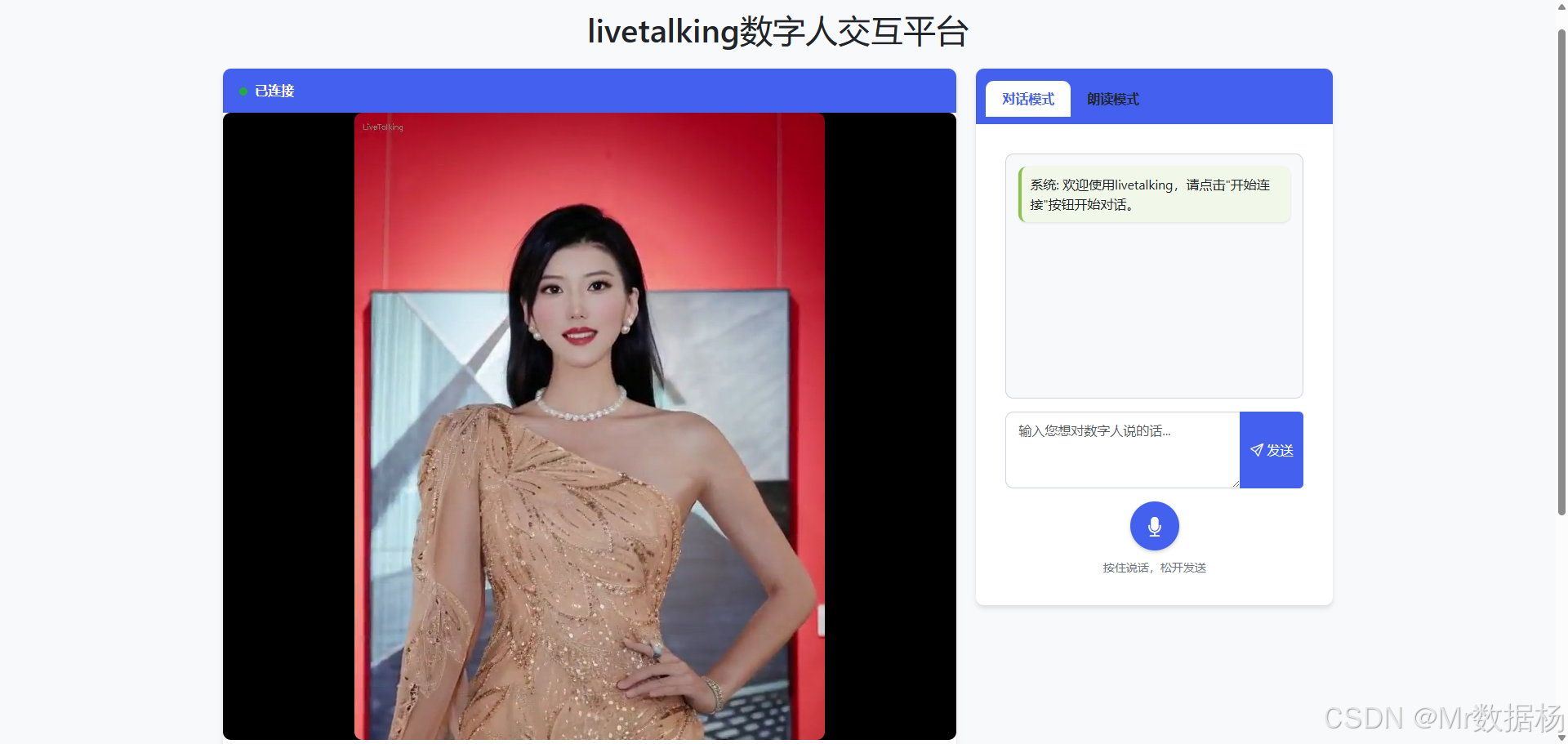

在 http://127.0.0.1:8010/dashboard.html 页面点击连接服务 启动成功之后会看到数字人,这里可以进行对话操作,可以是音频也可以是文字。

当前系统中,文字与音频均作为输入内容使用,由于尚未接入大语言模型,因此不会自动生成回复内容。若需要实现语音朗读,需手动在朗读模式中输入回答文本。同时,TTS 配音模块的配置需根据实际需求自行调整。

后续可根据项目需求灵活接入大语言模型,以实现更完整的问答交互体验。整体使用流程简洁明了,具备良好的拓展性。

如需使用简化版本的功能界面,可访问:

http://127.0.0.1:8010/webrtcapi.html,该版本与主功能基本一致,便于快速验证与测试。

总结

LiveTalking 模块的关键设计体现在其对本地化部署的友好支持。通过预配置的 Gradio 可视化界面,使用者无需深入命令行操作即可完成视频、音频的上传与处理,唇形同步流程一目了然。脚本运行过程高度简化,大幅降低了使用门槛。模块结构清晰,各功能通过独立脚本组织,利于后期修改与维护,适合构建教学型或原型验证类项目。

当前版本在功能完整性与智能交互能力方面仍有较大提升空间。系统尚未整合语言模型,导致交互过程依赖人工输入响应,影响对话的自然性。音频合成需手动输入文本,不具备闭环问答能力。若引入语音识别、自然语言处理及自动 TTS 生成,将能显著增强数字人的实用性和智能化程度。