免费使用 DeepSeek API 教程及资源汇总

免费使用 DeepSeek API 教程及资源汇总

- 一、DeepSeek API 资源汇总

-

- 1.1 火山引擎

- 1.2 百度千帆

- 1.3 阿里百炼

- 1.4 腾讯云

- 二、其他平台

-

- 2.1 华为云

- 2.2 硅基流动

- 三、总结

DeepSeek-R1 作为 2025 年初发布的推理大模型,凭借其卓越的逻辑推理能力和成本优势,迅速成为全球 AI 领域焦点。然而,官方服务因用户量激增频繁出现服务器繁忙问题。

既然 DeepSeek 都开源了,那我直接本地部署一个不就行了吗?可是满血版的 DeepSeek-R1 光模型就占了 404GB 空间,个人电脑根本负担不起呀!我就要稳定使用满血版 DeepSeek,怎么办呢?我们可以使用第三方平台提供的接口服务,大公司帮我们部署了满血版 DeepSeek,我们直接通过 API 调用就行。

一、DeepSeek API 资源汇总

需求供应增大促使火山引擎、阿里云、腾讯云、华为云、百度智能云、硅基流动等第三方云服务商相继推出 API 接口服务,形成多元化市场竞争格局。

1.1 火山引擎

免费体验地址:https://www.volcengine.com/experience/ark

免登录体验3/3次,登录后免费赠送每个模型50万tokens推理额度

账号注册登录地址:https://www.volcengine.com/experience/ark,感谢大家注册的账号的时候填写下我的邀请码!!!

邀请码:4FFO1WJV

接下来我们将介绍如何获取 Deepseek-R1 API,进入API 接入站点

https://console.volcengine.com/ark/region:ark+cn-beijing/endpoint

选择模型推理 - 在线推理,可以选择预置推理接入点或者自定义推理接入点:

1.获取 API Key

2. 选择模型快速测试

3. 发起调用后,平台将为您自动创建模型接入点

创建推理接入点

需要先开通模型,选择DeepSeek-R1开通即可

选择按Token付费,现在有50万tokens免费推理额度,最后确定接入即可完成。查看接入点:

查看Rest API 调用示例

curl https://ark.cn-beijing.volces.com/api/v3/chat/completions \\ -H \"Content-Type: application/json\" \\ -H \"Authorization: Bearer $ARK_API_KEY\" \\ -d \'{ \"model\": \"deepseek-r1-250120\", \"messages\": [ {\"role\": \"system\",\"content\": \"你是人工智能助手.\"}, {\"role\": \"user\",\"content\": \"常见的十字花科植物有哪些?\"} ] }\'使用 Chatbox 工具配置,直接使用DeepSeek-R1模型。打开Chatbox,选择设置 - 模型 - 添加自定义提供方,主要添加API域名、API路径和API Key即可(根据Rest API 调用示例填写接口),模型填deepseek-r1

测试一下效果

1.2 百度千帆

注册并登录百度千帆站点:https://console.bce.baidu.com/qianfan/overview

可以进入体验地址:https://console.bce.baidu.com/qianfan/ais/console/onlineTest/LLM/DeepSeek-R1

接下来需要创建API Key,查看左侧菜单项 API Key

创建API Key,服务选择千帆ModelBuilder,即可生成(需要保存下)

查看 HTTP API 示例

curl --location --request POST \'https://qianfan.baidubce.com/v2/chat/completions\' \\--header \'Content-Type: application/json\' \\--header \'Authorization: Bearer 密钥\' \\--data-raw \'{\"model\":\"deepseek-r1\",\"messages\":[]}\'在 Chatbox 中添加自定义提供方,主要添加API域名、API路径和API Key即可(根据API 示例填写接口),模型填deepseek-r1

测试一下效果

我们可以在调用统计查看API调用情况和消费的Tokens

1.3 阿里百炼

免费模型体验地址:

https://bailian.console.aliyun.com/#/efm/model_experience_center/text

现在基于百炼调用 DeepSeek-R1 满血版 API,享100万免费token:

https://www.aliyun.com/solution/tech-solution/deepseek-r1-for-platforms

点击免费体验即可按照步骤操作部署即可

登录阿里云百炼大模型服务平台,开通百炼模型服务,创建API Key

创建新的API-KEY

查看 HTTP API 示例

curl -X POST https://dashscope.aliyuncs.com/compatible-mode/v1/chat/completions \\-H \"Authorization: Bearer $DASHSCOPE_API_KEY\" \\-H \"Content-Type: application/json\" \\-d \'{ \"model\": \"deepseek-r1\", \"messages\": [ { \"role\": \"user\", \"content\": \"9.9和9.11谁大\" } ]}\'在 Chatbox 中添加自定义提供方,主要添加API域名、API路径和API Key即可(根据API 示例填写接口),模型填deepseek-r1

测试一下效果

貌似都没有联网功能

1.4 腾讯云

DeepSeek API 接口文档:https://cloud.tencent.com/document/product/1772/115963

知识引擎原子能力大模型对话 API 已对外开放,可前往 控制台 开通服务。进入 控制台 - 立即接入 - 管理,单击创建 API KEY。

本接口调用 DeepSeek 系列模型

限时免费。 即日起至北京时间2025年2月25日23:59:59,所有腾讯云用户通过知识引擎原子能力腾讯云 API 接口和兼容 OpenAI的接口调用DeepSeek系列模型均可享受 DeepSeek-V3、DeepSeek-R1 模型限时免费服务,单账号限制接口并发上限为5。在优惠结束之后,模型价格将恢复至原价。

成功创建 API KEY

知识引擎原子能力 DeepSeek OpenAI 对话接口兼容了 OpenAI 的接口规范,这意味着您可以直接使用 OpenAI 官方提供的 SDK 来调用。您仅需要将 base_url 和 api_key 替换成相关配置,不需要对应用做额外修改,即可无缝将您的应用切换到相应的大模型。

- base_url:https://api.lkeap.cloud.tencent.com/v1

- api_key:需在控制台API KEY页面进行创建,操作步骤请参考 API KEY 管理。

- 接口完整路径:https://api.lkeap.cloud.tencent.com/v1/chat/completions

查看流式输出 HTTP API 示例:

curl https://api.lkeap.cloud.tencent.com/v1/chat/completions \\-H \"Content-Type: application/json\" \\-H \"Authorization: Bearer sk-xxxxxxxxxxx\" \\-d \'{ \"model\": \"deepseek-r1\", \"messages\": [ { \"role\": \"user\", \"content\": \"你好\" } ], \"stream\": true}\'在 Chatbox 中添加自定义提供方,主要添加API域名、API路径和API Key即可(根据API 示例填写接口),模型填deepseek-r1

测试一下效果

二、其他平台

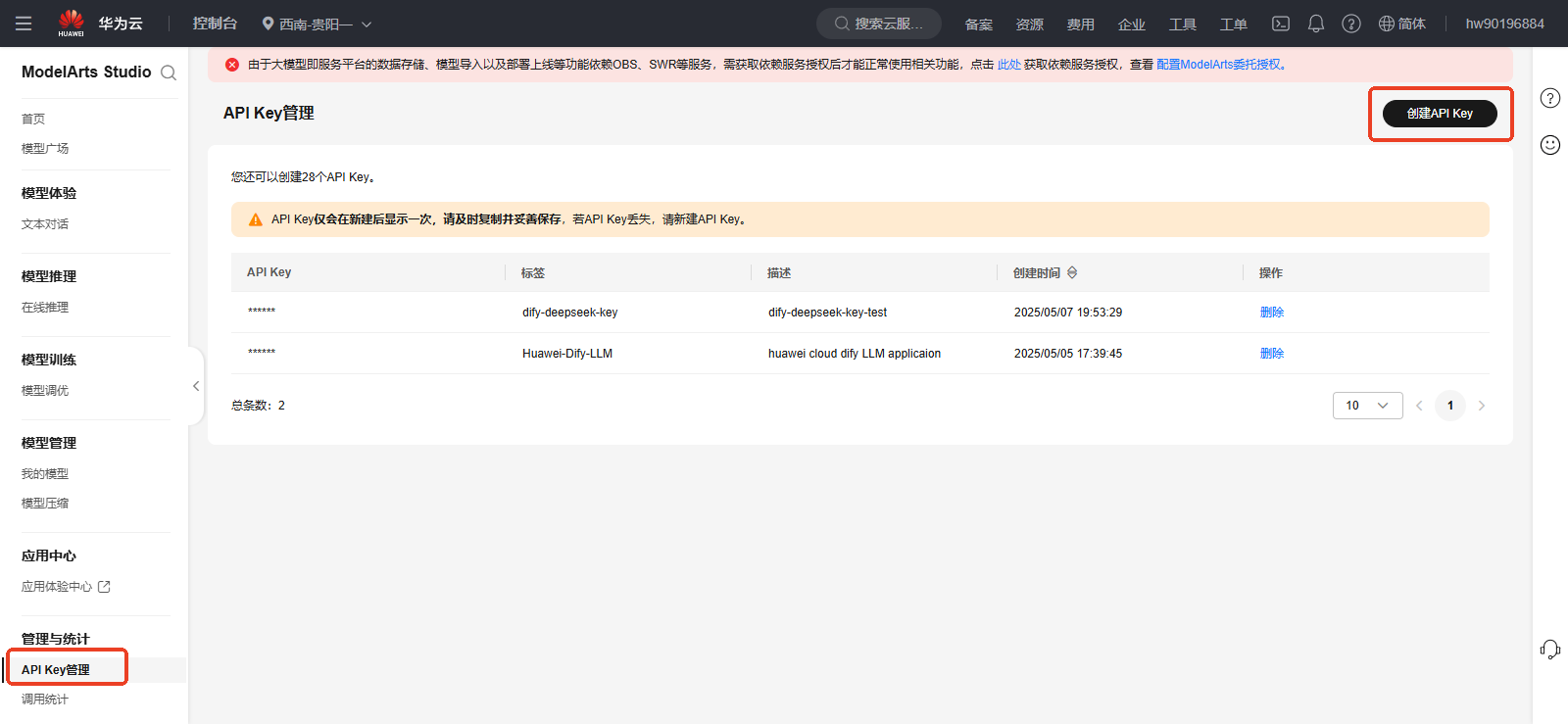

2.1 华为云

华为云ModelArts Studio大模型服务平台:https://console.huaweicloud.com/modelarts/?region=cn-east-4#/model-studio/homepage

单个模型200万免费Tokens, 可用于体验DeepSeek蒸馏系列、Qwen等模型, 免费额度仅适合用于体验模型。

将地区切换到 西南-贵阳一 即可免费体验 DeepSeek-R1-32K 和 DeepSeek-V3-32K

创建 API KEY

接口信息

- API地址:https://maas-cn-southwest-2.modelarts-maas.com/v1/infers/8a062fd4-7367-4ab4-a936-5eeb8fb821c4/v1/chat/completions

- 模型名称:DeepSeek-R1

使用商用服务

API地址是不一样的

curl命令示例如下所示:

curl -X POST \"https://example.com/v1/infers/937cabe5-d673-47f1-9e7c-2b4de06*****/v1/chat/completions\" -H \"Content-Type: application/json\" -H \"Authorization: Bearer yourApiKey\" -d \'{\"model\": \"******\", \"max_tokens\": 1024, \"messages\": [{\"role\": \"system\", \"content\": \"You are a helpful assistant.\"}, {\"role\": \"user\", \"content\": \"hello\"}], \"stream\": false, \"temperature\": 0.6 }\' --insecure具体参考 API 调用指南

2.2 硅基流动

硅基流动 x 华为云联合推出基于昇腾云的 DeepSeek R1&V3 推理服务!

地址:https://cloud.siliconflow.cn/

欢迎大家填写我的推荐码:IT9TZDUk

创建API密钥

创建文本对话请求 curl示例 如下

curl --request POST \\ --url https://api.siliconflow.cn/v1/chat/completions \\ --header \'Authorization: Bearer \' \\ --header \'Content-Type: application/json\' \\ --data \'{ \"model\": \"Qwen/QwQ-32B\", \"messages\": [ { \"role\": \"user\", \"content\": \"What opportunities and challenges will the Chinese large model industry face in 2025?\" } ], \"stream\": false, \"max_tokens\": 512, \"enable_thinking\": false, \"thinking_budget\": 4096, \"min_p\": 0.05, \"stop\": null, \"temperature\": 0.7, \"top_p\": 0.7, \"top_k\": 50, \"frequency_penalty\": 0.5, \"n\": 1, \"response_format\": { \"type\": \"text\" }, \"tools\": [ { \"type\": \"function\", \"function\": { \"description\": \"\", \"name\": \"\", \"parameters\": {}, \"strict\": false } } ]}\'具体参考 API手册

硅基流动的嵌入Embedding模型(BAAI/bge-m3)和重排序Reranker模型(BAAI/bge-reranker-v2-m3)可以有限制的免费使用

三、总结

推荐火山引擎平台,输出速度在上述平台中最快,且目前价格只有官网一半,赠送 50 万 tokens,关于各家平台的收费情况请自行查看官网。