Python与OpenCV快速实现人脸识别指南

本文还有配套的精品资源,点击获取

简介:本压缩包文件详细阐述了如何利用Python及其库进行人脸检测和识别。介绍了Python的易读性和丰富的库支持,如OpenCV和face_recognition,它们极大地简化了人脸识别系统开发。内容涵盖人脸检测、OpenCV中人脸检测功能,以及使用深度学习和传统机器学习方法进行人脸识别。同时提供了一个有趣的“戴圣诞帽”应用案例,展现图像合成技术的实用。

1. Python编程语言在人脸识别中的应用

Python作为一门高级编程语言,在人脸识别领域中扮演着至关重要的角色。由于其简洁的语法和强大的社区支持,Python已经被广泛应用于从数据预处理到模型训练的各个阶段。本章将简要介绍Python在人脸识别中的应用,并分析其背后的原因和优势。

1.1 Python的流行与人脸识别

Python的流行主要是因为其代码易于理解和编写,这使得开发者能够快速地构建和测试算法。在人脸识别领域,这一特性尤为重要,因为它涉及到复杂的图像处理和模式识别技术。Python不仅能够简化开发过程,还因为其丰富的库生态系统,提供了大量用于图像处理、机器学习和数据分析的工具。

1.2 Python库在人脸识别中的作用

Python的第三方库,如OpenCV、dlib和face_recognition等,极大地推动了人脸识别技术的发展。这些库提供了从图像加载和预处理到人脸检测和特征提取的完整工具集。例如,face_recognition库利用深度学习方法,简化了人脸检测和识别过程,允许开发者仅通过几行代码就能实现复杂的人脸识别功能。

1.3 未来展望:Python在人脸识别中的持续影响

随着技术的不断进步和更多创新库的出现,Python在人脸识别领域的应用前景将更加广阔。开发者可以预期Python将持续提供易于使用的框架,帮助他们构建更加智能和高效的人脸识别系统。随着计算能力的提升和算法的优化,Python将助力人脸识别技术在安全、医疗、零售等多个行业中发挥更大的作用。

2. 人脸检测技术与方法

2.1 人脸检测的基本概念

2.1.1 人脸检测的定义和目的

人脸检测技术是指识别图像或视频中的人脸位置并将其框选出来的技术。这项技术目的是通过计算机视觉的方法自动地找出图片中人的面孔,并进行标记或追踪。与人脸检测密切相关的是人脸识别,后者是在前者的基础上,进一步分析被检测出的人脸,以确认人物的身份。

人脸检测是许多现代技术应用的基础,比如智能安防系统、人机交互界面、社交媒体中的照片标记功能等。它通过定位人脸,使得后续的识别和分析工作得以进行,是智能系统感知人类存在的一个关键步骤。

2.1.2 人脸检测的历史发展和现状

人脸检测技术的发展经历了从简单到复杂、从低效到高效的演变过程。在计算机视觉领域,人脸检测从最初的基于规则的方法到后来的机器学习方法,直至当前的深度学习方法,技术不断迭代升级。

最初,基于规则的方法,如肤色模型检测方法,主要依赖于特定的皮肤色调来识别脸部。然而,这种方法的准确率较低,容易受到光照变化和人种肤色差异的影响。随后,基于特征点检测的方法通过寻找人脸的特征点(如眼睛、鼻子和嘴巴的位置)来定位人脸,这种方法比基于肤色的方法具有更高的准确性。

到了21世纪初,随着机器学习的发展,特别是在模式识别领域,人脸检测技术得到了质的飞跃。支持向量机(SVM)和随机森林等算法被广泛应用于人脸检测,并且可以利用大量的数据进行训练,以适应不同的应用场景。

近年来,深度学习尤其是卷积神经网络(CNN)的崛起为人脸检测带来了革命性的改变。深度学习方法通过自动提取特征,大幅提高了检测的准确性和鲁棒性。现在,几乎所有的商业级应用都采用深度学习方法来实现高效、准确的人脸检测。

2.2 传统人脸检测技术

2.2.1 基于肤色模型的人脸检测

肤色模型是人脸检测领域中一种较早提出的方法。这种检测技术假设在特定颜色空间下,人的肤色具有一定的连续性和一致性,通过肤色的色度信息来识别和定位人脸区域。

典型的肤色模型包括YCbCr和HSV等颜色空间。在这些颜色空间内,肤色区域可以被近似为一个较为集中的范围,并用这个范围构建肤色模型的肤色检测器。通过遍历图像中的每个像素点,并判断其颜色是否属于肤色模型定义的范围,可以对图像中可能的人脸区域进行标记。

然而,这种方法的局限性也非常明显。由于光线变化、种族肤色差异等因素,肤色模型可能无法准确区分非肤色区域和肤色区域。此外,肤色检测对图像质量要求较高,容易受到噪声的干扰。

2.2.2 基于特征点检测的人脸检测

基于特征点检测的人脸检测技术主要依赖于人脸图像中特征点的位置信息。人脸的特征点包括眼睛、鼻子、嘴巴等。传统的基于特征点的检测方法通过手动设计或自动学习的方式提取特征,例如使用边缘检测算子来检测眼睛和嘴巴的边缘,或者使用模板匹配的方法寻找特定的面部特征。

特征点检测方法的准确性往往取决于所选特征的判别力。例如,眼睛和鼻子的位置通常较为明显,可以提供稳定且具有区分度的特征。但是,此类方法同样存在局限性,比如对表情变化、遮挡情况和非正面角度的人脸检测效果不佳。

为了提高检测的准确性,可以采取一些策略,如结合多种特征点信息、使用统计学习方法提高对特征点的判别能力,或者对人脸特征点检测的结果进行空间几何约束,以确保检测的合理性和准确性。

2.3 深度学习在人脸检测中的应用

2.3.1 卷积神经网络(CNN)在人脸检测中的应用

卷积神经网络(CNN)是目前最主流的人脸检测技术之一。CNN通过模拟生物视觉皮层的机制来处理图像数据,能够自动且有效地学习图像中的层次化特征。

在人脸检测任务中,CNN模型通常被用于构建一个分类器,其输入是图像块,输出为该图像块是否包含人脸的信息。通过在大量的人脸和非人脸图像上训练,CNN能够学习到区分人脸和其他物体的高级特征。

近年来,各种基于CNN的改进架构和方法不断被提出。例如,单阶段检测器(如SSD)和两阶段检测器(如Faster R-CNN)都是目前流行的网络结构。这些模型在包含和不包含人脸的区域上同时进行训练和预测,大大提高了检测的速度和准确性。

使用深度学习进行人脸检测的一个关键挑战是如何处理大规模数据集,因为高质量和多样化的标注数据对于模型的训练至关重要。同时,如何解决过拟合问题、如何提高模型在不同场景下的泛化能力也是研究者们关注的焦点。

2.3.2 基于深度学习的人脸检测方法比较

随着深度学习技术的发展,出现了多种不同的人脸检测方法。这些方法可以根据其检测策略和性能特点被分类和比较。

一种分类方式是基于检测速度和准确度的不同需求,将人脸检测方法分为实时检测和高精度检测。实时检测方法,如MobileNet结合SSD的架构,强调在保持相对较低的资源消耗的同时,达到较高的检测速率。这类方法适合需要快速响应的应用场景,如视频监控。

而高精度检测方法,如Faster R-CNN结合ResNet的架构,则更注重检测的准确性。这类方法通过复杂的网络结构和丰富的特征提取能力来提高检测精度,适合应用于对准确率有较高要求的场景,如身份验证系统。

除了上述基于速度和准确度的分类,基于数据集的训练方式也是区分人脸检测方法的一个重要因素。例如,无监督学习方法通过未标注的数据进行自我训练,而半监督学习方法则结合少量的标注数据和大量的未标注数据进行训练,这些方法在标签稀缺的情况下具有潜在优势。

总体来说,深度学习中的人脸检测方法的发展正在推动着从传统的基于规则或机器学习的方法向基于自动特征学习的方法转变,同时也在向更加高效、准确、适应性强的方向发展。

graph TD A[人脸检测技术] -->|传统方法| B(基于肤色模型) A -->|传统方法| C(基于特征点检测) A -->|深度学习方法| D(CNN技术应用) A -->|深度学习方法| E(实时检测与高精度检测) A -->|深度学习方法| F(无监督与半监督学习)在实际应用中,不同的方法可能会根据具体的应用场景和需求进行选择和结合。比如,在计算资源受限的移动平台上,可能会选择优化过的轻量级CNN模型来保证实时性;而在对准确性要求极高的场合,会采用复杂的网络结构和丰富的数据集进行训练。

人脸识别和检测技术的不断演进,也带动了相关技术的融合与创新。例如,通过将深度学习方法与传统机器学习方法相结合,可以同时利用深度学习的强大特征提取能力和传统方法对某些特殊情况(如极端光照条件或遮挡)的鲁棒性。这些交叉融合的技术正在不断推动人脸检测技术的发展,向更高性能、更广应用的方向迈进。

3. OpenCV库在人脸检测中的使用

3.1 OpenCV库基础介绍

3.1.1 OpenCV库的安装与配置

OpenCV(Open Source Computer Vision Library)是一个开源的计算机视觉和机器学习软件库。它广泛应用于学术研究、工程项目以及商业产品开发中。OpenCV的跨平台能力强大,支持多种操作系统,包括Windows、Linux、OS X和Android等。OpenCV库在人脸检测的应用中扮演了重要的角色,它提供了大量预训练好的模型和算法来处理图像和视频数据。

在安装OpenCV库之前,确保你的开发环境已经安装了Python。推荐使用Python的pip包管理器来安装OpenCV,因为它是最简单快捷的方法。打开命令行工具,输入以下命令进行安装:

pip install opencv-python为了使用OpenCV进行深度学习相关的操作,如加载预训练的神经网络,还需要安装OpenCV的额外包:

pip install opencv-python-headless安装完成后,可以通过Python代码来验证安装是否成功,并简单了解其基本功能:

import cv2print(cv2.__version__)执行上述代码,若成功,将输出已安装的OpenCV版本号。

3.1.2 OpenCV库的基本功能和结构

OpenCV库由多个模块组成,每个模块解决特定的问题。例如,core模块提供了基本的数据结构和矩阵操作,imgproc模块包含了图像处理的基础操作,如滤波、形态学操作、特征检测等,而video模块包括了运动分析和对象跟踪的功能。

在人脸检测中,我们主要关注以下模块:

-

cv2.CascadeClassifier:这个类用于加载预训练的级联检测器,并使用它来检测图像中的对象。它常用于人脸检测。 -

cv2.dnn:提供了深度神经网络模块,可用于加载预训练的神经网络模型,并进行预测。

接下来我们深入探讨如何使用这些模块来实现人脸检测的功能。

3.2 OpenCV中的人脸检测实现

3.2.1 使用Haar级联分类器进行人脸检测

Haar级联分类器是OpenCV中用于对象检测的一种方法。它通过训练集对Haar特征进行训练,从而学习到区分对象与背景的模式。在人脸检测中,OpenCV提供了预训练的Haar级联分类器。

使用Haar级联分类器进行人脸检测主要分为以下几个步骤:

- 加载级联分类器

- 读取待检测图像

- 将图像转换为灰度图(因为级联分类器基于灰度图像进行检测)

- 进行人脸检测

- 对检测到的人脸进行标记或处理

以下是一个使用Haar级联分类器检测人脸的Python代码示例:

import cv2# 加载预训练的Haar级联分类器face_cascade = cv2.CascadeClassifier(cv2.data.haarcascades + \'haarcascade_frontalface_default.xml\')# 读取图像image = cv2.imread(\'path_to_image.jpg\')# 转换为灰度图gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)# 进行人脸检测faces = face_cascade.detectMultiScale(gray_image, scaleFactor=1.1, minNeighbors=5)# 在检测到的人脸周围画矩形框for (x, y, w, h) in faces: cv2.rectangle(image, (x, y), (x+w, y+h), (255, 0, 0), 2)# 显示结果图像cv2.imshow(\'Detected Faces\', image)cv2.waitKey(0)cv2.destroyAllWindows() 在上述代码中, detectMultiScale 函数是级联分类器的核心函数,其参数包括图像、缩放比例、相邻矩形的最小邻居数等。

3.2.2 使用深度学习模型在OpenCV中检测人脸

除了使用Haar级联分类器,OpenCV还支持使用深度学习模型进行人脸检测。OpenCV提供了一个专门的 dnn 模块,可以加载预训练的深度学习模型,并用其进行对象检测。

使用深度学习模型进行人脸检测通常包括以下几个步骤:

- 导入深度学习所需的库

- 读取或下载预训练模型

- 准备待检测的图像数据

- 将图像数据转换为模型所需的格式

- 加载模型并进行预测

- 结果处理

下面是一个使用预训练的SSD(Single Shot MultiBox Detector)模型进行人脸检测的示例代码:

import cv2import numpy as np# 加载深度学习模型net = cv2.dnn.readNetFromCaffe(\'path_to_caffe_prototxt\', \'path_to_caffe_model\')# 读取图像image = cv2.imread(\'path_to_image.jpg\')# 获取图像尺寸并准备为网络输入(h, w) = image.shape[:2]blob = cv2.dnn.blobFromImage(cv2.resize(image, (300, 300)), 1.0, (300, 300), (104.0, 177.0, 123.0))# 设置网络输入net.setInput(blob)# 进行检测detections = net.forward()# 过滤掉不需要的检测结果for i in np.arange(0, detections.shape[2]): confidence = detections[0, 0, i, 2] # 过滤掉低置信度的检测结果 if confidence > 0.5: # 计算人脸边界框的位置 box = detections[0, 0, i, 3:7] * np.array([w, h, w, h]) (startX, startY, endX, endY) = box.astype(\"int\") # 绘制边界框并显示结果图像 cv2.rectangle(image, (startX, startY), (endX, endY), (0, 255, 0), 2)# 显示检测结果cv2.imshow(\"Face Detection\", image)cv2.waitKey(0) 在这段代码中, blobFromImage 函数用于将输入图像转换为网络输入所需的格式。 forward 函数调用模型,返回检测结果。

3.3 OpenCV中的图像处理技巧

3.3.1 图像预处理和优化

图像预处理是提高人脸检测准确性的关键步骤。常见的图像预处理步骤包括:

- 转换为灰度图:减少计算量和提高检测速度。

- 应用直方图均衡化:增强图像对比度,改善光照不均问题。

- 应用高斯模糊:减少图像噪声和细节,防止检测到虚假人脸。

下面是一个示例代码展示这些预处理步骤:

# 原始图像image = cv2.imread(\'path_to_image.jpg\')# 转换为灰度图像gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)cv2.imshow(\'Gray Image\', gray_image)# 直方图均衡化equalized_image = cv2.equalizeHist(gray_image)cv2.imshow(\'Equalized Image\', equalized_image)# 应用高斯模糊blurred_image = cv2.GaussianBlur(equalized_image, (5, 5), 0)cv2.imshow(\'Blurred Image\', blurred_image)cv2.waitKey(0)cv2.destroyAllWindows()3.3.2 图像的保存和显示技巧

在人脸检测项目中,经常需要保存中间处理的结果或者最终的检测结果。OpenCV提供 cv2.imwrite 函数用于保存图像文件,以及 cv2.imshow 函数用于在窗口中显示图像。

保存和显示图像的代码通常如下:

# 保存处理后的图像cv2.imwrite(\'output_image.jpg\', processed_image)# 显示图像cv2.imshow(\'Image\', processed_image)cv2.waitKey(0) # 等待任意键输入,使窗口保持打开状态cv2.destroyAllWindows() 在这些基础操作之上,了解OpenCV的 VideoCapture 模块可以捕获实时视频流并进行人脸检测,以及 VideoWriter 模块可以将处理的视频保存下来。这些技术将在后续的章节中详细探讨。

以上章节内容为OpenCV库在人脸检测中的使用,介绍了如何安装和配置OpenCV,以及如何使用它的基础功能来实现人脸检测。通过具体的代码示例和解释,我们可以更直观地理解OpenCV在处理图像和视频数据中的应用。在下一章节中,我们将深入探讨图像合成技术,特别是如何在人脸图像上添加虚拟装饰。

4. 图像合成技术:在人脸图像上添加虚拟装饰

4.1 图像合成的基本原理

图像合成是一种计算机图形学中的技术,其核心是将多个图像合并成一个连贯的场景,从而产生新的视觉效果。在人脸图像上添加虚拟装饰,就是图像合成技术的一个具体应用,其目的是在不破坏原有人脸图像完整性的同时,增加一些虚拟的元素,如眼镜、帽子、胡须等,来达到特定的视觉效果或功能需求。

4.1.1 图像合成的定义和技术背景

图像合成技术由来已久,广泛应用于电影、游戏以及虚拟现实等地方。在人脸图像上添加虚拟装饰的图像合成则是一个相对更聚焦的应用场景。通过技术手段合成的装饰可以与原始图像完美融合,实现各种创意设计和应用需求。

4.1.2 图像合成的关键技术点

图像合成技术涉及的关键技术点包括图像的匹配与对齐、遮罩技术以及像素级别的混合处理。匹配与对齐保证了虚拟装饰与人脸图像的正确位置关系。遮罩技术则用于从背景中分离出人脸的部分,这样可以只对人脸区域进行处理而不影响其他部分。像素级别的混合处理则是将虚拟装饰与人脸图像的边缘融合,使之看起来自然而不突兀。

4.2 虚拟装饰的实现技术

在人脸图像上添加虚拟装饰,关键在于理解装饰与人脸之间的空间和视觉关系,以及如何通过技术手段实现它们的无缝结合。

4.2.1 遮罩与混合技术的原理和应用

遮罩技术在图像合成中非常重要,它可以看作是图像的一个模板,通过遮罩可以指定图像合成的区域。混合技术涉及将两个图像在边界处进行平滑过渡,减少边缘的不自然感。在OpenCV中,可以通过 cv2.bitwise_and 结合相应的遮罩来实现。

代码实现示例

import cv2import numpy as np# 读取原始图像和装饰图像face_image = cv2.imread(\'face.jpg\')decoration_image = cv2.imread(\'decoration.png\')# 创建遮罩,这里使用简单的颜色范围来创建遮罩# 例如,装饰图像中黑色的前景代表装饰区域,背景为白色decoration_mask = cv2.inRange(decoration_image, np.array([0,0,0]), np.array([0,0,0]))# 将装饰图像中的装饰部分与人脸图像合成decoration_on_face = cv2.bitwise_and(face_image, face_image, mask=decoration_mask)# 显示结果cv2.imshow(\'Original\', face_image)cv2.imshow(\'Decoration\', decoration_image)cv2.imshow(\'Decoration on Face\', decoration_on_face)cv2.waitKey(0)cv2.destroyAllWindows()4.2.2 虚拟装饰物品的选择和处理

在选择虚拟装饰物品时,需要考虑物品的风格、颜色以及与人脸的相容性等因素。对于装饰物品的处理,通常会通过Photoshop等图像处理软件事先准备好,并确保装饰物品在不同的光照和视角下的真实感。

4.3 图像合成项目的实战演练

了解了图像合成的基础知识与关键实现技术之后,接下来是通过一个实战演练项目来加深理解。

4.3.1 项目概述和前期准备

本项目的目标是在人脸图像上添加一副装饰眼镜。首先,需要准备两张图片:一张是待装饰的人脸图片,另一张是装饰眼镜的图片。然后,对眼镜图片进行处理,将其转换为只有眼镜和透明背景的遮罩图像。

4.3.2 实战演练:将装饰物品合成到人脸图像上

在本实战演练中,将按照以下步骤将装饰眼镜合成到人脸图像上:

- 读取人脸图像和眼镜遮罩图像。

- 对人脸图像进行适当的预处理,如调整大小,以便与眼镜图像匹配。

- 应用眼镜遮罩和人脸图像进行合成。

- 保存和展示最终合成的结果。

步骤1:读取图像

face_image = cv2.imread(\'face.jpg\')decoration_image = cv2.imread(\'glasses.png\')步骤2:预处理图像

# 获取眼镜图像的高度和宽度glasses_height, glasses_width = decoration_image.shape[:2]# 获取人脸图像的高度和宽度face_height, face_width = face_image.shape[:2]# 为了匹配,将眼镜图像缩放到人脸图像的尺寸glasses_resized = cv2.resize(decoration_image, (face_width, face_height))步骤3:应用遮罩和合成图像

# 创建眼镜图像的遮罩glasses_mask = cv2.inRange(glasses_resized, np.array([0,0,0]), np.array([0,0,0]))# 将眼镜图像与遮罩合成到人脸图像上final_image = cv2.bitwise_and(face_image, face_image, mask=glasses_mask)final_image += glasses_resized # 通过加法合并图像# 应用眼睛遮罩来移除眼镜图像的背景部分glasses_only = cv2.bitwise_and(glasses_resized, glasses_resized, mask=glasses_mask)final_image = cv2.add(final_image, glasses_only)# 显示结果cv2.imshow(\'Original Face\', face_image)cv2.imshow(\'Glasses\', glasses_only)cv2.imshow(\'Final Image\', final_image)cv2.waitKey(0)cv2.destroyAllWindows()步骤4:保存和展示结果

# 保存最终图像到文件cv2.imwrite(\'final合成图像.jpg\', final_image)# 展示最终图像cv2.imshow(\'Final合成图像\', final_image)cv2.waitKey(0)cv2.destroyAllWindows()通过以上步骤,可以完成在人脸图像上添加虚拟装饰的眼镜的任务。通过这个实战演练,不仅学习了图像合成的技术,也加深了对OpenCV图像处理库的理解。随着技术的不断演进,图像合成技术将会更加智能和自然,为人类生活带来更多的便利和乐趣。

5. 人脸识别技术与特征提取方法

人脸识别技术是计算机视觉领域的一项重要研究方向,其应用广泛,包括安全验证、用户界面、人群分析等多个领域。在深入了解人脸识别技术之前,我们首先需要理解其核心——特征提取方法。

5.1 人脸识别的基本概念

5.1.1 人脸识别的定义和任务

人脸识别是一项利用计算机技术识别个体面部特征并进行个体识别的过程。与指纹识别或虹膜识别等其他生物识别技术相比,人脸识别具有非接触、用户友好和容易集成等特点。人脸识别的任务通常分为两大类:

- 人脸检测(Face Detection) :检测图像或视频流中的人脸位置,并将人脸与背景分离。

- 人脸比对(Face Matching) :将检测到的人脸与数据库中存储的面部特征进行比较,以确定该人是否为已知个体。

5.1.2 人脸识别的分类和应用场景

人脸识别根据其识别方式可以分为以下几种:

- 1:1验证(身份验证) :验证是否为数据库中的特定个体。

- 1:N识别(身份识别) :在数据库的有限集合中识别出个体身份。

- Watchlist Screening :在监控场景中,对人脸进行实时检测和识别,与黑名单数据库进行匹配。

应用场景包括但不限于:

- 安全监控 :机场、银行等高安全需求场所的人脸识别门禁系统。

- 移动设备 :智能手机、平板电脑的人脸解锁功能。

- 社交平台 :自动标记照片中的特定人物。

- 智能零售 :分析消费者行为,进行个性化推荐。

5.2 人脸识别中的特征提取

5.2.1 传统特征提取方法

传统的人脸特征提取方法主要依赖于几何特征或基于图像处理的技术。典型方法包括:

- 主成分分析(PCA) :通过特征脸(特征向量)来表示人脸数据。

- 线性判别分析(LDA) :最大化类别间的差异,最小化类内差异,提取判别特征。

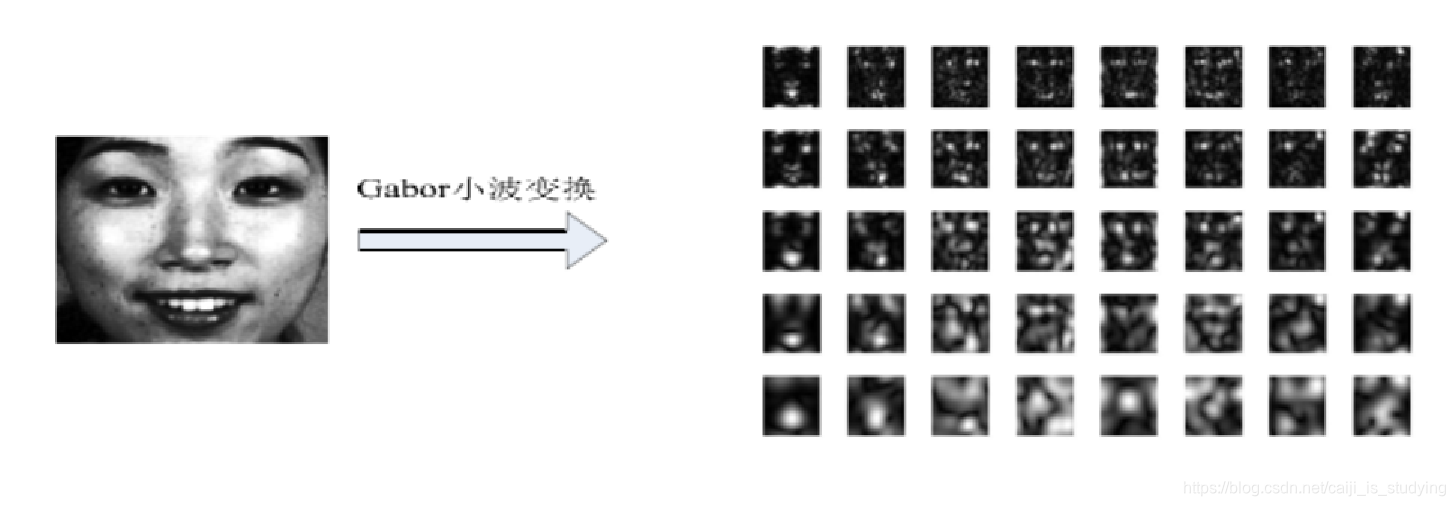

- 弹性图匹配(Elastic Graph Matching, EGM) :构建面部的弹性图,匹配面部特征点。

- Gabor滤波器 :利用Gabor小波提取面部的纹理特征。

5.2.2 基于深度学习的特征提取方法

随着深度学习的发展,基于卷积神经网络(CNN)的特征提取方法已经成为主流。与传统方法相比,CNN可以自动学习和提取更深层次的特征,极大地提高了人脸识别的准确性。常见的深度学习方法有:

- AlexNet、VGG、ResNet :这些深度网络结构被广泛用于特征提取任务。

- Siamese网络 :两个相同的网络共享权重,用于比较和学习输入样本间的相似性。

- Triplet loss网络 :通过三个输入(一个锚点,一个正例,一个负例)来学习判别特征。

以下是一个使用深度学习进行特征提取的简化代码示例:

import tensorflow as tffrom tensorflow.keras.models import Sequentialfrom tensorflow.keras.layers import Conv2D, Flatten, Dense# 构建简单的CNN模型用于特征提取model = Sequential([ Conv2D(32, (3, 3), activation=\'relu\', input_shape=(224, 224, 3)), Conv2D(64, (3, 3), activation=\'relu\'), Flatten(), Dense(128, activation=\'relu\'), Dense(512, activation=\'relu\') # 假设我们的特征维数为512])# 编译模型(这里不训练模型,只是创建模型结构)model.compile(optimizer=\'adam\', loss=\'categorical_crossentropy\')# 展示模型结构model.summary()在上述代码中,我们构建了一个包含两个卷积层和两个全连接层的简单CNN模型,输出层的单元数被设置为512,意味着每个输入图像将被转化为一个512维的特征向量。

5.2.3 特征提取方法的比较与分析

选择合适的人脸特征提取方法需要考虑多个因素,包括算法的准确性、实时性、可扩展性和计算资源等。传统方法因其简单性在小规模或实时性要求高的应用中仍有一席之地,但在复杂场景和大规模部署时,基于深度学习的方法通常能提供更高的准确性。

在实际应用中,特征提取方法的选择往往需要根据项目的具体需求、数据集的特点以及可用资源等因素进行综合权衡。随着技术的不断进步,人脸识别的特征提取方法将持续优化和创新,以满足不断变化的市场需求和技术挑战。

6. 使用face_recognition库进行人脸识别

6.1 face_recognition库入门指南

face_recognition是一个易于使用的Python库,它使得人脸识别变得非常简单。通过它我们可以完成人脸检测、识别和比较等一系列操作。

6.1.1 face_recognition库的安装与配置

为了安装 face_recognition ,我们可以使用Python的包管理工具 pip 。打开终端或命令提示符并输入以下命令:

pip install face_recognition 如果在安装过程中遇到权限问题,可以使用 sudo (在Mac或Linux上)或以管理员身份运行命令提示符(在Windows上)。

安装完成后,我们需要验证安装是否成功。在Python环境中运行以下代码:

import face_recognition# 如果没有错误发生,说明安装成功print(\"face_recognition库安装成功!\")6.1.2 face_recognition库的结构和基本功能

face_recognition 库主要由以下几个部分组成:

- 人脸检测 :这个库使用dlib的深度学习模型来检测图像中的人脸。

- 人脸编码 :在检测到人脸后,库会对人脸进行编码,这些编码可以用于比较不同的人脸是否相同。

- 人脸比较 :库提供了比较两组人脸编码相似度的方法。

基本功能的使用非常简单,这里有一个简单的示例:

import face_recognition# 加载图片并识别人脸image_path = \"path_to_image.jpg\"image = face_recognition.load_image_file(image_path)face_locations = face_recognition.face_locations(image)face_encodings = face_recognition.face_encodings(image, face_locations)# 打印信息print(\"找到 {} 张人脸\".format(len(face_locations))) 这段代码首先加载了一个图片文件,然后使用 face_recognition 库的人脸检测功能找到图像中的人脸,并对其进行编码。

6.2 使用face_recognition进行人脸检测和识别

6.2.1 人脸检测的实现方法

face_recognition 库中的人脸检测方法非常直接:

import face_recognitionimage = face_recognition.load_image_file(\"your_image.jpg\")face_locations = face_recognition.face_locations(image)for face_location in face_locations: top, right, bottom, left = face_location print(\"A face is located at pixel location Top: {}, Left: {}, Bottom: {}, Right: {}\".format(top, left, bottom, right))上面的代码段首先加载了图片,然后检测图片中的人脸,并遍历检测到的人脸,打印出它们在图像中的位置坐标。

6.2.2 人脸比对和识别的实现方法

当我们想识别特定人脸的时候,我们可以比对新图像的人脸编码和已知人脸编码:

import face_recognitionknown_image = face_recognition.load_image_file(\"known_person.jpg\")unknown_image = face_recognition.load_image_file(\"unknown_person.jpg\")# 编码已知图片和未知图片中的人脸known_face_encoding = face_recognition.face_encodings(known_image)[0]unknown_face_encoding = face_recognition.face_encodings(unknown_image)[0]# 比较两个人脸编码是否匹配results = face_recognition.compare_faces([known_face_encoding], unknown_face_encoding)print(\"这是否是已知的人脸?\", results) 该代码段首先加载了已知和未知的人脸图片,并对它们进行编码。然后使用 compare_faces 函数比较已知人脸编码和未知人脸编码是否匹配。

6.3 face_recognition库高级应用

6.3.1 人脸识别项目实战案例分析

一个实际的人脸识别案例可能包括以下步骤:

- 图像采集:使用摄像头或上传图片的方式来获取人脸图像。

- 人脸检测:使用

face_recognition库进行人脸检测,获取人脸位置。 - 人脸编码:对检测到的人脸进行编码。

- 人脸识别:将编码与数据库中存储的已知人脸编码进行比对,进行识别。

- 输出结果:根据比对结果输出识别结果。

6.3.2 人脸识别系统集成和优化策略

集成人脸识别系统时,要考虑性能和准确性:

- 优化识别准确性 :确保有高质量的训练数据集,提高模型的准确性。

- 提高识别速度 :使用更快的硬件,优化算法,使用更有效的图像预处理方法。

- 用户界面设计 :设计直观易用的界面,方便用户操作。

- 安全性 :确保传输和存储的数据安全,采取加密措施。

实现人脸识别系统时,要考虑到实际应用中的隐私保护和法律法规 。

通过 face_recognition 库,我们可以有效地实现人脸检测和识别功能。尽管如此,人脸识别技术依然需要我们在处理隐私和伦理问题时保持谨慎和责任感。

7. 人脸识别项目实战与未来展望

7.1 人脸识别项目的规划与设计

7.1.1 项目需求分析

人脸识别项目需要深入分析实际应用场景,明确项目目标和预期功能。例如,一个企业级的人脸识别门禁系统可能会要求实时性、高准确率和安全性。需求分析阶段应该包含以下步骤:

- 目标定义 :确定项目的最终目标,例如提高安全级别、优化用户体验等。

- 功能需求 :详细说明系统应具备的功能,如自动识别、数据管理、实时反馈等。

- 性能需求 :包括识别率、响应时间、并发处理能力等。

- 安全性要求 :考虑系统的数据加密、防篡改、隐私保护等安全性措施。

- 法律和伦理考量 :确保项目遵守相关法律法规,如GDPR或中国个人信息保护法等。

7.1.2 系统架构设计和模块划分

在系统架构设计阶段,我们需要将复杂系统分解成可管理的模块。一般来说,人脸识别系统可包括以下模块:

- 数据采集模块 :负责获取人脸图像数据。

- 预处理模块 :改善图像质量,如调整大小、去噪、归一化等。

- 检测模块 :从图像中定位人脸。

- 特征提取模块 :分析并提取人脸的关键特征。

- 比对模块 :将提取的特征与数据库中已有数据进行比对。

- 决策模块 :根据比对结果做出最终决策。

- 用户界面 :提供与用户交互的可视化界面。

整个系统架构的模块化设计有助于提高开发效率,便于维护和扩展。

7.2 人脸识别项目的开发与部署

7.2.1 开发环境搭建

在开发人脸识别系统时,选择合适的开发环境至关重要。这通常包括硬件环境和软件环境。硬件环境可能包括多GPU服务器,而软件环境则涉及操作系统、编程语言、必要的库和框架。例如:

- 操作系统 :Linux服务器,如Ubuntu 18.04。

- 编程语言 :Python,因为有许多现成的库,如OpenCV、face_recognition等。

- 深度学习框架 :TensorFlow或PyTorch。

- 数据库 :如MySQL或MongoDB,用于存储特征向量和用户信息。

7.2.2 人脸识别系统的部署和维护

部署阶段是将开发完成的系统放到生产环境中去运行。通常包括以下步骤:

- 测试 :对系统进行彻底测试,包括单元测试、集成测试和压力测试。

- 部署 :使用Docker容器化或Kubernetes等技术,将应用部署到服务器或云平台。

- 监控 :确保系统稳定运行,设置性能监控和日志记录机制。

- 维护 :根据用户反馈和技术更新,定期进行系统优化和升级。

7.3 人脸识别技术的未来发展趋势

7.3.1 技术创新与挑战

随着技术的发展,人脸识别技术面临着诸多挑战和创新的机遇:

- 多模态融合 :结合人脸图像、声音、行为等多模态信息进行更准确的识别。

- 活体检测 :防止攻击者使用照片、视频、3D面具等手段欺骗系统。

- 边缘计算 :将计算任务在边缘节点完成,以减少延迟和带宽需求。

7.3.2 人脸识别技术的社会影响与伦理考量

人脸识别技术在便利性方面有巨大潜力,但同时也带来了隐私和社会伦理问题:

- 隐私保护 :如何在收集和使用人脸数据时保护个人隐私。

- 偏见和歧视 :确保算法不会对特定人群产生偏见。

- 法律规制 :各国对于人脸识别技术的法律约束越来越严格,开发者需要密切关注这些变化。

人脸识别技术正迅速发展,而我们对它未来可能带来的变化也应保持谨慎与敬畏之心。

本文还有配套的精品资源,点击获取

简介:本压缩包文件详细阐述了如何利用Python及其库进行人脸检测和识别。介绍了Python的易读性和丰富的库支持,如OpenCV和face_recognition,它们极大地简化了人脸识别系统开发。内容涵盖人脸检测、OpenCV中人脸检测功能,以及使用深度学习和传统机器学习方法进行人脸识别。同时提供了一个有趣的“戴圣诞帽”应用案例,展现图像合成技术的实用。

本文还有配套的精品资源,点击获取