华为云Flexus+DeepSeek征文|从理论到实践:基于华为云DeepSeek的Linux捕获性能监察之旅

前引:华为云Dify平台作为一款面向AI开发的先锋工具,以其高效的云原生架构和强大的DeepSeek推理服务,为开发者提供了从理论到实践的完整解决方案。本文基于华为云征文活动的实践体验,深入剖析Dify平台的技术创新、应用场景及产业价值,旨在为企业级AI开发提供清晰的技术洞察与实践指南。无论是追求高效部署的初创团队,还是探索智能化转型的大型企业,Dify平台都将成为连接创新与现实的桥梁,开启云端智能的新篇章!

目录

一、华为云Dify平台的战略意义与活动背景

二、华为云Dify平台的技术解析

(1)平台核心架构:云原生与AI的深度结合

(2)DeepSeek R1/V3模型的推理机制

(3)一键部署与自动化工具链的创新

三、实践体验——商用服务开通

(1)DeepSeek商用服务开通流程

(2)体验心得

四、云服务器单机部署

(1)开通教程

(2)心得分享

五、CCE高可用部署

(1)准备

获取桶名称:

获取秘钥:

创建委托:

委托授权:

(2)零基础教程

(3)部署心得

六、两种部署方式的性能对比

架构与技术基础:

扩展性:

可靠性与容错:

管理复杂度:

部署速度与灵活性:

七、Linux捕获服务器实时性能

(1)安装插件

(2)监控实时性能

八、针对本次活动Dify应用的建议

九、全程实操感受

(1)部署

(2)功能体验

(3)集成体验

(4)性能与稳定性

一、华为云Dify平台的战略意义与活动背景

战略意义:

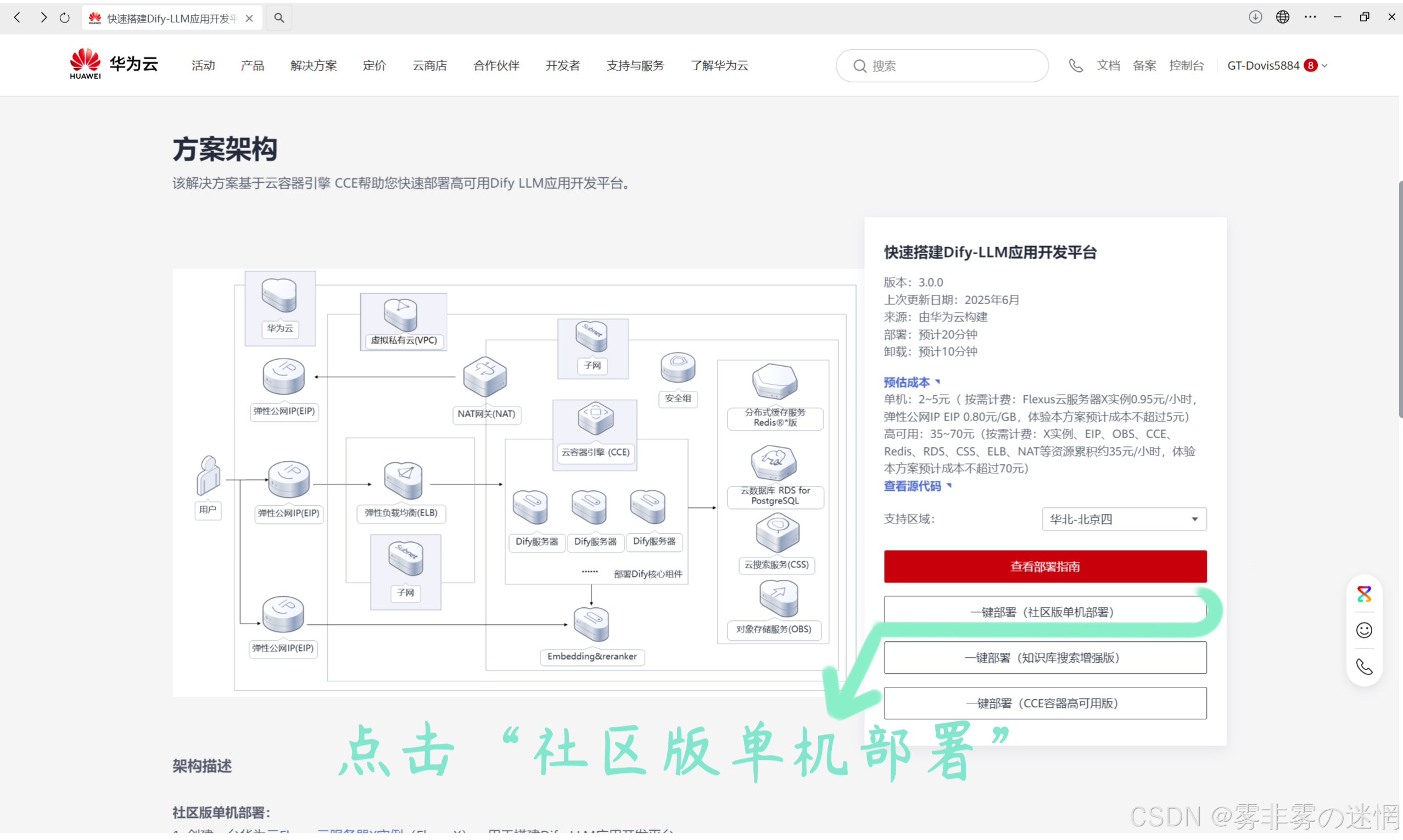

华为云Dify平台定位为一站式AI应用开发平台,旨在通过云原生技术和大模型推理服务(如DeepSeek R1/V3),降低AI开发的复杂性,推动AI技术的普惠化。图片中的架构图显示,Dify平台整合了虚拟私有云(VPC)、弹性负载均衡(ELB)和对象存储(OBS)等云服务,为企业提供高效、灵活的AI开发环境。其战略目标是赋能企业快速构建智能化应用,覆盖智能客服、实时推荐、数据分析等场景,助力数字化转型!

活动背景:

华为云通过CSDN开发者社区等平台举办征文活动,鼓励开发者分享Dify平台的使用体验和技术洞察。活动强调Dify的“一键部署”功能和DeepSeek模型的商用能力,旨在推动AI技术的广泛应用。ModelArts Studio界面和Dify部署流程进一步表明,华为云通过提供直观的操作界面和透明的计费模式,吸引开发者参与AI生态建设,构建开放的产业协同网络!

二、华为云Dify平台的技术解析

(1)平台核心架构:云原生与AI的深度结合

云原生架构:

Dify平台基于Kubernetes实现容器化管理,通过弹性负载均衡(ELB)实现流量分配,结合虚拟私有云(VPC)确保网络隔离和安全性。对象存储(OBS)和数据库服务(如Redis、RDS)支持高效的数据存储与访问。这种架构保证了资源的高效调度和弹性伸缩,适应高并发和动态负载需求!

AI服务的深度集成:

平台集成了DeepSeek R1/V3等大模型推理服务,支持多模态数据处理(如文本、图像)Embedding & Re-ranker模块表明,Dify通过算法优化增强了搜索和推荐场景的性能ModelArts Studio作为AI开发核心,提供从数据预处理到模型训练和推理的全流程支持

优势与特点:

高可用性:多可用区部署和负载均衡机制确保服务连续性,降低单点故障风险

自动化运维:通过CI/CD管道和自动化工具链,简化模型部署和版本管理

模块化设计:支持灵活的功能组合,开发者可根据需求选择特定模块(如推理服务、数据存储)

安全性:VPC和安全组配置保障数据隐私,满足企业级合规要求

(2)DeepSeek R1/V3模型的推理机制

全程数学指导体:

DeepSeek采用“全程数学指导体”技术,通过数学建模优化输入数据的处理流程。这种机制通过结构化分析和算法优化,减少推理过程中的计算误差,提高预测准确性,特别适用于复杂场景如金融风控和实时推荐

高效推理优化:

DeepSeek通过模型压缩、量化技术以及混合精度计算,显著降低推理延迟。负载均衡(ELB)和多实例部署架构表明,DeepSeek支持高并发推理,能够处理大规模用户请求,适用于实时性要求高的场景

动态资源调度:

平台利用云原生架构的动态调度能力,根据推理任务的负载需求自动分配计算资源(如GPU/TPU)。这确保了推理过程在高负载场景下的稳定性,同时优化了资源利用率

多模态支持:

DeepSeek支持文本、图像等多模态数据处理,Embedding模块展示了其在多维数据分析中的能力。这种机制通过特征提取和数据重排优化,提升了推理结果的相关性和准确性

适用场景:

DeepSeek R1适用于大规模模型训练和数据分析,V3则更适合高性能推理场景,如智能客服和自动驾驶。计费(如DeepSeek-V3-32K:输入0.004¥/千Tokens,输出0.016¥/千Tokens)表明其成本透明,适合企业灵活选择!

(3)一键部署与自动化工具链的创新

-

一键部署的创新:

部署流程展示了Dify平台通过直观的界面和预配置模板,实现“一键部署”。开发者无需深入了解底层技术,只需几步即可完成从环境配置到应用上线的全过程。例如,图片中的步骤指导用户通过ModelArts Studio快速开通DeepSeek服务,自动完成资源分配和模型部署 -

自动化工具链:

Dify平台通过集成CI/CD管道和自动化运维工具,简化了AI应用的开发、测试和部署流程。ModelArts Studio界面显示,平台支持自动化数据预处理、模型训练和推理部署,减少人工干预。自动化健康检查和动态扩缩容功能进一步确保了服务的高可用性 -

创新优势:

低门槛:一键部署功能使非专业开发者也能快速上手,适合初创团队和中小型企业

高效性:自动化工具链缩短了开发周期,加快了从原型到生产环境的转化速度

灵活性:支持按需配置资源(如计算实例、存储容量),优化成本并满足多样化需求

生态支持:通过开放API和模块化设计,Dify与第三方工具无缝集成,增强了开发灵活性

三、实践体验——商用服务开通

(1)DeepSeek商用服务开通流程

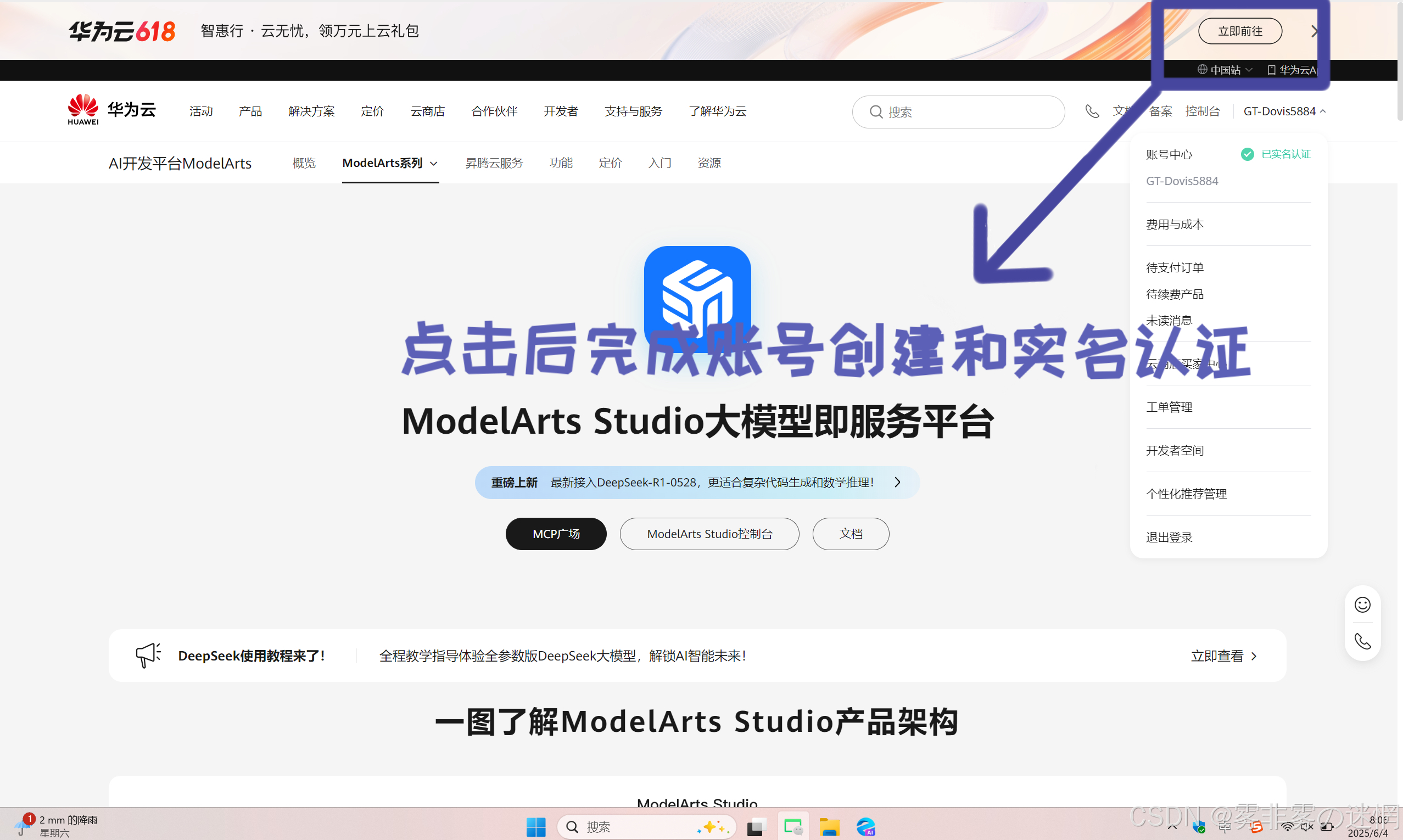

(1)新人需要先登录华为云平台,然后完成认证才可以使用各种服务

(2)打开控制台,开始开通商用服务

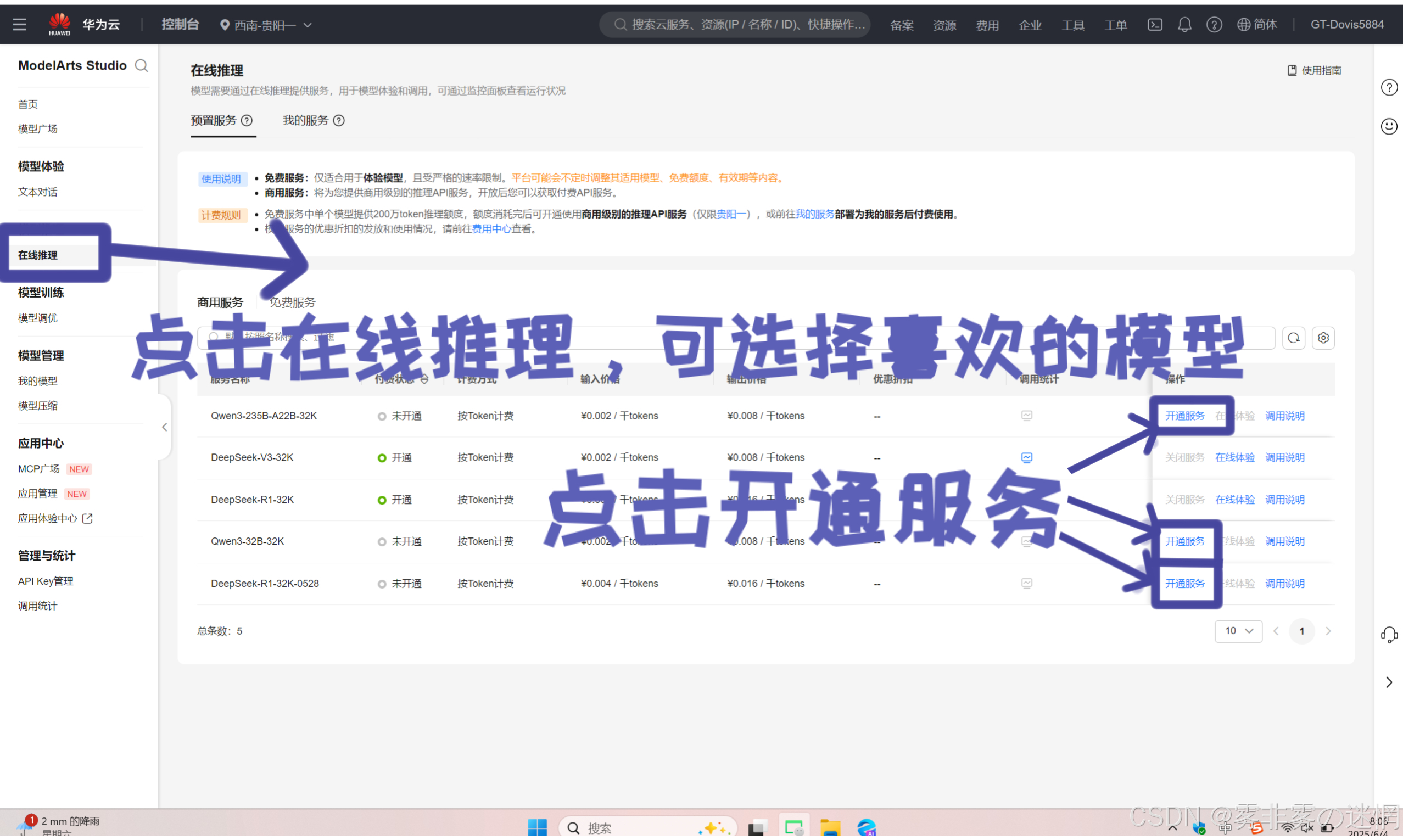

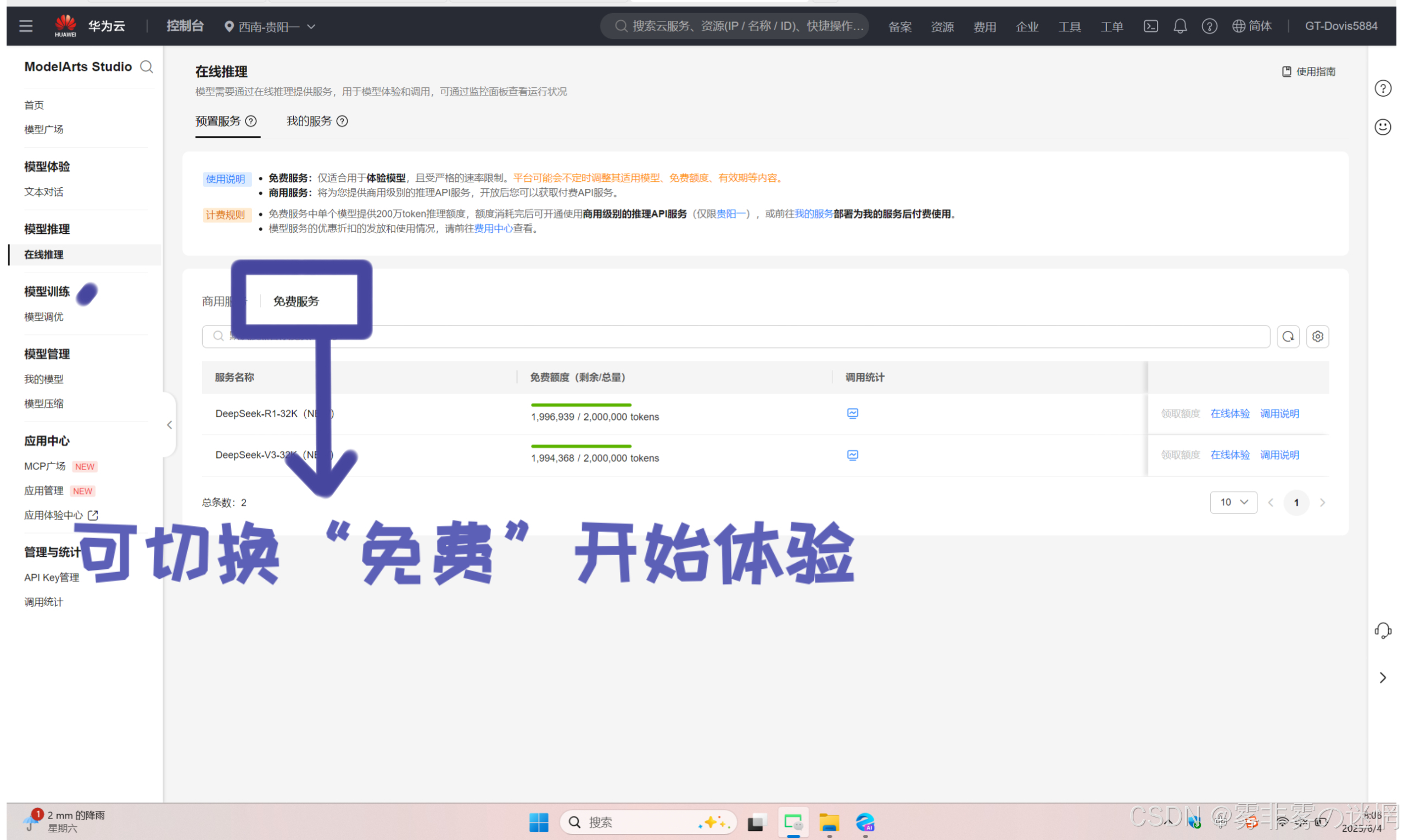

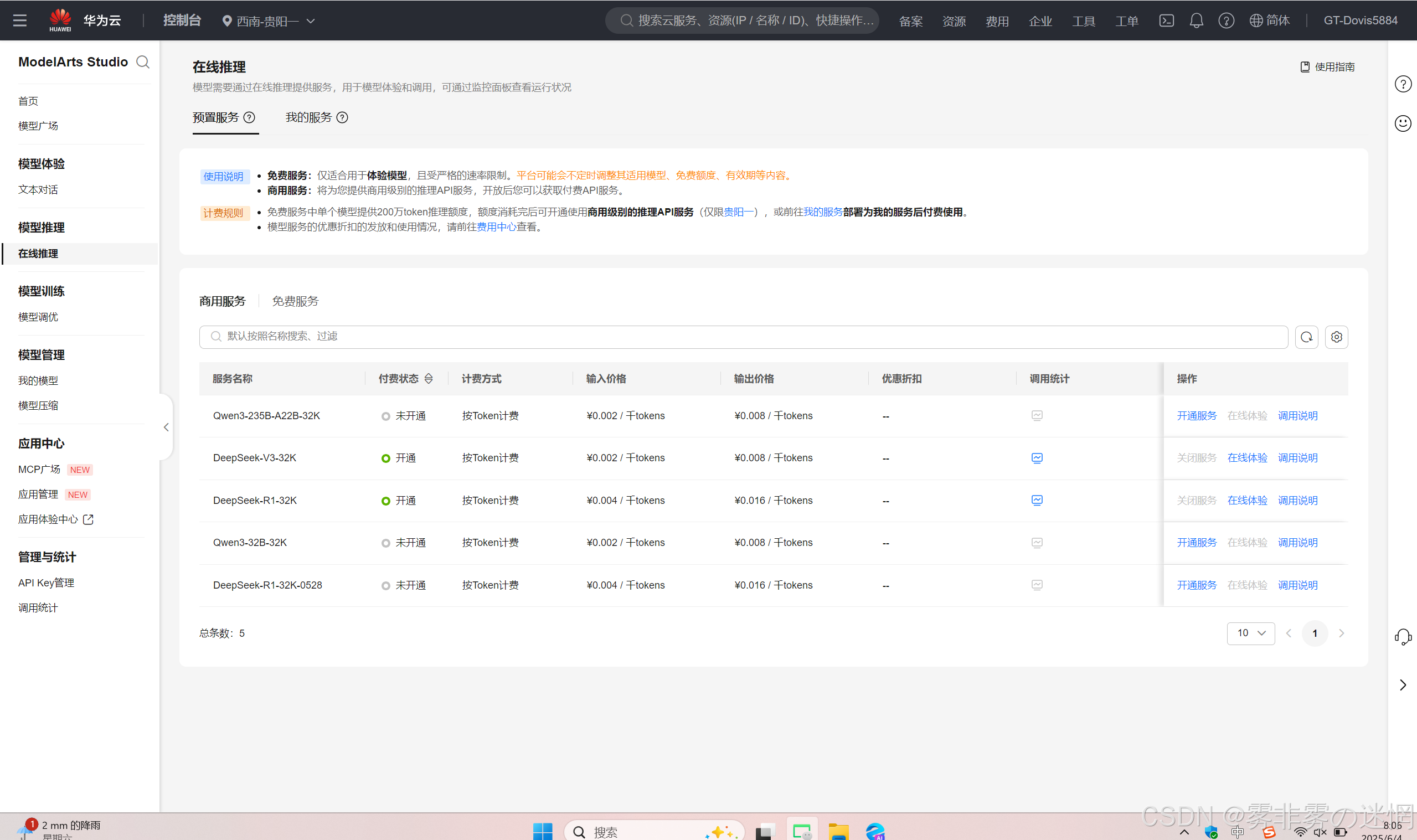

(3)点击左边功能栏的:在线推理,开通喜欢的模型

可以先免费领取额度使用免费服务

(2)体验心得

我最近体验了开通华为云 ModelArts Studio 平台上的 DeepSeek R1/V3商用服务。这次体验让我深刻感受到华为云在人工智能服务领域的便捷性和高效性,以下是我的心得体会:

操作简单,用户友好

华为云 ModelArts Studio 平台的界面设计非常直观,无论是初次接触的个人用户还是企业用户,都能快速上手。在开通服务的过程中,我通过左侧导航栏轻松找到“模型管理”和“应用中心”等选项,点击“开通服务”按钮后,系统清晰地引导我完成了整个流程。整个操作无需复杂的技术背景!

计费透明,灵活选择

平台对 DeepSeek R1 和 DeepSeek V3 的计费方式采用了按Token计费,费用结构一目了然。例如,DeepSeek-R1-32K 的输入费用为0.002 Token/次,输出费用为0.008 Token/次,这种透明的计费模式非常适合预算有限但希望接触前沿技术的学生,帮助他们在学习和实践中合理控制成本

服务多样,助力实践教学

华为云提供了多种AI服务选择,比如 DeepSeek R1、DeepSeek V3 以及其他模型如 Qwen3-235B,覆盖了从数据处理到模型推理的多种场景。可以通过这些服务参与真实项目,比如数据分析、算法开发等,积累宝贵的实践经验

管理便捷,支持职业发展

开通服务后,平台的在线管理功能让我印象深刻。用户可以实时查看服务状态、调用数据和运行效果,遇到问题还能通过平台快速调试。通过华为云平台接触企业级AI工具,为未来进入信息技术、电子商务等行业打下坚实基础!

四、云服务器单机部署

(1)开通教程

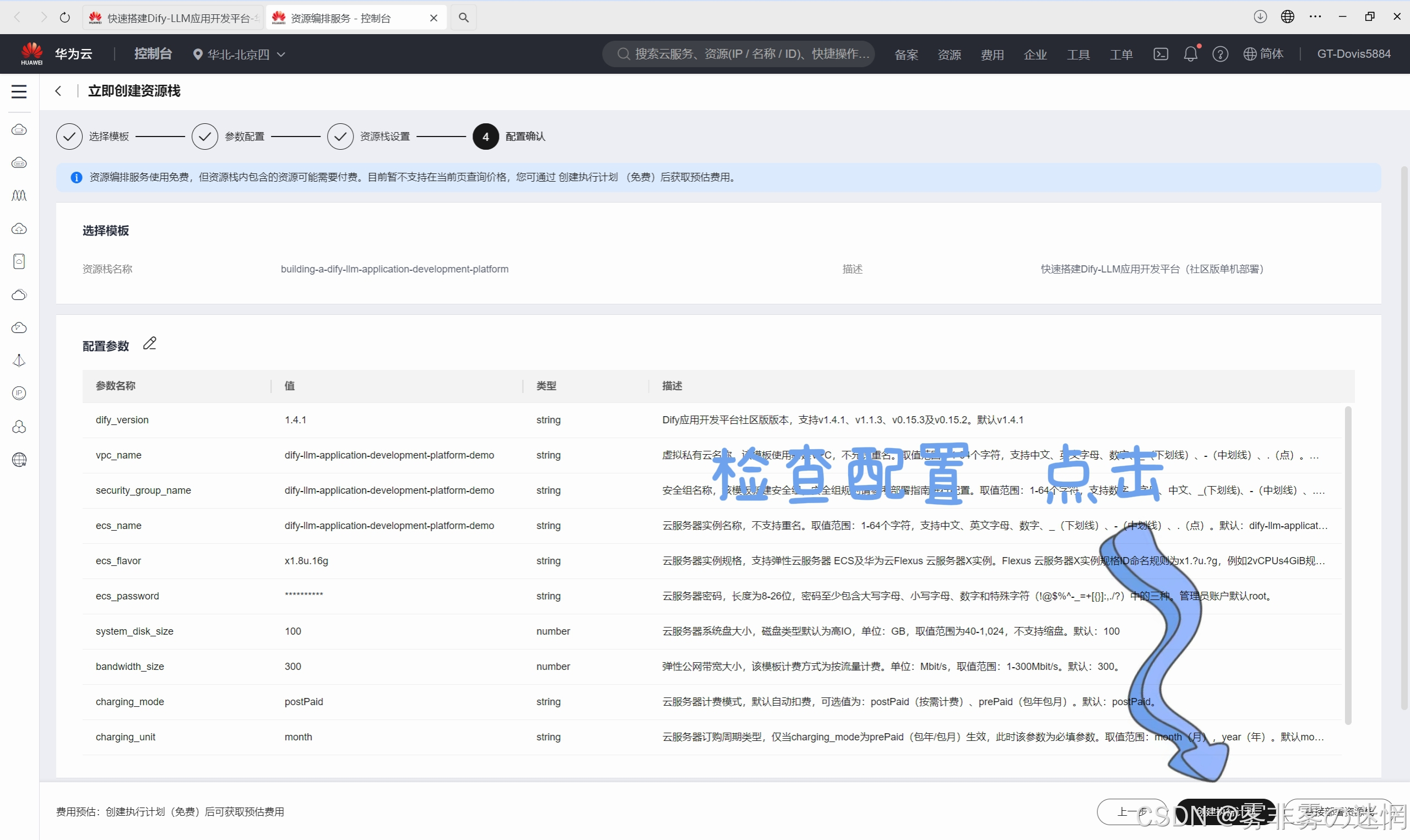

(1)点击华为云单机部署

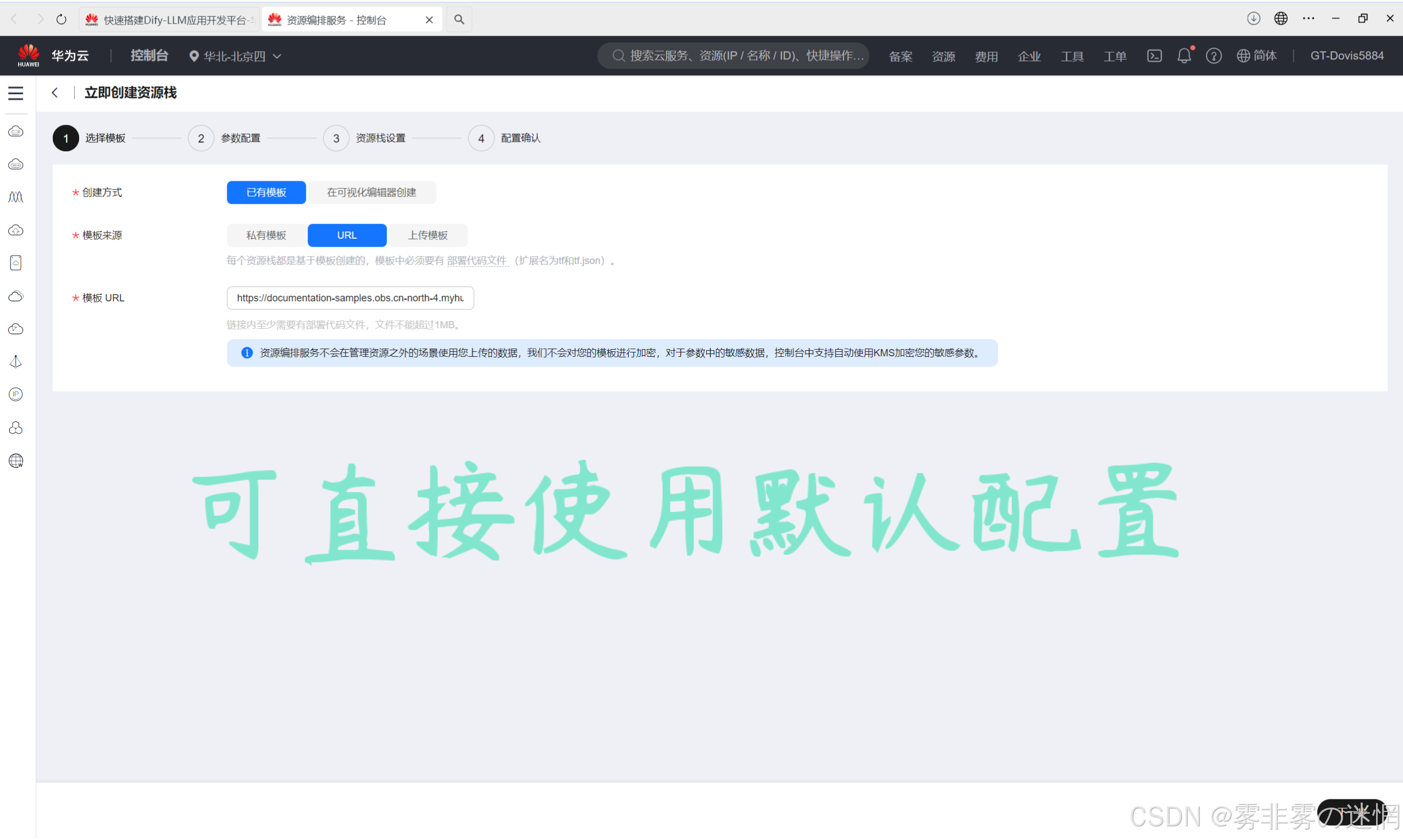

(2)选择默认配置,先一步

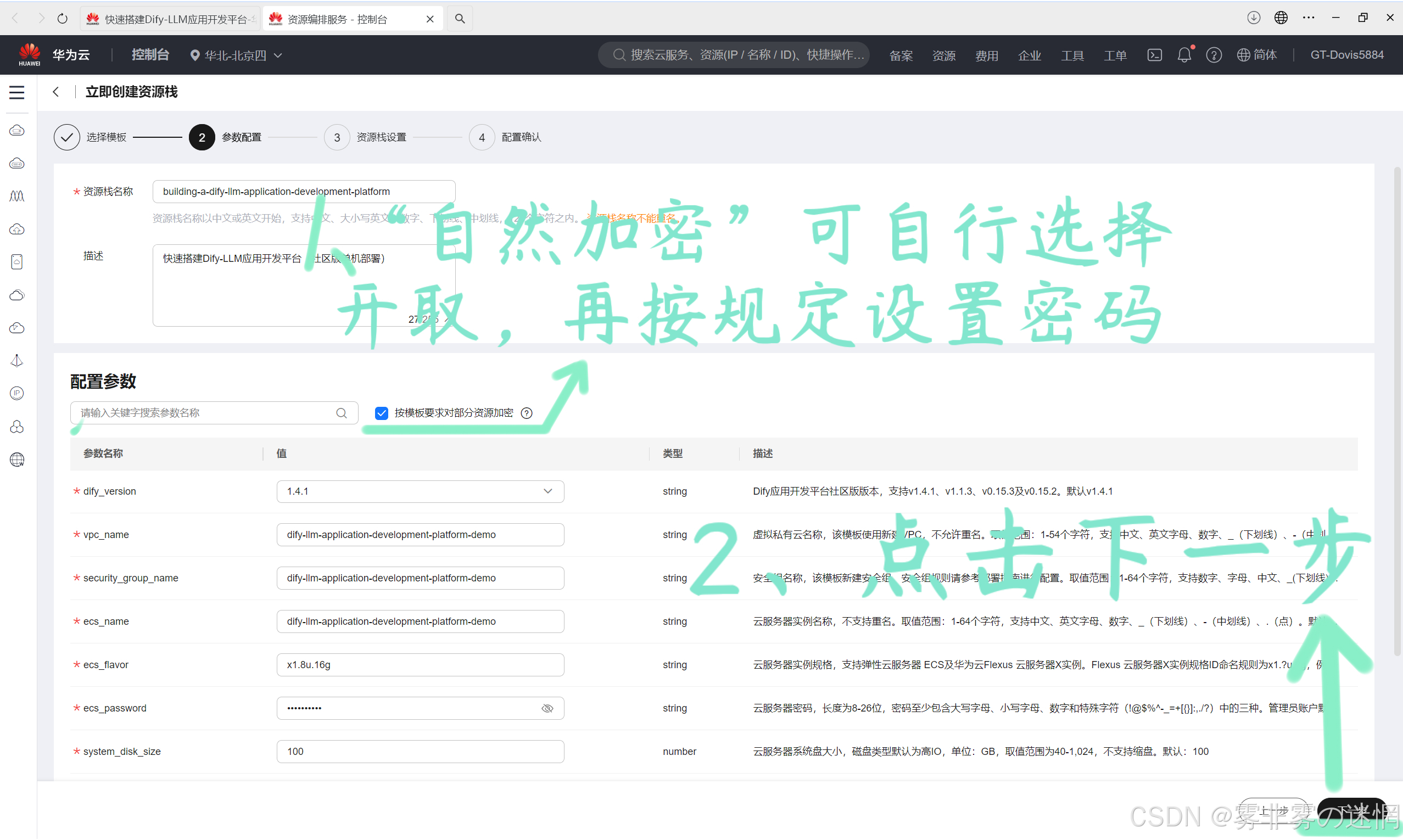

(3)版本可以选择默认/自行设置,加密只是对当前密码掩饰一下,自选即可,设置密码

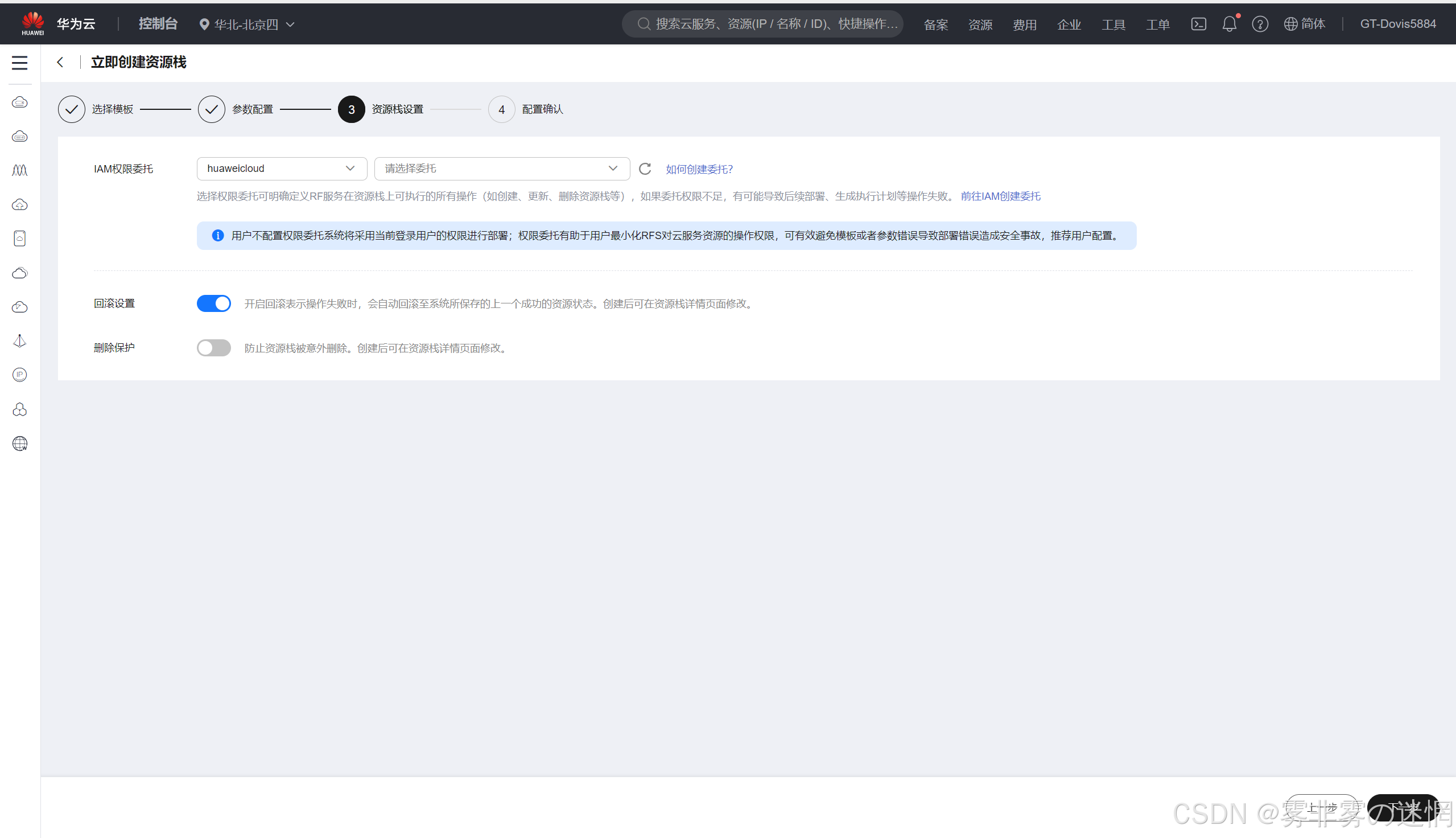

(4)我们可以打开回滚可以大大提高效率,删除保护自定义开启,没问题了就点击下一步

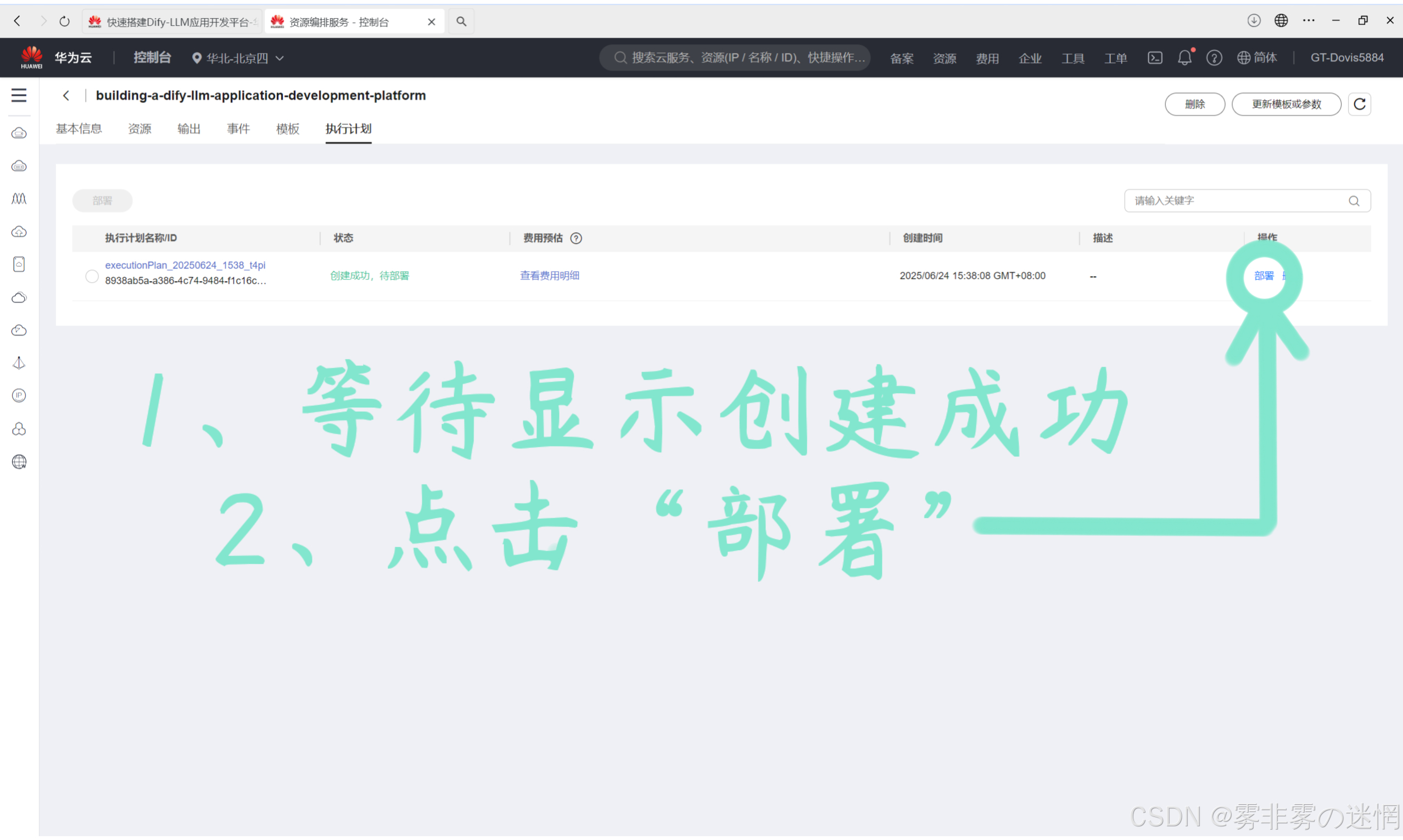

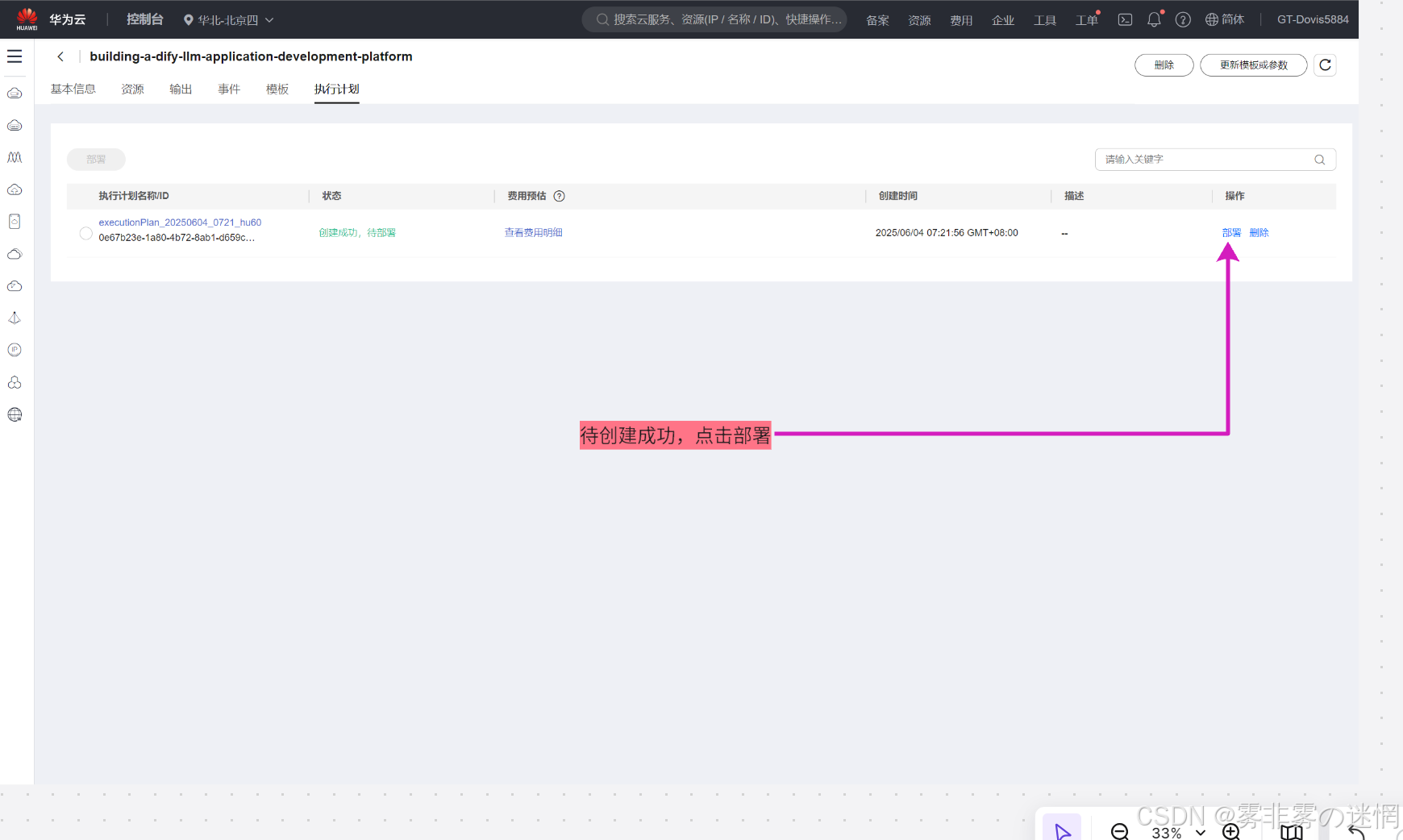

(5)确认配置,直接创建执行计划,然后确认创建执行计划

(6)待显示创建成功,点击开始部署

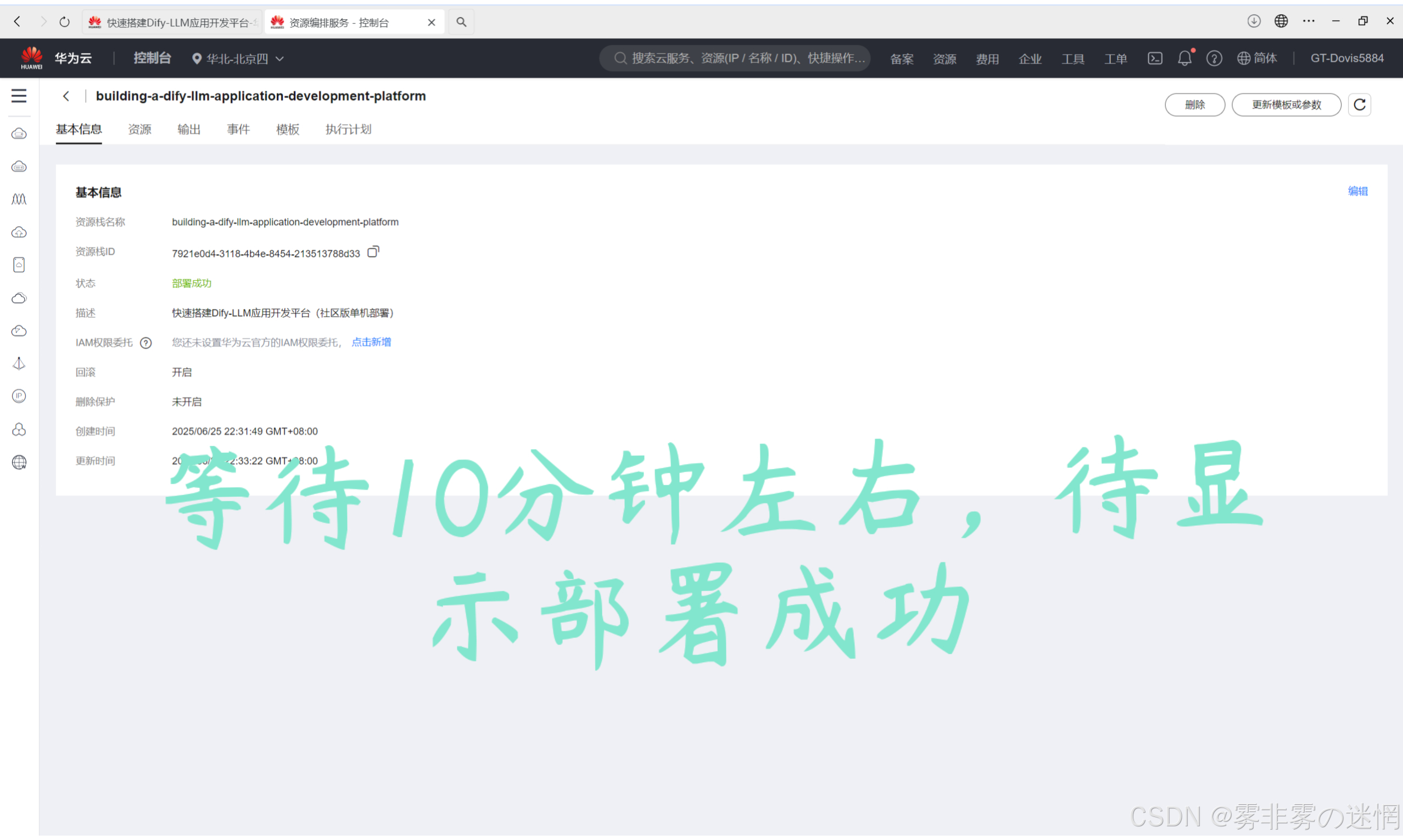

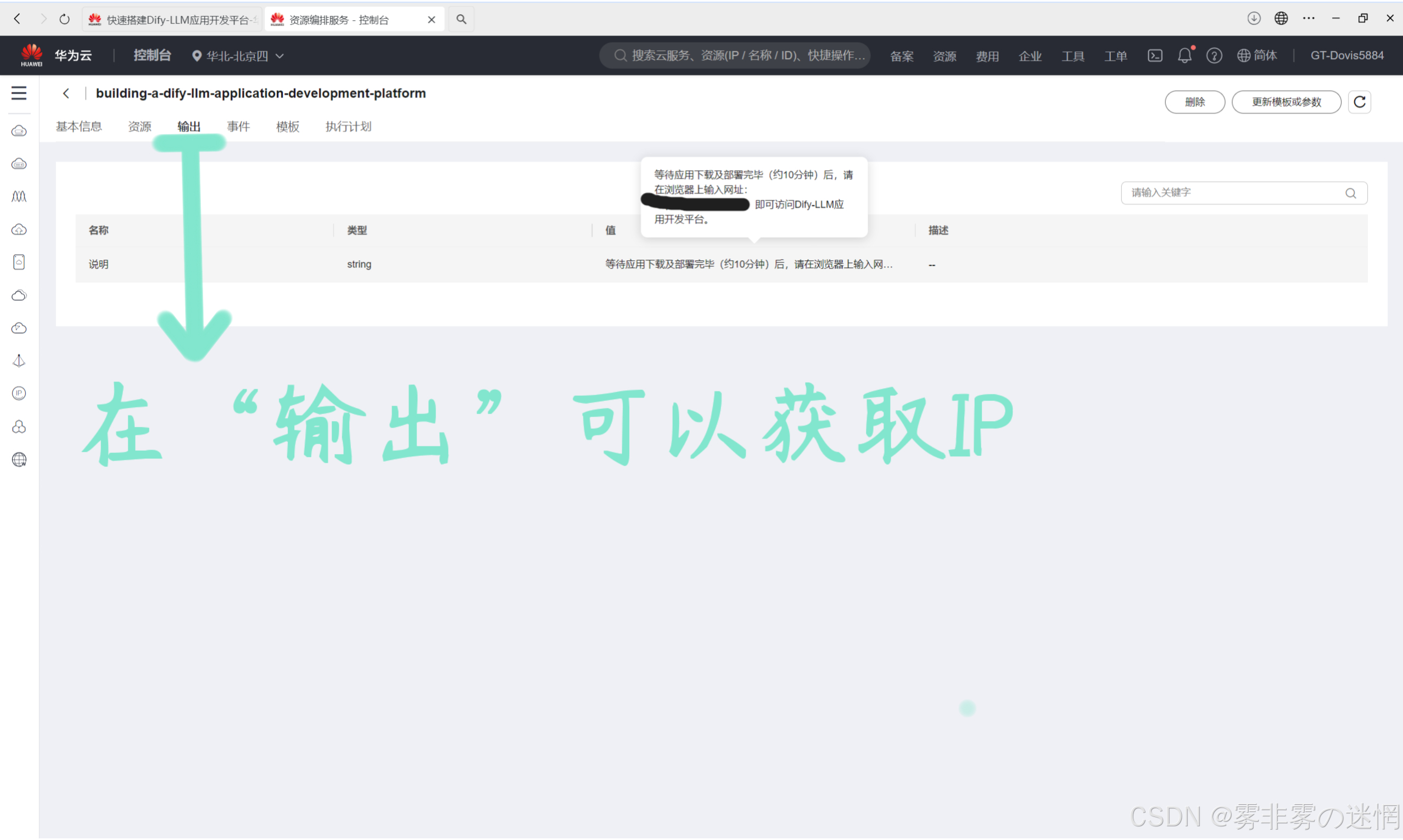

(7)预计10分钟会显示部署成功,打开“输出”,这里的IP就是后面登录Dify的公网IP

(2)心得分享

在体验华为云云服务器单机部署时,我通过Flexus云服务完成了快速部署,整体流程简单高效,特别适合小型应用或快速验证场景。开发者只需选择操作系统、计算资源(如CPU/内存)并完成一键初始化,即可快速搭建运行环境。单机部署的优势在于操作门槛低,费用透明(按需计费),适合预算有限的初创团队或测试环境。然而,由于依赖单台服务器,系统在高并发场景下容易出现性能瓶颈,且需要手动配置备份和故障恢复机制,运维工作量稍大。一键部署流程进一步简化了操作,但可靠性仍需通过额外的配置(如快照备份)来保障!

体验亮点:

快速上手:界面化操作,适合初学者,数分钟即可完成部署

灵活配置:支持按需调整资源,如增加存储或升级CPU

成本效益:按需计费模式,适合低预算场景

五、CCE高可用部署

(1)准备

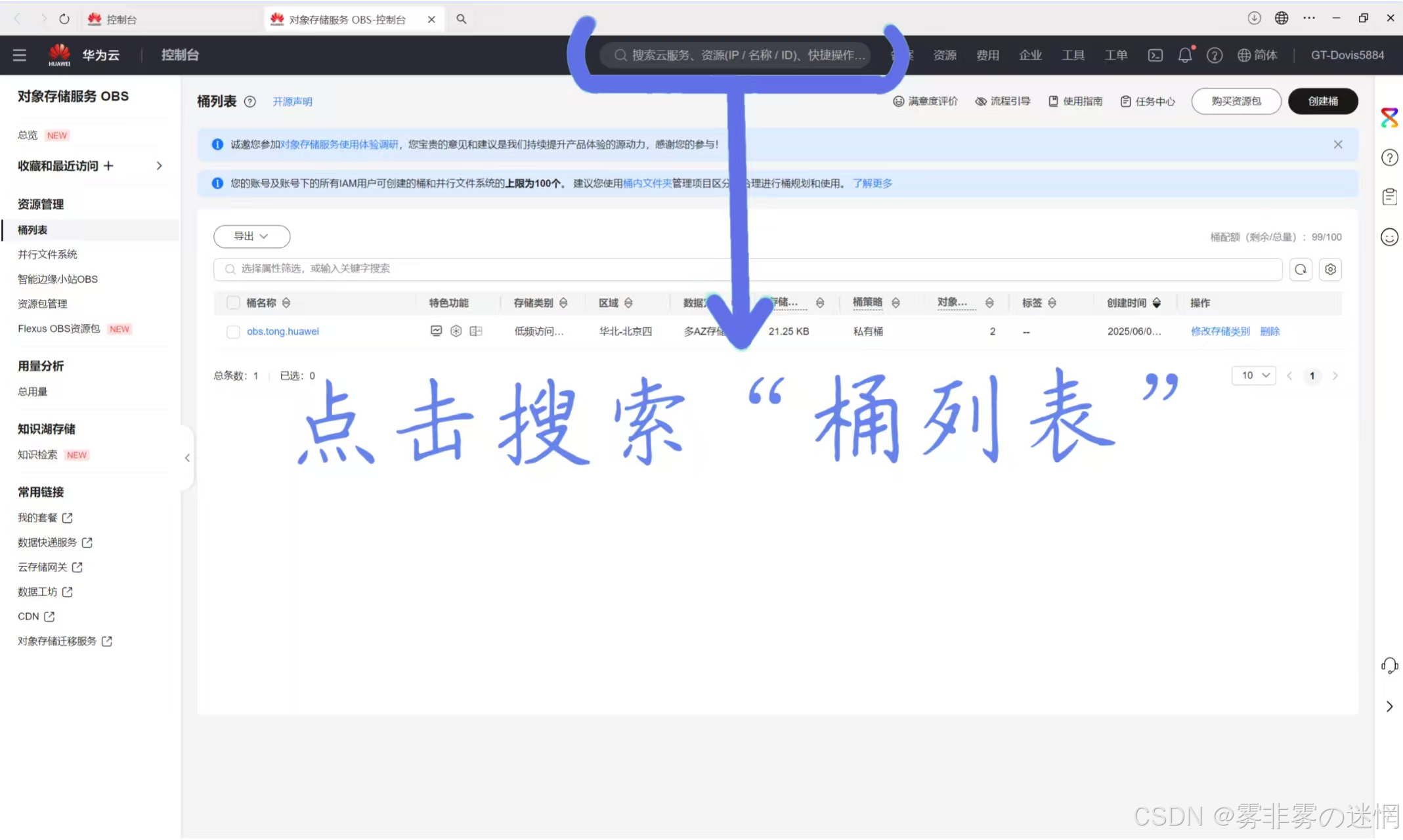

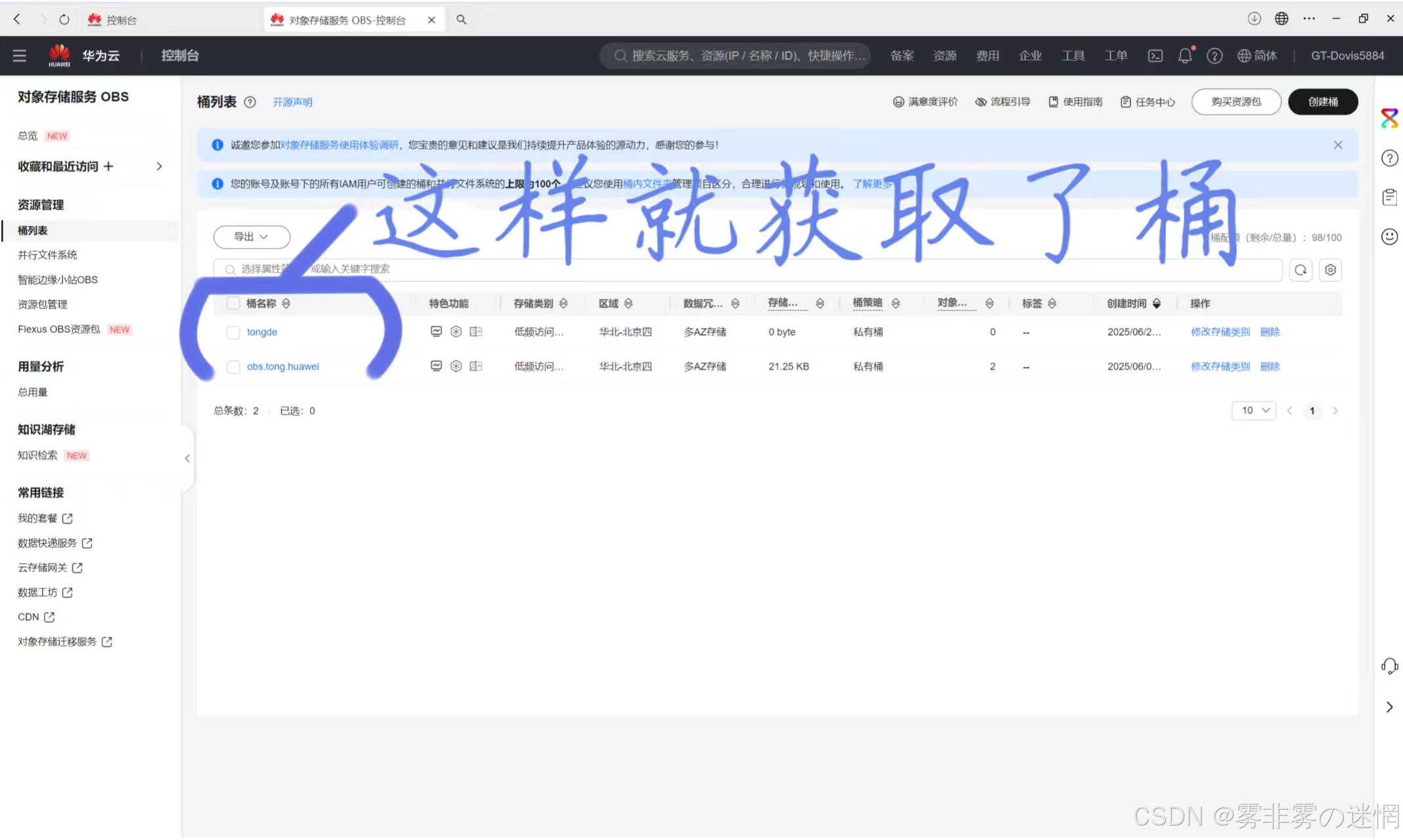

获取桶名称:

(1)搜索桶列表,点击创建

(2)完成桶的配置

(3)获取到桶名称

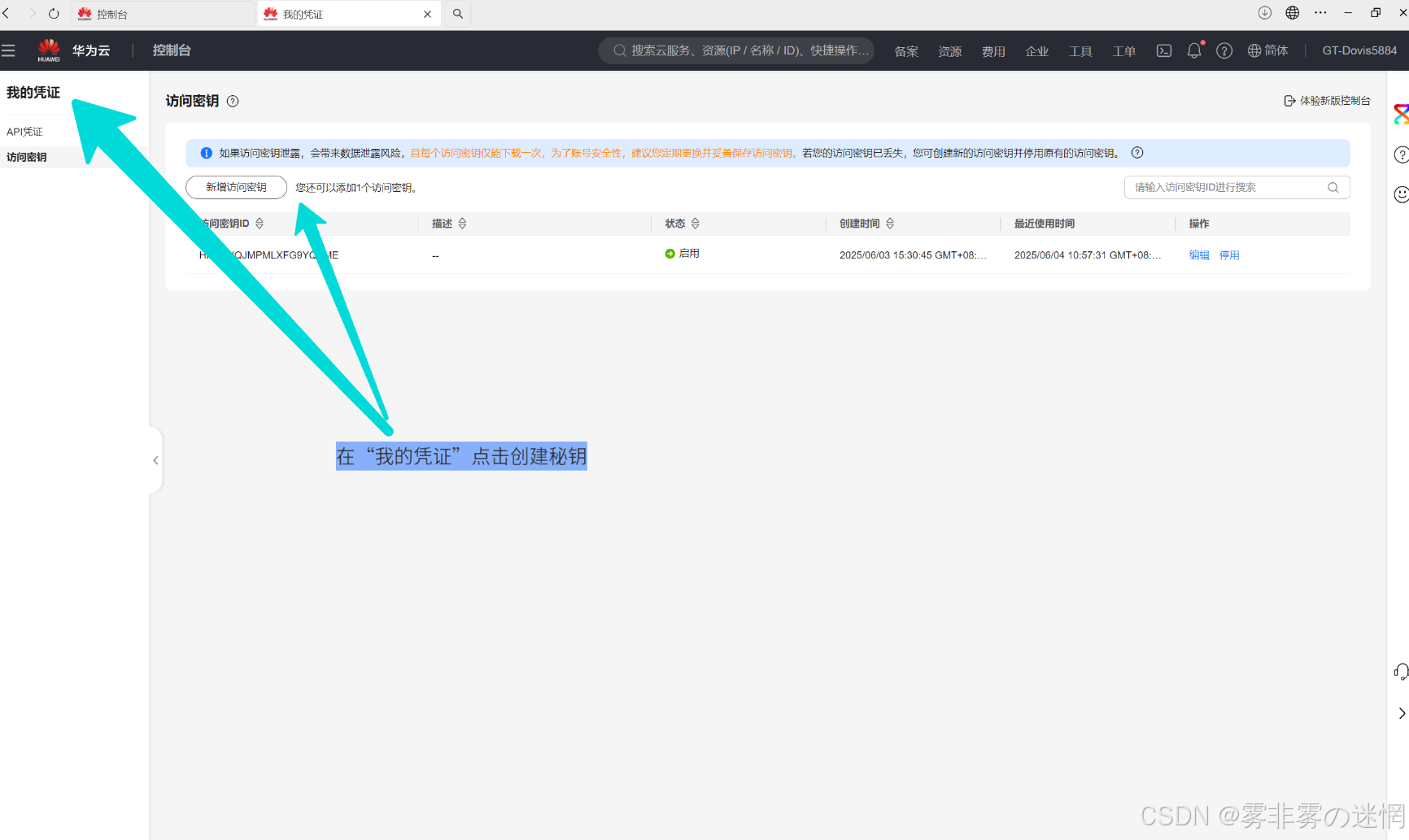

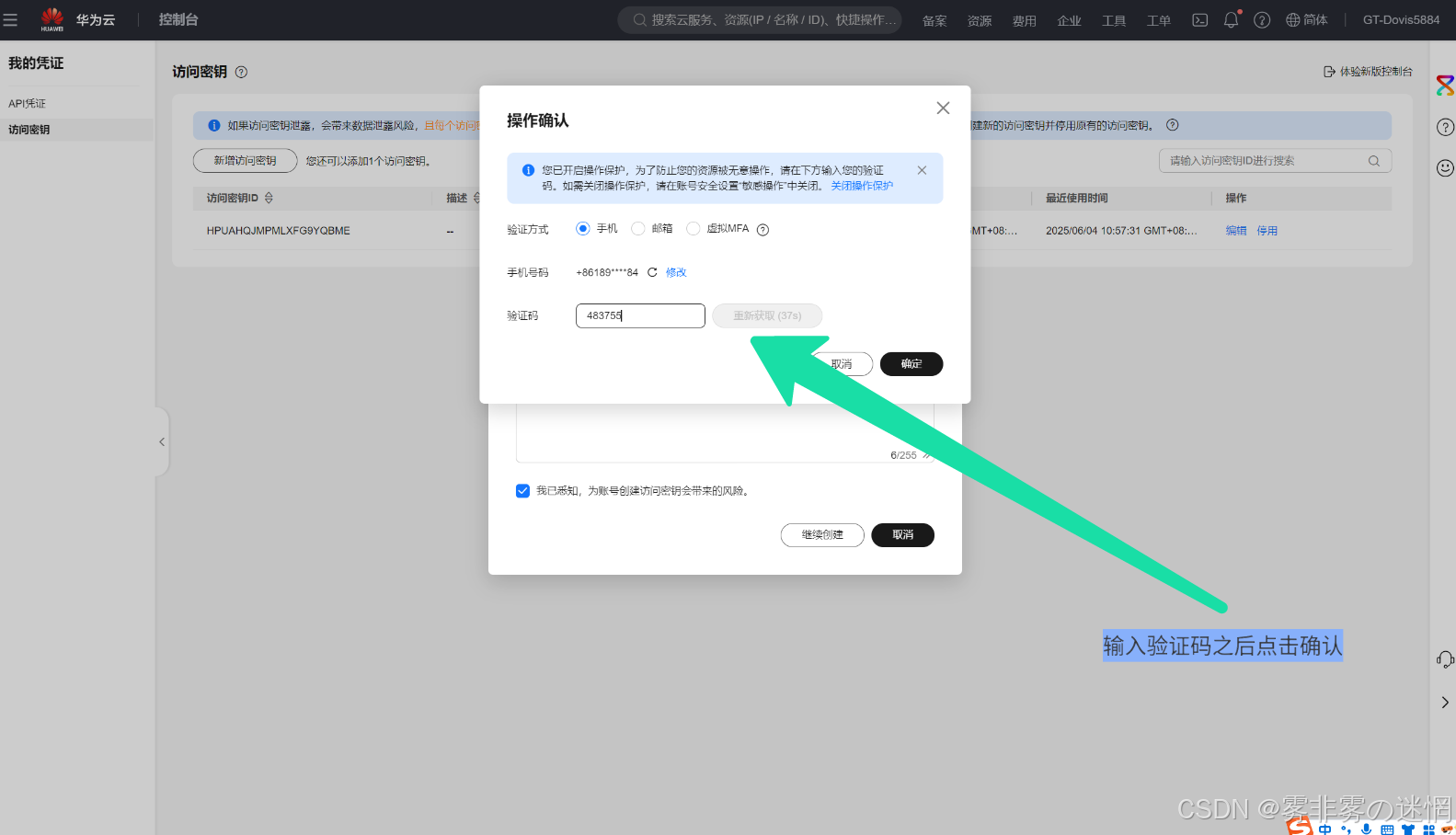

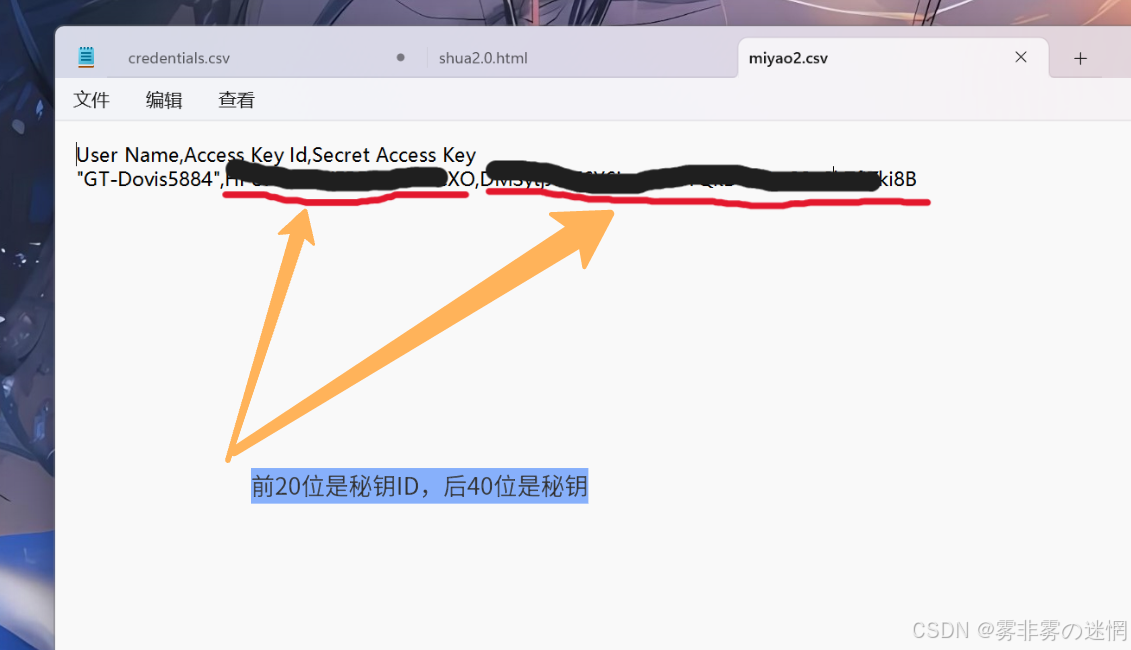

获取秘钥:

(1)可以在控制台搜索我的凭证

(2)打开访问秘钥,点击创建秘钥,秘钥只能查看一次,注意保存

(3)查看秘钥

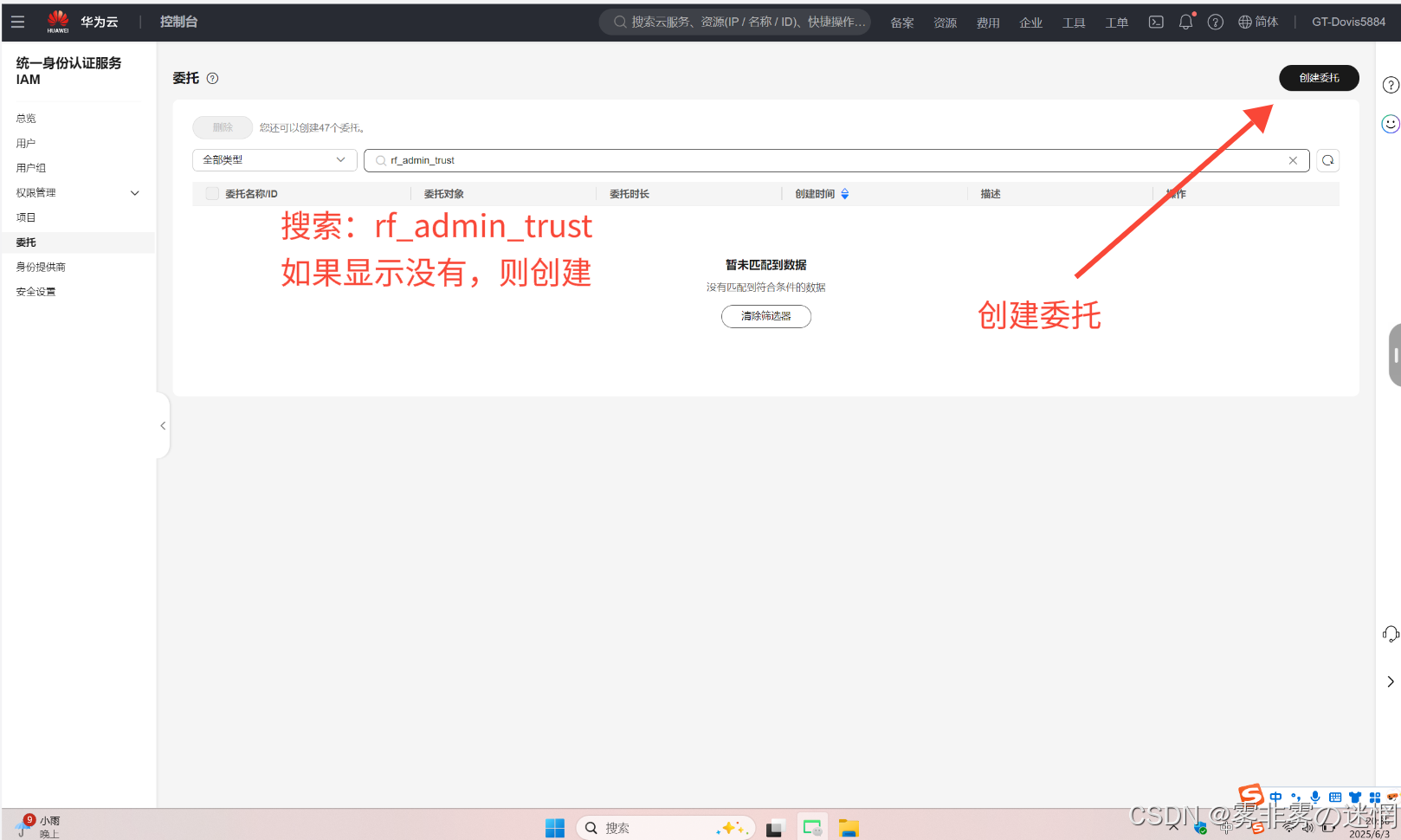

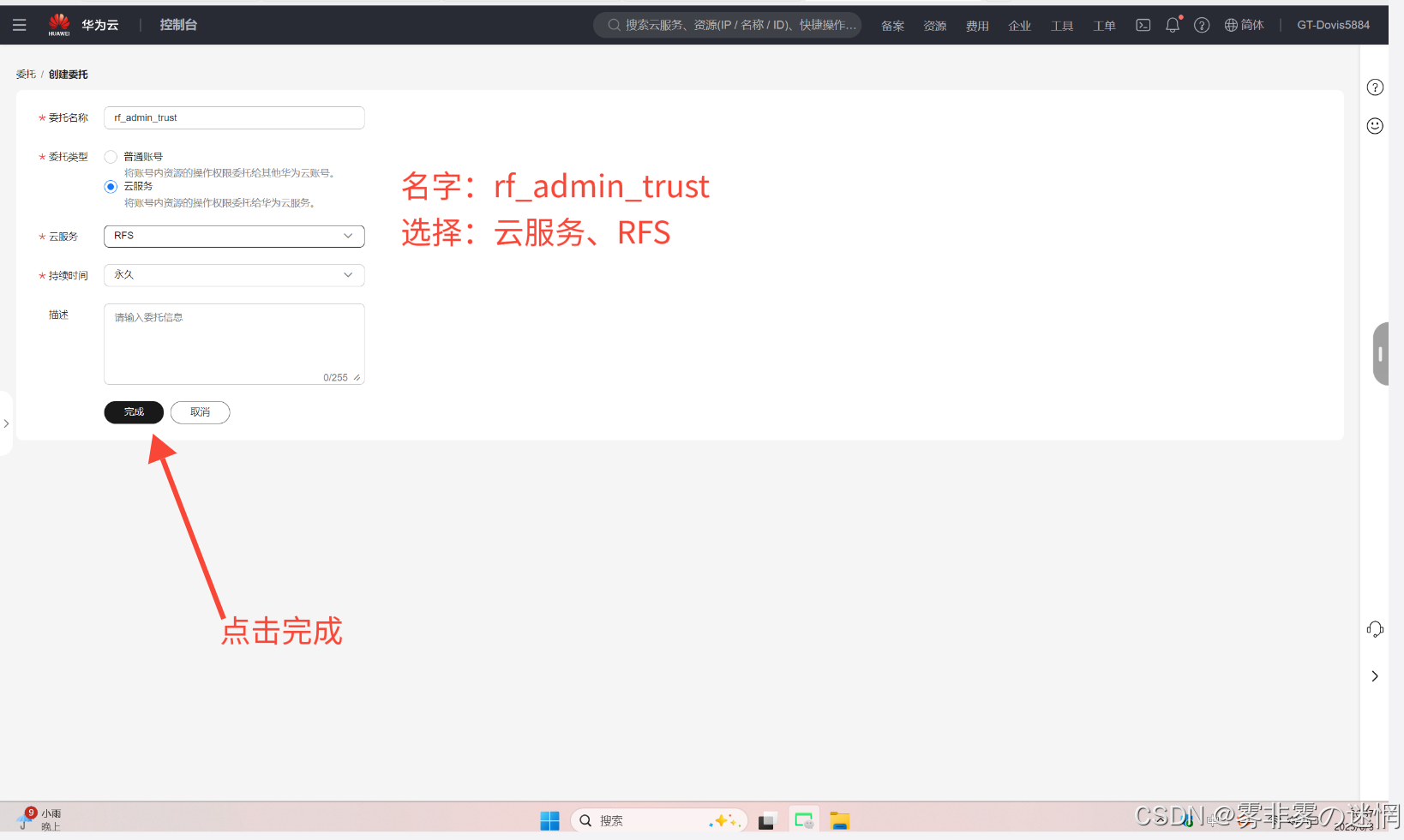

创建委托:

(1)可以直接在控制台搜索“委托”,搜索下面这个委托名,如果显示没有,就需要创建一个

(2)名字设置为:rf_admin_trust,选择云服务,RFS编排,完成委托的配置

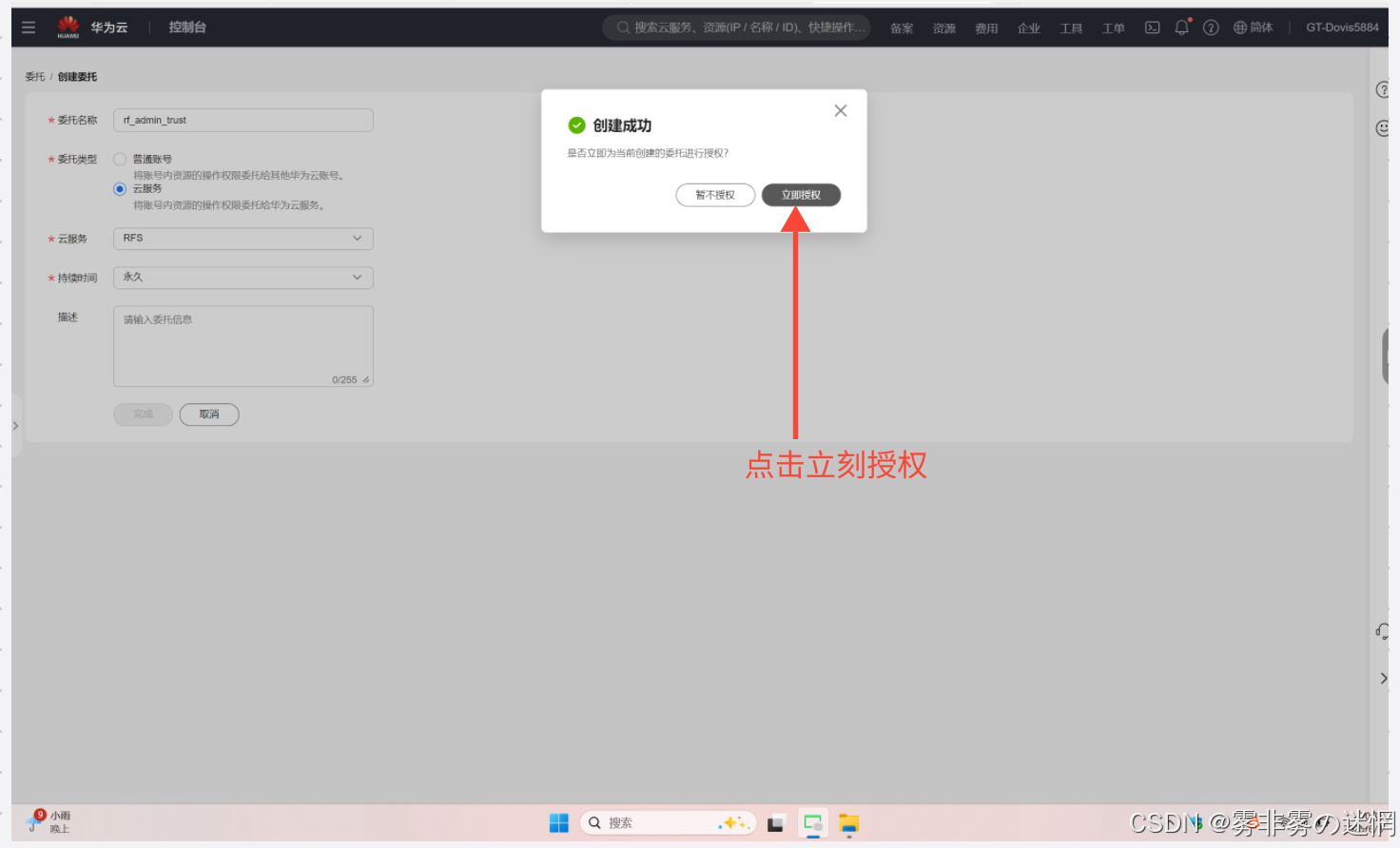

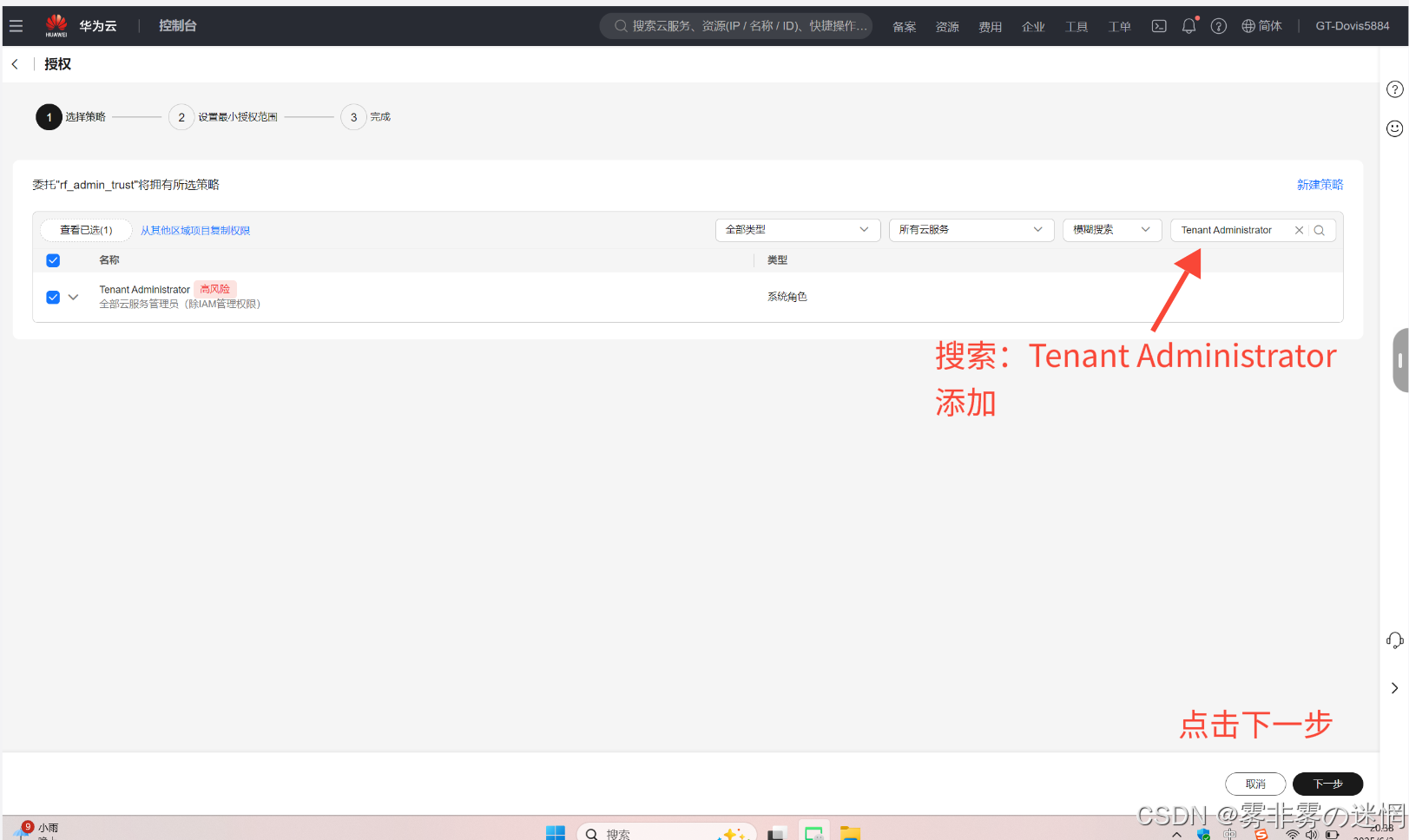

(3)点击立刻授权,给委托配置权限

(4)点击搜索下面这个权限,勾选

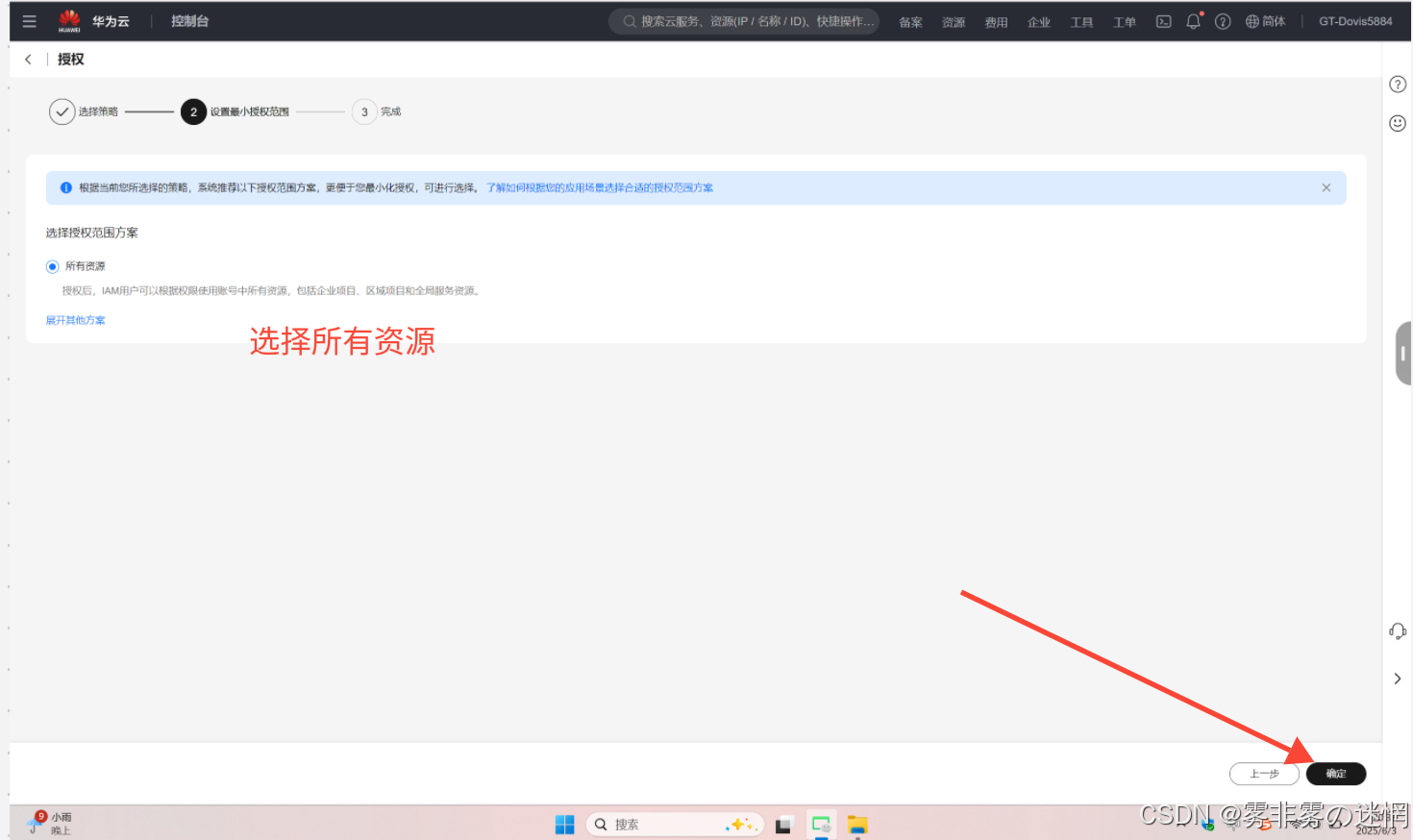

(5)选择所有资源

这样我们就完成了委托的配置,下面开始授权

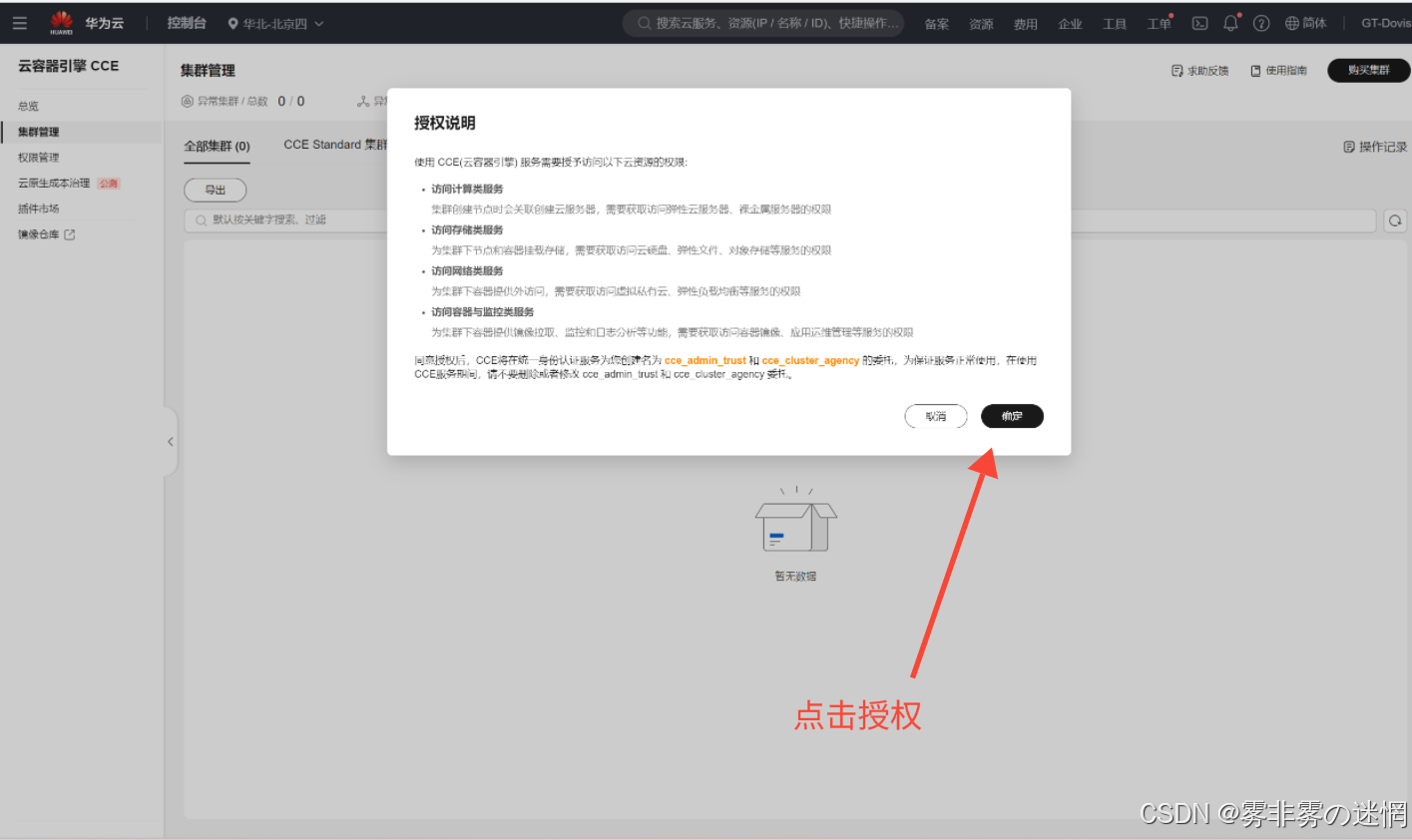

委托授权:

打开云容器引擎CCE,我们给委托授权

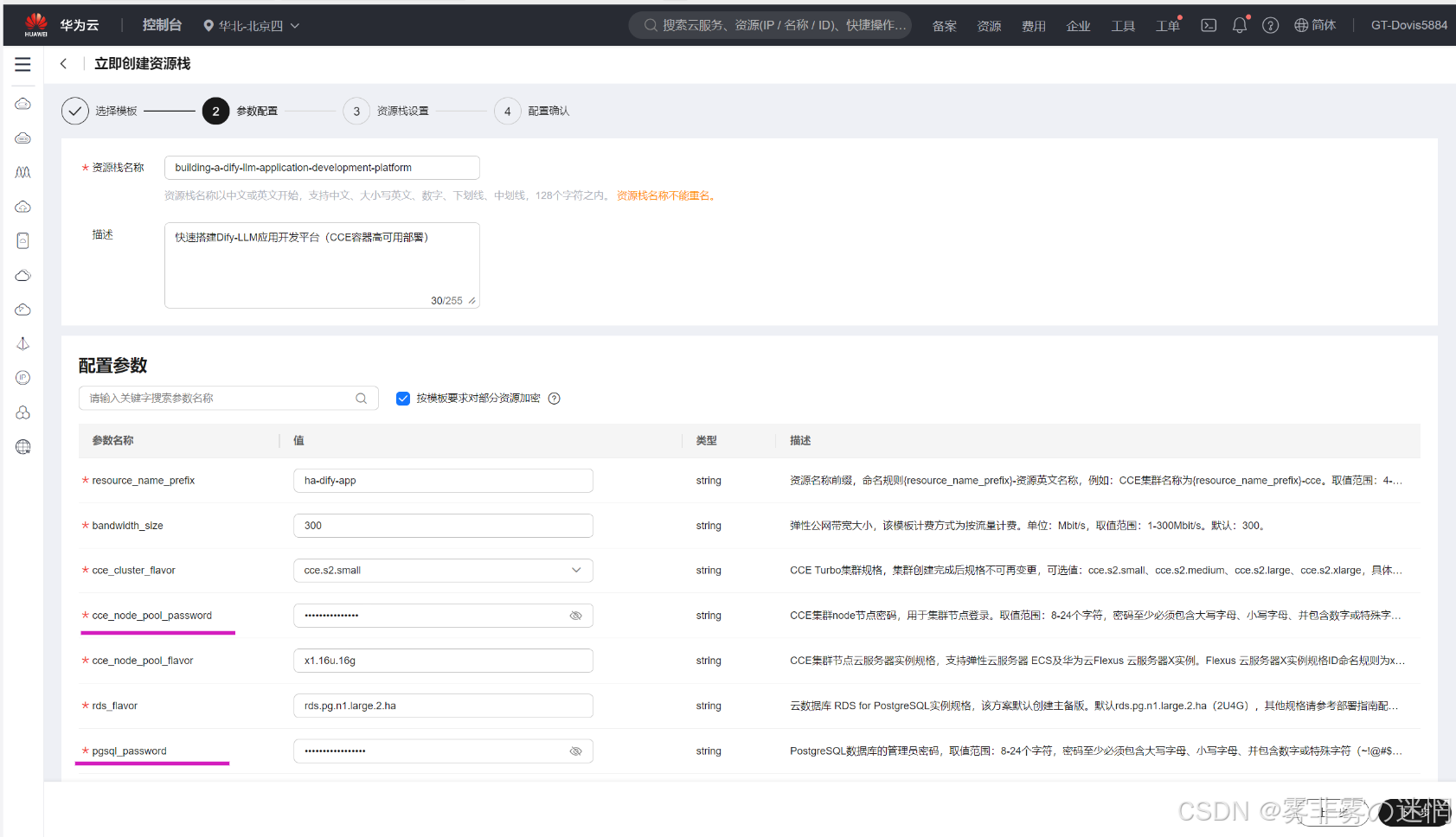

(2)零基础教程

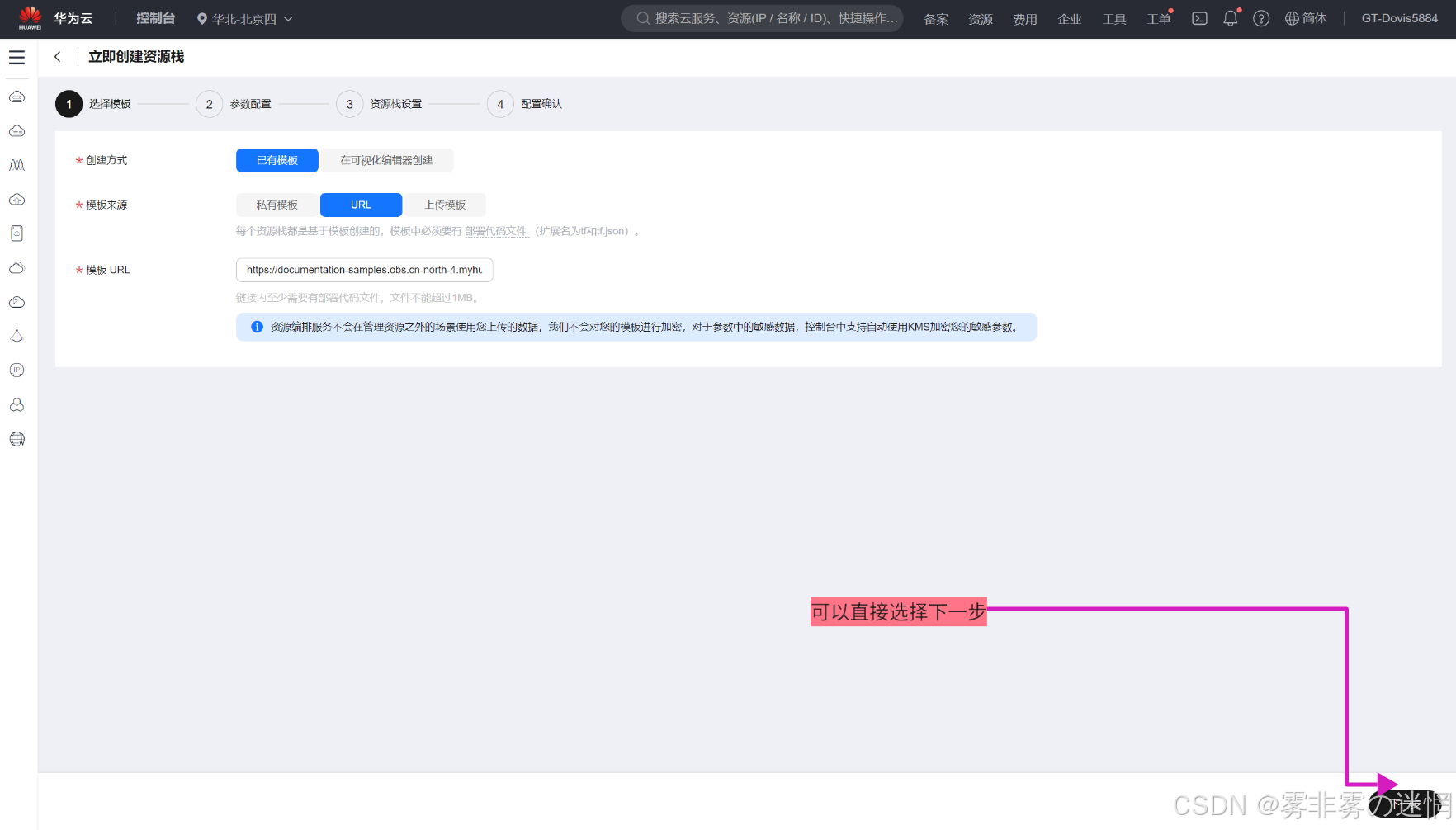

(1)点击CCE高可用部署

(2)还是可以选择默认模板不用管,直接下一步

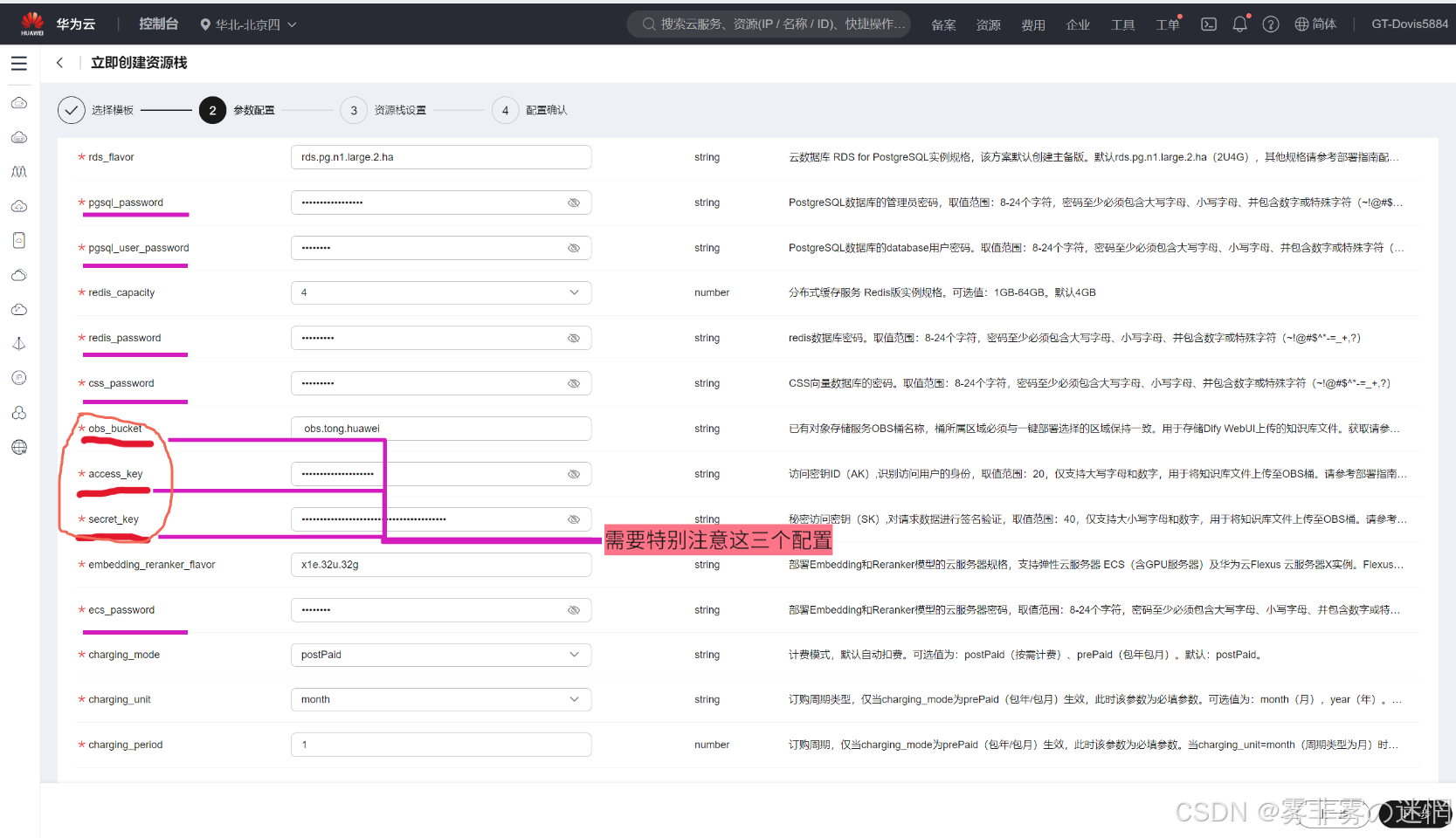

(3)这里所有的密码大家按照规定设置即可

下面的三个桶名称、秘钥、秘钥ID需要严格按教程获取!

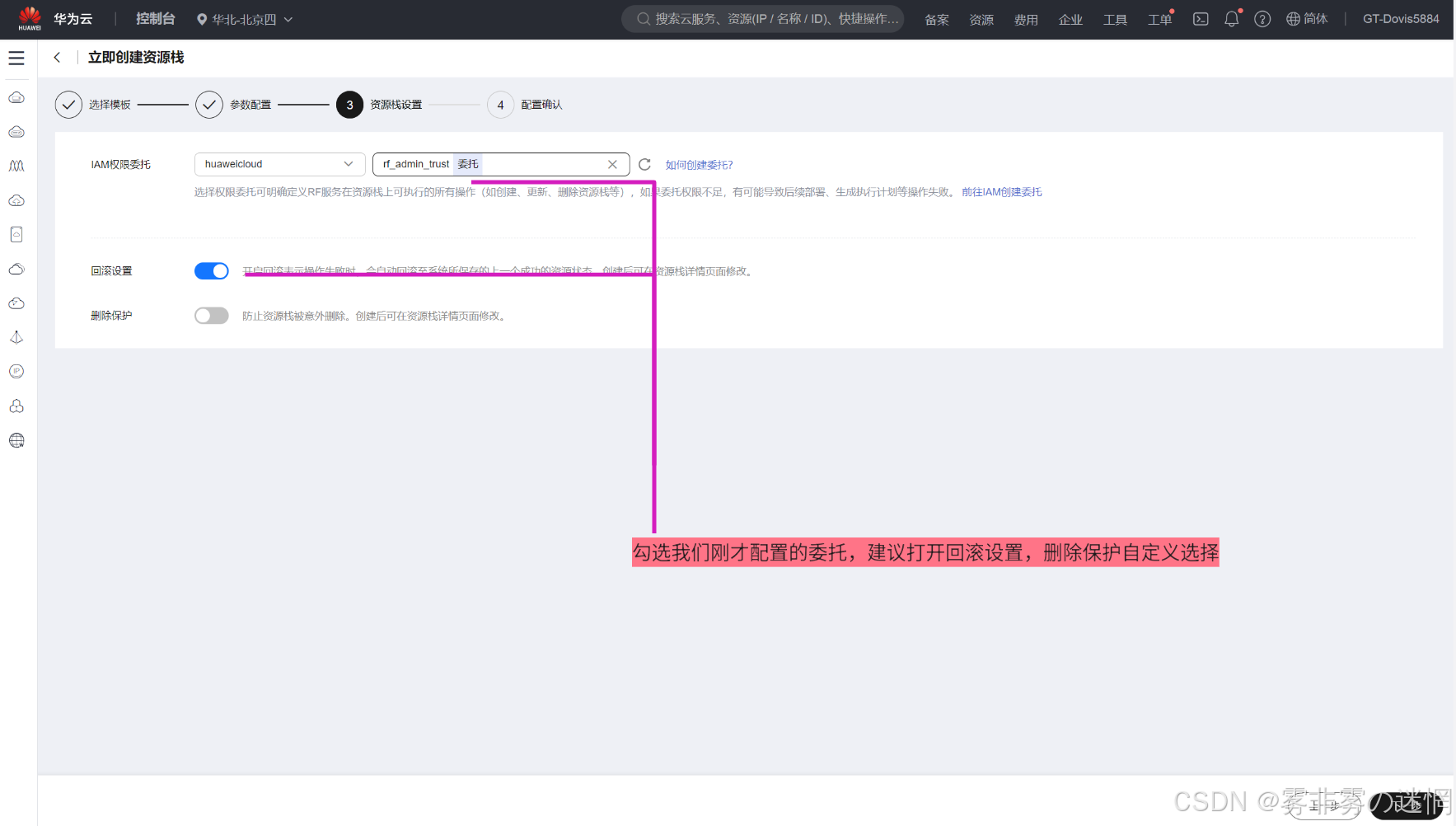

(4)这里一定要勾选我们刚才设置的rf_admin_trust委托,其它都可以自定义选择

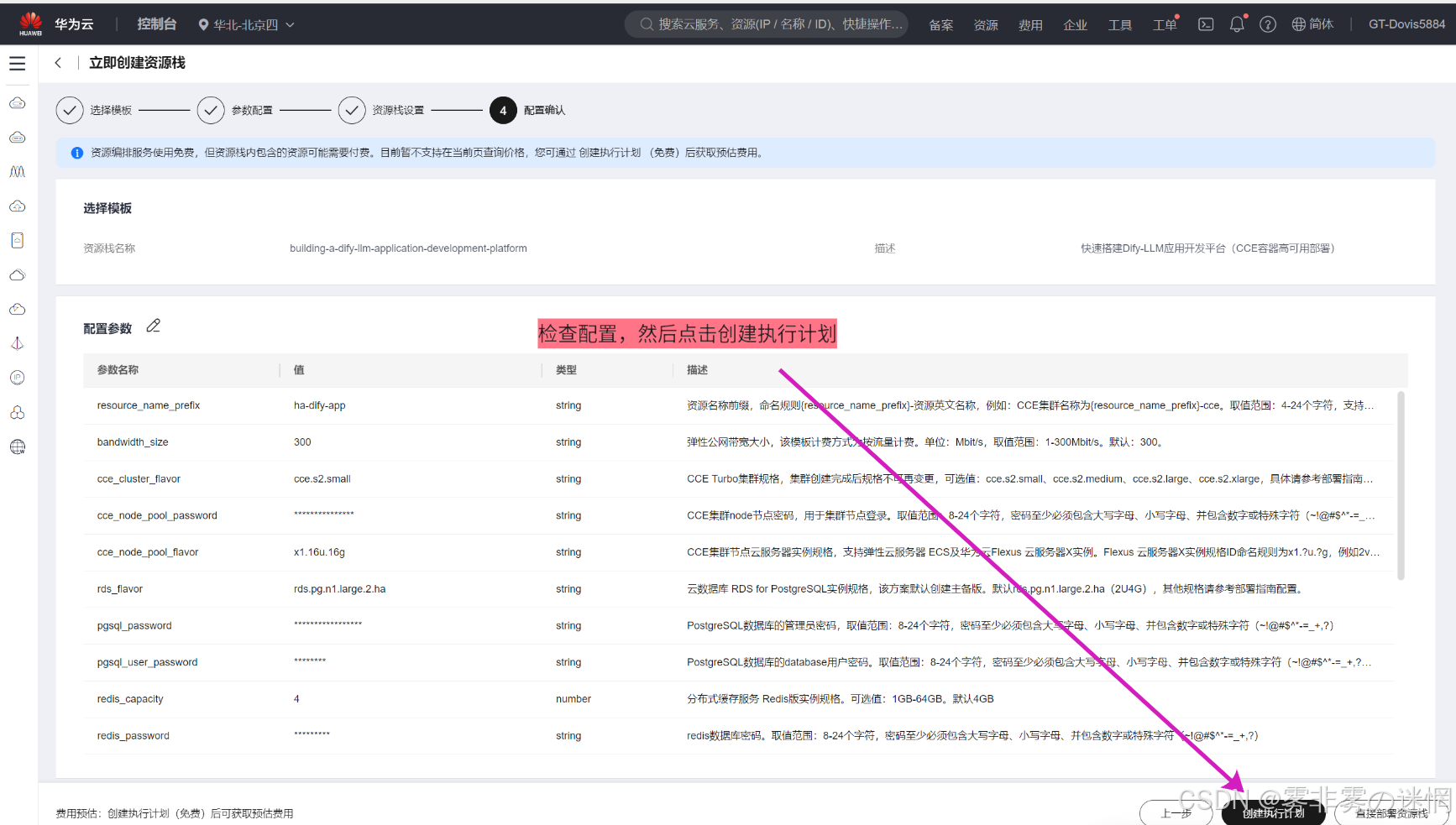

(5)确认配置之后,点击创建执行计划,创建执行计划

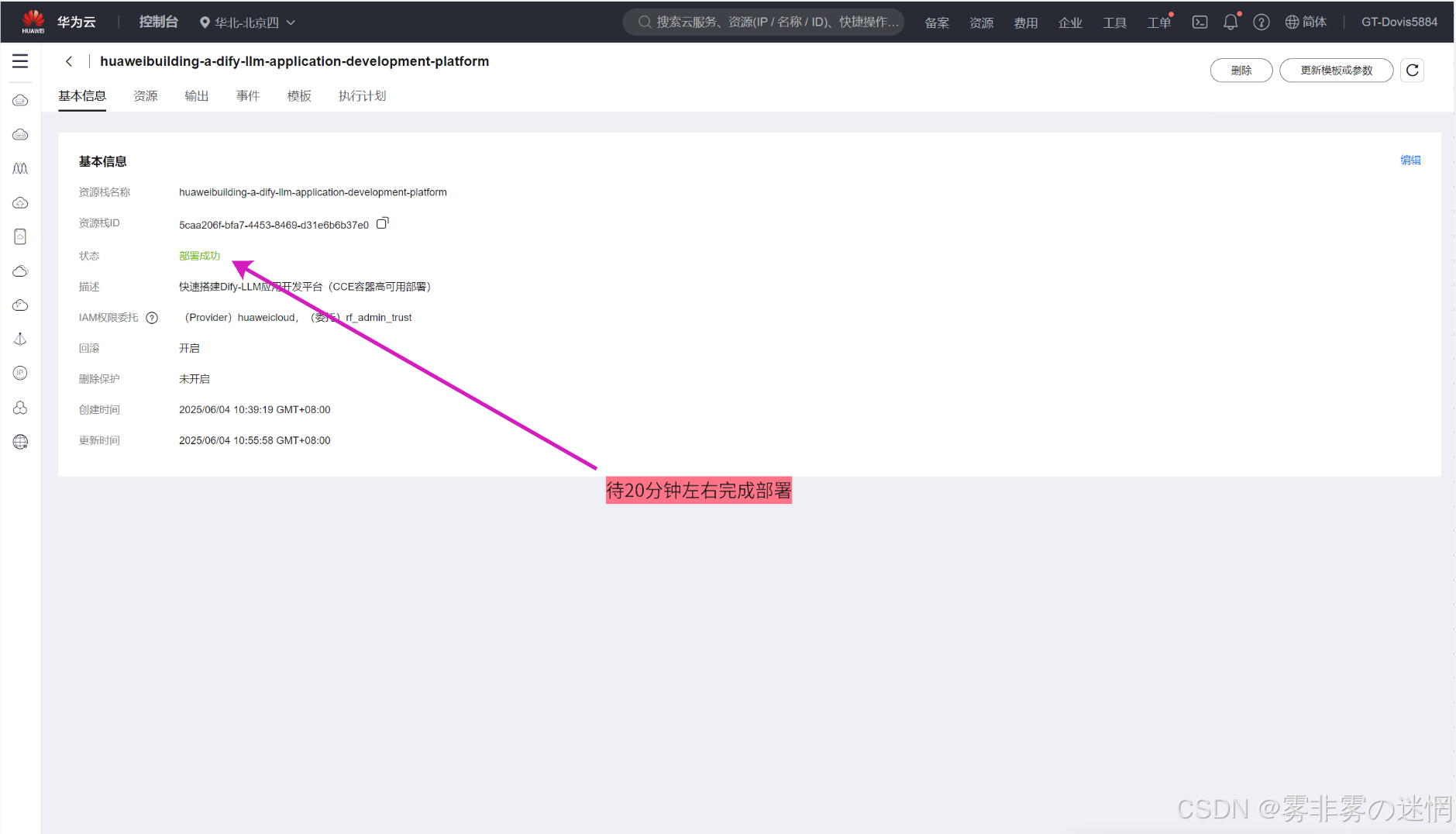

(6)待显示创建成功,点击开始部署,执行,大约20分钟可以获得DIfy的公网IP

(3)部署心得

华为云CCE(Cloud Container Engine)高可用部署基于Kubernetes架构,展现了其在企业级场景中的强大能力。我通过CCE完成了Dify平台的分布式部署,CCE利用负载均衡(ELB)、虚拟私有云(VPC)和多可用区部署,实现了高可用性和容错能力。在实际操作中,CCE的自动扩缩容功能让我印象深刻。例如:当模拟高并发访问时,系统自动增加容器实例,确保服务稳定运行!

CCE支持多副本部署和健康检查,显著降低了单点故障风险,适合高并发和关键业务场景,如智能客服或实时推荐系统。然而,CCE的配置和管理复杂度较高,需要一定的容器化技术背景,且成本相对单机部署更高~

体验亮点:

高可用性:多可用区和多副本部署,保障服务连续性

弹性伸缩:自动根据负载调整容器实例,应对流量波动

自动化运维:支持CI/CD管道和健康检查,减少人工干预

六、两种部署方式的性能对比

架构与技术基础:

单机部署:指在单一物理或虚拟服务器上运行应用程序,通常不依赖容器化或集群管理技术。部署方式较为简单,适用于小型应用或测试环境

CCE高可用部署:基于华为云云容器引擎(CCE),使用Kubernetes等容器编排技术,在多节点集群上运行容器化应用,支持自动扩展、负载均衡和故障恢复。CCE是企业级容器管理服务,强调高可靠性和高性能

扩展性:

单机部署:扩展性有限,需手动增加服务器或调整配置,难以应对流量激增或大规模并发

CCE高可用部署:支持自动水平扩展(HPA),可根据负载动态调整容器实例数量,适合高并发和动态负载场景

可靠性与容错:

单机部署:单点故障风险高,若服务器宕机,服务将中断,缺乏自动恢复机制

CCE高可用部署:通过多副本、跨可用区部署和自动故障转移,确保服务高可用。即使某节点故障,CCE可快速调度容器到其他节点,减少服务中断

管理复杂度:

单机部署:配置和维护简单,适合小型项目或不熟悉容器技术的团队,但后期维护成本可能随规模增加而上升

CCE高可用部署:管理复杂,需熟悉Kubernetes和容器技术,但CCE提供自动化工具(如自动升级、监控和日志管理),降低运维负担

部署速度与灵活性:

单机部署:部署快速,适合快速上线小型应用,但不适合复杂微服务架构

CCE高可用部署:支持快速部署微服务应用,适合复杂分布式系统,灵活性更高,尤其在DevOps场景下

维度 云服务器单机部署 CCE高可用部署 部署复杂度 简单,界面化操作,适合初学者或快速验证场景 较复杂,需熟悉Kubernetes及容器化技术,适合专业团队 可扩展性 扩展能力有限,需手动升级服务器配置,适合小规模应用 高可扩展性,支持动态扩缩容,适合大规模分布式系统 可靠性 依赖单机,单点故障风险较高,需手动配置备份机制 高可用性,多副本和多可用区部署,自动故障转移,服务稳定性强 成本 成本较低,按需计费,适合预算有限的场景 成本较高,涉及多节点、负载均衡等资源,适合高性能需求场景 管理与运维 需手动管理服务器,运维工作量较大 自动化运维(自动扩缩容、健康检查),减少人工干预,提升效率 适用场景 小型应用、测试环境、简单Web服务或原型开发 企业级应用、高并发服务、分布式AI应用(如DeepSeek推理服务)

七、Linux捕获服务器实时性能

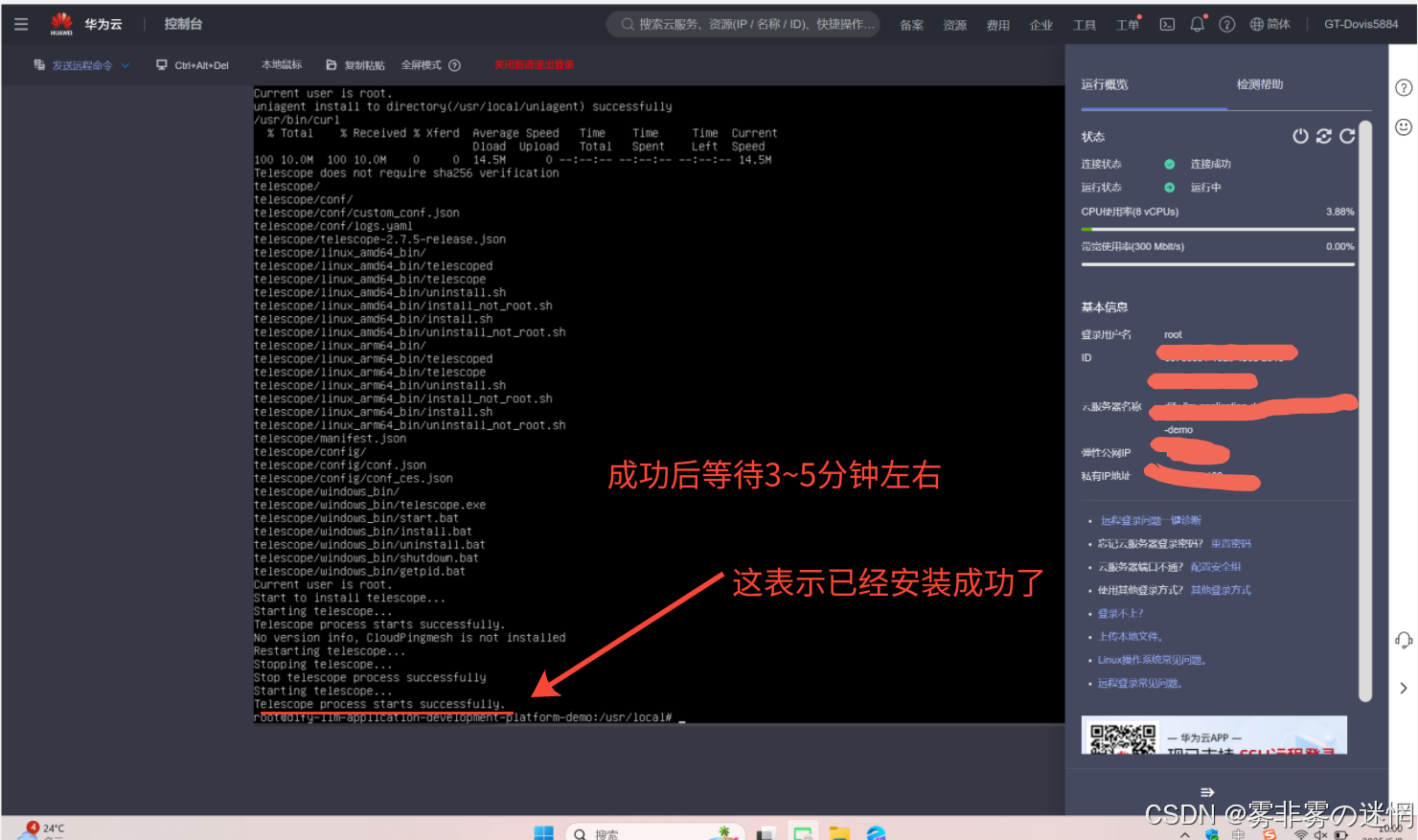

(1)安装插件

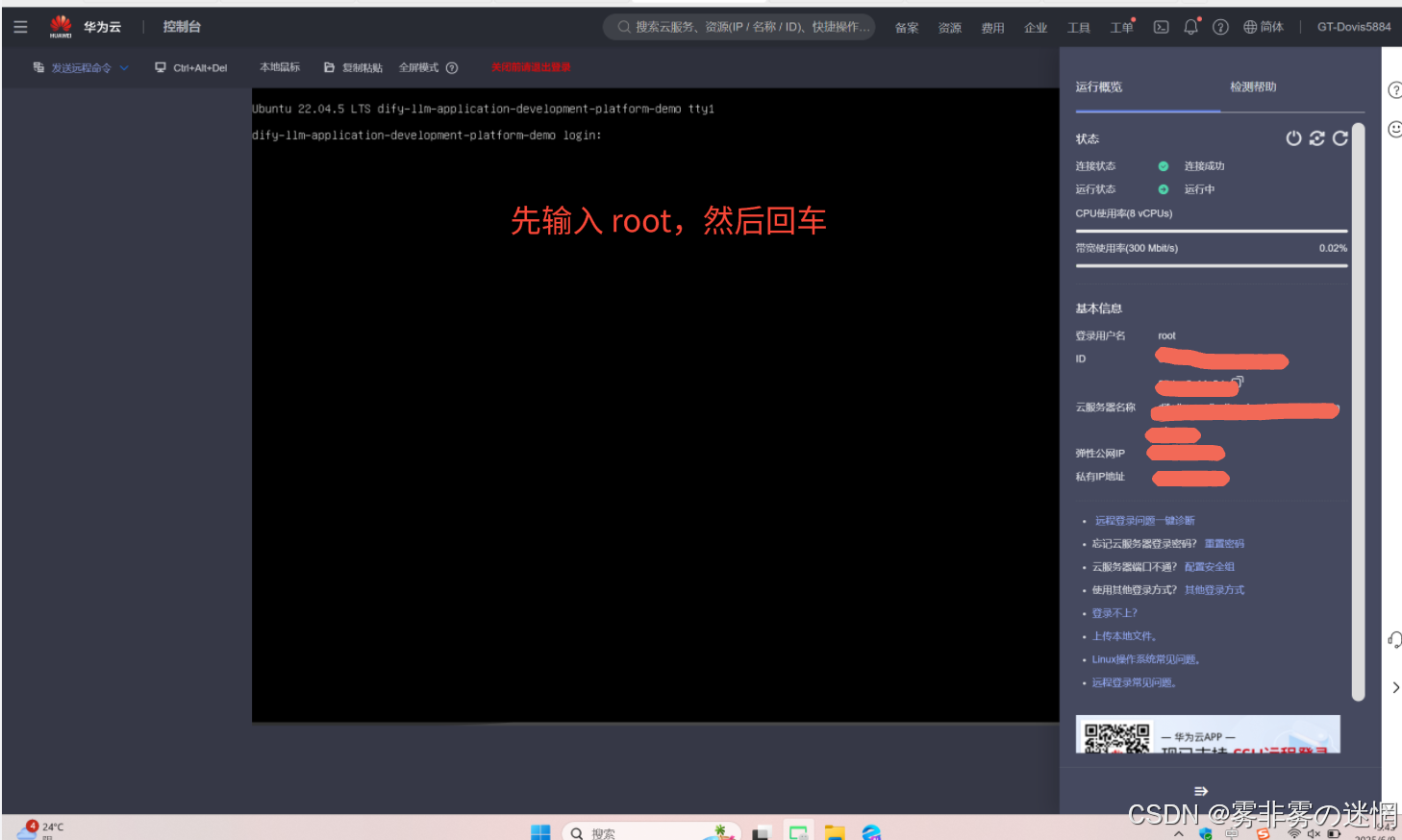

我们这里使用的是Linux安装方法,为了获取全面的性能监测

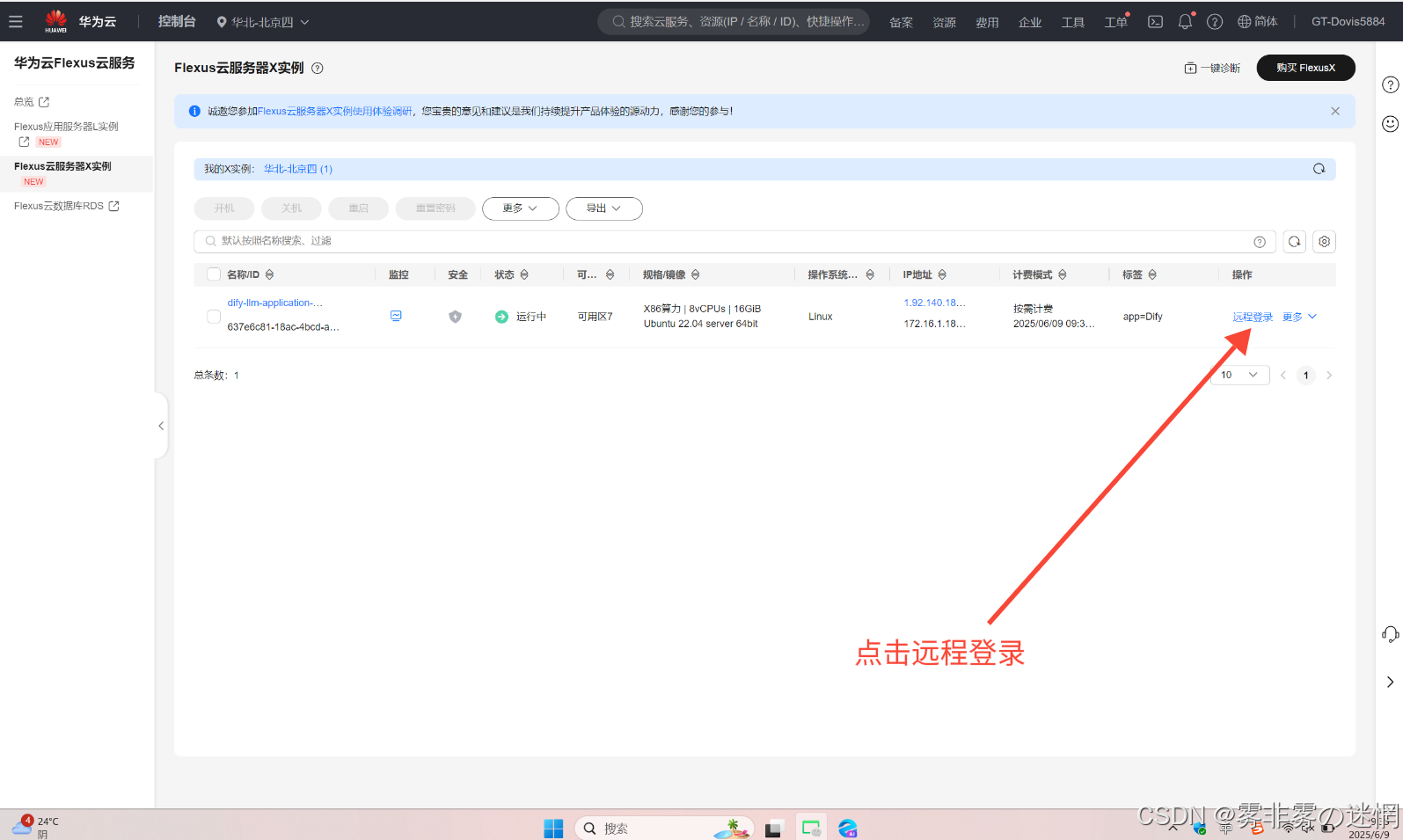

(1)直接搜“Flexus X实例”点击远程登录

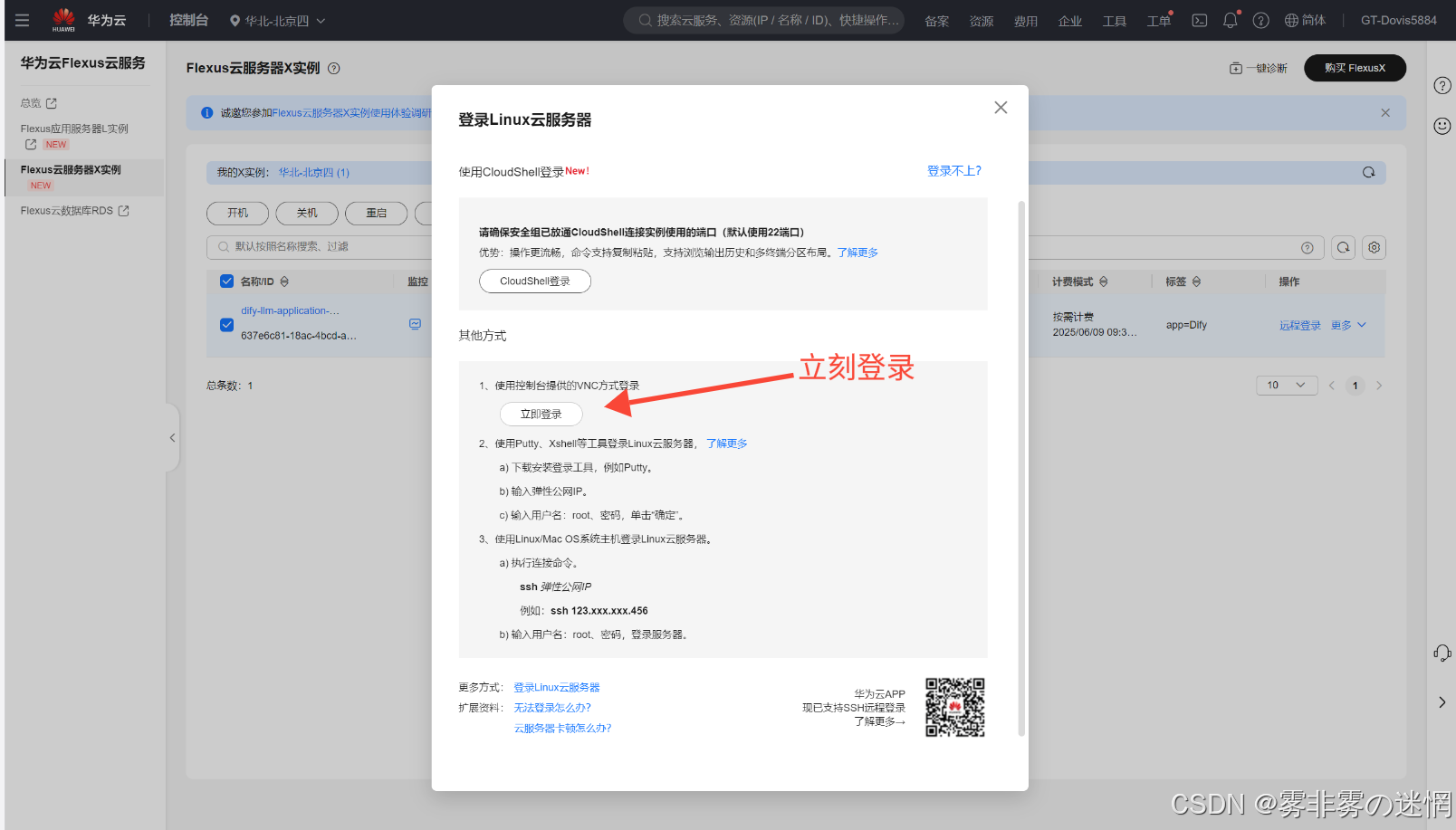

(2)点击立刻登录

(3)先输入root,然后回车,再输入部署设置的密码(注意:密码的输入不会显示)再回车

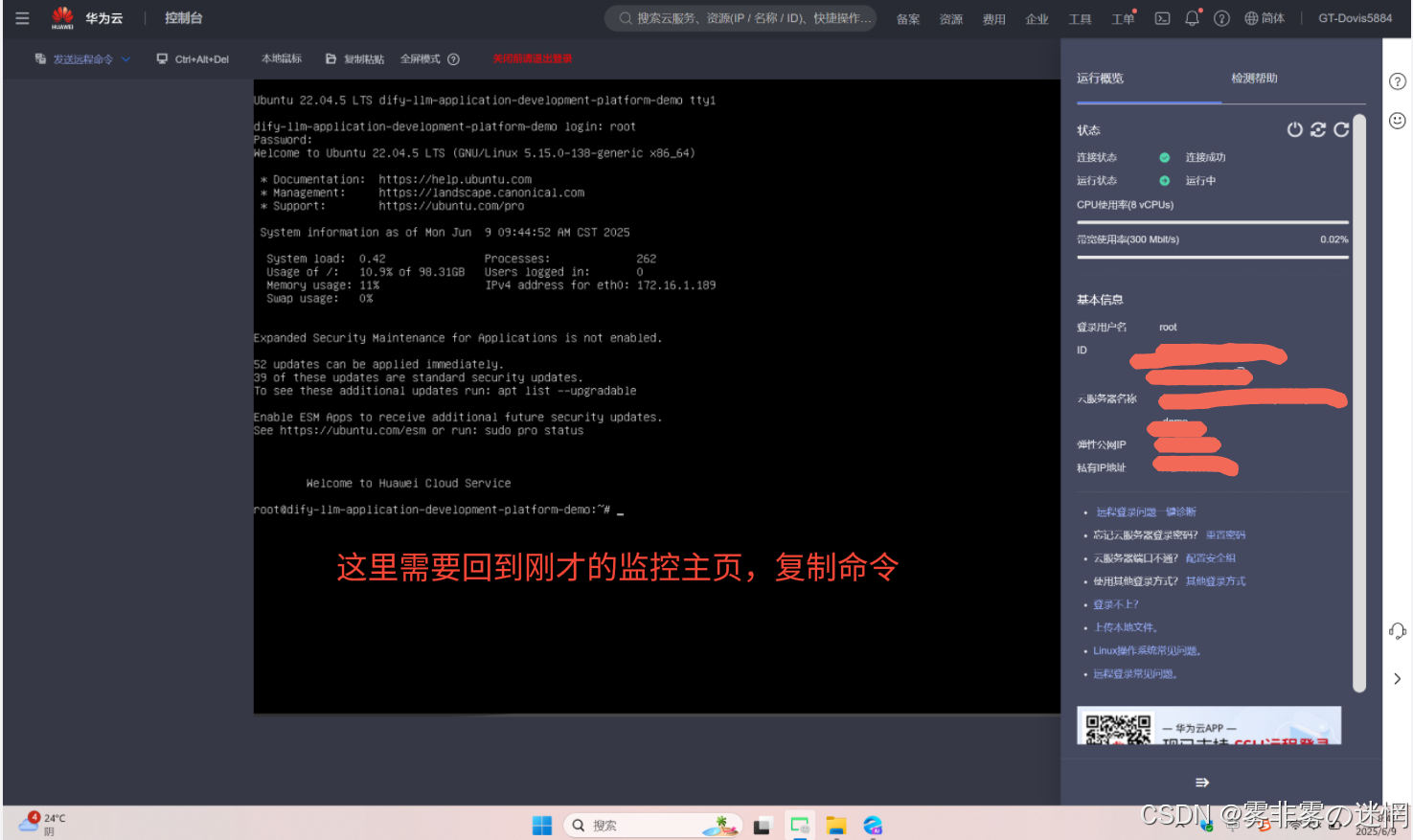

(4)这样的界面下,我们需要回到云监控服务复制 Linux 的执行命名

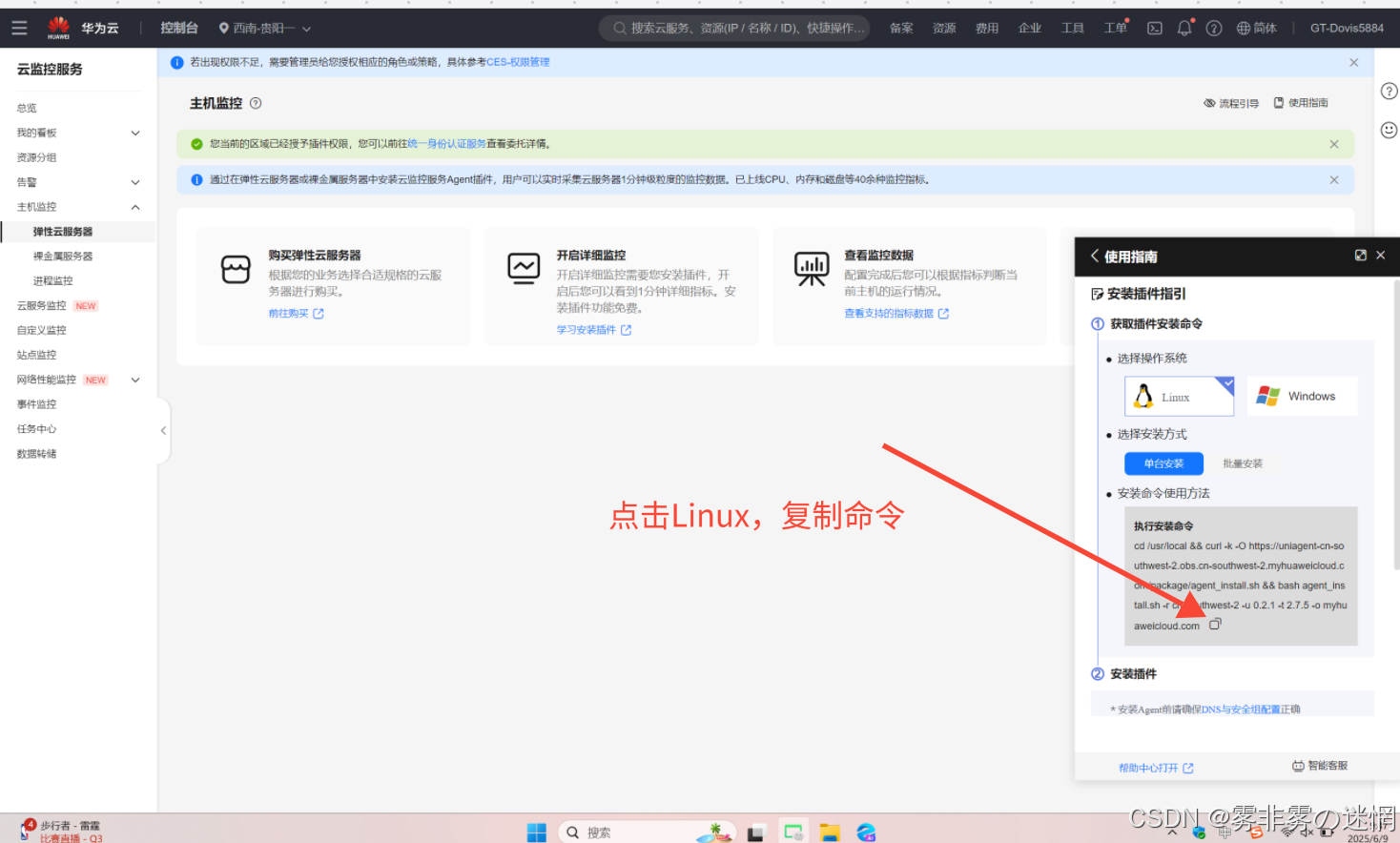

(5)点击弹性云云服务器,点击“开始详细监控”,点击 Linux,复制下面的执行命名

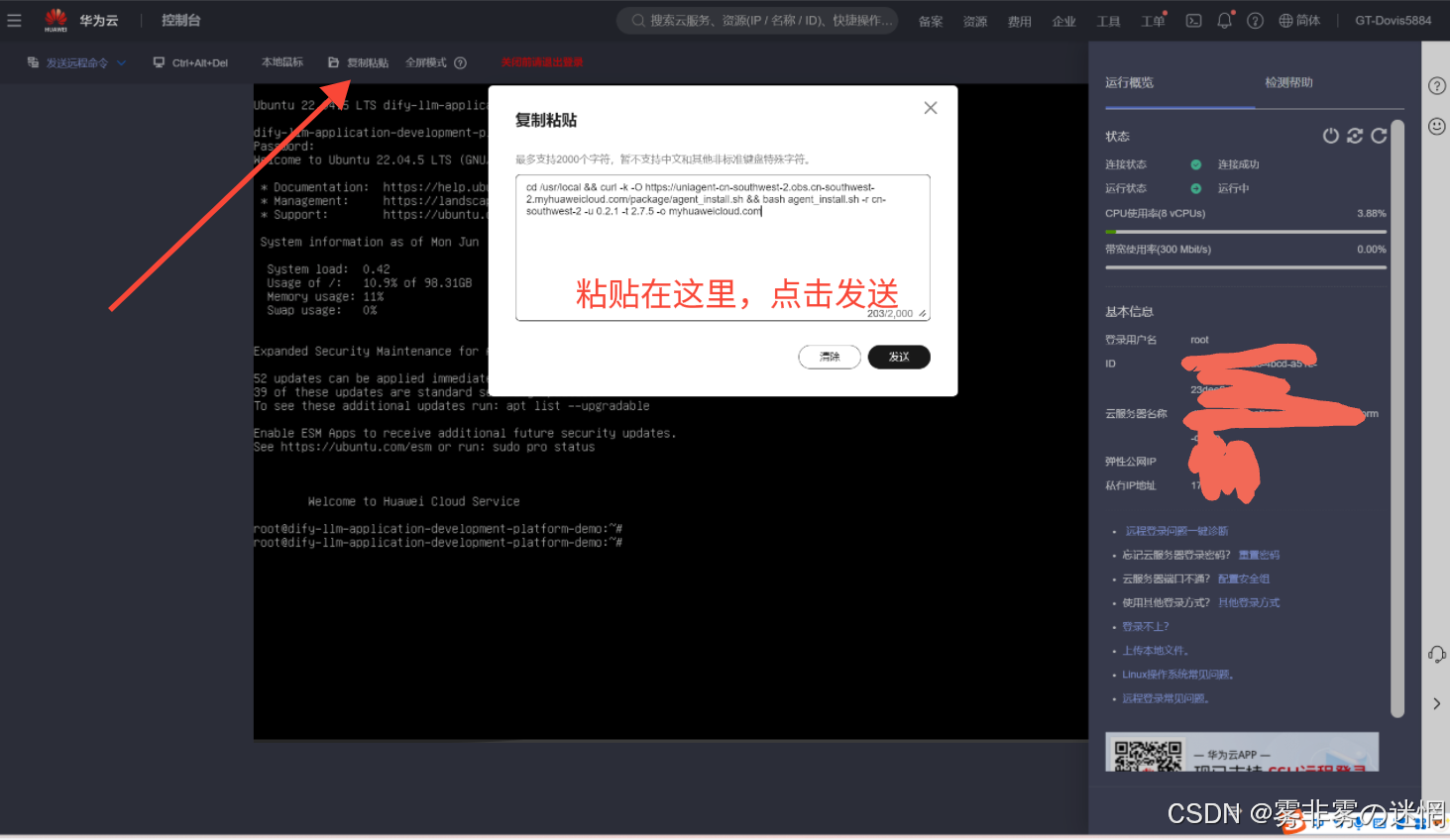

(6)然后回到登录界面,点击左上角的复制粘贴,粘贴命名然后发送

(9)这样就表示成功了

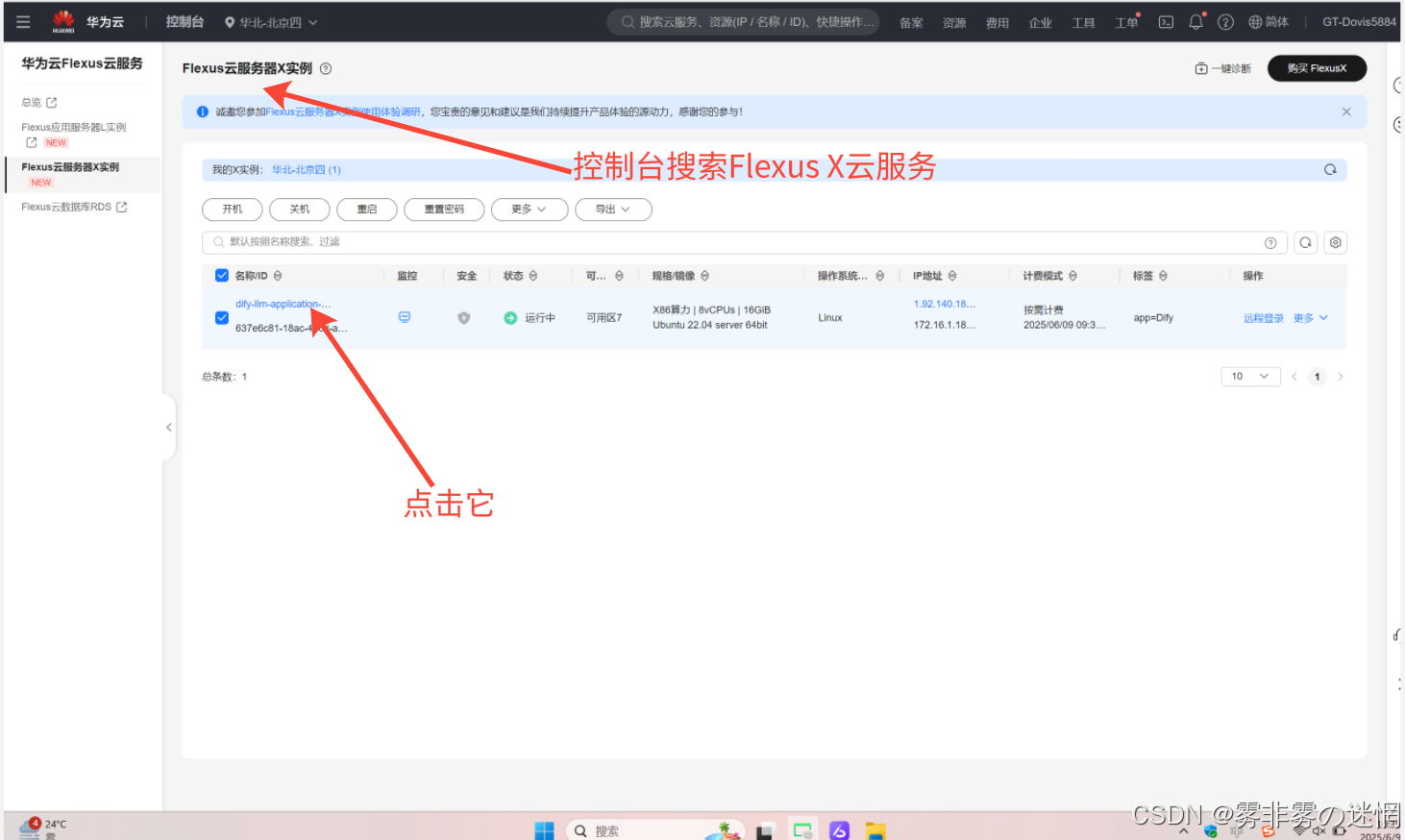

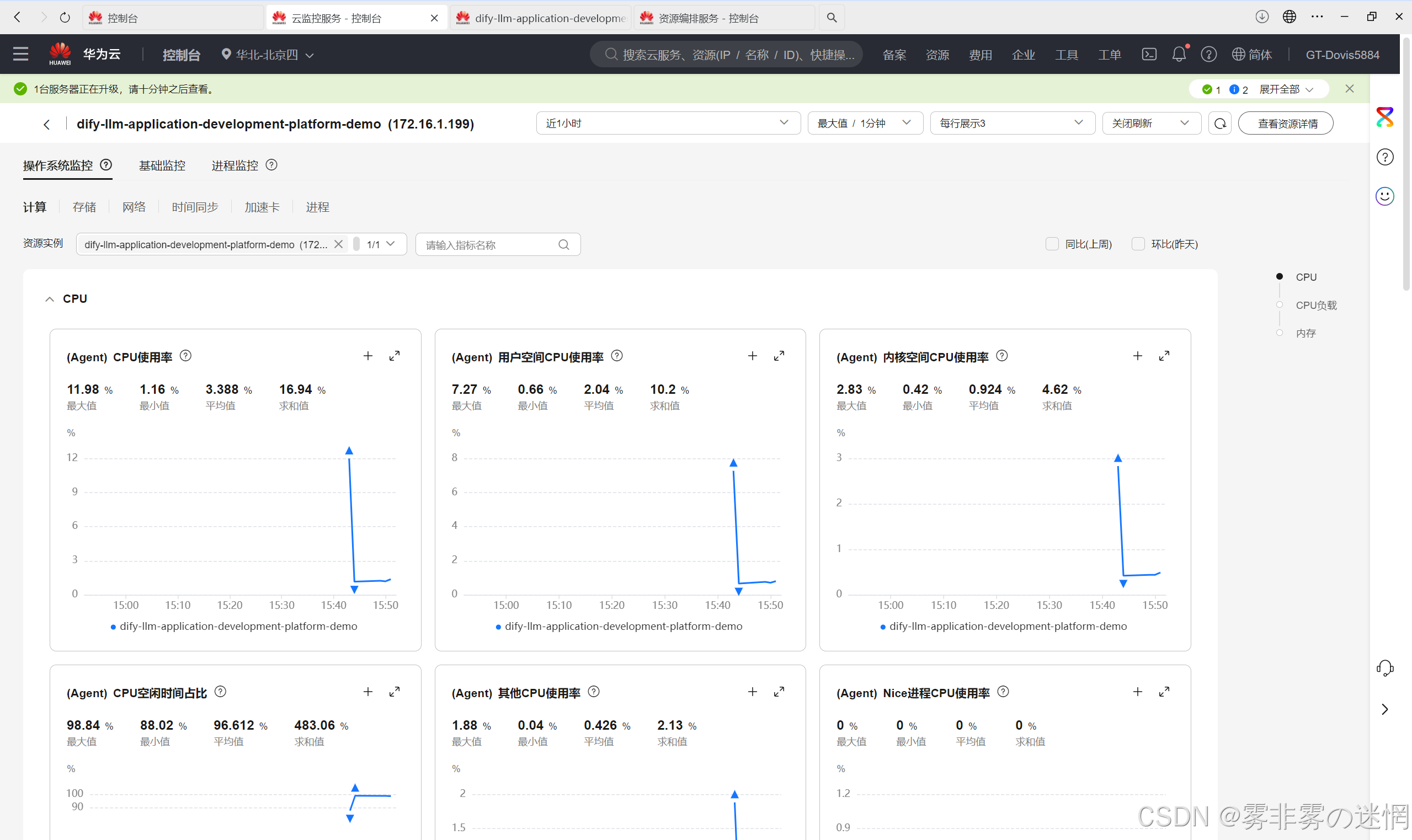

(2)监控实时性能

(1)搜索“Flexus云服务”,点击Flexus X实例,点击这个已经部署的实例

(3)点击“监控”,切换为“操作系统监控”,这样就可以查看部署的服务器实时性能参数

八、针对本次活动Dify应用的建议

Dify 是一个开源的大语言模型(LLM)应用开发平台,融合了后端即服务(Backend as Service)和 LLMOps 理念,旨在帮助开发者快速构建和运营生成式 AI 应用。结合华为云的强大基础设施,以下是针对华为云征文活动的 Dify 应用建议:

建议:利用 Dify 的工作流编排功能,结合华为云 CCE(云容器引擎),开发自动化运营工具。例如,构建一个自动生成社交媒体内容(如小红书帖子)的工作流,集成华为云 FunctionGraph 实现事件触发!

建议:将 Dify 应用接入微信生态(如微信公众号或小程序),打造智能交互助手,增强用户体验

建议:利用 Dify 支持的多种 LLM(如 OpenAI GPT、Anthropic Claude 或开源模型),结合华为云 ModelArts,灵活选择适合业务场景的模型

九、全程实操感受

(1)部署

在华为云上部署 Dify 的过程非常直观,尤其是通过 CCE 提供的 Kubernetes 集群,配合 Dify 官方的 Docker Compose 部署指南,部署时间大幅缩短。单机部署(ECS)适合快速验证,CCE 高可用部署则展现了企业级可靠性!

(2)功能体验

Dify 的工作流编排功能让人印象深刻。例如,在构建自动化内容生成工作流时,通过拖拽式界面即可完成复杂逻辑(如从知识库检索到内容生成),无需深入编程。结合华为云 FunctionGraph,触发式任务(如定时生成报告)非常高效

(3)集成体验

Dify 与华为云的 OBS、ModelArts 和 CCE 等服务集成顺畅。例如,将企业文档存储在 OBS 作为知识库,结合 Dify 的 RAG 功能,构建的智能问答助手响应精准且快速

(4)性能与稳定性

在华为云 CCE 上部署 Dify 后,应用的稳定性和响应速度令人满意。测试中,即使在高并发场景下(如模拟 1000 次同时问答请求),CCE 的自动扩展功能确保了服务不中断