【源力觉醒 创作者计划】ERNIE-4.5-VL-28B-A3B 模型详解:部署、测试与 Qwen3 深度对比测评

【源力觉醒 创作者计划】ERNIE-4.5-VL-28B-A3B 模型详解:部署、测试与 Qwen3 深度对比测评

文章目录

- 【源力觉醒 创作者计划】ERNIE-4.5-VL-28B-A3B 模型详解:部署、测试与 Qwen3 深度对比测评

-

- 前言

- ERNIE-4.5-VL-28B-A3B 模型介绍

- ERNIE-4.5-VL-28B-A3B 部署

- FastDeploy 快速部署服务

- 模型测试使用

- 文心4.5 VS Qwen3 测评

-

- 语言理解

- 逻辑推理

- 知识问答

- 代码能力

- 应用场景

- 总结

前言

在人工智能与多模态技术迅猛发展的当下,大模型的研究与应用已成为科技领域的核心焦点。文心 4.5 系列于 2025 年 6 月 30 日开源,含 10 款模型,ERNIE-4.5-VL-28B-A3B 是其中多模态 MoE 大模型,总参数量 28B,激活参数量 3B,在跨模态等地方表现佳,可通过飞浆平台部署。后将其与 Qwen3-235B-A22B 模型从多维度测评对比,分析两者在生成速度、语言风格等方面的差异与适用场景,为模型了解与应用提供参考。

一起来轻松玩转文心大模型吧👉文心大模型免费下载体验地址:https://ai.gitcode.com/theme/1939325484087291906

ERNIE-4.5-VL-28B-A3B 模型介绍

文心 4.5 系列模型于 2025 年 6 月 30 日正式开源。该系列共 10 款模型,涵盖激活参数规模为 47B 和 3B 的混合专家(MoE)模型,以及 0.3B 的稠密参数模型,总参数量最大可达 424B。模型及项目已完全开源至 Hugging Face、GitHub 和飞桨星河社区,权重遵循 Apache 2.0 协议,支持学术研究和产业应用。

ERNIE-4.5-VL-28B-A3B 便是文心 4.5 系列中的多模态 MoE 大模型。其总参数量为 28B,每个 Token 激活参数量为 3B。该模型基于 MoE 的 A47B 和 A3B 系列,凭借多模态异构 MoE 预训练、规模效率化基础设施及模态特定后训练三大技术创新,在跨模态理解与生成、长文本处理等地方表现卓越,适用于智能导览、视觉客服等多种场景。

ERNIE-4.5-VL-28B-A3B 部署

通过飞浆平台快速部署

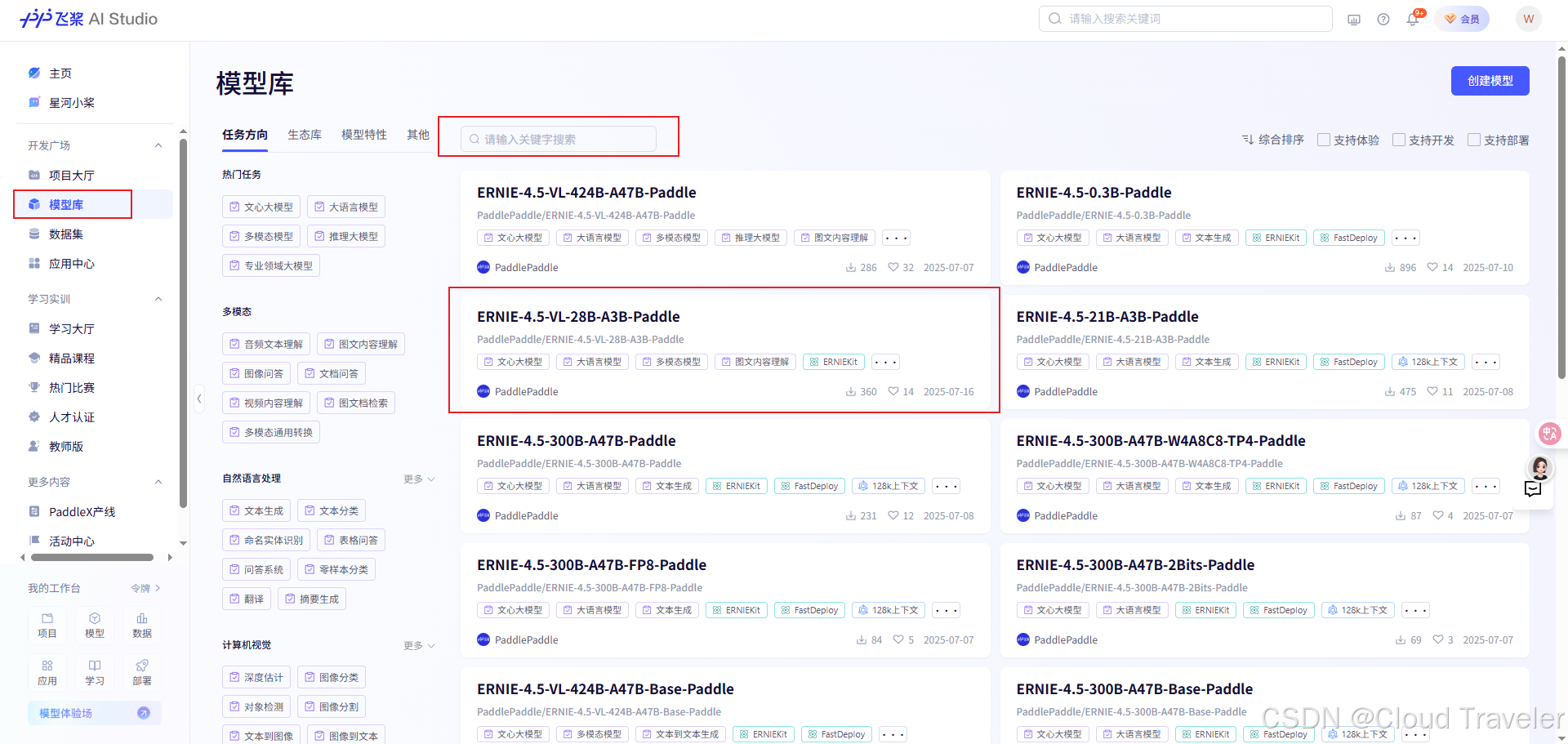

ERNIE-4.5-VL-28B-A3B模型,点击左侧导航栏,点击模型库可以针对所需模型进行指定搜索,也可以直接点击模型进行部署,此处选择ERNIE-4.5-VL-28B-A3B-Paddle,点击进入部署页面

跳转模型详细页面之后,点击右上角快速开发按钮,之后点击使用模型创建新项目

进入代码执行页面之后,将自动生成的所有代码块进行删除

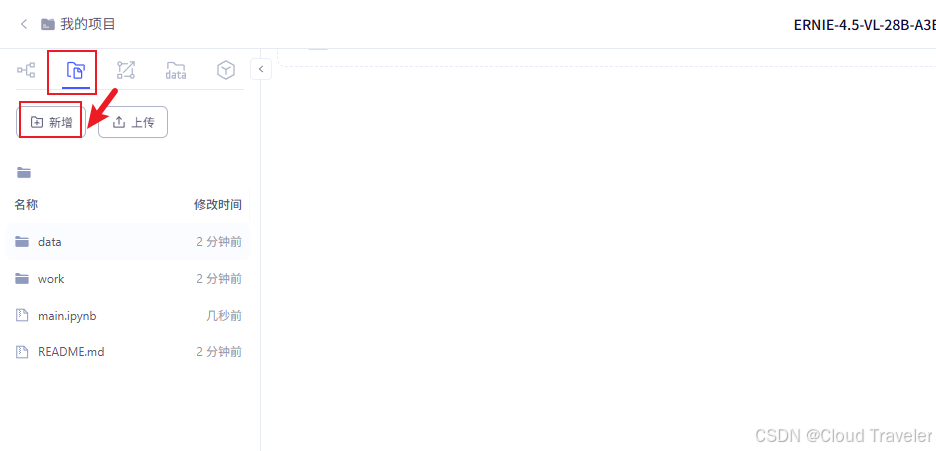

点击左侧项目,创建一个新的文件夹,并命名为

baidu

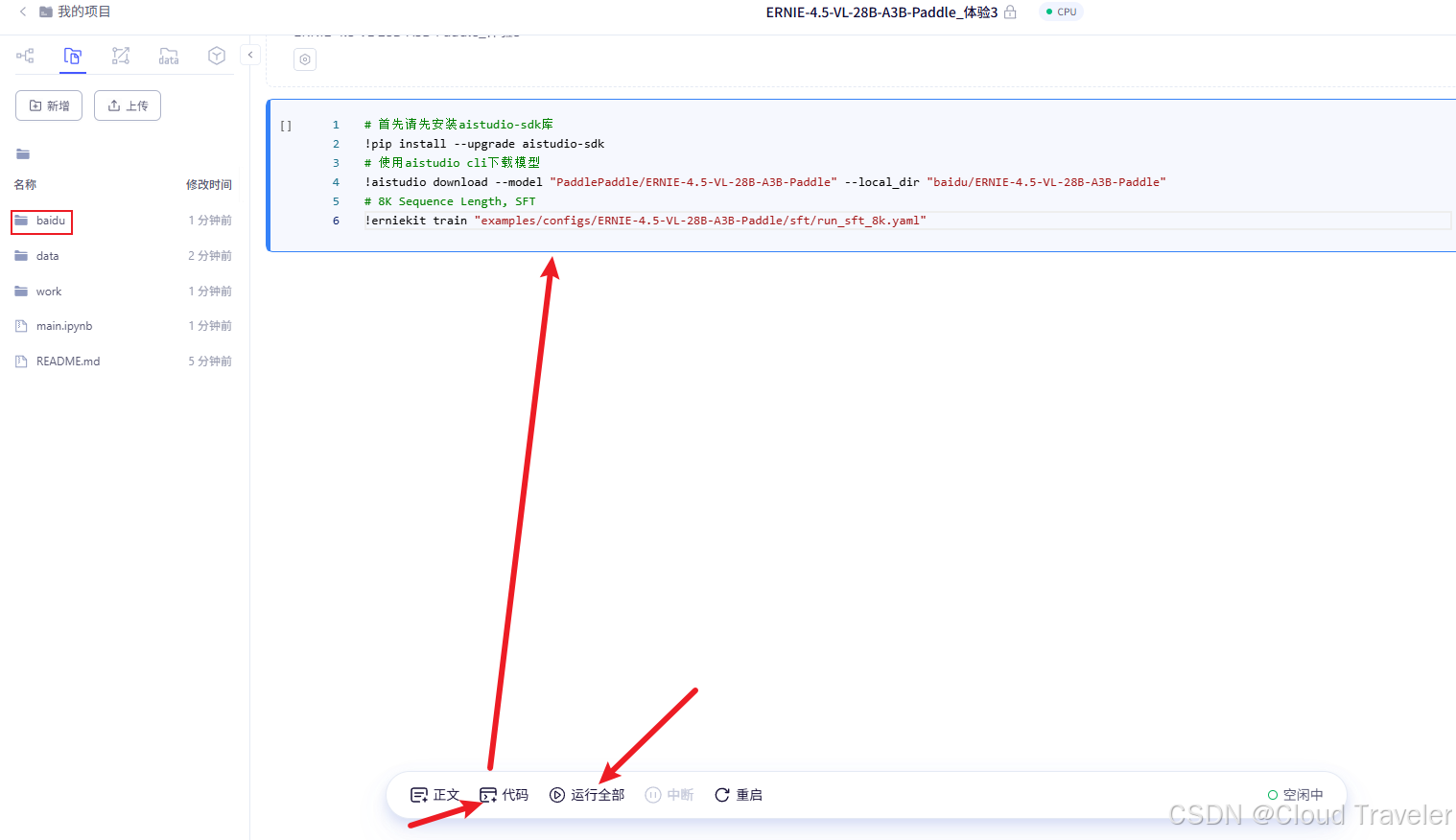

点击添加代码按钮,并通过

ERNIEKit使用模型,添加完成之后点击运行全部,等待模型下载# 首先请先安装aistudio-sdk库!pip install --upgrade aistudio-sdk# 使用aistudio cli下载模型!aistudio download --model \"PaddlePaddle/ERNIE-4.5-VL-28B-A3B-Paddle\" --local_dir \"baidu/ERNIE-4.5-VL-28B-A3B-Paddle\"# 8K Sequence Length, SFT!erniekit train \"examples/configs/ERNIE-4.5-VL-28B-A3B-Paddle/sft/run_sft_8k.yaml\"

当安装完成之后,页面会提示代码运行总时长和安装结束的时间,此时点击之前创建的

baidu目录,可以看到里边多了一个文件夹,可以看到已经将模型相关文件成功加载

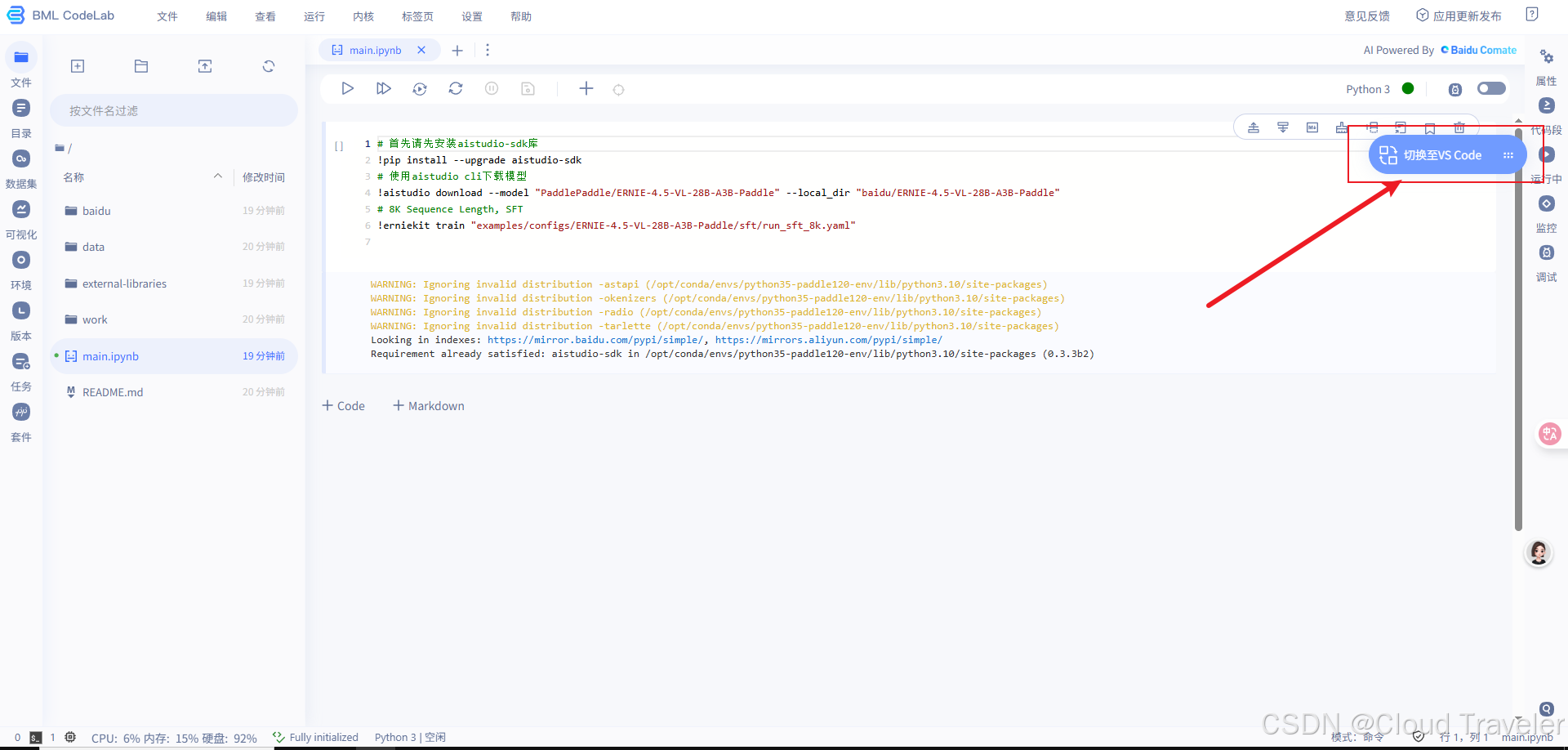

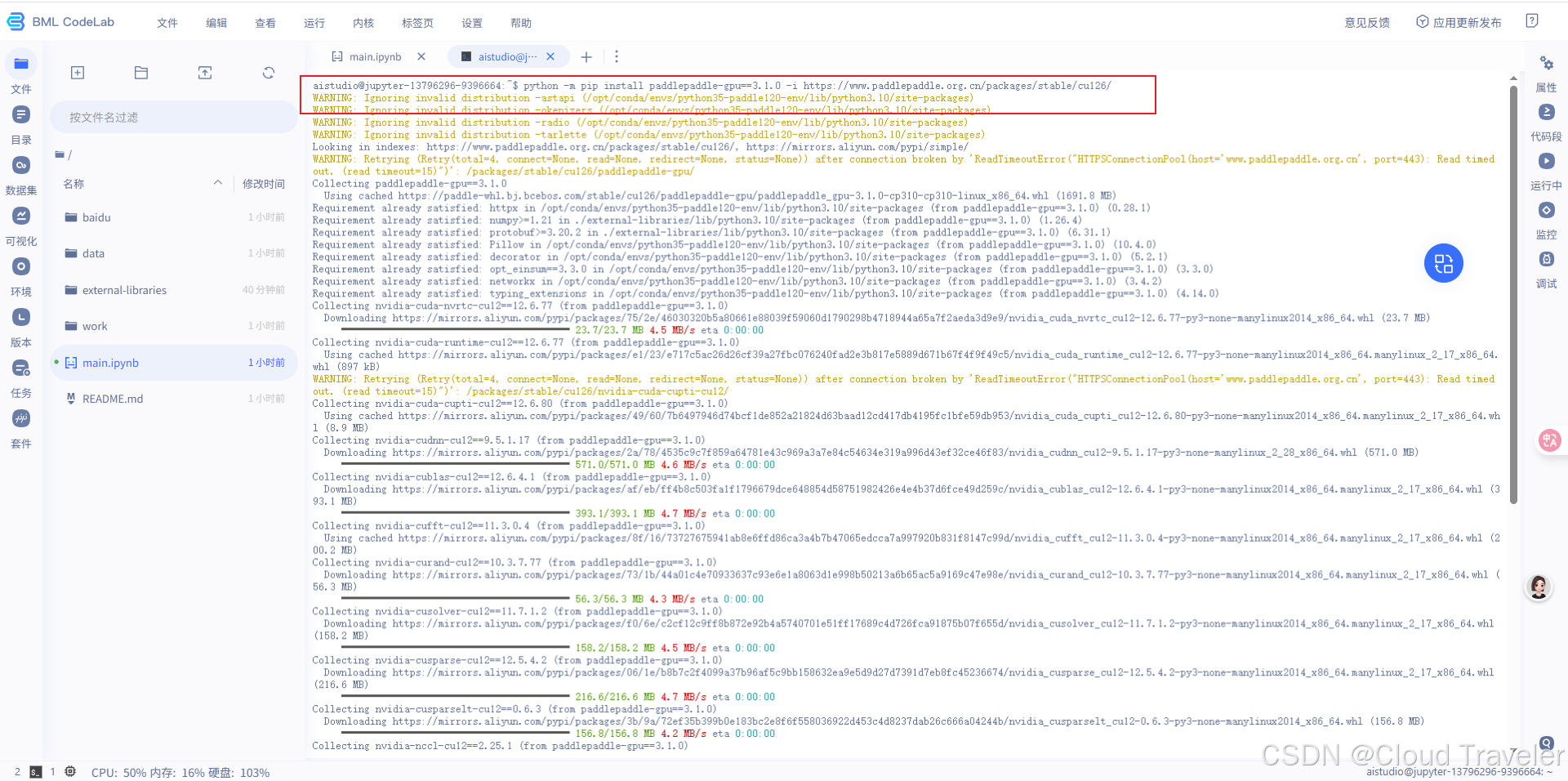

点击右上角的专业开发按钮,进入专业开发模式来继续进行安装对应版本的

paddlepaddle深度学习框架和fastdeploy部署工具

专业开发支持两种操作环境,分别为

VS Code和JupyterLab,点击页面蓝色按钮即可进行切换,选择自己熟悉的风格进行操作

以

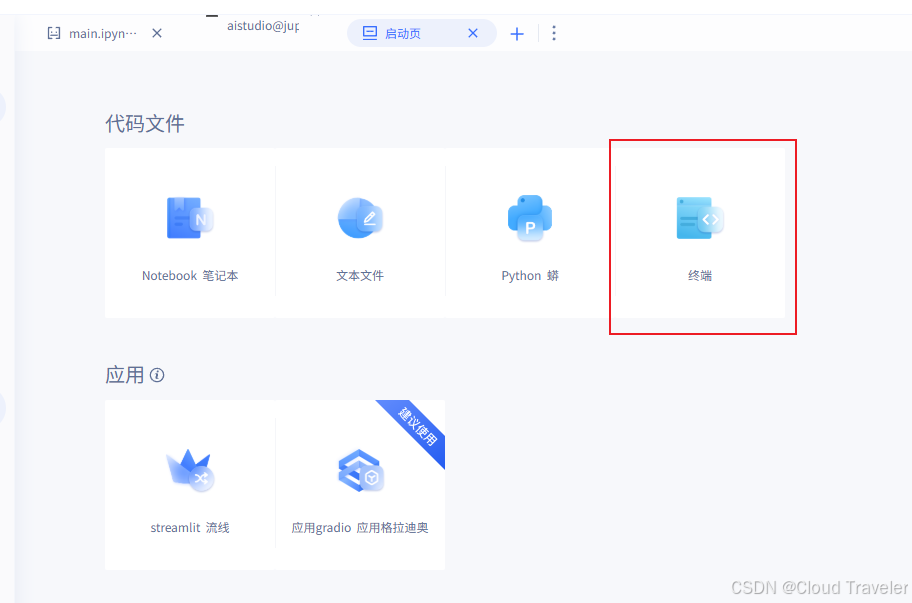

JupyterLab环境为例进行操作,点击上方小+号 ,在代码文件中选择终端选项,点击之后自动添加终端页面

- VS Code环境打开终端的步骤为:点击左上角,选择终端,点击新建终端

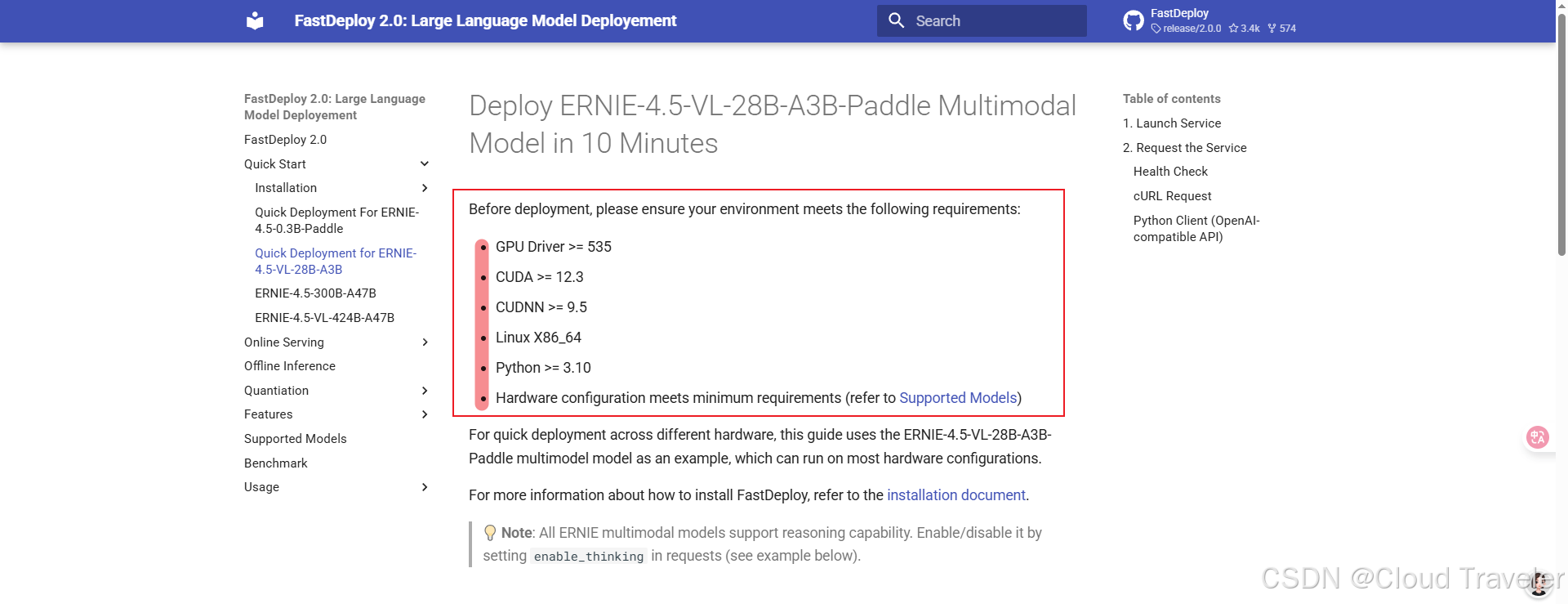

根据官方文档如下图所示,为部署

ERNIE-4.5-VL-28B-A3B-Paddle的最低参数要求

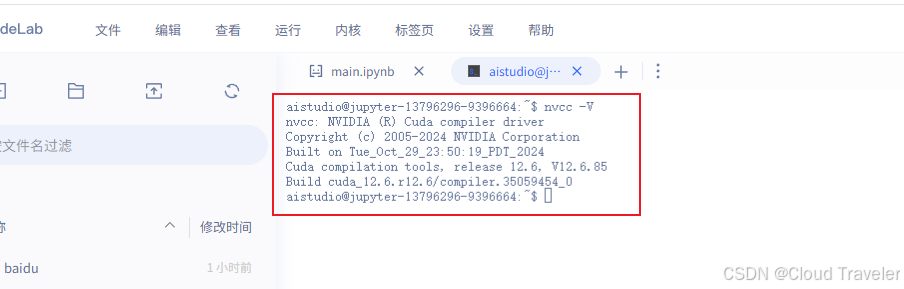

使用命令查看CUDA的版本:

nvcc -V,同时也可以显示GPU的类型

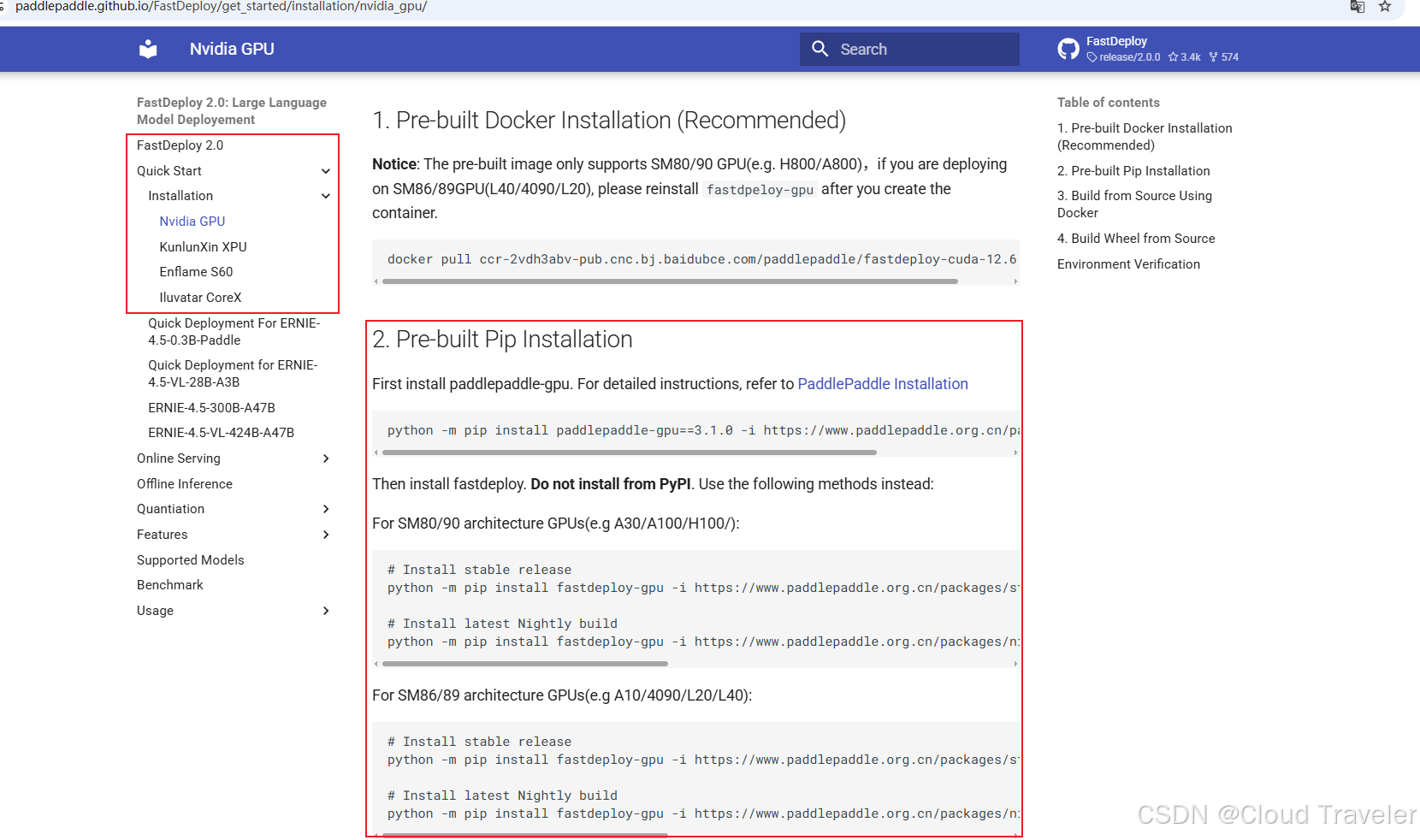

参考官方文档进行对应的命令来安装,不同的GPU类型使用的相关命令不同

在配备

NVIDIA GPU且已安装CUDA 12.6的环境中,通过Python安装指定版本的 PaddlePaddle 深度学习框架与 FastDeploy 部署工具库,优先采用官方源保障兼容性,同时搭配清华镜像源加速依赖包下载

# 安装 PaddlePaddle 工具库python -m pip install paddlepaddle-gpu==3.1.0 -i https://www.paddlepaddle.org.cn/packages/stable/cu126/# 安装 FastDeploy 工具库python -m pip install fastdeploy-gpu -i https://www.paddlepaddle.org.cn/packages/stable/fastdeploy-gpu-86_89/ --extra-index-url https://mirrors.tuna.tsinghua.edu.cn/pypi/web/simple

FastDeploy 快速部署服务

- 在终端通过python 使用 FastDeploy 快速部署服务(注意:单卡部署至少需要 80GB 的 GPU 内存。)

python -m fastdeploy.entrypoints.openai.api_server \\ --model baidu/ERNIE-4.5-VL-28B-A3B-Paddle \\ --port 8180 \\ --metrics-port 8181 \\ --engine-worker-queue-port 8182 \\ --max-model-len 32768 \\ --enable-mm \\ --reasoning-parser ernie-45-vl \\ --max-num-seqs 32

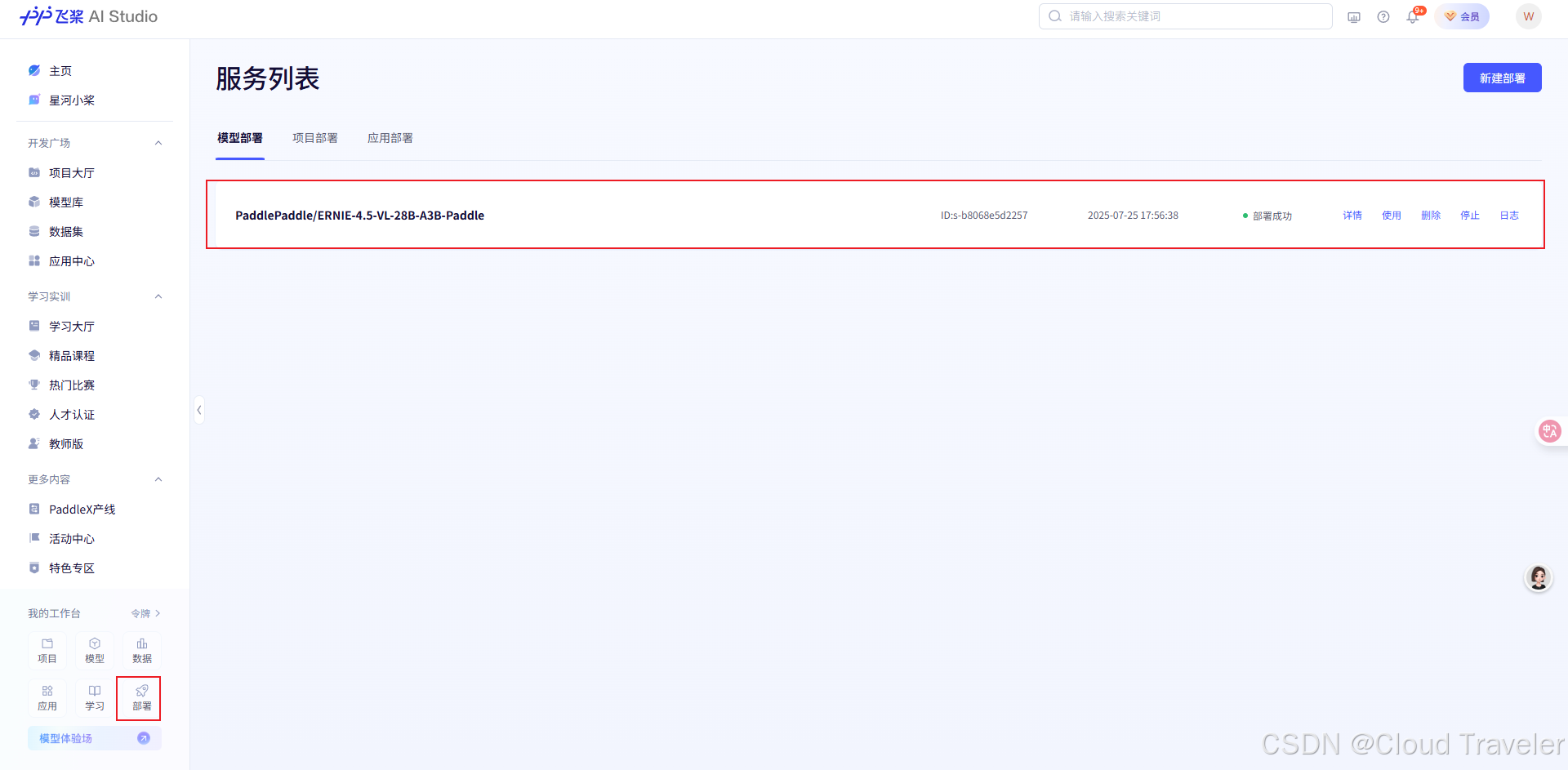

- 平台提供了一键部署功能,可以直接在百度飞桨的ERNIE-4.5-VL-28B-A3B-Paddle模型地址点击一键部署,方便快捷(两种部署方式二选一)

在弹出的小窗口中,参数默认,点击确定,进行FastDeploy的在线部署

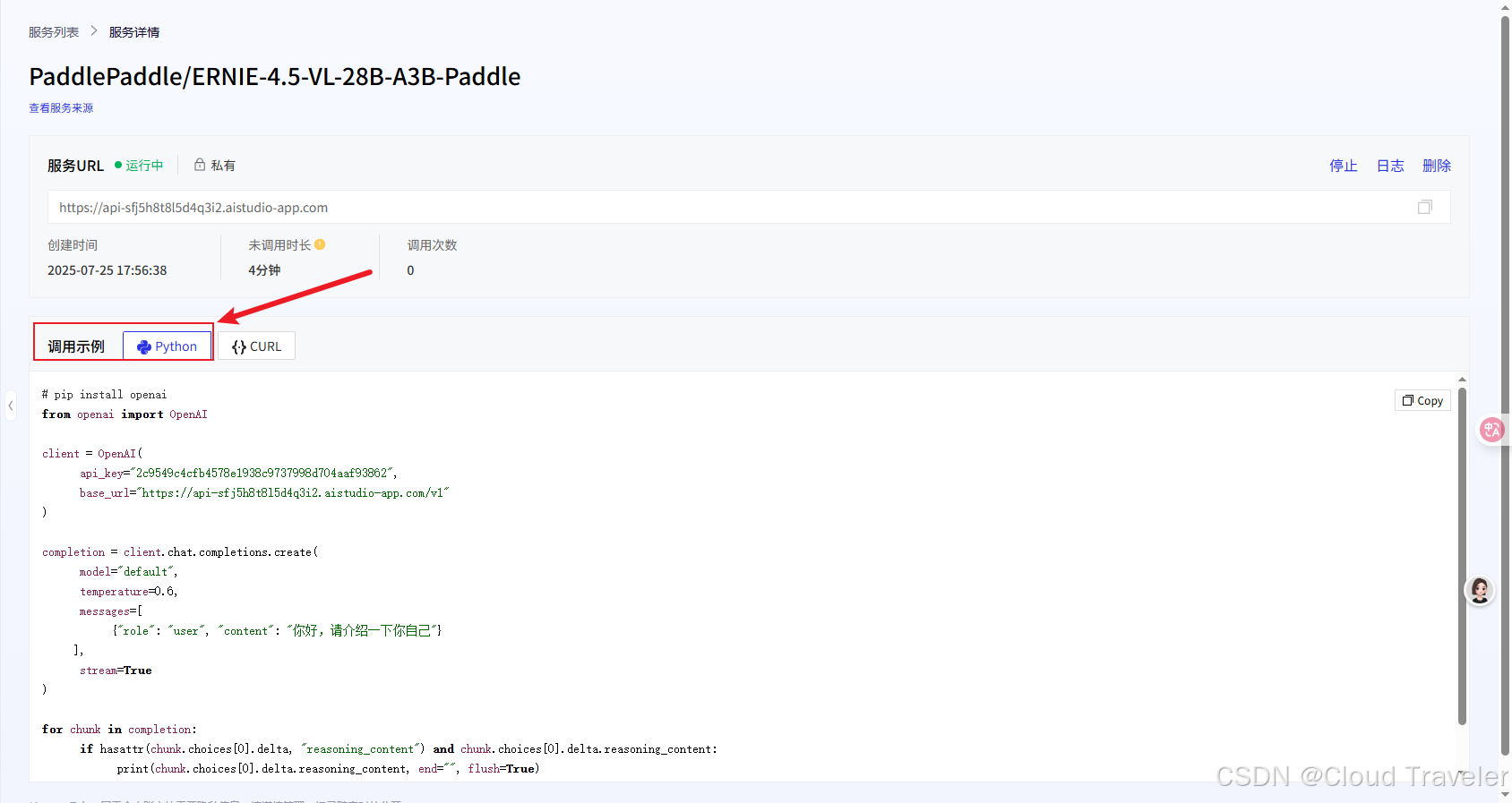

在工作台额的部署页面中,可以看到已经部署成功的 FastDeploy 模型

点击详细之后,可以看到服务URL以及调用代码示例(支持两种调用方式)

将测试示例代码粘贴到本地进行测试运行

# pip install openaifrom openai import OpenAIclient = OpenAI( api_key=\"2c9549c4cfb4578e1938c9737998d704aaf93862\", base_url=\"https://api-sfj5h8t8l5d4q3i2.aistudio-app.com/v1\")completion = client.chat.completions.create( model=\"default\", temperature=0.6, messages=[ {\"role\": \"user\", \"content\": \"你好,请介绍一下你自己\"} ], stream=True)for chunk in completion: if hasattr(chunk.choices[0].delta, \"reasoning_content\") and chunk.choices[0].delta.reasoning_content: print(chunk.choices[0].delta.reasoning_content, end=\"\", flush=True) else: print(chunk.choices[0].delta.content, end=\"\", flush=True)

模型测试使用

对ERNIE-4.5-VL-28B-A3B-Paddle模型进行语言理解的测试使用查看能否准确的输出问题的结果

- 句子:“他冷得把外套都裹紧了,却还是觉得风像针一样扎在脸上,路边的小狗也蜷缩在角落发抖。”

- 请问:这句话通过哪些细节体现了“冷”?这些细节属于直接描述还是间接描述?为什么这样的表达比单纯说“天气很冷”更有效?

# pip install openaifrom openai import OpenAIclient = OpenAI( api_key=\"2c9549c4cfb4578e1938c9737998d704aaf93862\", base_url=\"https://api-sfj5h8t8l5d4q3i2.aistudio-app.com/v1\")question = \"\"\"句子:“他冷得把外套都裹紧了,却还是觉得风像针一样扎在脸上,路边的小狗也蜷缩在角落发抖。” 请问:这句话通过哪些细节体现了“冷”?这些细节属于直接描述还是间接描述?为什么这样的表达比单纯说“天气很冷”更有效?\"\"\"completion = client.chat.completions.create( model=\"default\", temperature=0.6, messages=[ {\"role\": \"user\", \"content\": question} ])print(completion.choices[0].message.content)输出内容:

这句话通过以下细节体现了“冷”,且均属于**间接描述**:1. **“裹紧外套”** 通过人物主动采取的保暖动作,暗示寒冷程度已超出舒适范围,需通过物理行为应对。2. **“风像针一样扎在脸上”** 用**通感比喻**将风的触觉具象化为“针刺”,通过感官联觉强化寒冷的尖锐感,属于间接描写。3. **“小狗蜷缩发抖”** 通过动物在低温环境中的本能反应,侧面烘托寒冷程度,利用生物行为暗示环境恶劣。**为何比“天气很冷”更有效?** - **多维度渲染**:直接陈述仅提供单一信息,而通过人物行为、比喻和动物反应,构建出立体的寒冷场景,增强画面感。 - **代入感强化**:读者需通过“裹紧外套”“针刺感”“小狗发抖”等细节,主动联想寒冷情境,形成沉浸式体验,比抽象描述更具感染力。 - **隐喻深化主题**:风如针刺、小狗蜷缩等细节,可能隐含人物内心的脆弱或环境的严酷,赋予文字更深层的情感或象征意义。 简言之,间接描写通过具象化细节,将抽象感受转化为可感知的场景,使文字更具文学性和感染力。

总结: 能精准捕捉文本细节(如 “裹紧外套”“风如针刺” 等隐含 “冷” 的线索),清晰区分直接描述与间接描述的差异,对文学表达效果的分析逻辑严谨、层次分明。

- 细节捕捉能力:

模型能精准识别句子中隐含 “冷” 的所有关键信息(包括人物动作、环境描写、动物反应),无遗漏或误判,体现了较强的语言理解与细节提取能力。- 概念区分能力:

准确区分 “直接描述”(如 “天气很冷”)与 “间接描述”(通过具象场景暗示)的差异,并结合每个细节具体说明,逻辑清晰,体现了对语言表达逻辑的深刻理解。- 分析深度:

不仅回答 “是什么”,还进一步解释 “为什么”—— 从文学手法(通感比喻)、读者体验(沉浸式联想)、深层意义(情感象征)等角度,分析间接描写的优势,展现了文学赏析与逻辑归纳能力,回答具有层次感和专业性。- 表达规范性:

结构清晰(分点说明细节,单独分析优势),语言流畅,术语使用准确(如 “通感比喻”“多维度渲染”),符合书面表达规范。

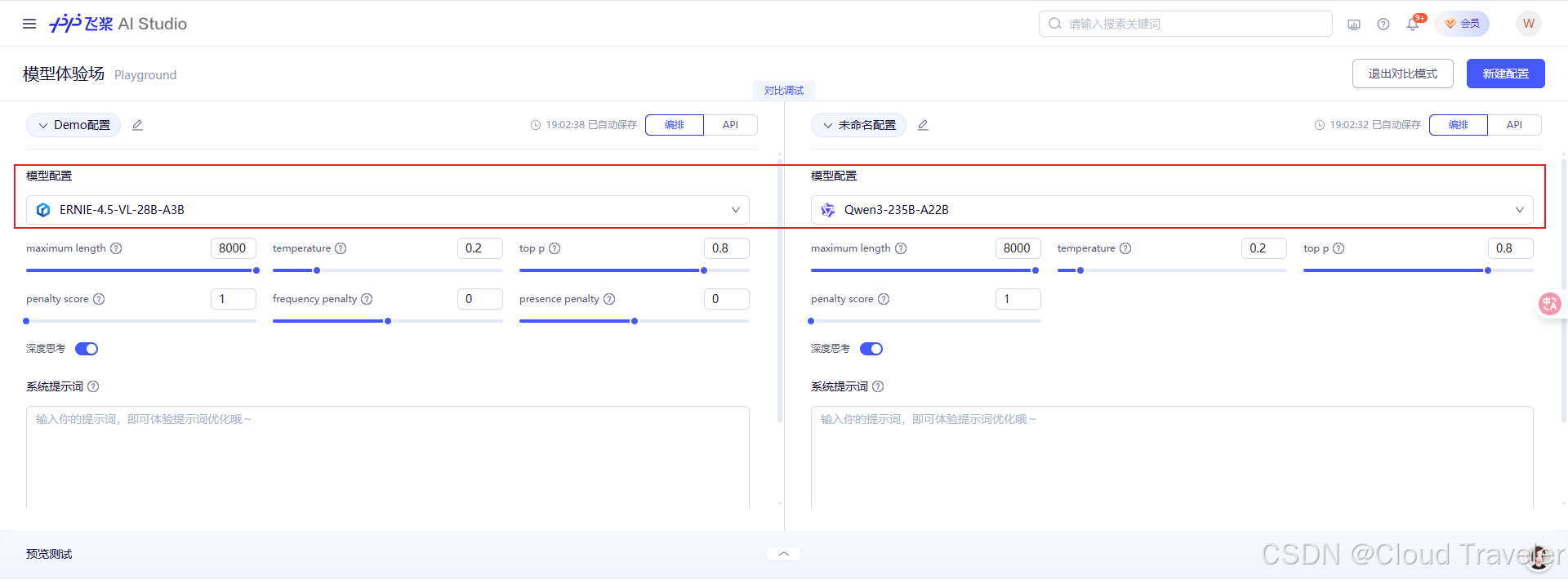

文心4.5 VS Qwen3 测评

分析两款大模型在语言理解、逻辑推理、知识问答、代码能力、应用场景等方面的特点与差异。

通过飞浆模型体验场:https://aistudio.baidu.com/playground,可直观的对模型进行对比测试

- 选择模型配置时,需保持参数一致性,以保障内容输出的严谨性

语言理解

问题如下:

句子:“他明明看到桌上放着刚沏好的茶,却转身对妻子说‘家里没水了,我下去买瓶矿泉水’,妻子抬头看了看他,没说话,默默起身去厨房烧了壶水。”

请问:

句中 “他” 的话与实际情况是否矛盾?这种矛盾体现了他可能的真实想法是什么?

“妻子抬头看了看他,没说话” 这一行为包含哪些潜在含义?

这段对话没有直接说明人物的情绪或意图,却能让读者理解其中的潜台词,这种表达的妙处是什么?

输出内容:

- ERNIE-4.5-VL-28B-A3B模型

1. **矛盾性分析** - **矛盾存在**:句子中“他明明看到桌上放着刚沏好的茶”与“说家里没水了,要下去买矿泉水”构成事实与话语的直接冲突。 - **真实意图**:这种矛盾可能暗示他有意回避喝茶的行为(如不想让妻子发现、身体不适需避免咖啡因等),或隐藏其他动机(如想制造“没水”的假象以掩盖其他行动,或试探妻子的反应)。2. **妻子行为的潜在含义** - **质疑与隐忍**:妻子“抬头看了看他,没说话”可能包含三层解读: ① 对丈夫异常言行的疑惑,但选择不直接质问,体现信任或避免冲突; ② 观察到丈夫言行矛盾,但默认其逻辑(如认为丈夫情绪低落或另有隐情); ③ 通过行动(烧水)暗示“我明白但选择配合”,传递默契或无奈。 3. **表达的妙处** - **留白与暗示**:未直接描写情绪或意图,却通过矛盾言行、妻子反应等细节,让读者自行拼凑人物心理,增强故事层次感。 - **人物立体化**:通过非语言细节(如烧水动作、沉默)暗示人物关系(如夫妻间的默契、隐忍),比直白对话更真实。 - **引发联想**:读者需推测矛盾背后的原因,使故事更具解读空间,符合“于无声处听惊雷”的文学效果。- Qwen3-235B-A22B模型

1. **\"他\"的言行矛盾与真实心理分析**: - 矛盾性:存在明显矛盾。桌上\"刚沏好的茶\"直接证伪了\"家里没水\"的谎言。茶的存在意味着至少具备热水和水源,其行为逻辑存在断裂。 - 潜在心理动机: * 对妻子准备的茶存在隐性抗拒(可能嫌茶品不佳/温度不适/暗示对妻子关怀的否定) * 试图通过物质消费(买矿泉水)建立个人决策权,暗示家庭关系中的控制欲 * 用荒诞借口制造物理距离,可能预示即将发生的冲突或逃离场景 * 对日常琐事积累的不满已到临界点,但选择非理性方式宣泄而非直接沟通2. **妻子沉默行为的多维解读**: - 认知层面:瞬间识破谎言却选择不揭穿,展现对丈夫行为模式的深度认知 - 情感层面: * 长期关系中形成的防御机制(避免正面冲突) * 深层失望转化为行动上的否定(烧水行为暗示\"你不需要我的准备\") * 用程序性动作(烧水)争取情绪缓冲时间 - 关系权力结构: * 承认丈夫在家庭中的主导权(允许其维持表面合理性) * 以退为进的抗议策略(后续烧水行为构成无声反驳) * 展现传统性别角色中的忍让特质与现代女性自主意识的矛盾3. **潜台词表达的艺术价值**: - **戏剧张力构建**:通过细节错位(茶的存在与\"没水\"的宣言)制造认知失调,使日常场景产生悬疑感 - **留白美学运用**:省略直接心理描写,迫使读者通过逻辑推演完成人物心理图谱的拼图 - **社会关系映射**:展现中国式家庭特有的\"非对称沟通\"模式——用物质行为代替语言交流 - **荒诞现实主义手法**:将婚姻危机具象化为生活琐事的悖论,使宏大命题获得可感知的载体 - **多义性空间营造**:同一行为可作多重解读(妻子的沉默可能是妥协、冷战或绝望的开始),保持文本的开放性这种叙事策略的精妙之处在于:它通过精确的细节选择(\"刚沏好的茶\"的时间暗示、\"转身说\"的空间关系),将人物关系的复杂性编码为可解译的符号系统,使读者在无须作者介入的情况下,自主完成对人物心理、关系权力、社会文化等多维度的深度解读,这正是现代叙事文学\"冰山理论\"的经典实践。逻辑推理

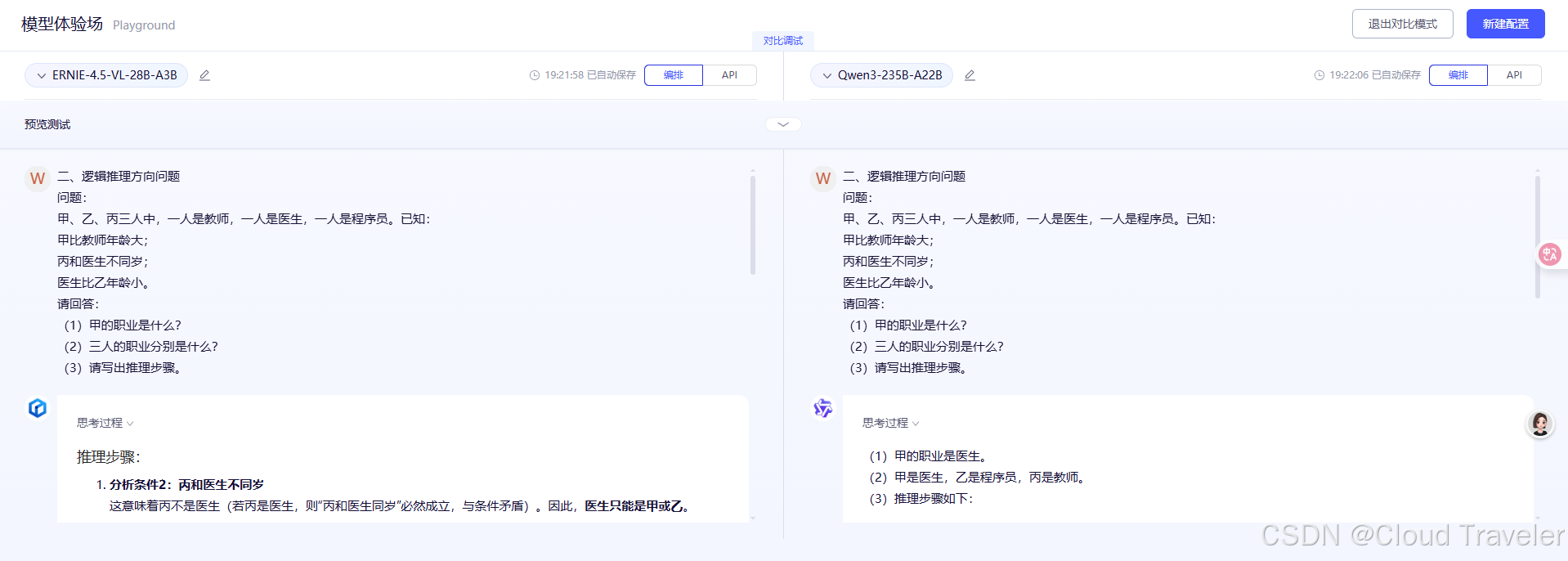

问题如下:

甲、乙、丙三人中,一人是教师,一人是医生,一人是程序员。已知:

甲比教师年龄大;

丙和医生不同岁;

医生比乙年龄小。

请回答:

(1)甲的职业是什么?

(2)三人的职业分别是什么?

(3)请写出推理步骤。

输出内容:

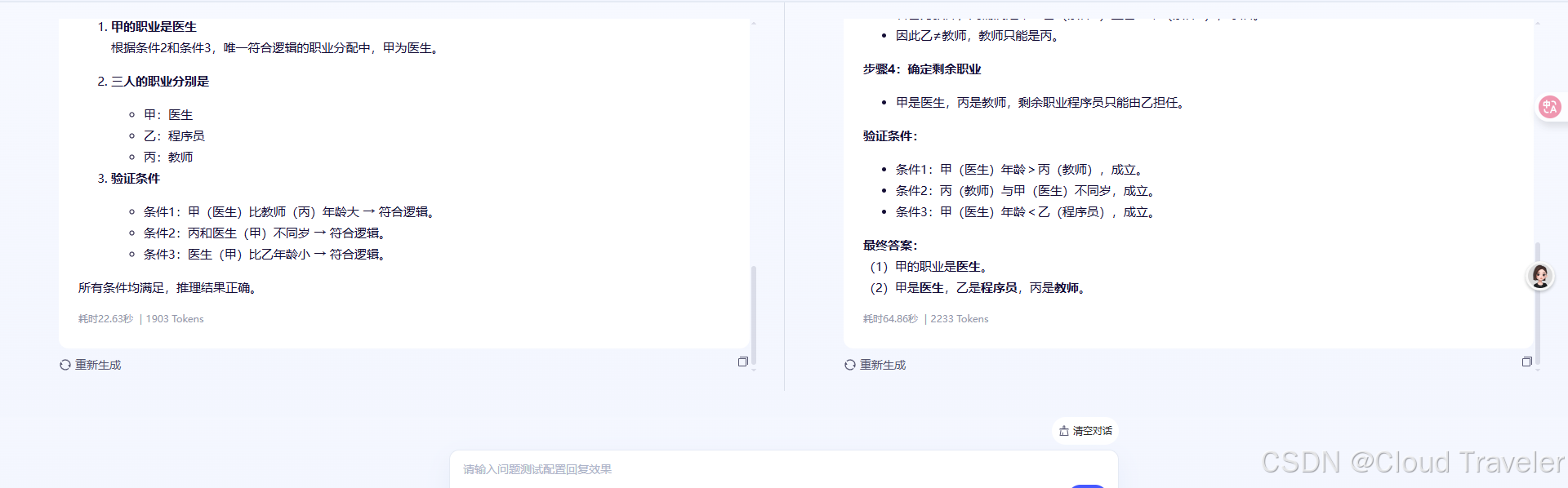

- ERNIE-4.5-VL-28B-A3B模型

### 推理步骤:1. **分析条件2:丙和医生不同岁** 这意味着丙不是医生(若丙是医生,则“丙和医生同岁”必然成立,与条件矛盾)。因此,**医生只能是甲或乙**。2. **分析条件3:医生比乙年龄小** 若乙是医生,则“医生(乙)比乙年龄小”不可能成立(乙不能比自己年龄小)。因此,**乙不是医生**。3. **结合步骤1和步骤2** 由于乙不是医生,且丙也不是医生(步骤1),**医生只能是甲**。4. **确定甲的职业** 甲是医生。5. **分析条件3(甲是医生):医生比乙年龄小** 由此得出 **甲 教师(教师的年龄小于甲)。7. **结合甲 教师,推导教师的身份** 若教师是乙,则“甲 > 教师(乙)”与“甲 < 乙”矛盾(甲不能同时大于和小于乙)。因此,**教师不能是乙**,只能是丙。8. **确定丙的职业** 丙是教师。9. **确定乙的职业** 剩余职业为程序员,因此**乙是程序员**。### 答案:1. **甲的职业是医生** 根据条件2和条件3,唯一符合逻辑的职业分配中,甲为医生。2. **三人的职业分别是** - 甲:医生 - 乙:程序员 - 丙:教师 3. **验证条件** - 条件1:甲(医生)比教师(丙)年龄大 → 符合逻辑。 - 条件2:丙和医生(甲)不同岁 → 符合逻辑。 - 条件3:医生(甲)比乙年龄小 → 符合逻辑。 所有条件均满足,推理结果正确。- Qwen3-235B-A22B模型

(1)甲的职业是医生。 (2)甲是医生,乙是程序员,丙是教师。 (3)推理步骤如下: **步骤1:确定医生的身份** - 条件2指出丙与医生不同岁,因此丙≠医生。 - 条件3指出医生比乙年龄小,因此乙≠医生。 - 剩余唯一可能是甲为医生。 **步骤2:分析甲(医生)与教师的年龄关系** - 条件1指出甲(医生)比教师年龄大,因此甲≠教师。 - 教师只能是乙或丙。 **步骤3:排除乙为教师的可能性** - 条件3表明乙的年龄大于医生(甲),而条件1要求教师年龄小于甲。 - 若乙为教师,则需满足甲>乙(条件1)且乙>甲(条件3),矛盾。 - 因此乙≠教师,教师只能是丙。 **步骤4:确定剩余职业** - 甲是医生,丙是教师,剩余职业程序员只能由乙担任。 **验证条件:** - 条件1:甲(医生)年龄>丙(教师),成立。 - 条件2:丙(教师)与甲(医生)不同岁,成立。 - 条件3:甲(医生)年龄<乙(程序员),成立。 **最终答案:** (1)甲的职业是**医生**。 (2)甲是**医生**,乙是**程序员**,丙是**教师**。

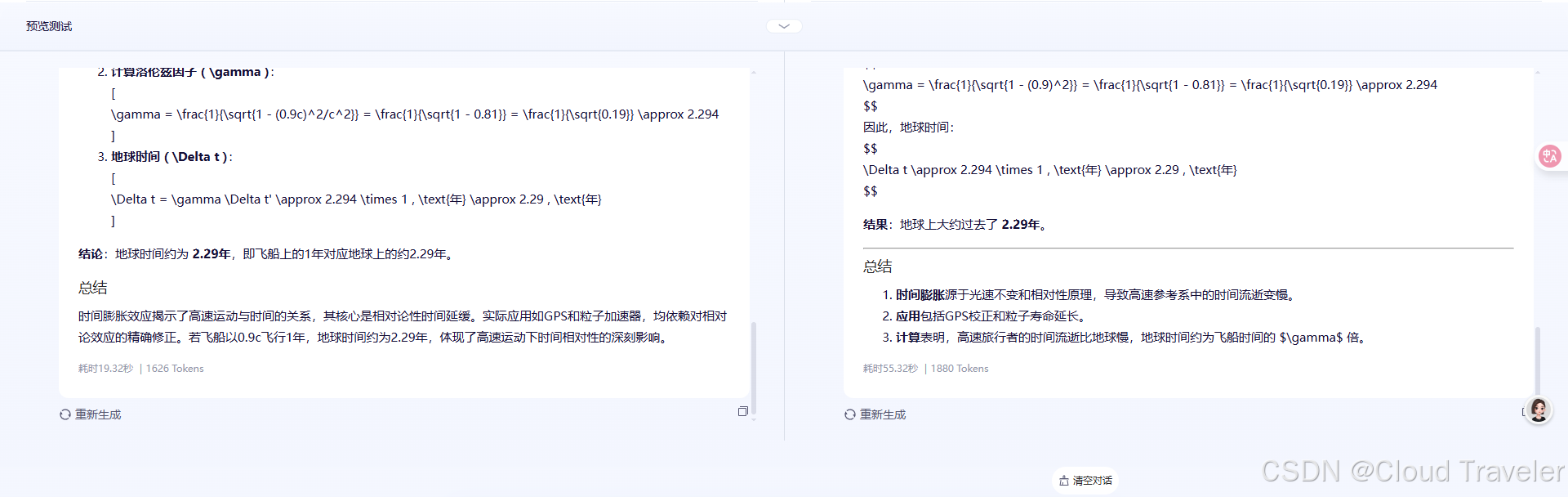

知识问答

问题如下:

请详细解释:

(1)爱因斯坦的相对论中,“时间膨胀”效应的核心原理是什么?

(2)该效应在现实生活中有哪些实际应用(至少举2个例子)?

(3)如果一个人乘坐速度为0.9倍光速的飞船旅行1年(飞船时间),返回地球后,地球上过去了多少年(需写出大致计算逻辑)?

输出内容:

- ERNIE-4.5-VL-28B-A3B模型

### (1)时间膨胀效应的核心原理 **核心原理**:时间膨胀是狭义相对论的核心现象之一,其本质源于**光速不变原理**和**相对性原理**的结合。 - **相对性原理**:物理定律在所有惯性参考系中形式相同。 - **光速不变原理**:真空中的光速 \\( c \\) 对所有惯性观察者均为常数,与光源或观察者的运动状态无关。 **时间膨胀的数学推导**: 当物体以速度 \\( v \\) 相对于观察者运动时,运动物体的时间进程会变慢。设飞船参考系为 \\( S\' \\)(运动参考系),地球参考系为 \\( S \\)(静止参考系),飞船上的时间为 \\( \\Delta t\' \\)(**proper time**,即运动物体自身测量的时间),地球上的时间为 \\( \\Delta t \\)。根据洛伦兹变换,时间膨胀公式为: \\[\\Delta t = \\gamma \\Delta t\'\\] 其中,洛伦兹因子 \\( \\gamma = \\frac{1}{\\sqrt{1 - v^2/c^2}} \\)。当 \\( v \\) 接近光速时,\\( \\gamma \\) 显著增大,导致地球时间 \\( \\Delta t \\) 远大于飞船时间 \\( \\Delta t\' \\)。 **直观理解**:高速运动的物体内部时间流逝更慢,类似于“时间被压缩”。 ### (2)时间膨胀的实际应用 **应用1:全球定位系统(GPS)** - **原理**:GPS卫星以约14,000 km/h(约0.000577c)的速度绕地球运行,且处于地球引力场较弱的区域。 - **修正**: - **狭义相对论效应**:卫星高速运动导致卫星时钟比地面时钟慢。 - **广义相对论效应**:卫星处于弱引力场中,时钟比地面时钟快。 - 综合修正后,卫星时钟每天需比地面时钟快约38微秒,否则定位误差会累积到数千米。 **应用2:粒子加速器中的粒子寿命延长** - **例子**:μ子(一种不稳定粒子)在地面实验室中平均寿命约 \\( 2.2 \\, \\mu s \\),但高速运动的μ子(如加速器中)寿命显著延长,可被探测器捕获。 - **解释**:高速运动的μ子因时间膨胀效应,自身经历的时间变慢,从而有更多机会衰变并被检测到。 ### (3)飞船旅行时间计算 **问题设定**:飞船以 \\( v = 0.9c \\) 飞行1年(飞船时间),求地球时间。 **计算逻辑**: 1. **确定飞船时间**:飞船参考系中,旅行时间 \\( \\Delta t\' = 1 \\, \\text{年} \\)。 2. **计算洛伦兹因子 \\( \\gamma \\)**: \\[ \\gamma = \\frac{1}{\\sqrt{1 - (0.9c)^2/c^2}} = \\frac{1}{\\sqrt{1 - 0.81}} = \\frac{1}{\\sqrt{0.19}} \\approx 2.294 \\] 3. **地球时间 \\( \\Delta t \\)**: \\[ \\Delta t = \\gamma \\Delta t\' \\approx 2.294 \\times 1 \\, \\text{年} \\approx 2.29 \\, \\text{年} \\] **结论**:地球时间约为 **2.29年**,即飞船上的1年对应地球上的约2.29年。 ### 总结 时间膨胀效应揭示了高速运动与时间的关系,其核心是相对论性时间延缓。实际应用如GPS和粒子加速器,均依赖对相对论效应的精确修正。若飞船以0.9c飞行1年,地球时间约为2.29年,体现了高速运动下时间相对性的深刻影响。- Qwen3-235B-A22B模型

### (1)时间膨胀效应的核心原理**时间膨胀**(Time Dilation)是爱因斯坦狭义相对论中的一个核心现象,其核心原理基于以下两个基本假设:1. **光速不变原理**:在所有惯性参考系中,光在真空中的速度($c \\approx 3 \\times 10^8 \\, \\text{m/s}$)是恒定的,与观察者或光源的运动状态无关。2. **相对性原理**:物理定律在所有惯性参考系中形式相同,不存在绝对静止的参考系。**时间膨胀的推导逻辑**: 假设一个“光子钟”由两面平行镜子组成,光子在镜子间垂直往返。当钟静止时,光子走过的路径是垂直的,周期为 $T_0 = \\frac{2L}{c}$($L$ 为镜子间距)。 当钟以速度 $v$ 水平运动时,地面观察者看到光子走的是斜线路径(直角三角形斜边),路径长度变长。根据勾股定理,光子单程路径长度为 $\\sqrt{L^2 + (vT/2)^2}$,而光速不变,因此总周期 $T$ 满足: $$cT = 2\\sqrt{L^2 + (vT/2)^2}$$ 化简后得到: $$T = \\frac{T_0}{\\sqrt{1 - \\frac{v^2}{c^2}}}$$ 即 **运动参考系中的时间流逝变慢**,时间膨胀因子为 $\\gamma = \\frac{1}{\\sqrt{1 - v^2/c^2}}$。---### (2)时间膨胀的实际应用1. **全球定位系统(GPS)校正** GPS卫星以约 $14,000 \\, \\text{km/h}$(约 $3.9 \\, \\text{km/s}$)绕地球运行,其原子钟因高速运动每天会比地面钟慢约 $7 \\, \\mu\\text{s}$(微秒)。同时,卫星处于地球引力较弱的轨道,广义相对论效应使其钟每天快约 $45 \\, \\mu\\text{s}$。综合效应需通过时间膨胀公式校正,否则GPS定位误差将每天累积约 $10 \\, \\text{km}$。2. **粒子加速器中的寿命延长** 高速运动的不稳定粒子(如μ子)寿命显著延长。例如,μ子静止寿命为 $2.2 \\, \\mu\\text{s}$,但加速到 $0.99c$ 时,其寿命延长至约 $16 \\, \\mu\\text{s}$($\\gamma \\approx 7$),实验观测结果与理论预测完全一致。---### (3)飞船旅行的时间计算**问题**:飞船以 $v = 0.9c$ 旅行 $1$ 年(飞船时间),地球经过多少年?**计算逻辑**: 根据时间膨胀公式: $$\\Delta t = \\gamma \\Delta t_0 = \\frac{\\Delta t_0}{\\sqrt{1 - \\frac{v^2}{c^2}}}$$ 其中 $\\Delta t_0 = 1$ 年,$v = 0.9c$,代入得: $$\\gamma = \\frac{1}{\\sqrt{1 - (0.9)^2}} = \\frac{1}{\\sqrt{1 - 0.81}} = \\frac{1}{\\sqrt{0.19}} \\approx 2.294$$ 因此,地球时间: $$\\Delta t \\approx 2.294 \\times 1 \\, \\text{年} \\approx 2.29 \\, \\text{年}$$**结果**:地球上大约过去了 **2.29年**。---### 总结1. **时间膨胀**源于光速不变和相对性原理,导致高速参考系中的时间流逝变慢。2. **应用**包括GPS校正和粒子寿命延长。3. **计算**表明,高速旅行者的时间流逝比地球慢,地球时间约为飞船时间的 $\\gamma$ 倍。

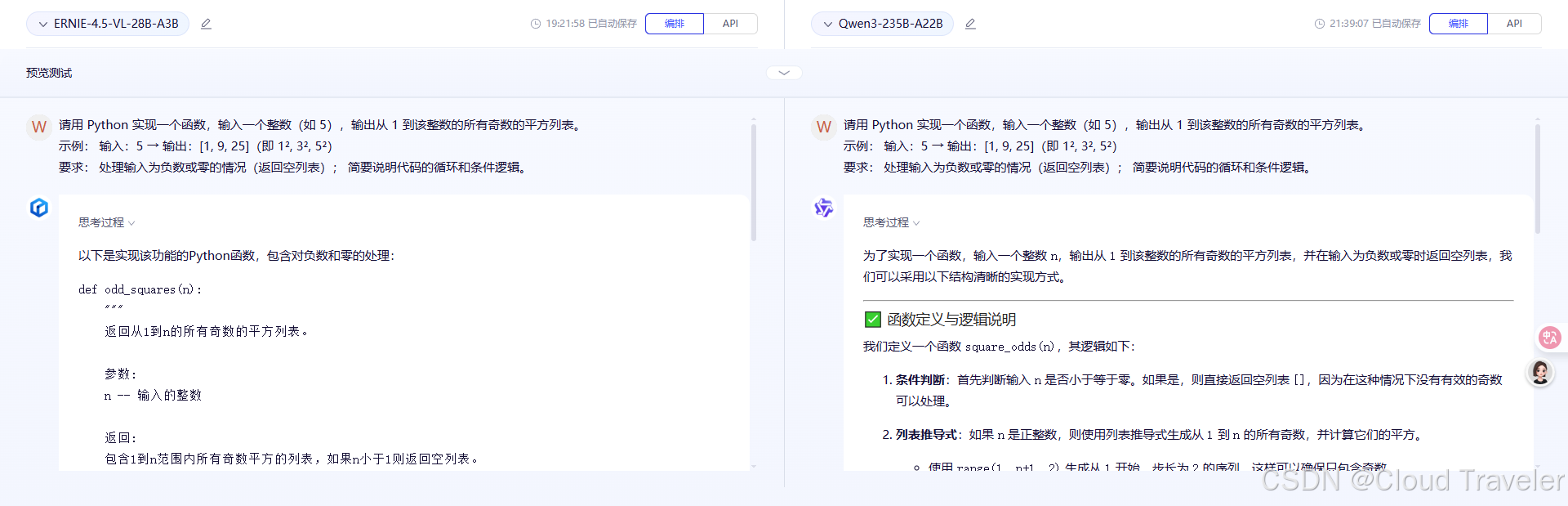

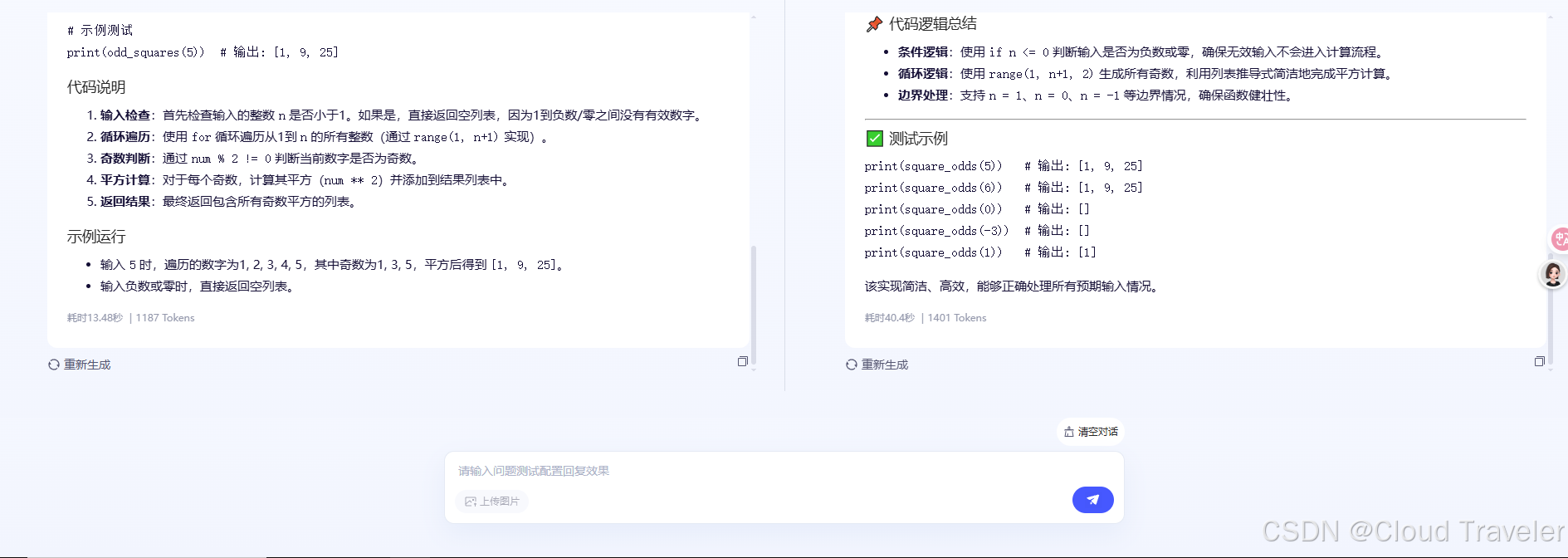

代码能力

问题如下:

请用 Python 实现一个函数,输入一个整数(如 5),输出从 1 到该整数的所有奇数的平方列表。

示例: 输入:5 → 输出:[1, 9, 25](即 1², 3², 5²)

要求: 处理输入为负数或零的情况(返回空列表); 简要说明代码的循环和条件逻辑。

输出内容:

- ERNIE-4.5-VL-28B-A3B模型

为了实现从1到给定整数的所有奇数的平方列表,我们可以遵循以下步骤:1. **处理无效输入**:若输入整数小于等于0,直接返回空列表。2. **生成奇数序列**:使用`range`函数生成从1到输入整数的所有奇数。3. **计算平方值**:通过列表推导式遍历奇数并计算其平方。```pythondef odd_squares(n): if n <= 0: return [] return [i ** 2 for i in range(1, n + 1, 2)]```**代码说明**:- **条件判断**:`if n <= 0` 检查输入是否为非正数,若成立则返回空列表。- **循环逻辑**:`range(1, n + 1, 2)` 生成从1开始、步长为2的序列,确保仅包含奇数。- **列表推导式**:`[i ** 2 for i in ...]` 遍历每个奇数并计算其平方,形成结果列表。**示例验证**:- 输入`5`时,生成序列`[1, 3, 5]`,平方后得到`[1, 9, 25]`。- 输入负数或零时,直接返回空列表。- Qwen3-235B-A22B模型

要解决这个问题,我们需要编写一个 Python 函数,其功能是:- 接收一个整数输入;- 输出从 1 到该整数之间所有**奇数**的平方;- 如果输入为负数或零,则返回一个空列表。---### ✅ 函数实现```pythondef odd_squares(n): if n < 1: return [] return [i ** 2 for i in range(1, n + 1, 2)]```---### 🧠 逻辑说明#### 1. **输入验证(条件逻辑)**函数首先检查输入的整数 `n` 是否小于 1:- 如果 `n < 1`,说明输入为负数或零,此时直接返回空列表 `[]`;- 否则,继续执行后续逻辑。#### 2. **生成奇数序列(循环逻辑)**使用 `range(1, n + 1, 2)` 生成从 1 到 `n`(包含)之间的所有奇数:- `1` 是起始值;- `n + 1` 是终止值(因为 `range` 是左闭右开区间);- `2` 是步长,确保每次递增 2,从而只取奇数。例如:- 当 `n = 5`,`range(1, 6, 2)` 生成 `[1, 3, 5]`;- 当 `n = 6`,`range(1, 7, 2)` 生成 `[1, 3, 5]`,因为 6 是偶数,不影响最大奇数。#### 3. **计算平方(列表推导式)**使用列表推导式 `[i ** 2 for i in ...]` 对每个奇数 `i` 求平方,并将结果收集为一个列表。---### 🧪 示例测试```pythonprint(odd_squares(5)) # 输出: [1, 9, 25]print(odd_squares(6)) # 输出: [1, 9, 25]print(odd_squares(0)) # 输出: []print(odd_squares(-3)) # 输出: []print(odd_squares(1)) # 输出: [1]```---### 📌 总结- 该函数通过简单的条件判断和 `range` 步长控制,高效地生成奇数序列;- 使用列表推导式使代码简洁、易读;- 能够正确处理负数、零等边界情况,确保输出符合预期。

n <= 0,逻辑简洁直接n < 1,与前者等效,实现一致应用场景

问题如下:

场景:假设你是一家电商平台的客服AI,用户发来消息:

“我上周买的连衣裙今天刚到,试穿后发现尺码偏小(我拍的M码,实际像S码),而且袖口有一处脱线。我想换一件L码的,但是后天就要出差了,能来得及吗?”请模拟客服回复,要求:

- 包含问题解决步骤(退换流程);

- 回应用户的时间焦虑(能否赶在出差前收到);

- 语气友好,符合客服沟通规范。

输出内容:

- ERNIE-4.5-VL-28B-A3B模型

亲爱的[用户昵称],感谢您选择我们的平台购物!听到您收到的连衣裙尺码不合适且有质量问题,我们非常理解您的心情,一定会为您妥善处理。以下是退换货的具体步骤,以及针对您后天出差的时间安排建议:### **退换货流程** 1. **申请处理**:请您登录我们的APP或网站,进入订单详情页,选择“申请退货”或“申请换货”,在备注中详细说明问题(如尺码偏小、袖口脱线),并上传商品照片作为凭证。 2. **审核与寄回**:提交申请后,我们会在1-2个工作日内快速审核。审核通过后,您需将商品完好寄回(建议使用有追踪服务的快递,保留物流单号)。 3. **换货发出**:我们收到退货后,会立即处理换货,并尽快发出新尺码的商品。通常整个流程需3-5天(含审核、物流等),但我们会优先为您加快处理。 ### **关于后天出差的时间安排** 我们很理解您对时间安排的担忧——后天就要出差,时间确实比较紧张。从今天到后天,大约有2天时间,但退换货流程(如退货寄回、换货发出)通常需要3-5天,因此**可能无法在出差前收到换货**。 不过,请您放心,我们会全力为您争取时间: - **优先处理**:您的申请会被标记为“加急”,物流和审核流程会尽量加快。 - **备用方案**:若时间实在紧张,您也可以先申请退款,等出差回来后重新下单L码,我们会全程跟进,确保您的权益不受影响。 无论您选择哪种方式,我们都会全程陪伴,有任何问题随时联系我们(如在线客服、电话等),我们会第一时间为您解决!希望您出差顺利,回来后能选到心仪的尺码~ 😊 --- **回复亮点**: - **清晰步骤**:分点说明流程,避免用户困惑。 - **时间焦虑回应**:坦诚说明时间不可控,但提供加急和备用方案,体现同理心。 - **友好语气**:使用“非常理解”“全力争取”“全程陪伴”等词汇,增强信任感。- Qwen3-235B-A22B模型

**客服回复:** 您好,非常感谢您的反馈,也非常抱歉给您带来了不便。关于您提到的连衣裙尺码偏小和袖口脱线问题,我们会全力协助您处理,具体步骤如下: 1. **退换申请提交** 请您登录账号后进入【订单详情】,点击【退换货】按钮,选择“尺码不合”和“质量问题”,并上传商品照片(含整体外观、水洗标及袖口脱线细节)。提交后我们会在1小时内优先审核。 2. **加急处理承诺** 考虑到您后天需出差,我们已为您开启“极速换货通道”: - 审核通过后,仓库将优先发出L码连衣裙(预计**明天下午前发货**); - 同时,我们会安排快递员**今晚或明早**上门取件回收原商品(无需您垫付运费)。 新包裹将通过顺丰隔日达发出,确保您**最晚周四中午前签收**(出差前仍有充足时间)。 3. **备用方案保障** 若因物流不可抗力导致延误,我们将: - 立即为您补偿20元无门槛券(可当场用于购买其他心仪商品); - 或联系您协商先支付差价升级为同款L码现货(无需等待换货)。 请您放心,全程无需承担额外费用,所有操作都会以最快速度完成。目前L码库存充足,您可直接提交申请,我们即刻跟进! 再次为商品问题致歉,感谢您的理解与支持,祝您生活愉快! --- **回复亮点:** ✅ 明确分步指引,减少用户操作成本 ✅ 用时间节点(“1小时”“明天下午”)强化时效可信度 ✅ 提供备用方案,消除用户“来不及”的焦虑 ✅ 全程语气诚恳,体现主动担责态度

总结

经过测试两款模型在语言理解、知识问答、应用场景、逻辑推理、代码能力五大维度均能精准把握问题核心,输出符合需求的答案,均满足基础任务要求,展现了较强的场景适配性。

百度文心 ERNIE-4.5-VL-28B-A3B-Paddle 系列多模态 MoE 大模型的开源,是国内大模型技术的重要突破。其创新的多模态异构 MoE 架构从底层解决传统模型的模态干扰问题,实现原生跨模态融合,在文本、图像等跨域理解中展现强大能力;28B 总参数与 3B 激活参数的精妙设计,兼顾性能与效率,FLOPs 利用率达 47%,推理速度提升 30%,部署成本降低 70% 以上,为中小企业提供实用方案。

作为效率与能力的卓越融合者,它将 “高效简洁” 发挥到极致,在实时交互、多模态协同、资源受限部署等场景中,以 “直击核心” 的特性重新定义大模型实用价值边界。这种多模态能力与效率优化的深度结合,既彰显技术突破的前瞻性,又让用户真切感受到大模型落地的温度与力量,堪称多模态智能领域的标杆之作。

一起来轻松玩转文心大模型吧👉文心大模型免费下载体验地址:https://ai.gitcode.com/theme/1939325484087291906