【AI大模型前沿】昆仑万维开源Skywork-R1V3:38B多模态推理模型,高考数学142分刷新开源SOTA

系列篇章💥

目录

- 系列篇章💥

- 前言

- 一、项目概述

- 二、技术原理

-

- (一)、整体训练框架

- (二)、GRPO强化学习算法

- (三)、跨模态连接器微调

- (四)、数据蒸馏与冷启动

- 三、主要功能

-

- (一)、跨模态推理

- (二)、多学科泛化

- (三)、教育级链式思维展示

- (四)、工具调用与插件扩展

- 四、应用场景

-

- (一)、教育领域

- (二)、医疗领域

- (三)、科研领域

- (四)、艺术与创意

- 五、性能表现

-

- (一)、公开基准

- (二)、中国高考实测

- (三)、消融实验

- 六、快速使用

-

- (一)、环境准备

- (二)、模型下载

- (三)、推理示例

- (四)、vLLM高并发部署

- (五)常见报错与解决

- 七、结语

- 项目地址

前言

2025年7月9日,昆仑万维旗下Skywork AI团队宣布开源Skywork-R1V3-38B,以高考数学142分、MMMU 76分的成绩,首次让开源多模态模型逼近人类初级专家水平。本文将深度解析其技术原理、功能边界与落地实践,帮助开发者与教育、医疗、科研等行业伙伴快速上手。

一、项目概述

Skywork-R1V3是昆仑万维Skywork AI基于InternVL3-38B打造的开源多模态推理大模型,通过强化学习后训练,仅用2.5万条小数据即在数学、物理、医学影像等跨学科任务上超越同规模闭源模型,成为当前开源社区视觉-语言推理的新标杆。

二、技术原理

(一)、整体训练框架

1、两阶段策略:先进行冷启动监督微调(SFT)建立推理格式,再用GRPO强化学习激发跨模态推理潜能。

2、小数据高效训练:1.2万条SFT + 1.3万条RL样本,参数量38B,单卡A100 80G即可推理。

(二)、GRPO强化学习算法

1、Group Relative Policy Optimization:以组为单位估计相对优势,减少方差、加速收敛。

2、关键熵驱动机制:实时监测生成链式思维(CoT)关键步骤的熵值,过滤低熵“死记硬背”模型,确保推理多样性。

(三)、跨模态连接器微调

1、冻结大语言模型权重,仅训练视觉-文本连接器,减少灾难性遗忘。

2、引入领域平衡因子,缓解数学领域数据过拟合,提升历史、艺术等泛化性能。

(四)、数据蒸馏与冷启动

1、利用上一代R1V2的推理结果蒸馏出高质量CoT样本,降低标注成本60%。

2、冷启动阶段加入“错误纠正”样本,教会模型识别并修正自身逻辑漏洞,提升鲁棒性。

三、主要功能

(一)、跨模态推理

1、图像+文本联合解析:可读取物理受力图、化学结构式、心电图,并给出逐步求解过程。

2、多图融合:支持一次性输入多张图像进行关联推理,例如对比实验前后显微照片差异。

(二)、多学科泛化

1、数理逻辑:涵盖初高中竞赛到大学高数、线代、概率论。

2、人文社科:历史地图变迁、地理信息可视化、艺术作品风格分析。

(三)、教育级链式思维展示

1、可输出LaTeX格式的数学推导,方便教师直接嵌入课件。

2、支持中文、英文双语逐步解释,适配不同教学场景。

(四)、工具调用与插件扩展

1、开放Function Call接口,可调用Wolfram Alpha、Python解释器进行符号计算。

2、支持LangChain、LlamaIndex集成,快速构建RAG知识库问答。

四、应用场景

(一)、教育领域

1、个性化AI家教:学生上传手写题目照片,模型即时给出分步解析与错因分析。

2、智能阅卷:自动批改数学、物理大题,输出评分细则,教师复核效率提升3倍。

(二)、医疗领域

1、多模态诊断助手:结合CT/MRI影像与电子病历,输出疑似疾病列表及循证依据。

2、医学教育:住院医师上传病例,模型生成鉴别诊断思路,用于教学查房。

(三)、科研领域

1、实验数据洞察:读取论文图表与正文,提取关键结论并推荐下一步实验设计。

2、跨学科知识发现:输入地质图与气象数据,推理古气候演变模型。

(四)、艺术与创意

1、风格迁移分析:解析梵高、莫奈画作笔触,为新作品提供风格建议。

2、广告与营销:根据商品图与评论文本,生成多模态广告脚本。

五、性能表现

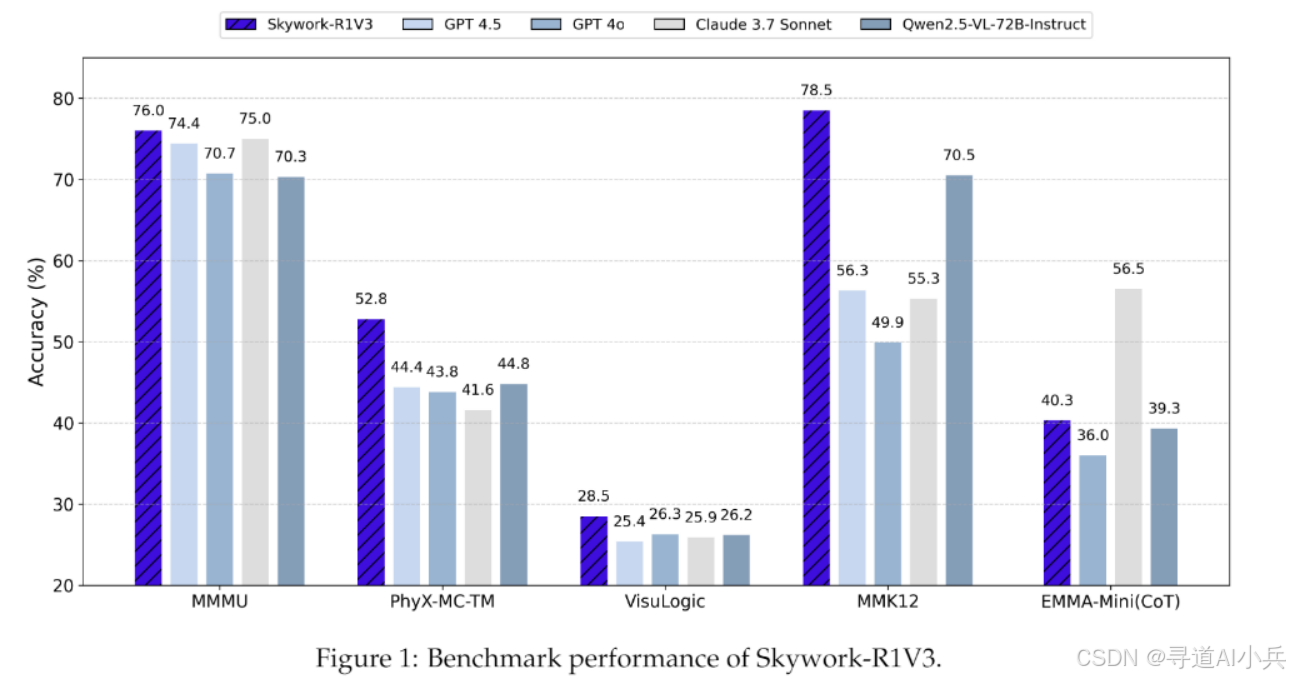

(一)、公开基准

1、MMMU(多学科多模态理解):76.0,领先第二名开源模型4.2分。

2、MathVista:68.7,超过GPT-4V 3.1分。

3、OlympiadBench:62.3,刷新开源纪录。

(二)、中国高考实测

1、2024年全国甲卷理科数学:142/150,错误集中在立体几何复杂作图题。

2、英语阅读理解:客观题满分,主观题得分率85%,语言模型部分仍有提升空间。

(三)、消融实验

1、移除关键熵机制后MMMU下降至71.4,证明多样性筛选有效。

2、仅用数学数据训练时,历史题得分降至39,显示连接器微调对泛化至关重要。

六、快速使用

(一)、环境准备

1、硬件:推荐单卡A100 80G或双卡RTX 4090 24G×2。

2、软件:

conda create -n r1v python=3.10 -yconda activate r1vgit clone https://github.com/SkyworkAI/Skywork-R1V.gitcd Skywork-R1V/inferencepip install -r requirements.txt(二)、模型下载

1、HuggingFace CLI登录

huggingface-cli login2、拉取权重

huggingface-cli download Skywork/Skywork-R1V3-38B --local-dir ./Skywork-R1V3-38B(三)、推理示例

1、命令行快速测试

python inference_with_transformers.py \\ --model_path ./Skywork-R1V3-38B \\ --image_paths ./examples/math.png \\ --question \"请详细解析这道几何题的证明过程,并用LaTeX输出。\"2、返回结果示例

{ \"answer\": \"\\\\textbf{步骤1:}\\\\quad 连接AC,利用勾股定理得AC=5...\", \"chain_of_thought\": \"观察到图形中存在直角三角形,可优先应用勾股定理...\"}(四)、vLLM高并发部署

1、安装vLLM

pip install vllm2、启动服务

from vllm import LLM, SamplingParamsllm = LLM(model=\"./Skywork-R1V3-38B\", tensor_parallel_size=2)out = llm.generate([\"![]() data:image/jpeg;base64,... 求解\"], sampling_params=SamplingParams(max_tokens=2048))print(out[0].outputs[0].text)

data:image/jpeg;base64,... 求解\"], sampling_params=SamplingParams(max_tokens=2048))print(out[0].outputs[0].text)(五)常见报错与解决

1、显存不足:启用AWQ量化版Skywork-R1V3-38B-AWQ,显存降至30 GB。

2、中文乱码:升级transformers>=4.42.0,确保tokenizer配置文件完整。

七、结语

Skywork-R1V3用极致的小数据训练策略和强化学习后训练,为开源社区带来了媲美闭源旗舰的多模态推理能力。随着Function Call与插件生态的完善,它将成为教育、医疗、科研等行业落地的首选基座模型。欢迎访问下方项目地址,一起探索跨模态智能的无限可能。

项目地址

GitHub:https://github.com/SkyworkAI/Skywork-R1V

HuggingFace:https://huggingface.co/Skywork/Skywork-R1V3-38B

技术论文:https://github.com/SkyworkAI/Skywork-R1V/blob/main/Skywork_R1V3.pdf

🎯🔖更多专栏系列文章:AI大模型提示工程完全指南、AI大模型探索之路(零基础入门)、AI大模型预训练微调进阶、AI大模型开源精选实践、AI大模型RAG应用探索实践🔥🔥🔥 其他专栏可以查看博客主页📑

😎 作者介绍:资深程序老猿,从业10年+、互联网系统架构师,目前专注于AIGC的探索(CSDN博客之星|AIGC领域优质创作者)

📖专属社群:欢迎关注【小兵的AI视界】公众号或扫描下方👇二维码,回复‘入群’ 即刻上车,获取邀请链接。

💘领取三大专属福利:1️⃣免费赠送AI+编程📚500本,2️⃣AI技术教程副业资料1套,3️⃣DeepSeek资料教程1套🔥(限前500人)

如果文章内容对您有所触动,别忘了点赞、⭐关注,收藏!加入我们,一起携手同行AI的探索之旅,开启智能时代的大门!