2024年09月12日 · Go生态洞察:在 Go 中构建 LLM 驱动的应用

2024年09月12日 · Go生态洞察:在 Go 中构建 LLM 驱动的应用 😺🐯

📄 摘要

大家好,我是猫头虎。

在本篇文章中,我将以专业且轻松的语气,带你深度剖析如何在 Go 语言中打造一款 LLM(大型语言模型)驱动 的 RAG(Retrieval-Augmented Generation)服务器。我们会结合 Google Gemini API、Weaviate、LangChainGo 和 Genkit for Go 等主流组件,系统性地展示三种实现方案的原理与最佳实践。

关键词:Go、LLM、RAG、Google Gemini、Weaviate、LangChainGo、Genkit

🔍 引言

随着 LLM 能力和相关工具(如向量化模型)在过去一年内的飞速提升,越来越多的开发者希望将 LLM 集成到自己的应用中。然而,LLM 通常需要专用硬件和大量算力,主流方案都是将其封装为网络服务,通过 REST 或 RPC 接口提供调用。为了实现领域化定制,RAG(检索增强生成)成为最可扩展的途径:先检索,再生成。

Go 在 高并发、网络编程 和 云原生 场景有天然优势,是编写 LLM 驱动应用的理想选择。下面,我们将以一个简单的 RAG 服务器示例为切入点,分三种变体:

- 直接调用 Google Gemini API + Weaviate

- 使用 LangChainGo 框架

- 使用 Genkit for Go

所有示例代码均托管于官方示例仓库。

猫头虎AI分享:Go生态洞察

- 2024年09月12日 · Go生态洞察:在 Go 中构建 LLM 驱动的应用 😺🐯

-

- 📄 摘要

- 🔍 引言

- 作者简介

-

- 猫头虎是谁?

- 作者名片 ✍️

- 加入我们AI编程共创团队 🌐

- 加入猫头虎的AI共创编程圈,一起探索编程世界的无限可能! 🚀

- 📑 正文

-

- 🧩 1. RAG 服务器概述 🐱

-

- 🥇 1.1 RAG 技术原理 😺

- 🥈 1.2 架构组件及交互 🐯

- 🤖 2. 直接调用 Google Gemini API 与 Weaviate 🐾

-

- ⚙️ 2.1 Go SDK 初始化与路由注册 🐈

- ⚙️ 2.2 并发处理与批量接口优化 🐈⬛

- 🛠 3. 使用 LangChainGo 构建 RAG 服务器 🦁

-

- 📚 3.1 模块化组件与接口统一 🎩

- 🔄 3.2 与直接调用的对比深度分析 😼

- 🧬 4. 使用 Genkit for Go 实现 🦊

-

- ⚡ 4.1 生产特性与工具集成 🔥

- 💡 知识要点总结

- ❓ QA 环节

- ✨ 总结

- 📢 参考资料

- 🔜 下一篇预告

- 🐅🐾猫头虎建议Go程序员必备技术栈一览表📖:

- 粉丝福利

-

-

- 联系我与版权声明 📩

-

作者简介

猫头虎是谁?

大家好,我是 猫头虎,猫头虎技术团队创始人,也被大家称为猫哥。我目前是COC北京城市开发者社区主理人、COC西安城市开发者社区主理人,以及云原生开发者社区主理人,在多个技术领域如云原生、前端、后端、运维和AI都具备丰富经验。

我的博客内容涵盖广泛,主要分享技术教程、Bug解决方案、开发工具使用方法、前沿科技资讯、产品评测、产品使用体验,以及产品优缺点分析、横向对比、技术沙龙参会体验等。我的分享聚焦于云服务产品评测、AI产品对比、开发板性能测试和技术报告。

目前,我活跃在CSDN、51CTO、腾讯云、阿里云开发者社区、知乎、微信公众号、视频号、抖音、B站、小红书等平台,全网粉丝已超过30万。我所有平台的IP名称统一为猫头虎或猫头虎技术团队。

我希望通过我的分享,帮助大家更好地掌握和使用各种技术产品,提升开发效率与体验。

作者名片 ✍️

- 博主:猫头虎

- 全网搜索IP关键词:猫头虎

- 作者微信号:Libin9iOak

- 作者公众号:猫头虎技术团队

- 更新日期:2025年07月21日

- 🌟 欢迎来到猫头虎的博客 — 探索技术的无限可能!

加入我们AI编程共创团队 🌐

- 猫头虎AI编程共创社群入口:

- 点我进入共创社群矩阵入口

- 点我进入新矩阵备用链接入口

加入猫头虎的AI共创编程圈,一起探索编程世界的无限可能! 🚀

🌷🍁 博主猫头虎(🐅🐾)带您 Go to New World✨🍁

🦄 博客首页——🐅🐾猫头虎的博客🎐

📑 正文

🧩 1. RAG 服务器概述 🐱

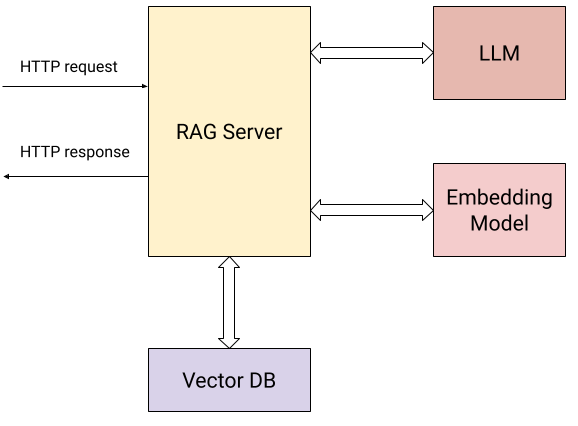

RAG 服务器提供两个核心 HTTP 接口:

- 添加文档(

POST /add/):客户端上传一批文本,服务器计算向量并存储到向量数据库中。 - 查询问答(

POST /query/):客户端提交问题,服务器检索相关文档,拼接 Prompt 并调用 LLM,最终返回答案。

典型调用流程图:

🥇 1.1 RAG 技术原理 😺

- Embedding:将文本映射到高维向量空间,以便进行相似度检索。

- 向量数据库:支持高效的相似度搜索,如 Weaviate。

- Prompt 工程:将检索出的上下文与用户问题拼接,提供给 LLM 生成答案。

🥈 1.2 架构组件及交互 🐯

- Embedding 服务(Google Gemini、OpenAI Embedding):批量/单条向量化。

- 向量存储(Weaviate、Milvus、Pinecone):存储与检索。

- LLM 服务(Google Gemini、OpenAI GPT):基于上下文生成文本。

- Go HTTP Server:调度上述三者,处理并发请求。

🤖 2. 直接调用 Google Gemini API 与 Weaviate 🐾

在第一种实现中,我们直接使用 Google Gemini 和 Weaviate 的 Go SDK。

⚙️ 2.1 Go SDK 初始化与路由注册 🐈

主要流程与 Go HTTP 服务器编程经验一致:

- 初始化 Gemini 客户端与 Weaviate 客户端。

- 将它们封装到

server对象中,传递给 Handler。 - 注册路由:

mux := http.NewServeMux()mux.HandleFunc(\"POST /add/\", server.addDocumentsHandler)mux.HandleFunc(\"POST /query/\", server.queryHandler)- http.NewServeMux:高性能、多路复用。

- HandleFunc:自定义路径和 Handler 映射。

- Go 的并发模型保证每个请求在独立 Goroutine 中执行,代码可写成“同步”风格,无需手动管理线程池。

⚙️ 2.2 并发处理与批量接口优化 🐈⬛

- 批量嵌入:使用

embModel.BatchEmbedContents,一次调用处理大量文本,减少网络往返。 - Weaviate 批量写入:

rs.wvClient.Batch,异步写入并行度控制。 - 流量控制:可结合 Go 的

semaphore或worker pool实现 QPS 限制,防止下游服务过载。 - 错误重试:使用指数退避(backoff)库,如 cenkalti/backoff,保障调用健壮性。

🛠 3. 使用 LangChainGo 构建 RAG 服务器 🦁

第二种变体借助 LangChainGo 框架,将 LLM、Embedder、VectorStore 等组件通过统一接口整合。

📚 3.1 模块化组件与接口统一 🎩

LangChainGo 提供一套通用接口,方便切换后端:

type VectorStore interface { AddDocuments(ctx context.Context, docs []schema.Document, options ...Option) ([]string, error) SimilaritySearch(ctx context.Context, query string, numDocuments int, options ...Option) ([]schema.Document, error)}- 优势:只需改动少量代码即可替换 Weaviate 为 Milvus、Pinecone 等。

- 初始化:调用框架的

NewClient,使用 JSON/YAML 配置声明式绑定。 - Pipeline:LangChainGo 支持可插拔的 Prompt 模板、链式调用,极大提升开发效率。

🔄 3.2 与直接调用的对比深度分析 😼

🧬 4. 使用 Genkit for Go 实现 🦊

Genkit for Go 是 Google 推出的新框架,专注于生产特性和提示管理。

⚡ 4.1 生产特性与工具集成 🔥

- Prompt 管理:内置版本控制和回滚能力,方便 A/B 测试 Prompt 效果。

- 部署支持:集成 Kubernetes、Cloud Run 部署脚本,一键生成镜像与配置。

- 监控:自动采集调用指标,兼容 OpenTelemetry。

Genkit 的实现与 LangChainGo 在接口层相似,但增加了生产级工具链。

💡 知识要点总结

/add/ 和 /query/ 两大 POST 操作BatchEmbedContents + wvClient.BatchVectorStore 等通用组件接口,易切换后端❓ QA 环节

Q1:为何要使用批量嵌入?

A1:降低网络开销,提高吞吐;一次请求可处理数百条文本,充分利用下游服务并发能力。

Q2:LangChainGo 与 Genkit 差异在哪?

A2:前者侧重组件统一和多后端支持,后者侧重生产部署和 Prompt 版本管理。

Q3:如何选择最适合的方案?

A3:若追求灵活、快速迭代,可选 LangChainGo;若关注生产特性、公平测试和集成运维,推荐 Genkit。

✨ 总结

本文被收录于猫头虎的 Go生态洞察 专栏,系统呈现了三种在 Go 中构建 LLM 驱动 RAG 服务器的实现方案,并深入探讨了各自的技术细节与扩展思路。

详情请点击:https://blog.csdn.net/qq_44866828/category_12492877.html

📢 参考资料

- Building LLM-powered applications in Go

https://go.dev/blog/llmpowered - RAG 服务器示例代码

https://github.com/golang/example/tree/master/ragserver - LangChainGo 项目

https://github.com/tmc/langchaingo - Genkit for Go 文档

https://developers.googleblog.com/en/introducing-genkit-for-go-build-scalable-ai-powered-apps-in-go/ - Weaviate 向量数据库

https://weaviate.io/ - Google Gemini API

https://ai.google.dev/

🔜 下一篇预告

在下一篇文章中,我将带来 “别名名称中的奥秘” —— 深入解析 Go 语言中的别名(Alias)命名规范与最佳实践,敬请期待!

学会Golang语言,畅玩云原生,走遍大小厂~💐

🐅🐾猫头虎建议Go程序员必备技术栈一览表📖:

☁️🐳

Go语言开发者必备技术栈☸️:

🐹 GoLang | 🌿 Git | 🐳 Docker | ☸️ Kubernetes | 🔧 CI/CD | ✅ Testing | 💾 SQL/NoSQL | 📡 gRPC | ☁️ Cloud | 📊 Prometheus | 📚 ELK Stack |AI

🪁🍁 希望本文能够给您带来一定的帮助🌸文章粗浅,敬请批评指正!🐅🐾🍁🐥

粉丝福利

👉 更多信息:有任何疑问或者需要进一步探讨的内容,欢迎点击文末名片获取更多信息。我是猫头虎,期待与您的交流! 🦉💬

联系我与版权声明 📩

- 联系方式:

- 微信: Libin9iOak

- 公众号: 猫头虎技术团队

- 万粉变现经纪人微信: CSDNWF

- 版权声明:

本文为原创文章,版权归作者所有。未经许可,禁止转载。更多内容请访问猫头虎的博客首页。

点击✨⬇️下方名片⬇️✨,加入猫头虎AI编程共创社群。一起探索科技的未来,共同成长。🚀

🔗 猫头虎AI编程共创500人社群 | 🔗 GitHub 代码仓库 | 🔗 Go生态洞察专栏 ✨ 猫头虎精品博文专栏🔗