荣登 Nature2025:大模型跨界水产、预测、安全领域,创新思路原来这么简单

关注gongzhonghao【计算机sci论文精选】

近期,DeepMind、OpenAI等顶尖团队持续在Science、Nature子刊发表突破性进展,揭示了新一代大模型在跨模态理解、复杂推理及具身智能方面的惊人潜力,任何志在AI前沿的探索者都应深度关注。

事实上,大模型相关的论文在NeurIPS、ICML、AAAI等顶会和JMLR、TPAMI等顶刊的录用率持续领跑,近半年更有多项重磅研究入选。虽然头部玩家竞争白热化,但在垂直领域深度优化、推理效率跃升、安全性增强等方向,仍蕴藏着海量原始创新机遇。今天小图给大家精选3篇Nature有关大模型方向的论文,请注意查收!

论文一:An integrating RAG-LLM and deep Q-network framework for intelligent fish control systems

方法:

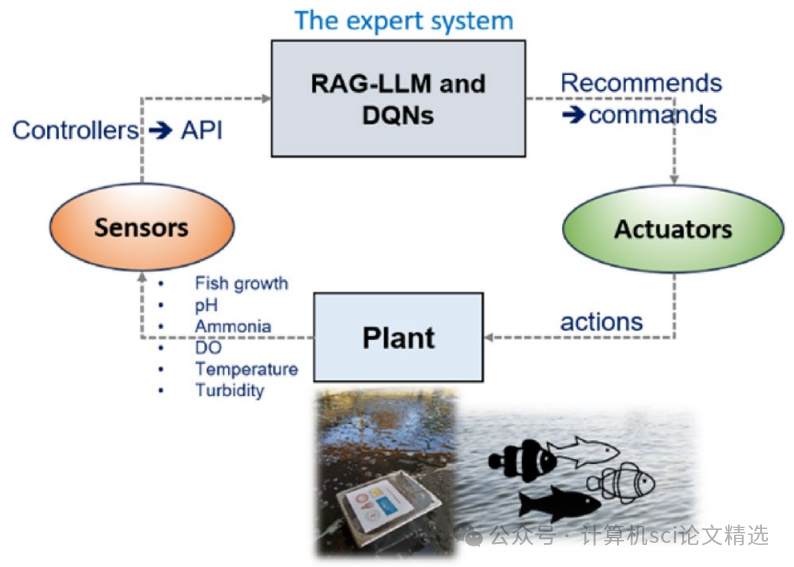

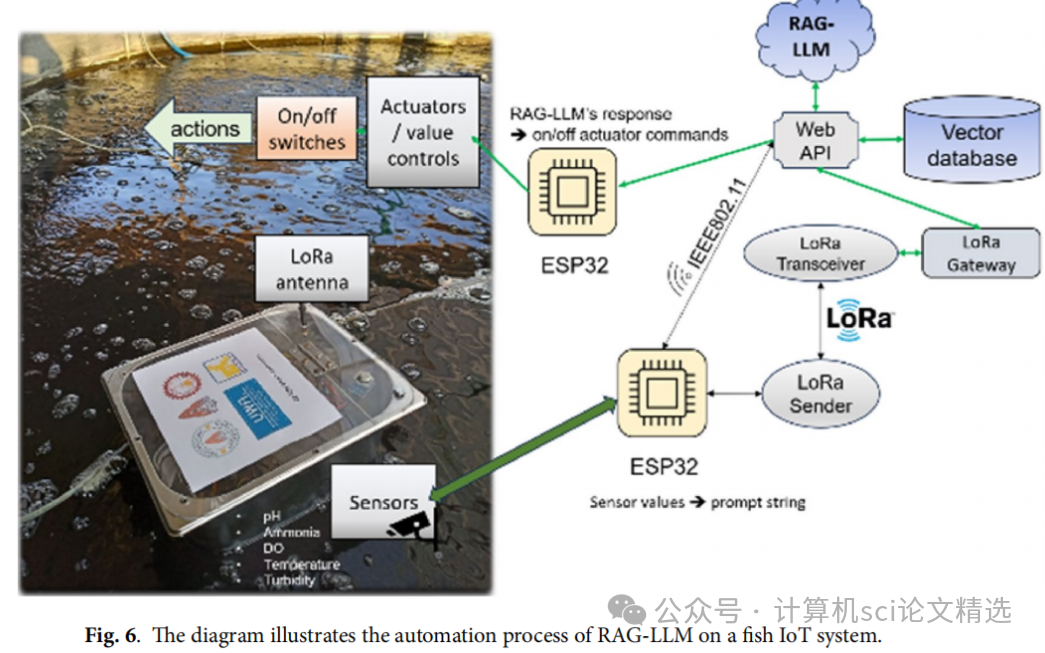

文章首先通过RAG-LLM模块检索专家知识并生成基于实时传感器数据的决策建议,然后利用DQN模块根据环境反馈学习最优策略,最终通过多数投票机制在集成学习框架中选择最有效的控制动作,从而实现对水产养殖环境的自主管理和优化。

创新点:

-

首次将RAG-LLM与DQN集成应用于水产养殖自动化,通过专家知识检索和强化学习优化决策过程,填补了该领域的研究空白。

-

引入基于多数投票的集成学习机制,有效融合了RAG-LLM的知识驱动决策和DQN的反馈驱动优化,显著提高了决策的准确性和稳定性。

-

利用物联网设备实时监测水质参数,并将其转化为模型输入,实现了对水产养殖环境的动态监测和实时控制。

论文链接:

https://www.nature.com/articles/s41598-025-05892-3

图灵学术论文辅导

论文二:A novel LLM time series forecasting method based on integer-decimal decomposition

方法:

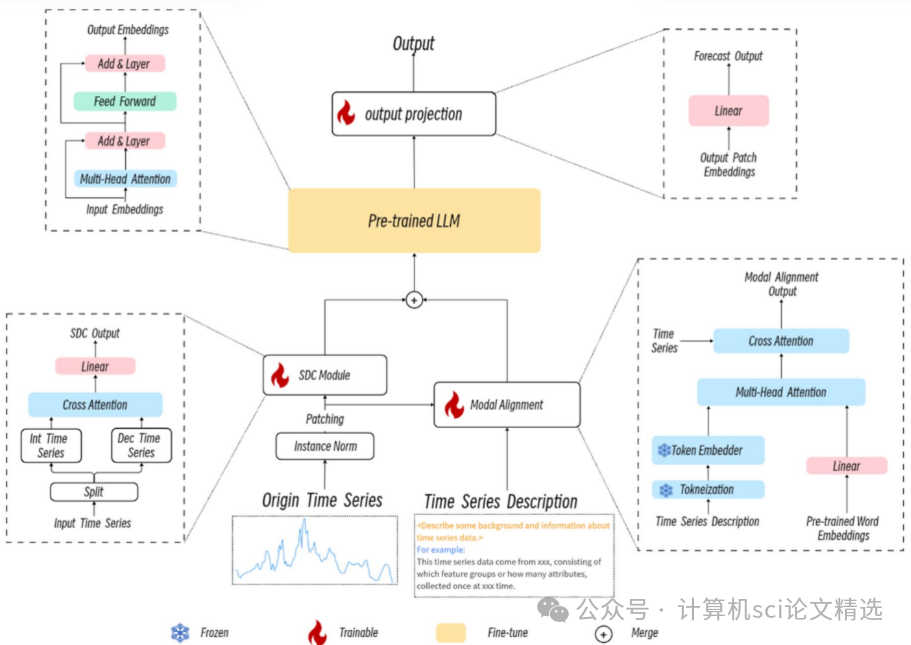

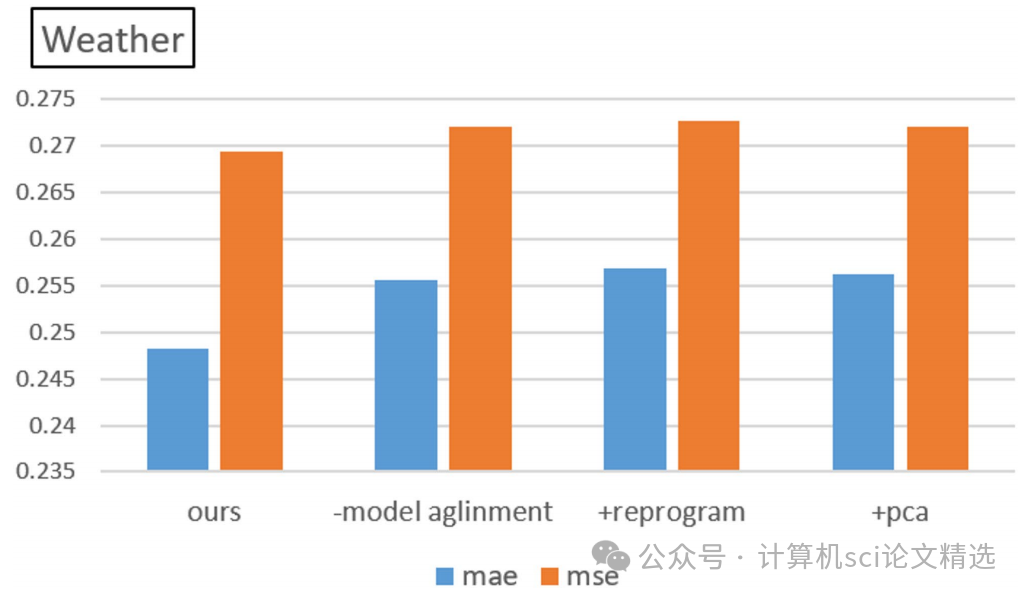

文章首先通过SDC模块将时间序列数据分解为整数和小数部分,以增强模型对时间序列结构的理解。接着,利用双重交叉注意力模块对齐时间序列与文本模态,进一步优化模型对时间序列的处理能力。最后,通过参数高效的微调技术对预训练的大语言模型进行调整,并采用线性变换将模型输出转化为最终的预测结果,从而实现了对时间序列的精准预测。

创新点:

-

提出了整数-小数分解框架,有效解决了传统方法中残差学习的难题,增强了模型对时间序列模式的理解。

-

设计了分裂时间序列数据交叉注意力模块,能够更准确地提取时间序列中的信息,捕捉更细致的时间特征。

-

引入了双重交叉注意力模块,促进了时间序列在大语言模型中的适应性,提高了模型的泛化能力。

论文链接:

https://www.nature.com/articles/s41598-025-06581-x

图灵学术论文辅导

论文三:Optimization for threat classification of various data types-based on ML model and LLM

方法:

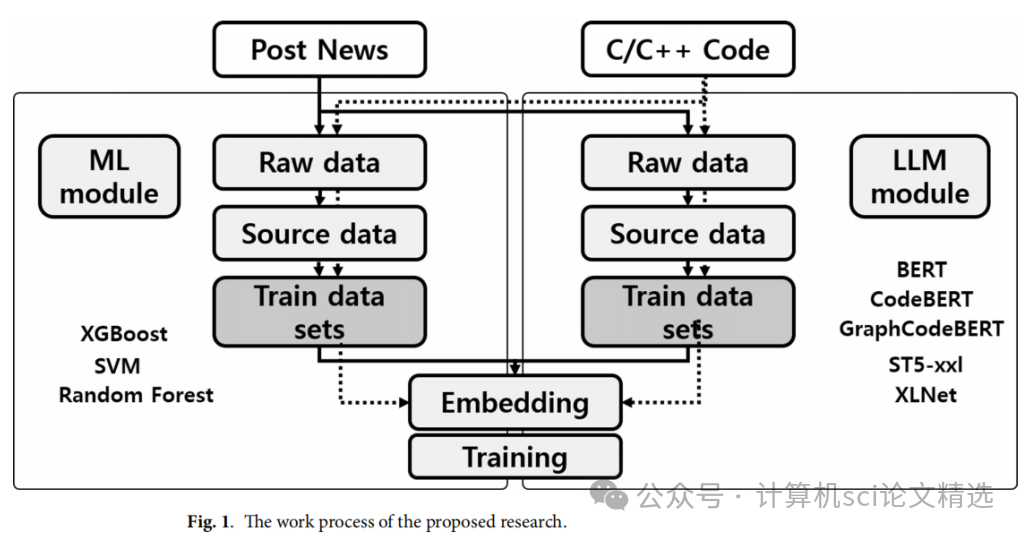

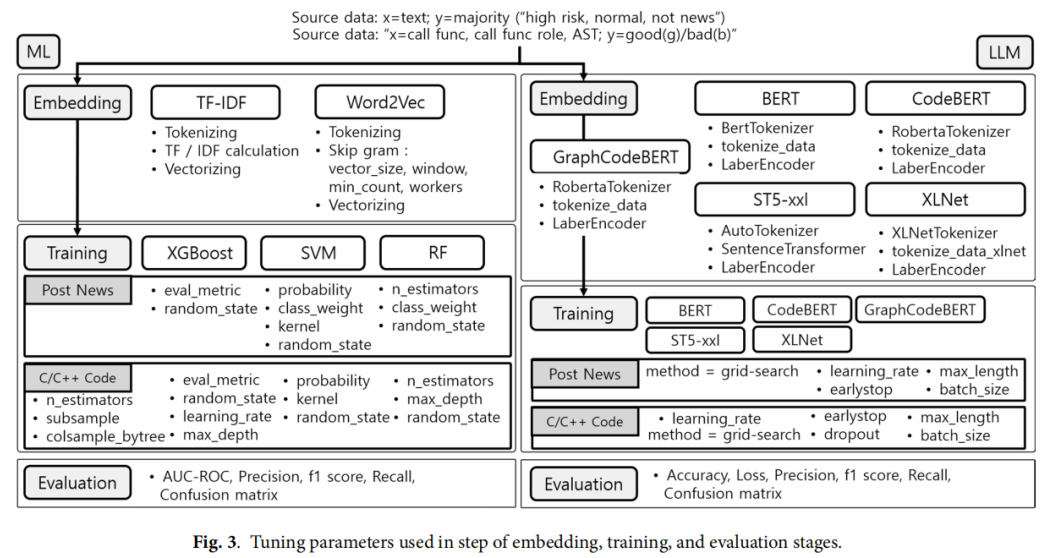

文章首先对Post News数据进行预处理,包括标记化、比例加权、对数缩放和归一化,以解决数据偏差问题;接着对C/C++源代码数据进行语法分析、语义分析和信息流学习,提取结构化特征。然后,根据模型类型选择合适的嵌入方法,ML模型采用TF-IDF和Word2Vec嵌入,LLM模型则使用预训练的BERT、CodeBERT、GraphCodeBERT、ST5-xxl和XLNet等。最后,通过网格搜索和k折交叉验证优化模型参数,实现了对安全威胁的高效检测。

创新点:

-

首次提出了一种集成ML和LLM的混合框架,能够同时分析社交媒体数据和源代码漏洞,填补了以往研究中将两者分开处理的空白。

-

引入了针对Post News数据的偏差优化技术,有效解决了数据不平衡问题,显著提升了模型对少数类别的检测性能。

-

设计了一种结合抽象语法树的源代码漏洞检测方法,通过整合语法分析、语义分析和信息流学习,提高了对复杂漏洞的检测能力,降低了误报率。

论文链接:

https://www.nature.com/articles/s41598-025-05182-y

本文选自gongzhonghao【计算机sci论文精选】