华为云Flexus+DeepSeek征文|云原生时代的AI智能:华为云Dify平台的技术洞察与应用价值:LLM+Bocha如何打造出三体浏览器

前引:人工智能正以前所未有的速度重塑产业格局。作为技术创新的前沿阵地,华为云Dify平台应运而生,为企业级AI应用提供了一个全新的技术生态系统。本文将深入探讨DeepSeek大模型推理服务在实际场景中的落地实践,揭示云原生时代AI技术的革命性价值!

通过对Dify平台的深入解析,我们将展现AI技术从理论走向实践的关键路径,为企业数字化转型提供有价值的技术洞察和实践指南。本文不仅是一次技术探索,更是对未来智能技术发展的前瞻性思考,下面开始探索~

目录

一、大模型推理服务的发展趋势

二、华为云Dify平台的战略定位

三、Dify平台的技术架构与创新

(1)平台核心技术解析

(2)DeepSeek模型的推理机制

(3)云原生架构的优势与特点

四、DeepSeek R1/V3商用服务开通教程

五、商用服务开通体验

(1)开通流程的便捷性

(2)费用透明与灵活性

(3)服务性能与拓展性

七、华为云云服务单机部署教程

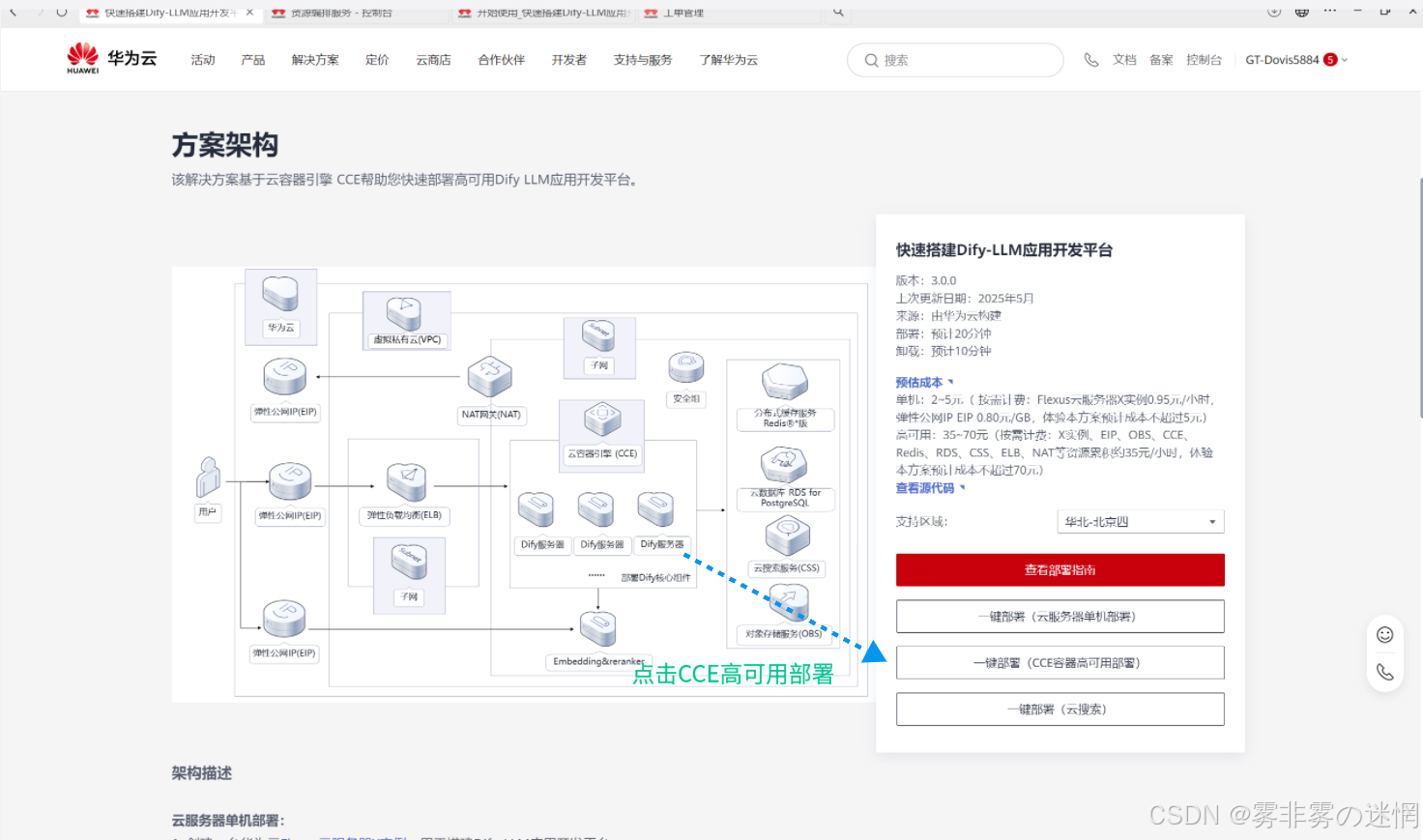

八、CCE高可用部署

(1)准备工作

创建桶:

创建委托:

委托授权:

创建秘钥:

(2)部署实践

九、Dify实践应用:登录

十、添加Maas模型

十一:工作流:LLM+Bocha三体搜索

十二:工作流测试

《731》电影搜索:

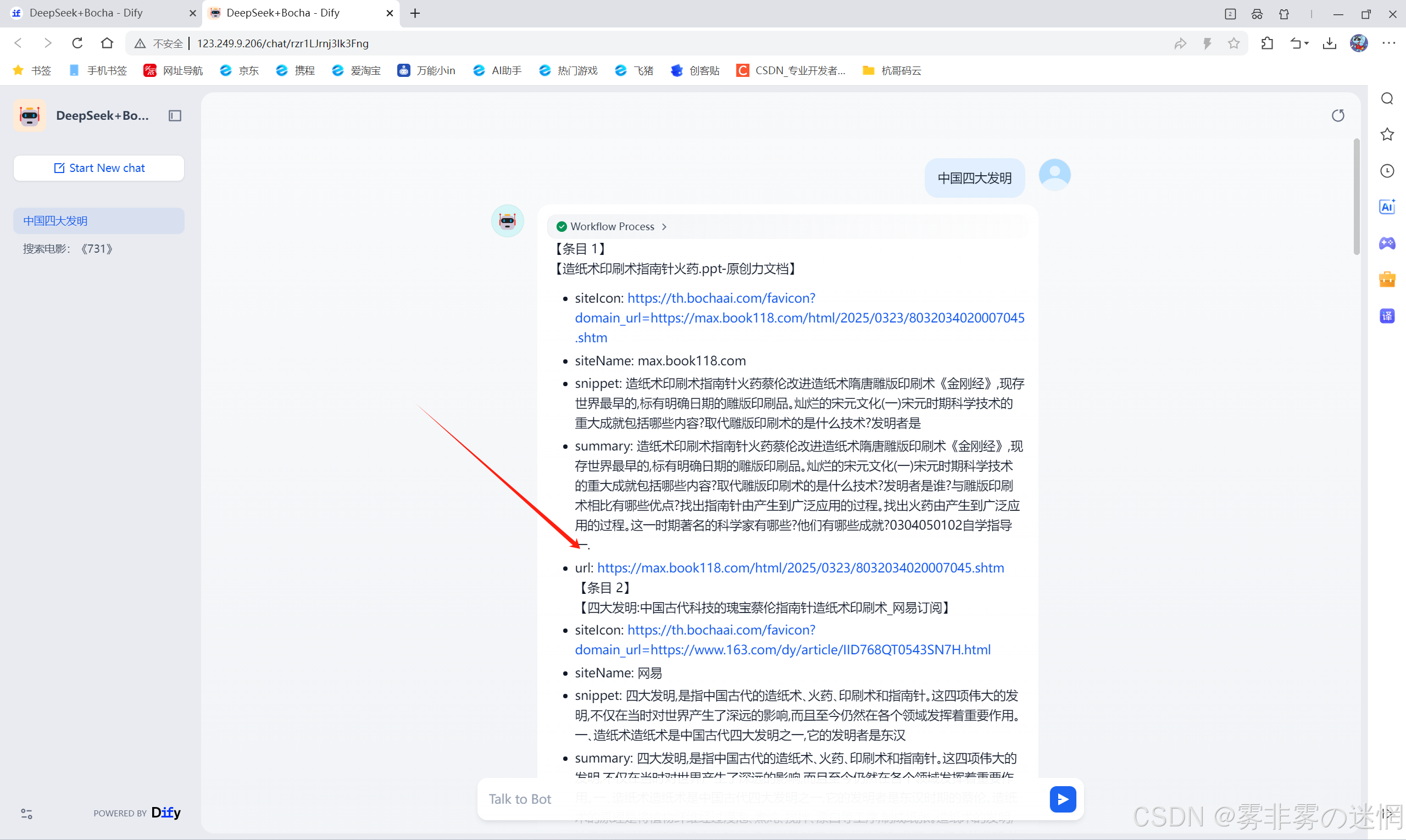

中国四大发明:

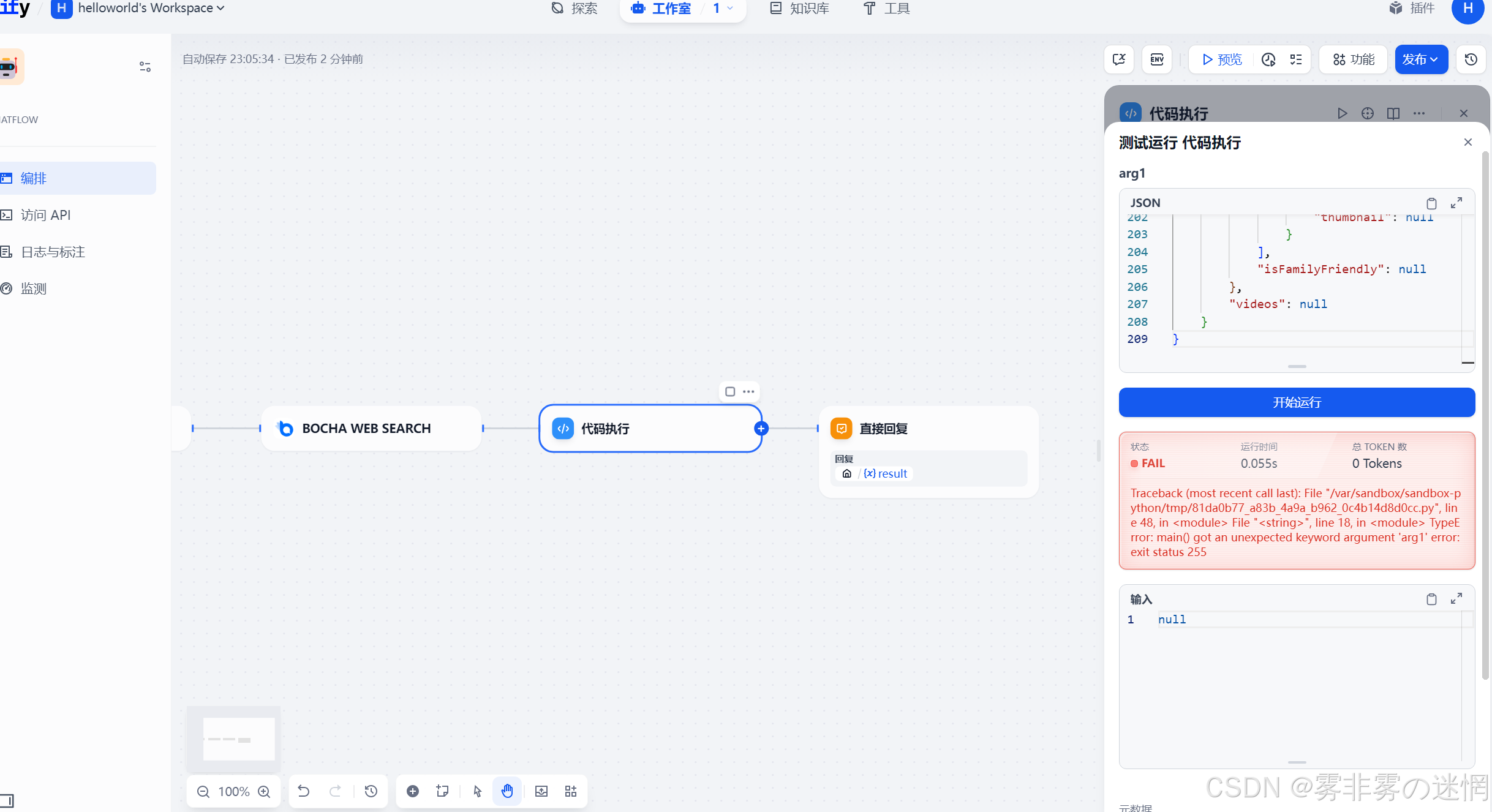

十三:代码运行报错分析

十四、云服务器两种部署方式的心得

(1)云服务单机部署

(2)CCE高可用部署

(3)表格对比

十六、华为云Dify平台的战略价值

一、大模型推理服务的发展趋势

大模型推理服务作为人工智能技术从研究走向实际应用的核心驱动力,正在经历快速的技术迭代和市场扩展。结合华为云Dify平台和ModelArts平台架构,以下是主要发展趋势分析:

高效实时推理:

随着企业对低延迟和高吞吐量的需求增加,大模型推理服务正朝着实时化方向发展。图片中的Dify平台架构显示,其通过负载均衡(LB)和多实例部署优化了推理性能,支持高并发场景,如智能客服和实时推荐系统

多模态集成:

推理服务不再局限于单一文本处理,而是扩展到图像、语音和视频等多模态数据处理。ModelArts平台的架构图表明,其支持多种AI模型的协同工作,为跨模态应用提供了技术基础

云原生架构优化:

云原生技术(如容器化、微服务)在大模型推理中广泛应用。Dify平台利用虚拟私有云(VPC)和对象存储服务(OBS),实现了资源的弹性伸缩和高效调度,显著降低了运维成本

自动化与智能化:

推理服务的自动化优化成为重点,包括模型压缩、量化以及智能调度ModelArts平台强调自动化工具链,帮助开发者从模型训练到推理部署实现全流程高效管理

边缘与云协同:

推理服务逐渐从云端扩展到边缘设备,以满足低延迟和数据隐私需求。华为云的架构设计支持分布式推理,适用于物联网和智能制造等场景

绿色计算:

随着算力需求的激增,节能减排成为行业关注点。大模型推理服务通过优化算法和硬件(如GPU/TPU)利用率,降低能耗

总结:高效实时、多模态集成、云原生优化、自动化调度、边缘云协同和绿色计算是主要方向,旨在满足多样化的企业需求 !

二、华为云Dify平台的战略定位

华为云Dify平台作为企业级AI应用开发的重要工具,其战略定位清晰且具有前瞻性,作为企业级AI开发赋能平台,Dify聚焦中高端市场,依托云原生技术和安全保障,构建开放生态,推动AI应用的快速落地和普惠化,快来看看吧:

核心定位:AI应用开发赋能平台

Dify平台旨在通过集成化的大语言模型(LLM)服务,降低AI应用的开发门槛。图片中的架构图显示,Dify通过用户友好的界面、负载均衡和存储服务,为开发者提供一站式解决方案,覆盖从模型部署到应用上线的全生命周期

市场目标:中高端企业市场

Dify平台面向需要高性能计算和复杂AI应用的企业客户,如金融、制造和零售行业。其模块化架构和多可用区部署能力,满足企业对高可用性和弹性的需求,特别适合大规模、分布式AI应用场景

技术优势:云原生与安全性结合

平台依托华为云的云原生技术(如VPC、LB、OBS),实现高效资源管理和弹性扩展。同时,Dify通过网络隔离和安全组配置,保障数据隐私和应用安全,满足企业级合规要求

生态战略:开放与协作

Dify平台不仅提供技术工具,还致力于构建开放的AI生态系统。ModelArts平台的架构图表明,华为云通过支持多种模型和硬件架构,吸引开发者社区和第三方服务商,增强平台竞争力

未来愿景:推动AI普惠化

Dify平台的战略目标是通过简化AI开发流程,让更多企业和开发者能够快速构建智能化应用。其“一键部署”和自动化工具设计,显著降低了技术壁垒,助力AI技术在各行业的广泛落地

三、Dify平台的技术架构与创新

(1)平台核心技术解析

集成化AI开发工具:

ModelArts Studio提供了一站式AI开发环境,覆盖数据处理、模型训练、推理部署等全生命周期。平台通过直观的UI设计和模块化功能(如数据预处理、模型优化等),降低了开发门槛。Dify平台进一步强化了“一键部署”功能,支持快速构建企业级AI应用,特别适合需要快速上线的场景

高效模型管理与优化:

平台集成了多种AI模型支持,包括DeepSeek大模型。平台通过数学建模和算法优化,提升了模型训练和推理的效率。这种优化特别体现在对复杂数据集的处理能力上,能够显著减少计算资源消耗

多模态与生态协同:

平台支持文本、图像等多模态数据处理,架构中的Embedding & Re-ranker模块表明,平台能够处理多维数据并优化搜索与推荐场景。开放的生态系统支持与第三方工具和服务的无缝集成,增强了平台的应用广度

安全性与合规性:

通过虚拟私有云(VPC)、网络隔离和安全组配置,平台确保了数据安全和应用合规性,满足企业级客户对隐私保护的需求

(2)DeepSeek模型的推理机制

DeepSeek作为华为云平台支持的核心大模型之一,其推理机制在性能和效率上具有显著优势,以下是具体分析:

全程数学指导体:

DeepSeek采用“全程数学指导体”技术,通过数学建模对输入数据进行结构化处理。这种机制通过优化模型的计算路径,减少推理过程中的误差,提高预测准确性。特别是在复杂场景(如金融风控、实时推荐)中,DeepSeek能够快速解析高维数据并生成可靠结果

高效推理优化:

DeepSeek模型在推理阶段通过模型压缩、量化和分布式计算技术,显著降低了计算延迟。架构图中的负载均衡(LB)和多实例部署机制表明,DeepSeek支持高并发推理,能够应对大规模用户请求

动态资源调度:

DeepSeek利用云原生架构的动态调度能力,根据推理任务的负载需求自动分配计算资源。这种机制确保了推理过程在高负载场景下的稳定性,同时优化了资源利用率

实时性与准确性平衡:

DeepSeek通过算法优化(如梯度剪裁、混合精度计算)在实时性和准确性之间找到平衡。性能提升表明,DeepSeek在推理速度和结果质量上均有显著改进,适用于需要低延迟的场景,如智能客服和自动驾驶

(3)云原生架构的优势与特点

华为云的云原生架构是平台高效性和灵活性的基石,结合图片中的架构图,以下是其主要优势与特点:

高可扩展性与弹性伸缩:

架构图显示,平台通过容器化技术(如Kubernetes)和微服务架构实现资源的高效调度。负载均衡(LB)和对象存储服务(OBS)支持动态扩展,能够根据业务负载自动调整计算资源,适应流量高峰和低谷

分布式部署与高可用性:

平台支持多可用区部署,架构图中的NAT和云管理平台模块表明,系统能够将服务实例分布到不同数据中心,降低单点故障风险,确保服务连续性

自动化运维与快速部署:

云原生架构通过自动化工具链(如CI/CD管道)简化了AI应用的开发与部署流程。“快速搭建Dify-LLM应用开发平台”表明,平台可以在短时间内完成从环境配置到应用上线的全过程,显著提高了开发效率

成本优化与绿色计算:

云原生架构通过动态资源分配和按需计费机制,降低企业运营成本。同时,平台通过优化硬件利用率(如GPU/TPU调度),减少能耗,符合绿色计算趋势

开放生态与模块化设计:

架构中的模块化设计(如Embedding & Re-ranker、云管理平台)表明,平台支持灵活的功能组合,开发者可以根据需求选择特定模块,增强了平台的定制化能力。此外,开放的API和生态支持便于与第三方工具集成

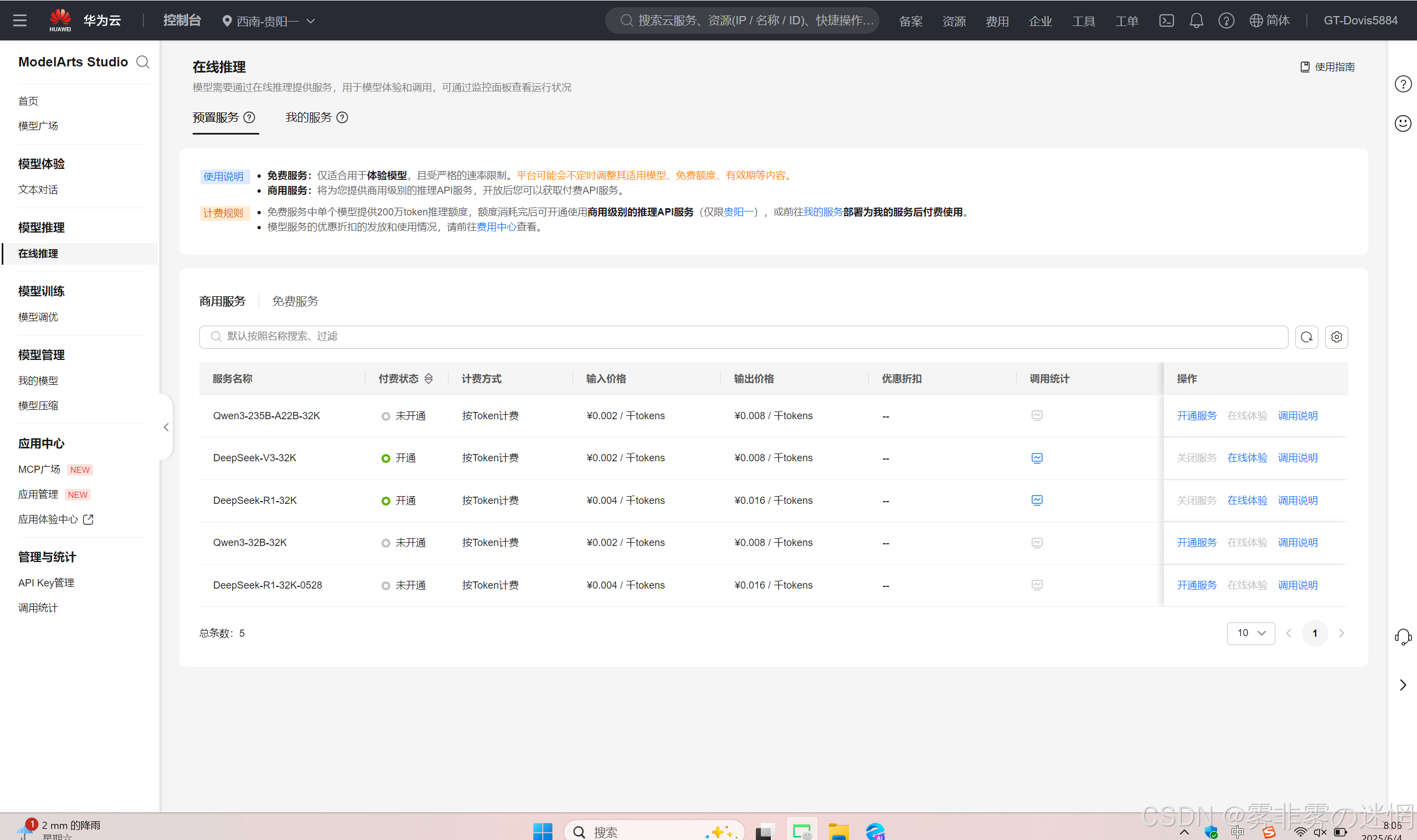

四、DeepSeek R1/V3商用服务开通教程

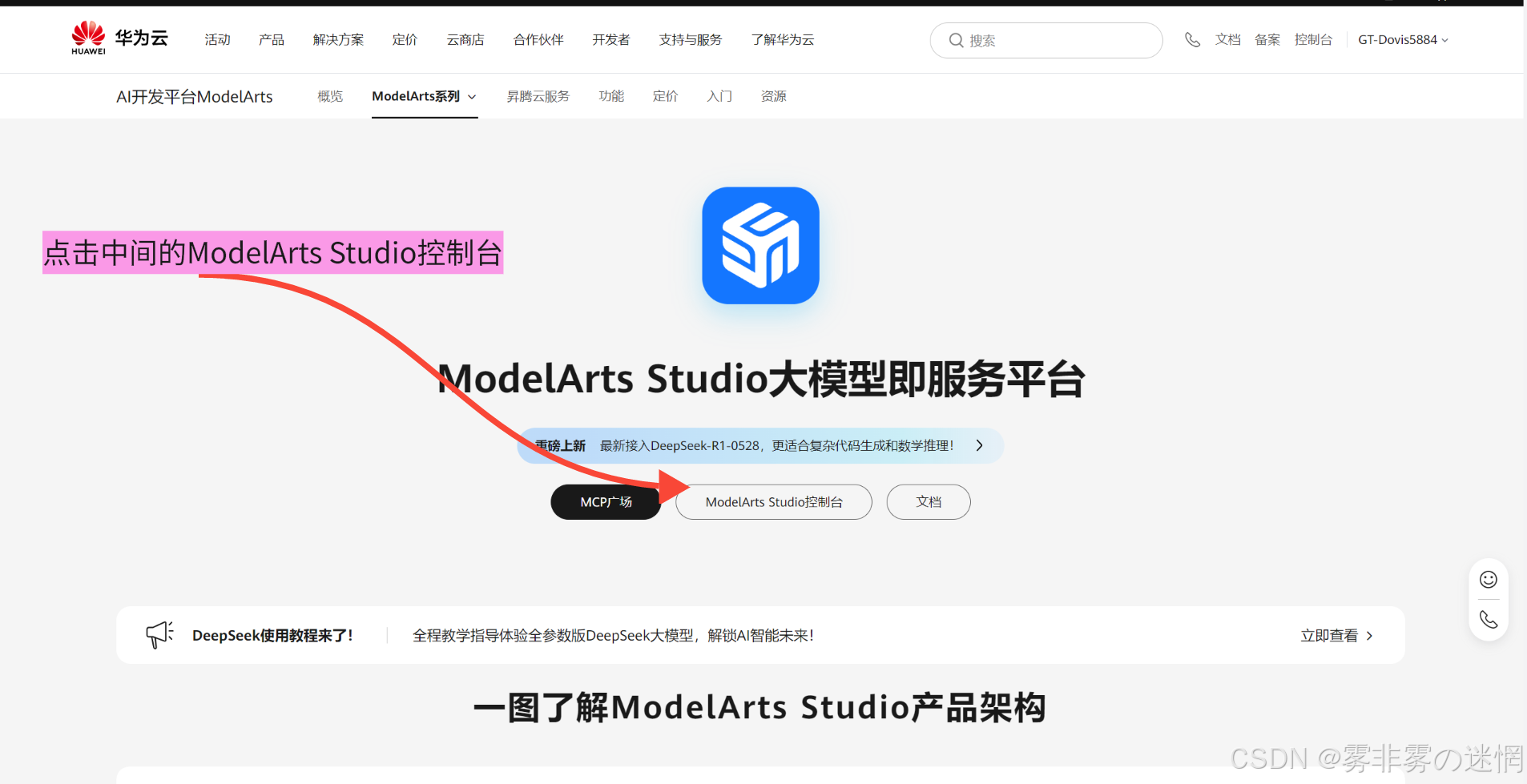

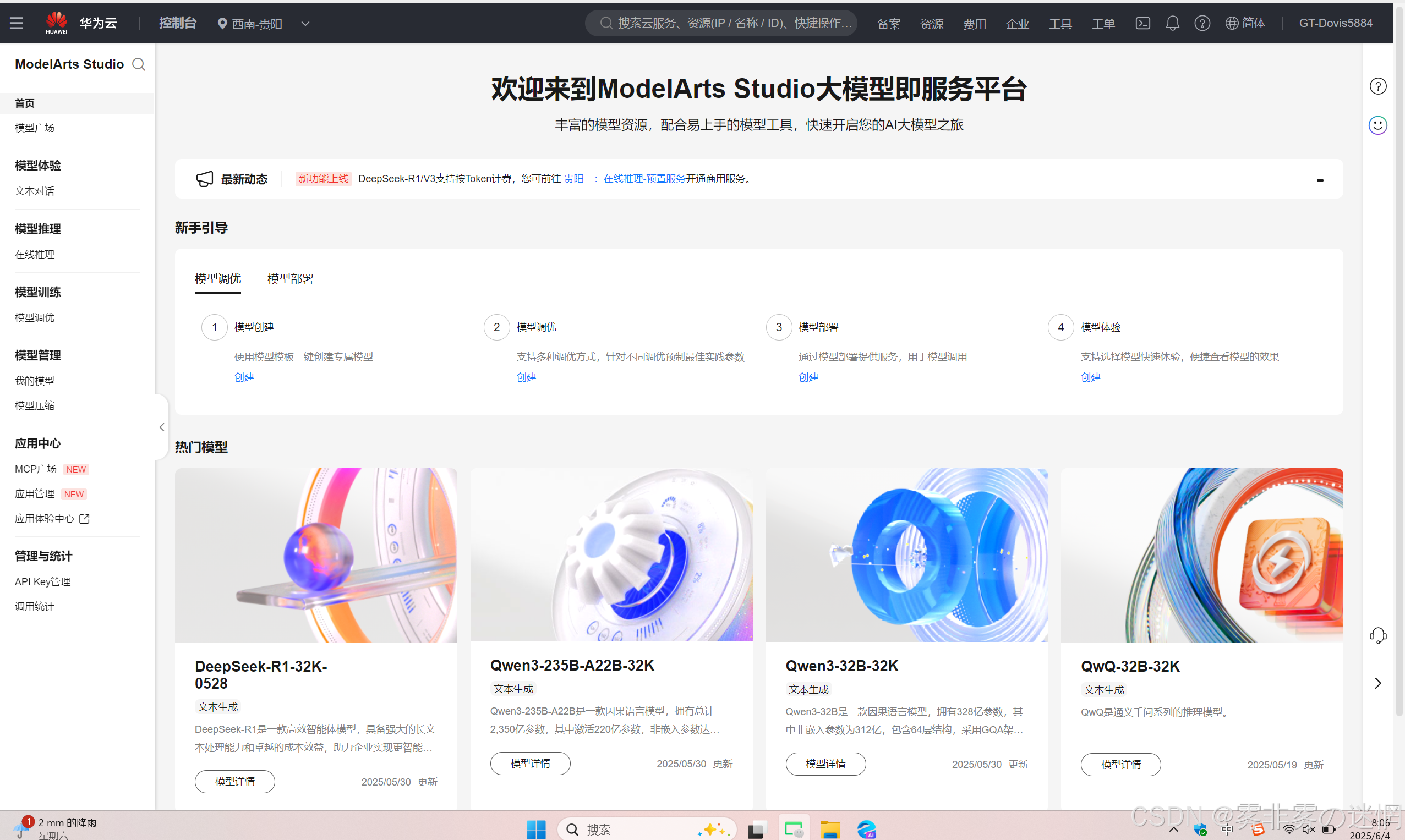

(1)先完成华为云的登录,点击ModelArts Studio控制台

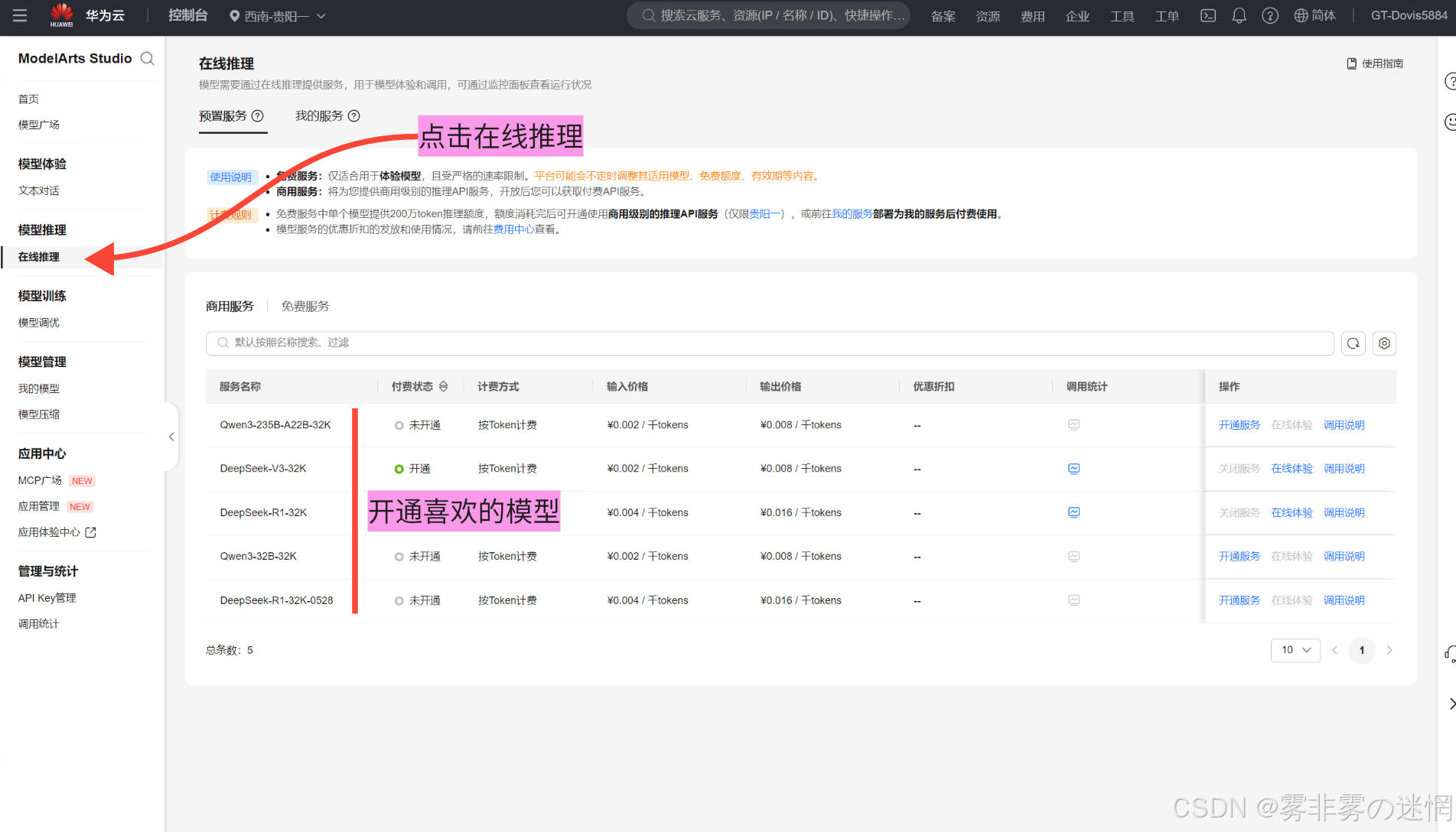

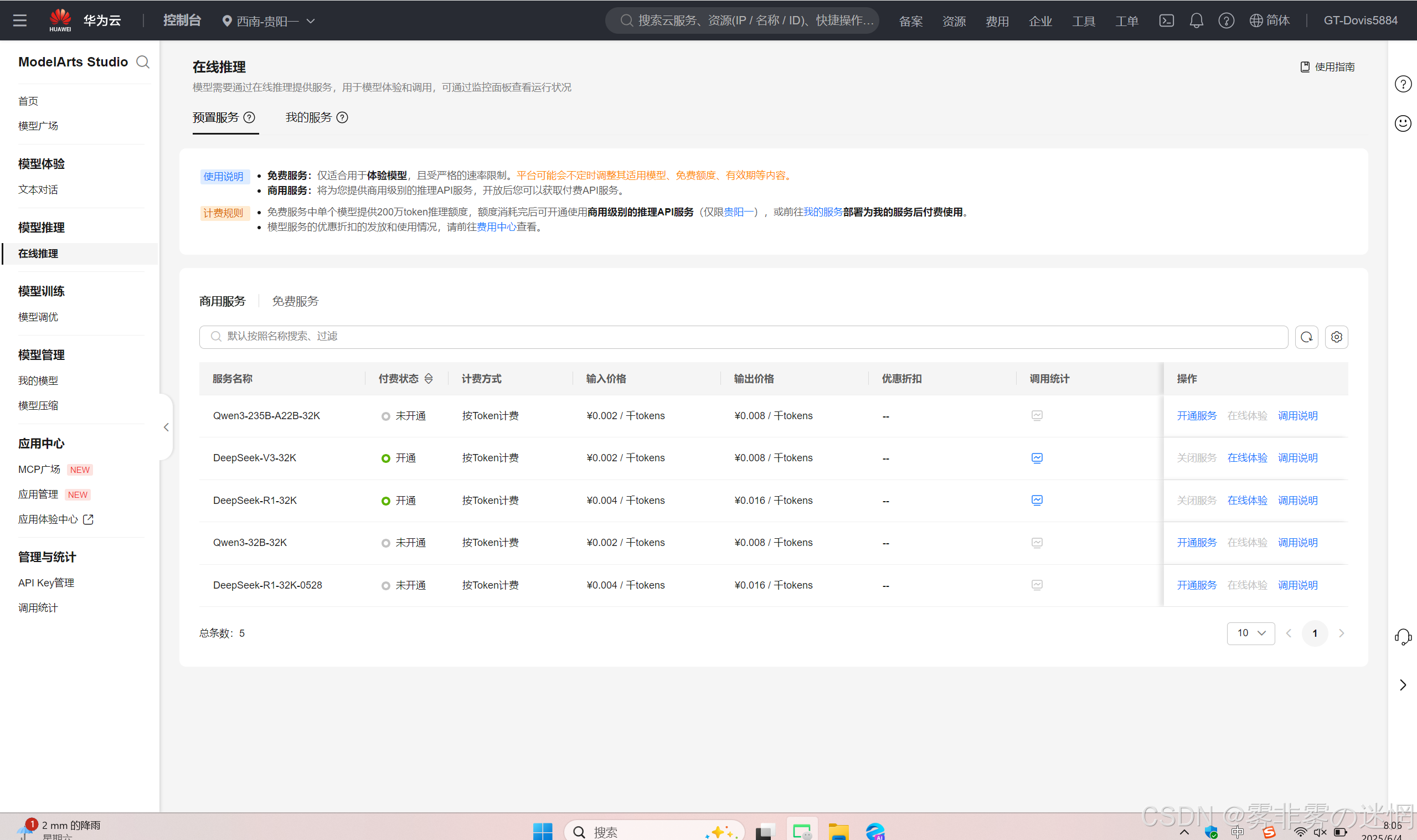

(2)再点击在线推理,开通喜欢的模型

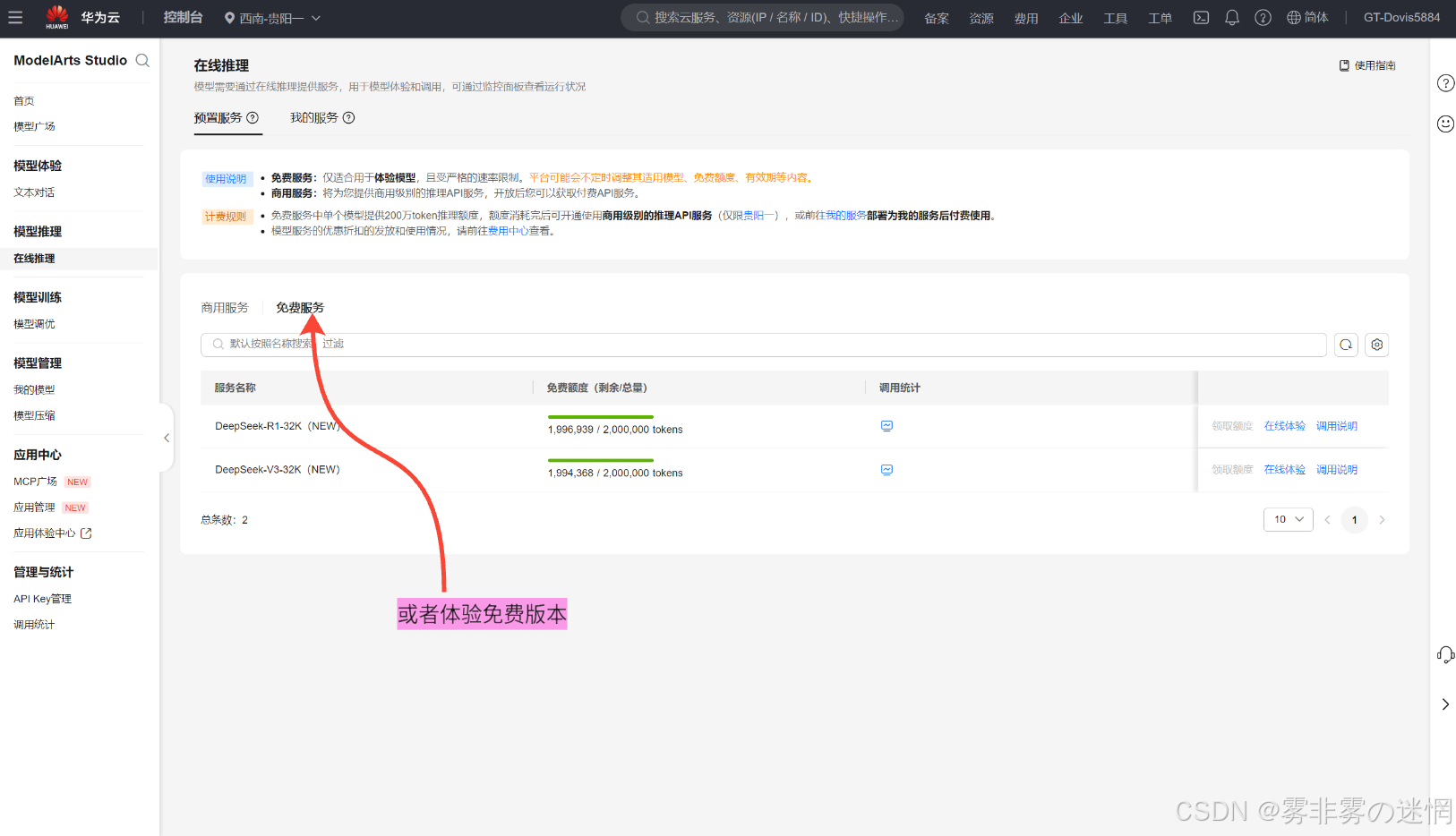

(3)也可以切换为免费的开始体验

五、商用服务开通体验

(1)开通流程的便捷性

过ModelArts Studio控制台,我仅需几步即可完成服务的开通。页面清晰列出了DeepSeek R1-32K、DeepSeek-V3-32K等服务的状态和操作选项,如“开通服务”或“调优说明”。界面简洁明了,即使是初次使用的开发者也能快速上手。开通后,系统自动分配计算资源,并支持按需调整,极大地提升了开发效率!

(2)费用透明与灵活性

DeepSeek服务的计费方式基于Token,输入和输出价格均在控制台明确展示。这种按需计费模式不仅便于预算控制,还能根据实际使用量优化成本。例如,DeepSeek-V3-32K适合高性能推理场景,而R1-32K则更适合大规模训练需求,满足了不同场景的灵活配置!

(3)服务性能与拓展性

DeepSeek R1和V3在推理和训练任务中表现出色,特别是在处理高并发请求时,平台通过动态资源调度确保了服务的稳定性。ModelArts Studio支持多模态数据处理和模型调优,为企业级AI应用提供了强大的技术支撑!

服务名称 计费方式 输入价格(¥/千Tokens) 输出价格(¥/千Tokens) 适用场景 DeepSeek-R1-32K 按Token计费 0.002 0.008 大规模模型训练、数据分析 DeepSeek-V3-32K 按Token计费 0.004 0.016 高性能推理、实时推荐系统 DeepSeek-R1-0528 按Token计费 0.002 0.008 定制化AI应用开发

七、华为云云服务单机部署教程

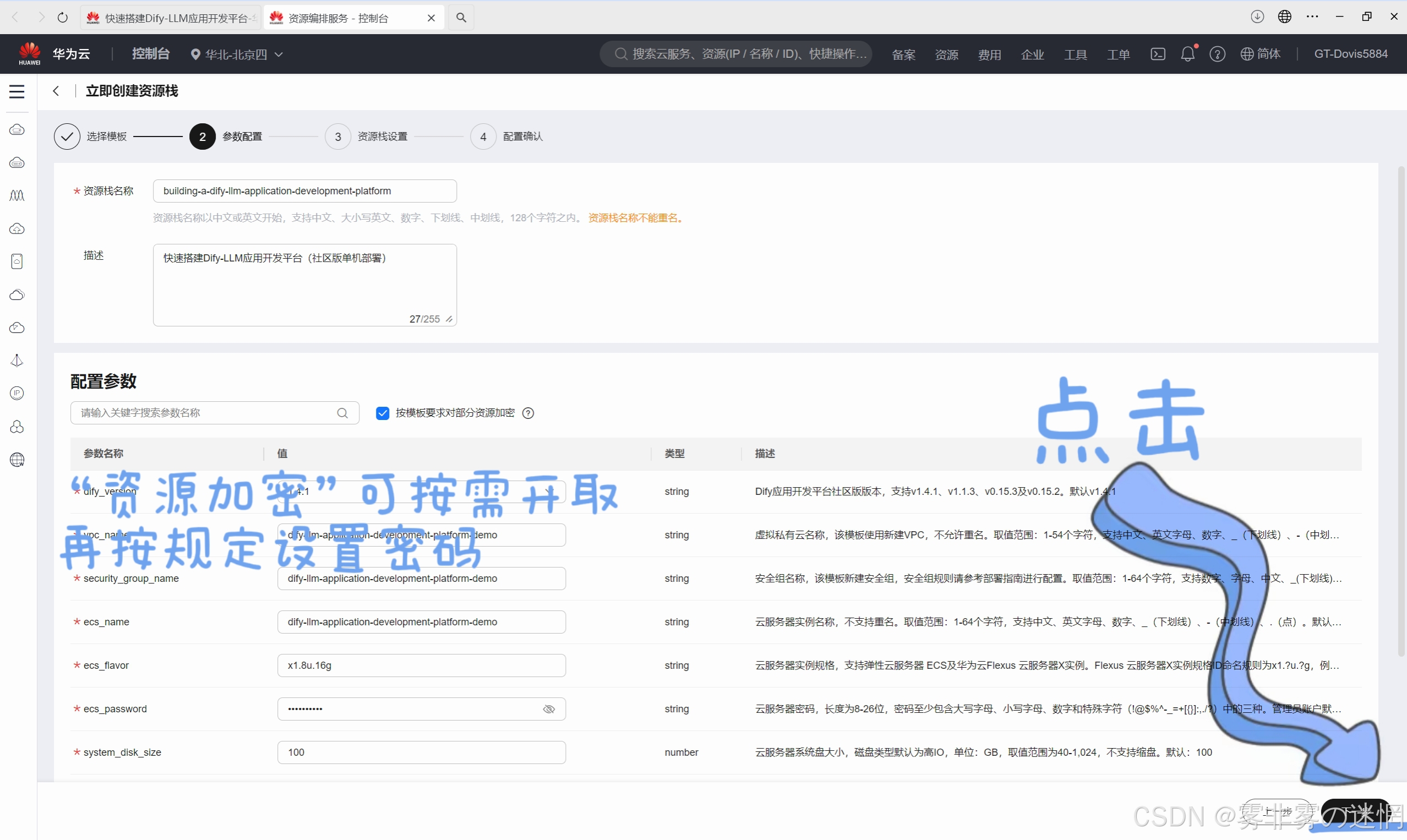

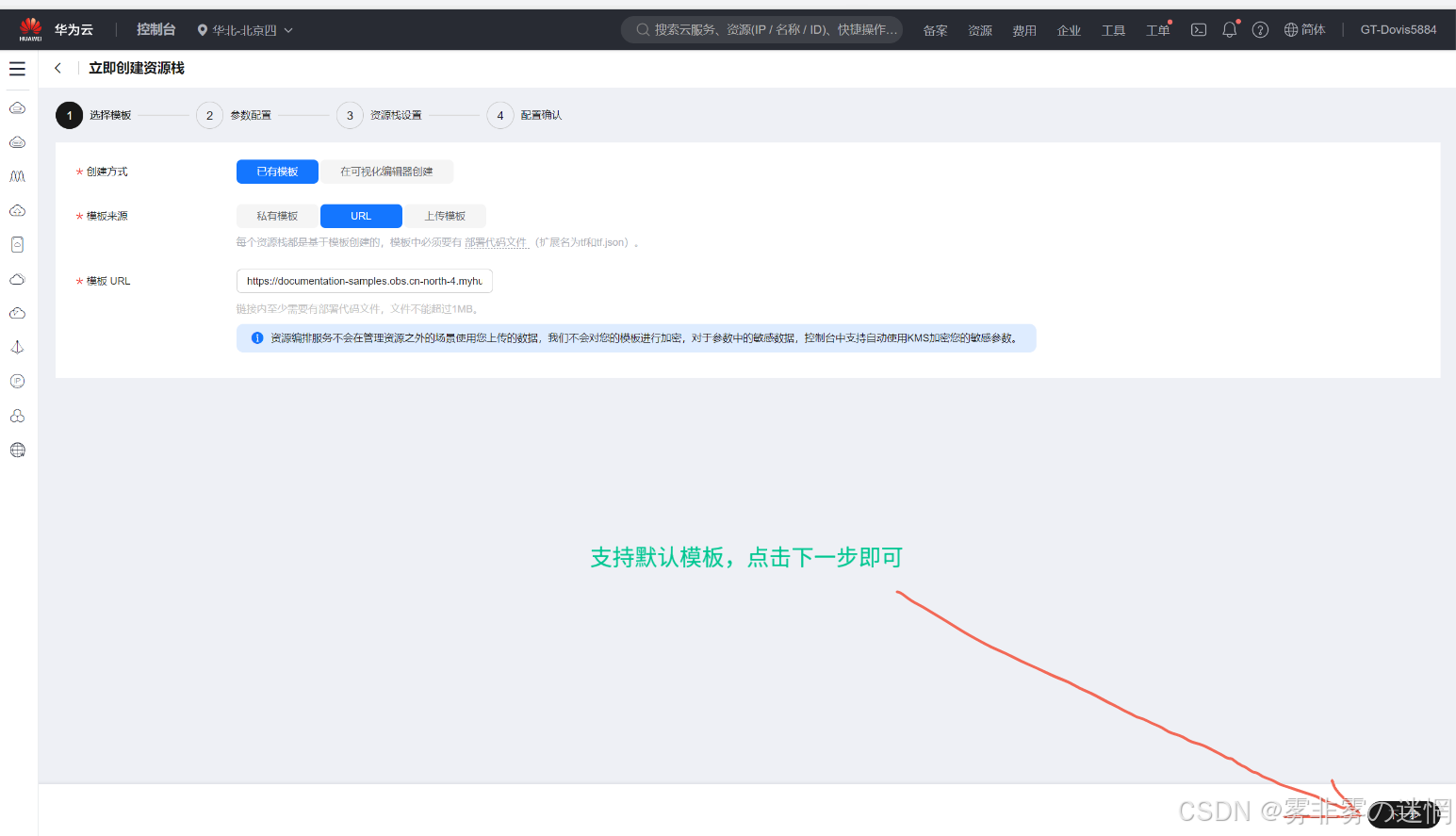

(1)点击单机版开始部署

(2)支持默认模板,可以选择下一步

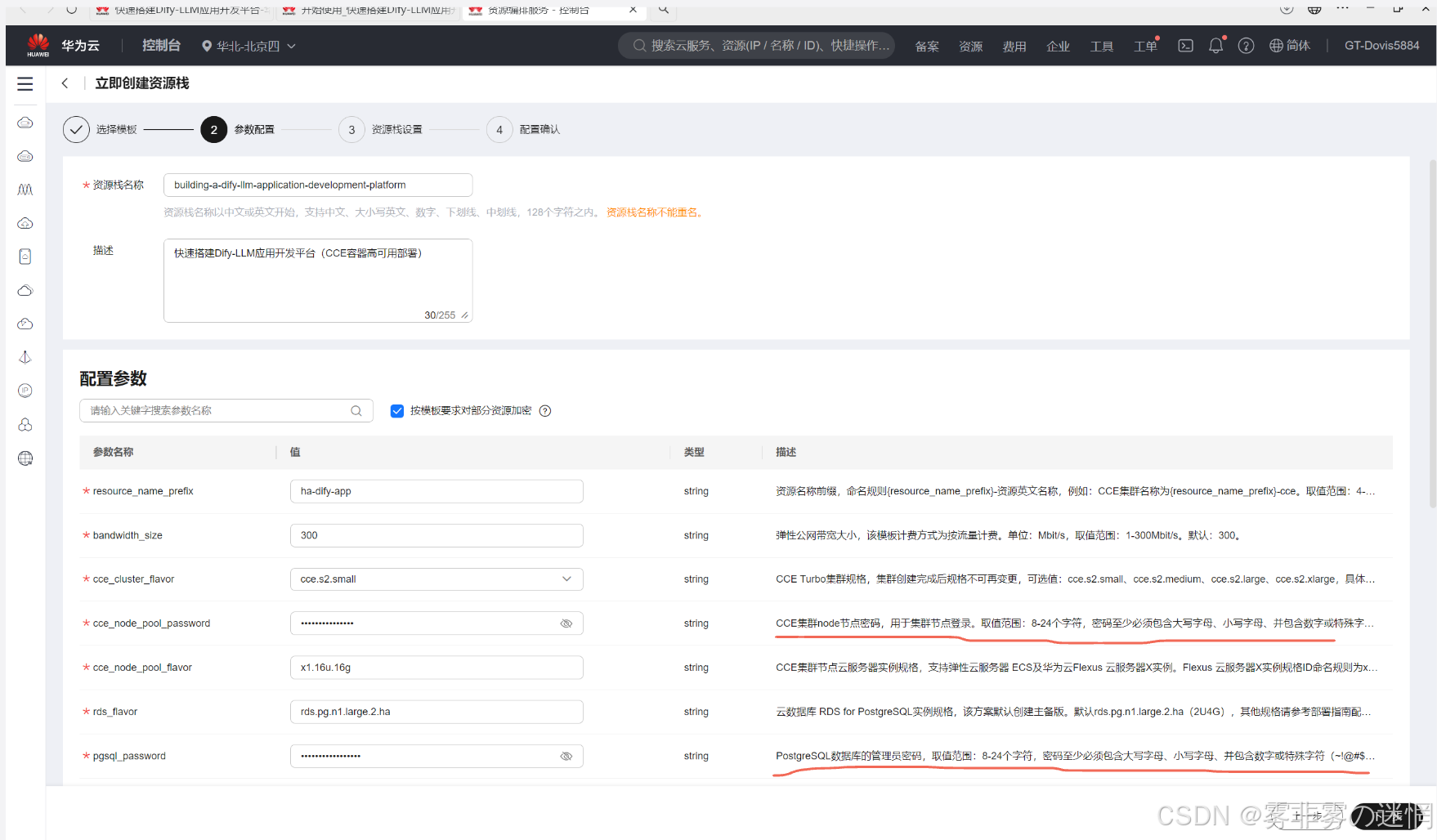

(3)加密、版本都可以自选,但是要注意密码的格式是否正确即可哦!

(4)回滚可以打开,避免失败重新开始,删除可以不用开(自选)

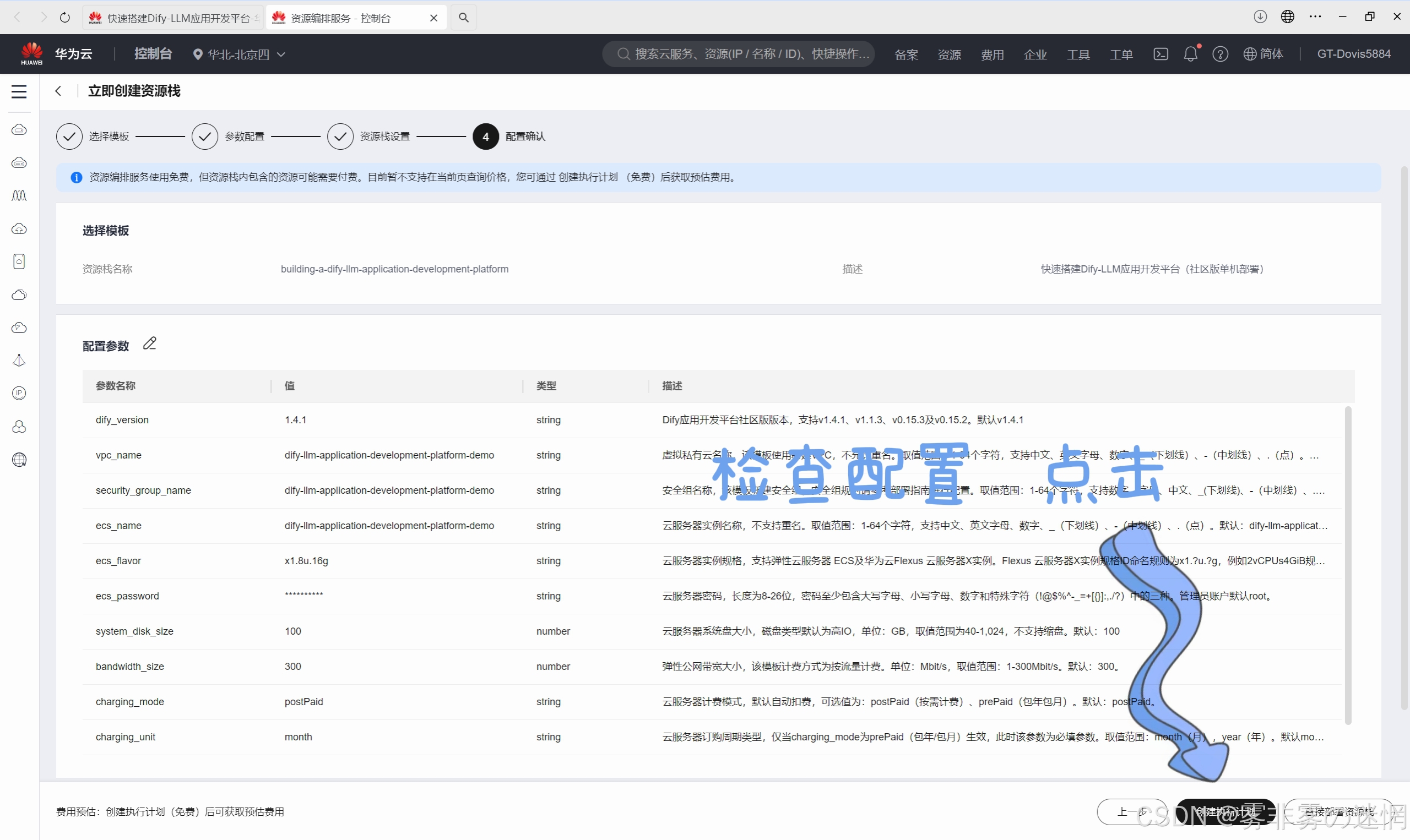

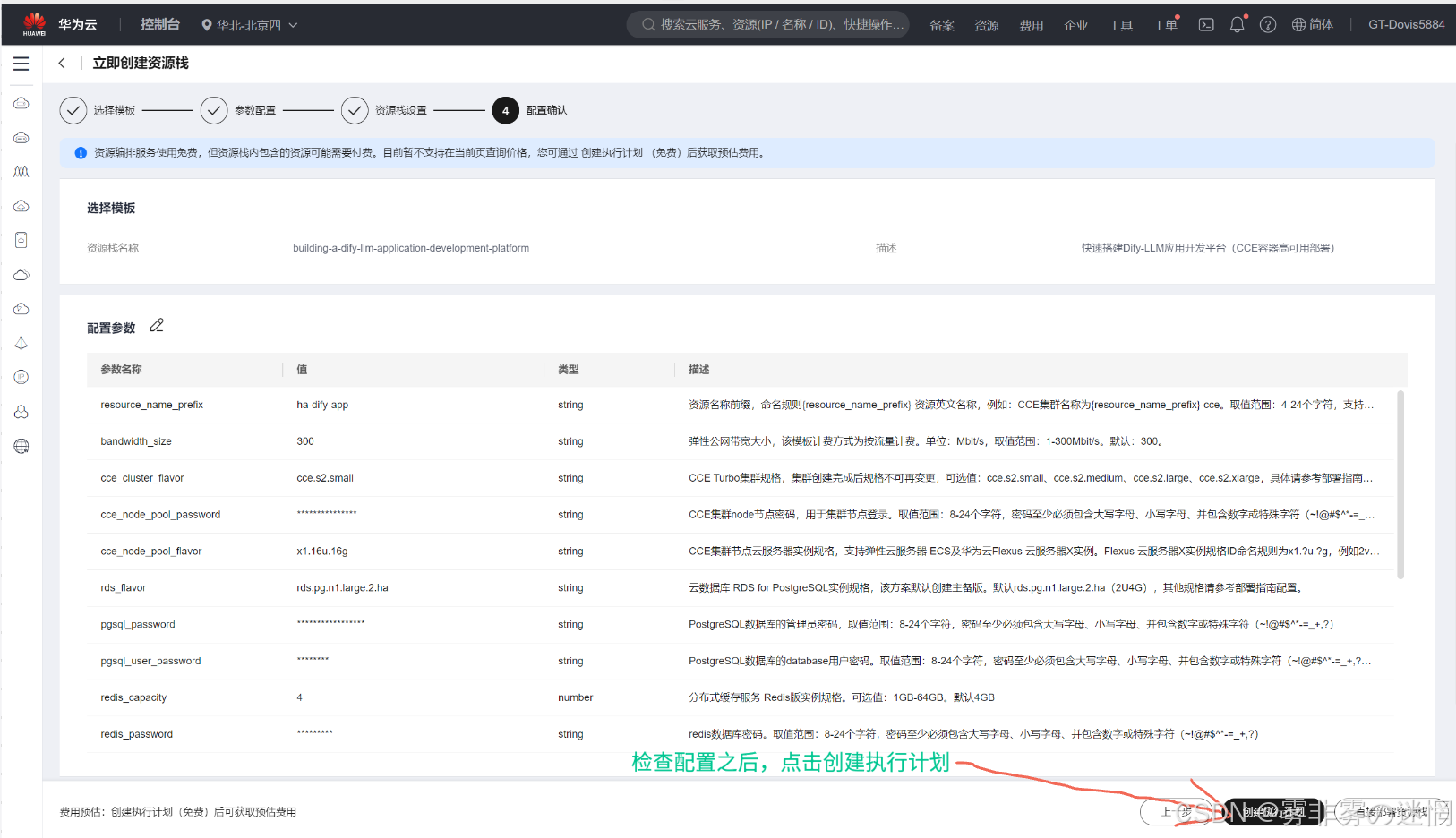

(6)检查配置,点击创建执行计划

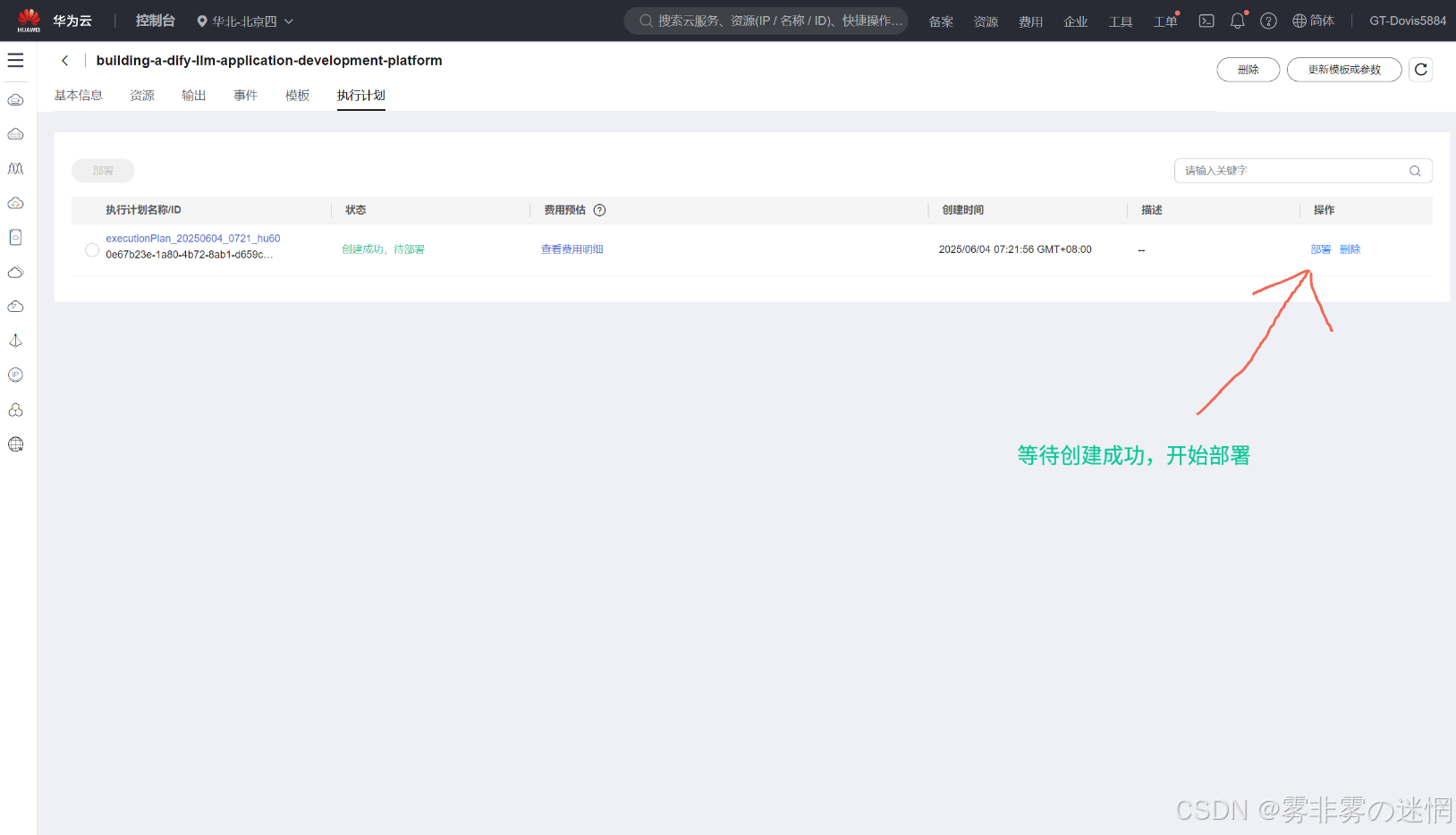

(7)待创建成功,开始部署,执行计划

(8)待10分钟左右,会显示部署完成,在“输出”可以查看IP

八、CCE高可用部署

(1)准备工作

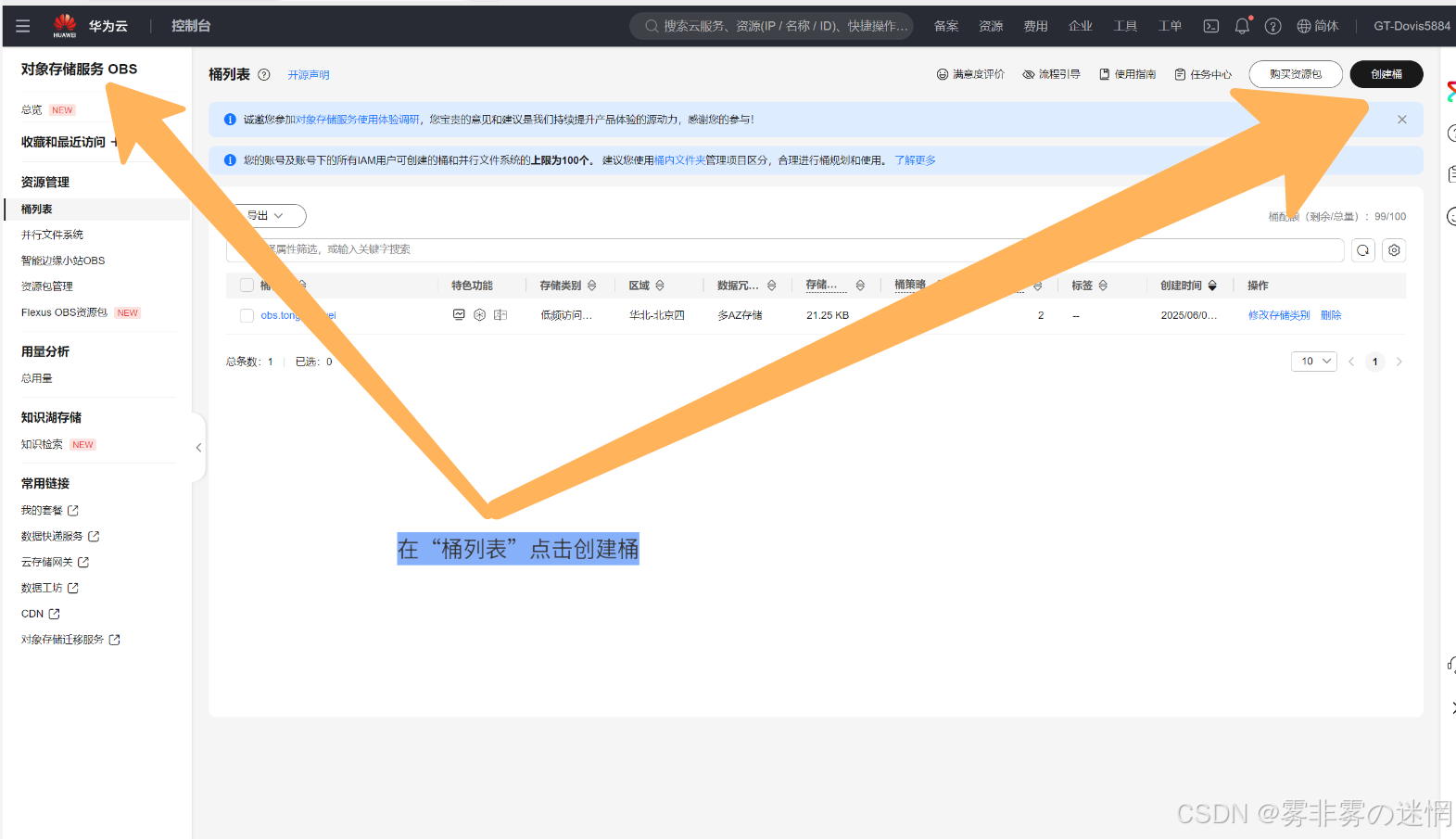

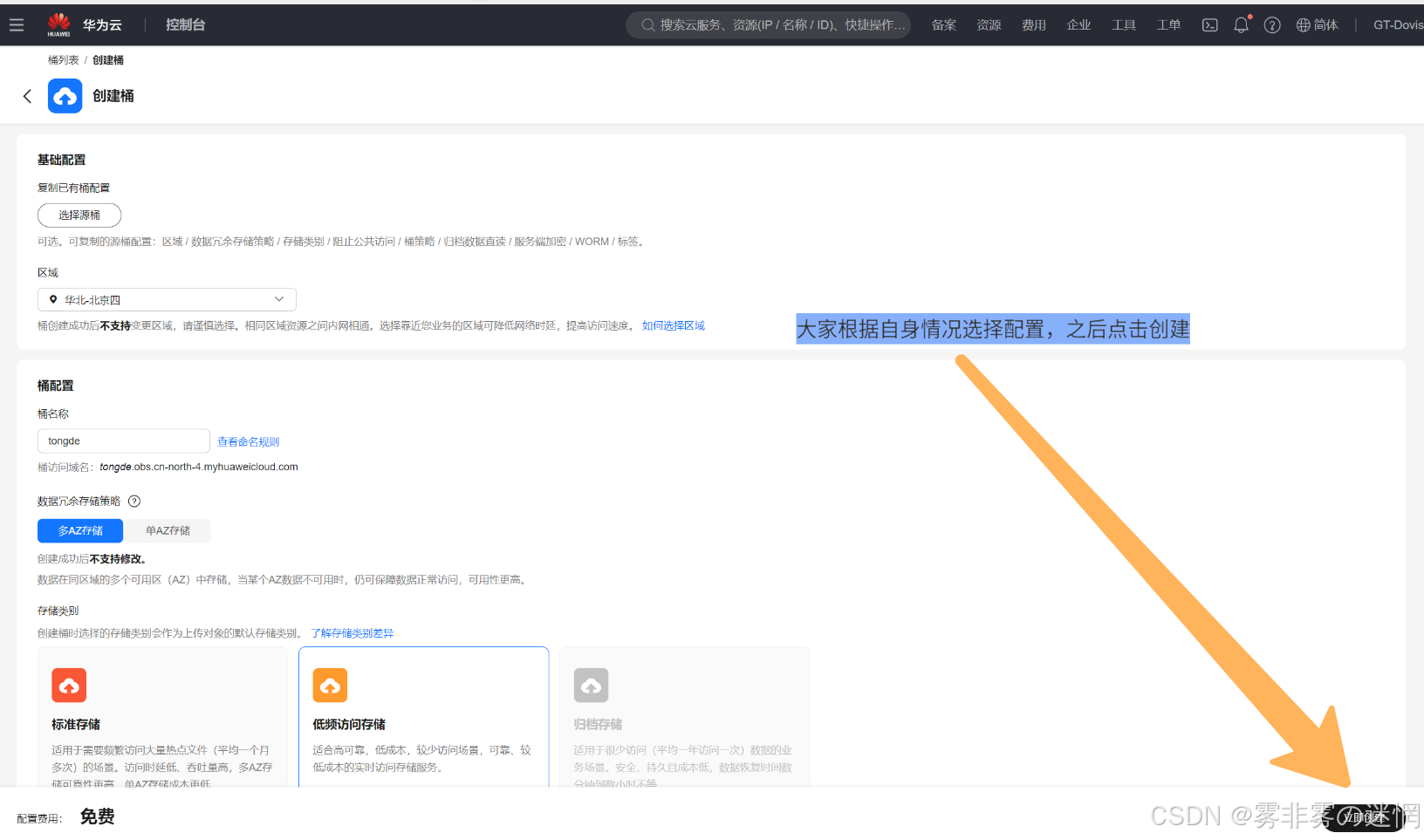

创建桶:

(1)搜索“桶列表”即可,点击创建

(2)桶的配置可以选择低频,减少费用

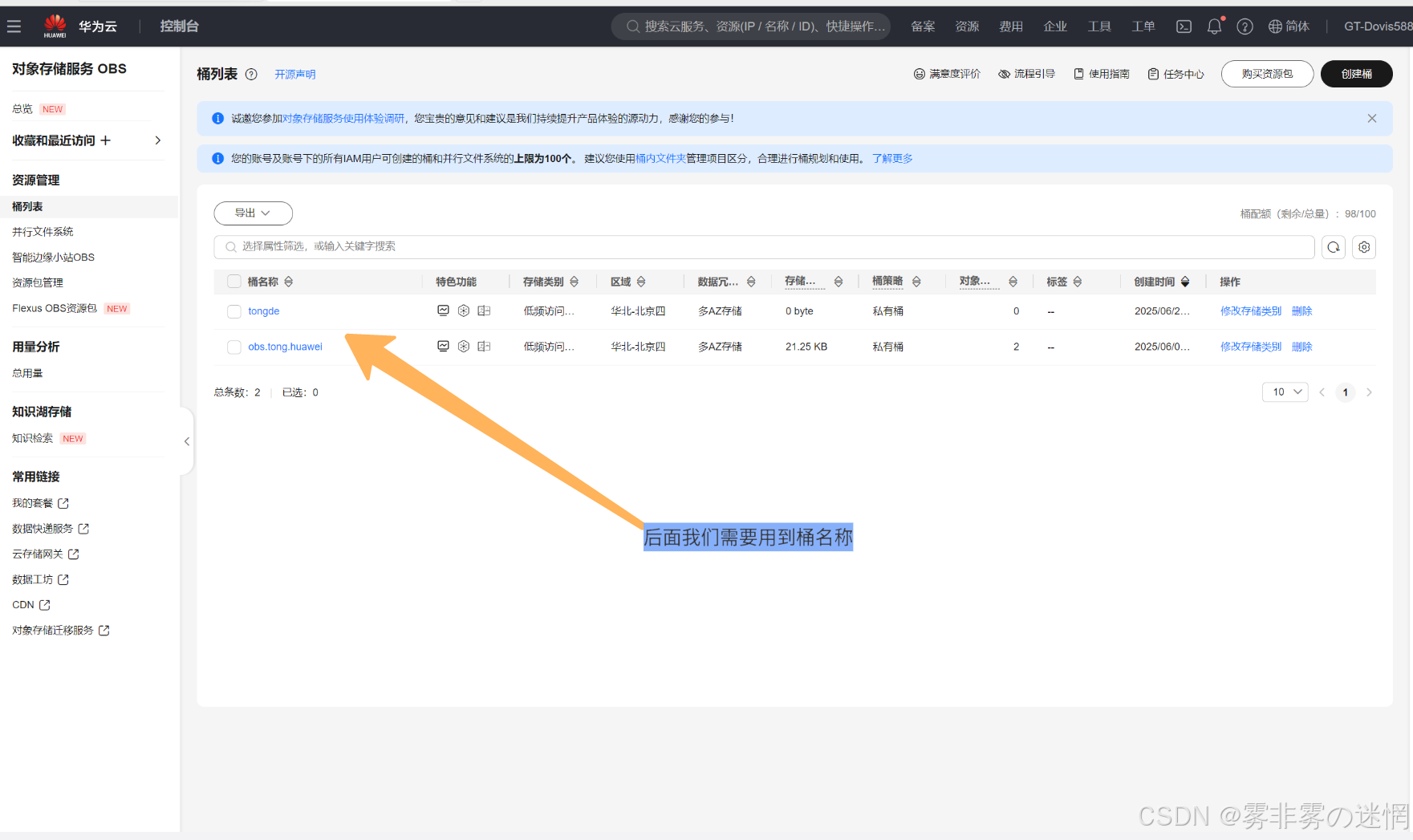

(3)我们后面需要用到桶名称

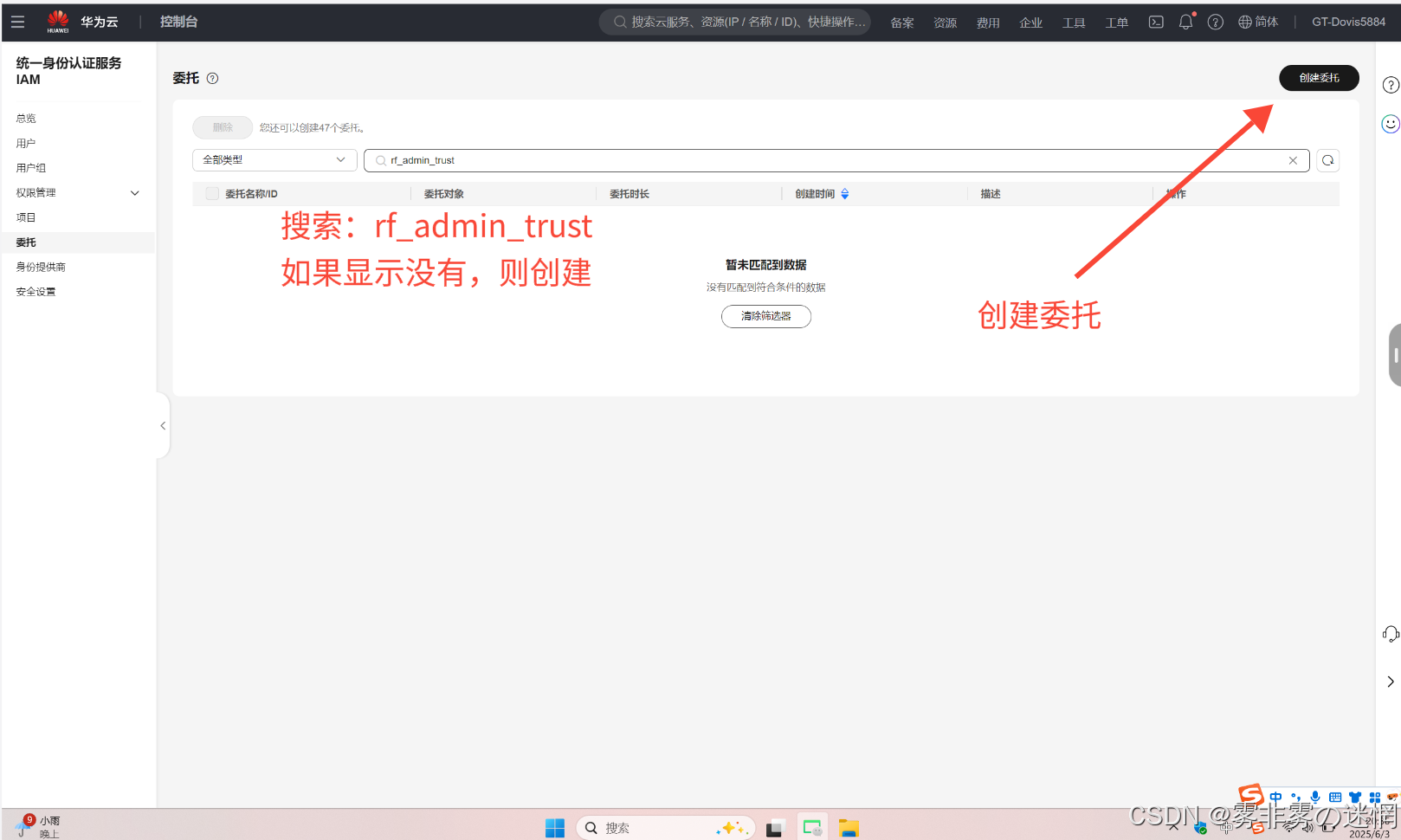

创建委托:

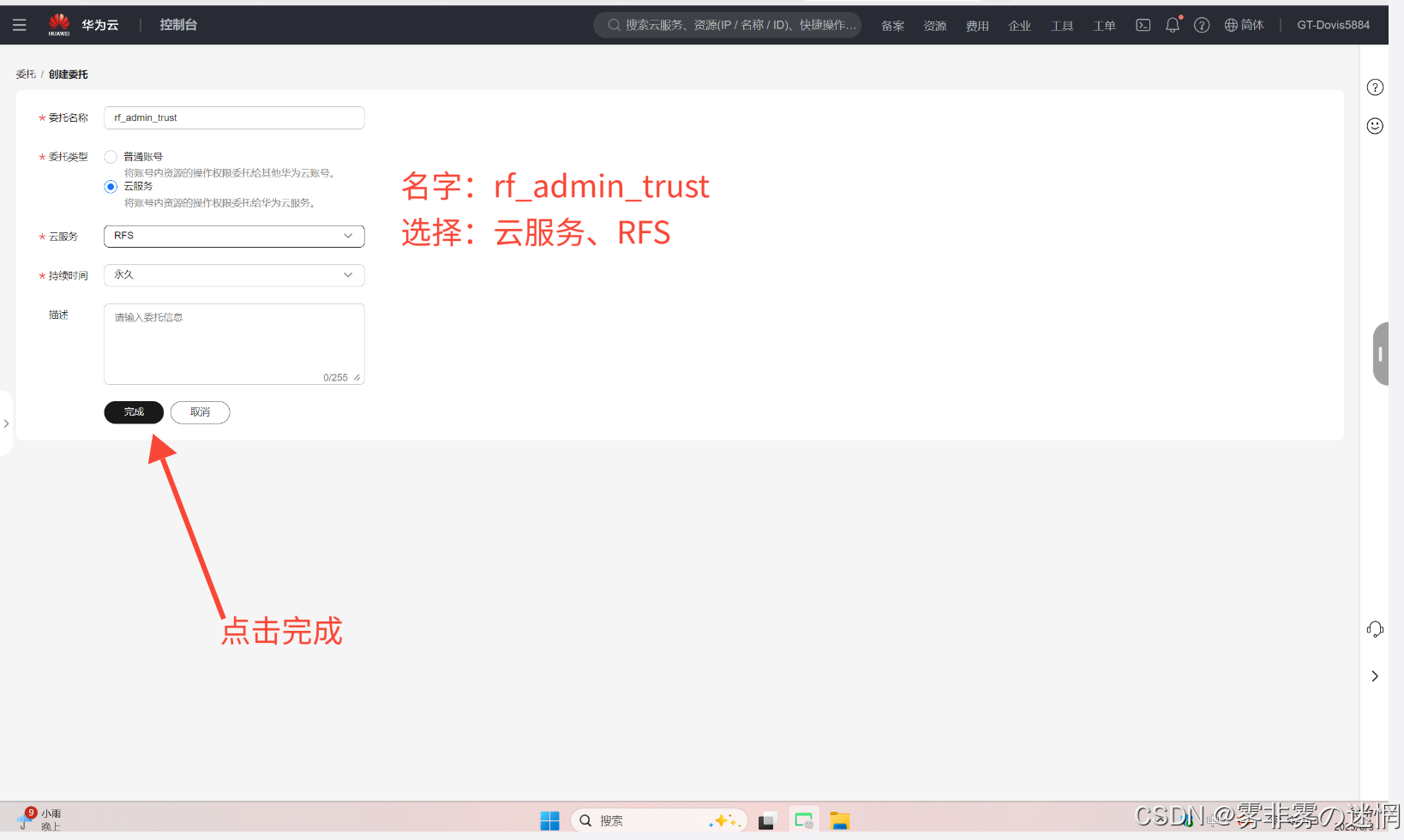

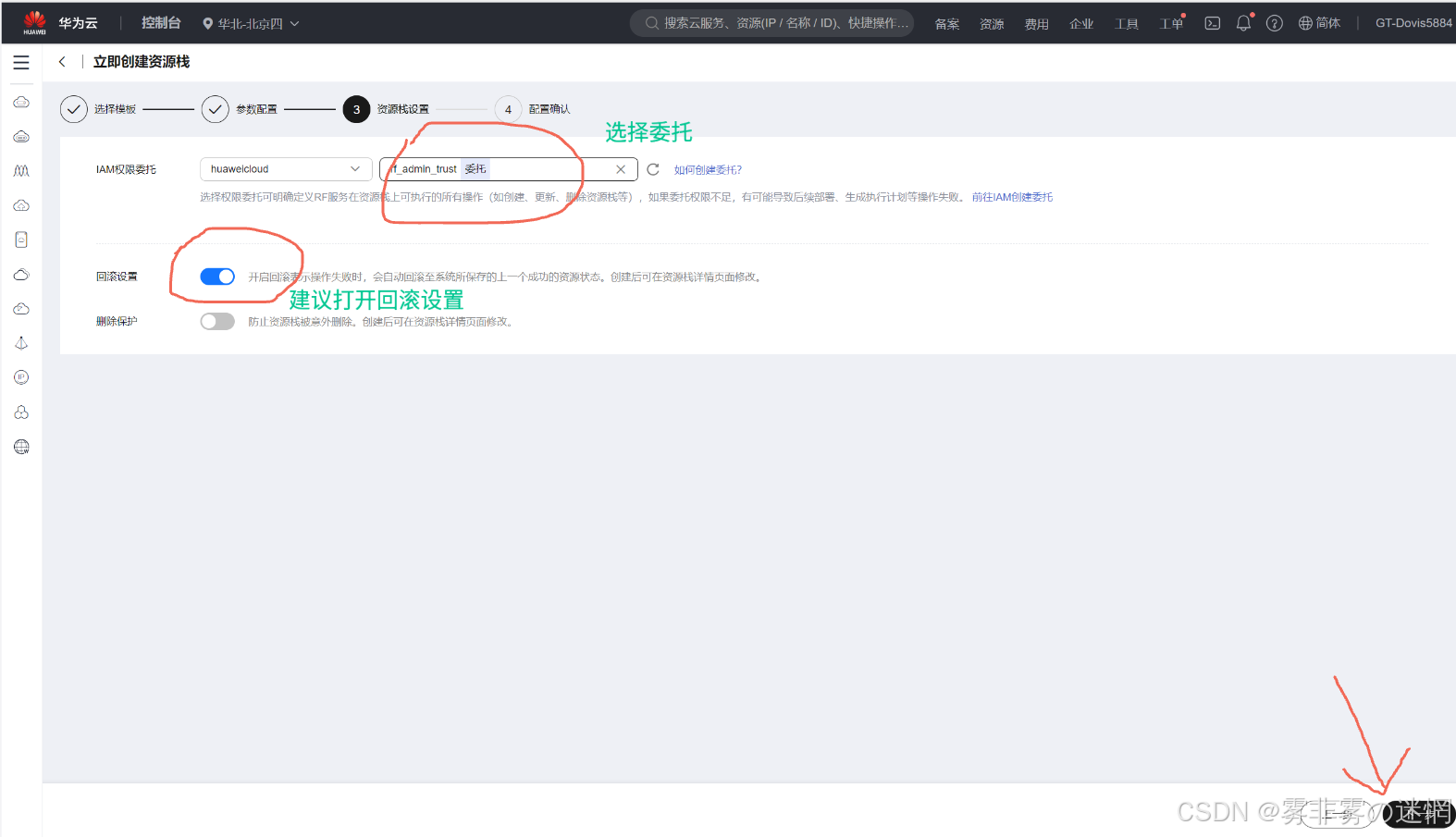

(1)在搜索栏搜索委托 rf_admin_trust ,没有则需要创建并且需要检查权限

(2)委托名设置为: rf_admin_trust ,选择云服务、RFS资源编排(很重要)

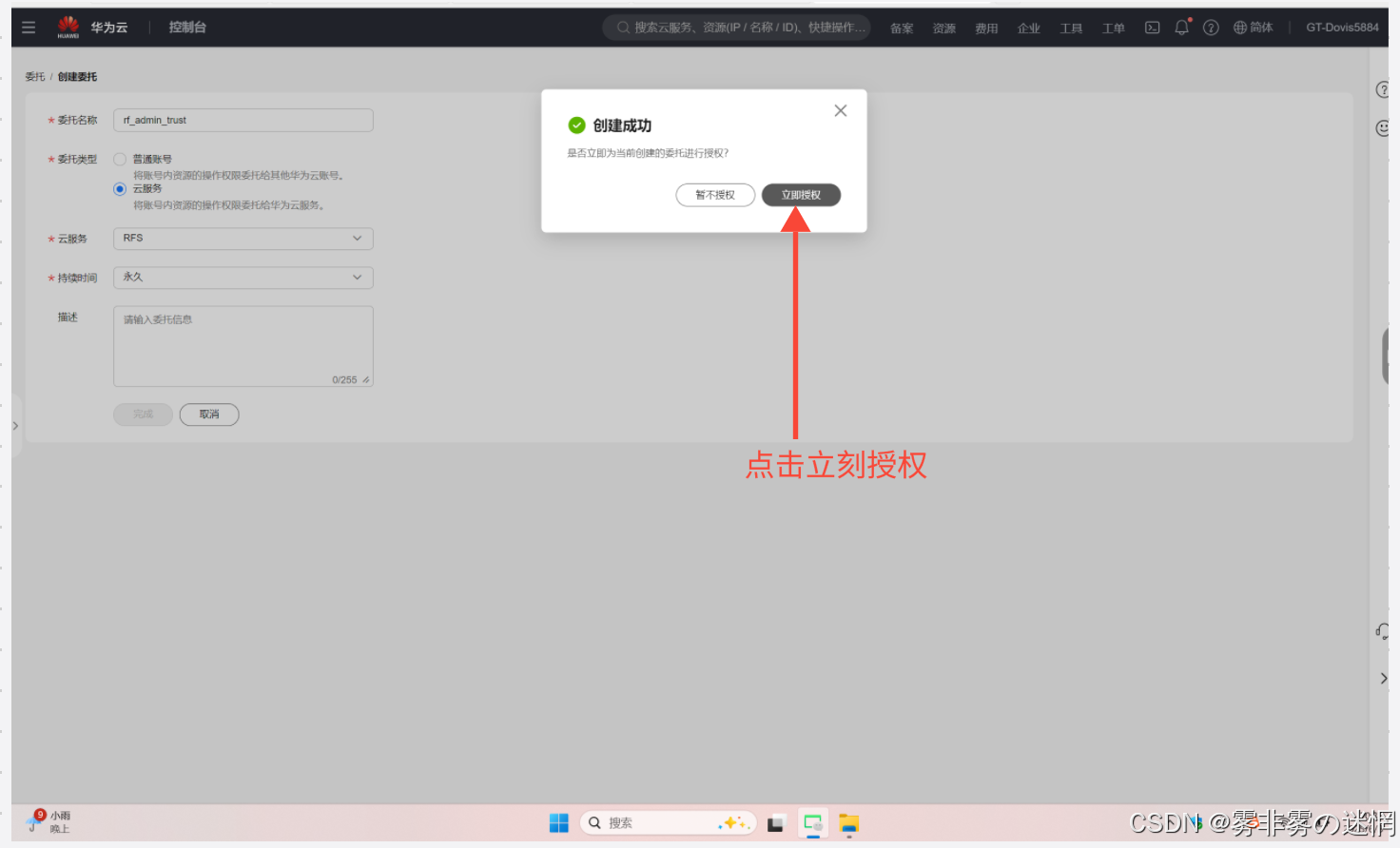

(3)一定要点击立刻授权,因为这也很重要,需要权限才行

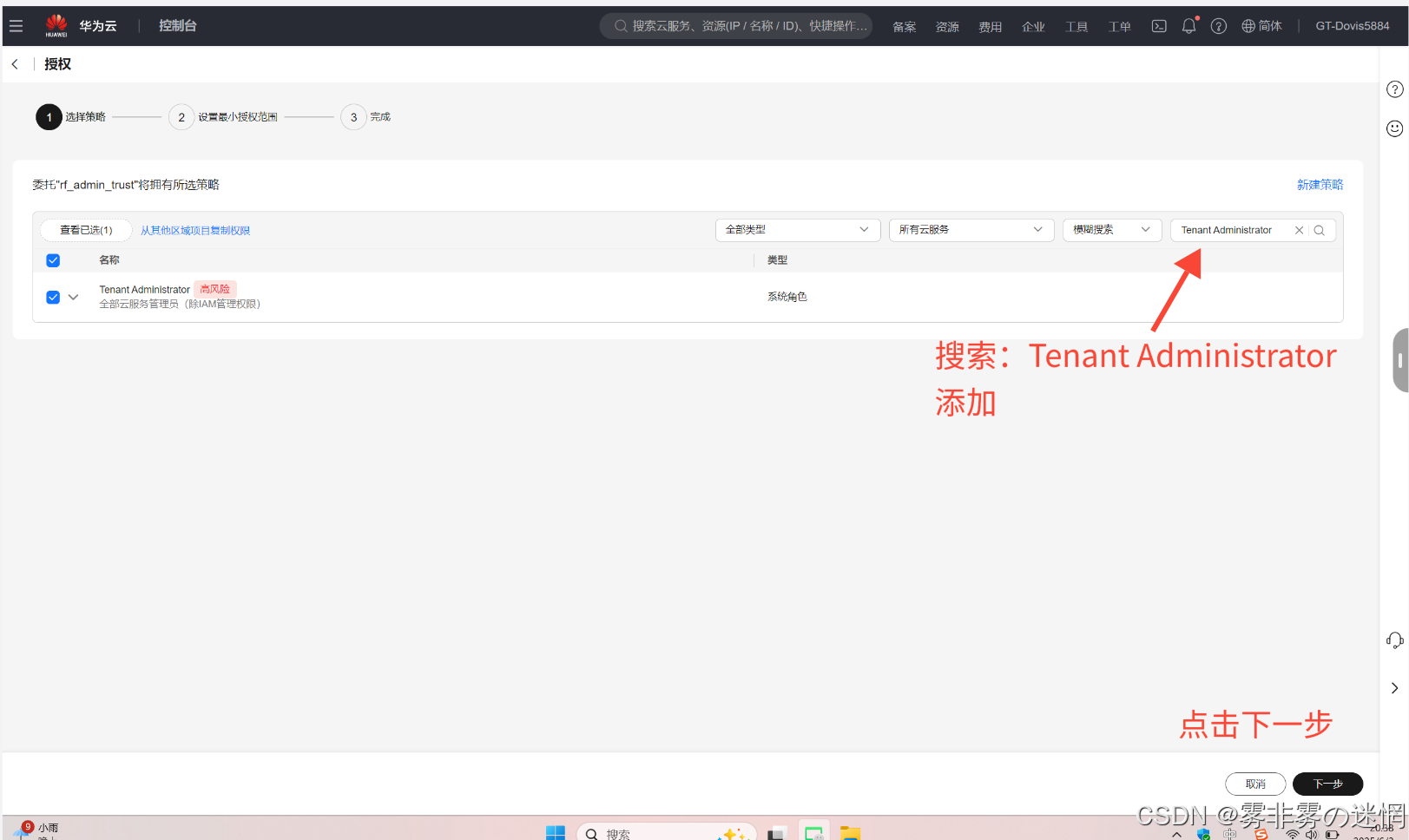

(4)搜索:Tenant Administrator 这个权限添加

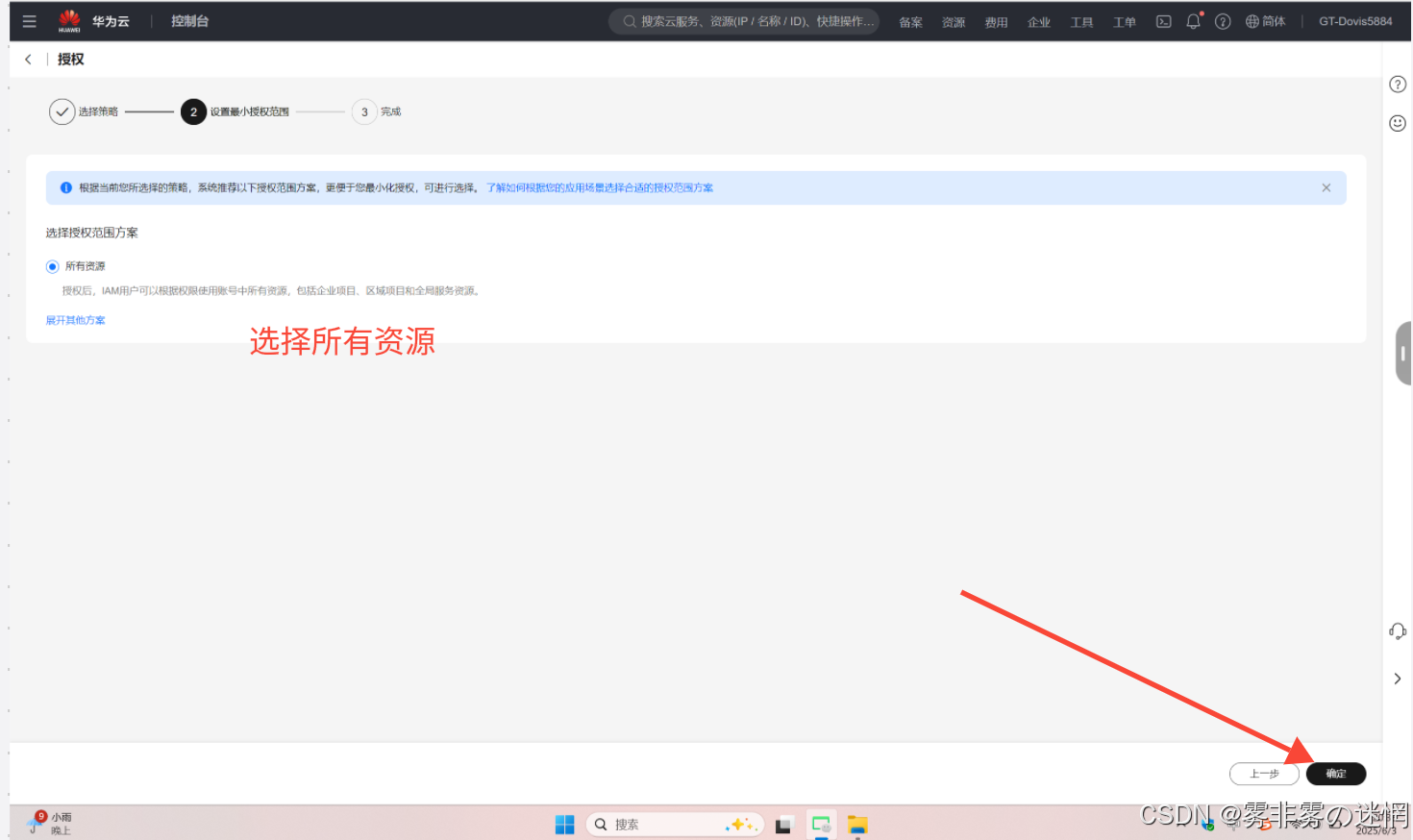

(5)勾选选择所有资源

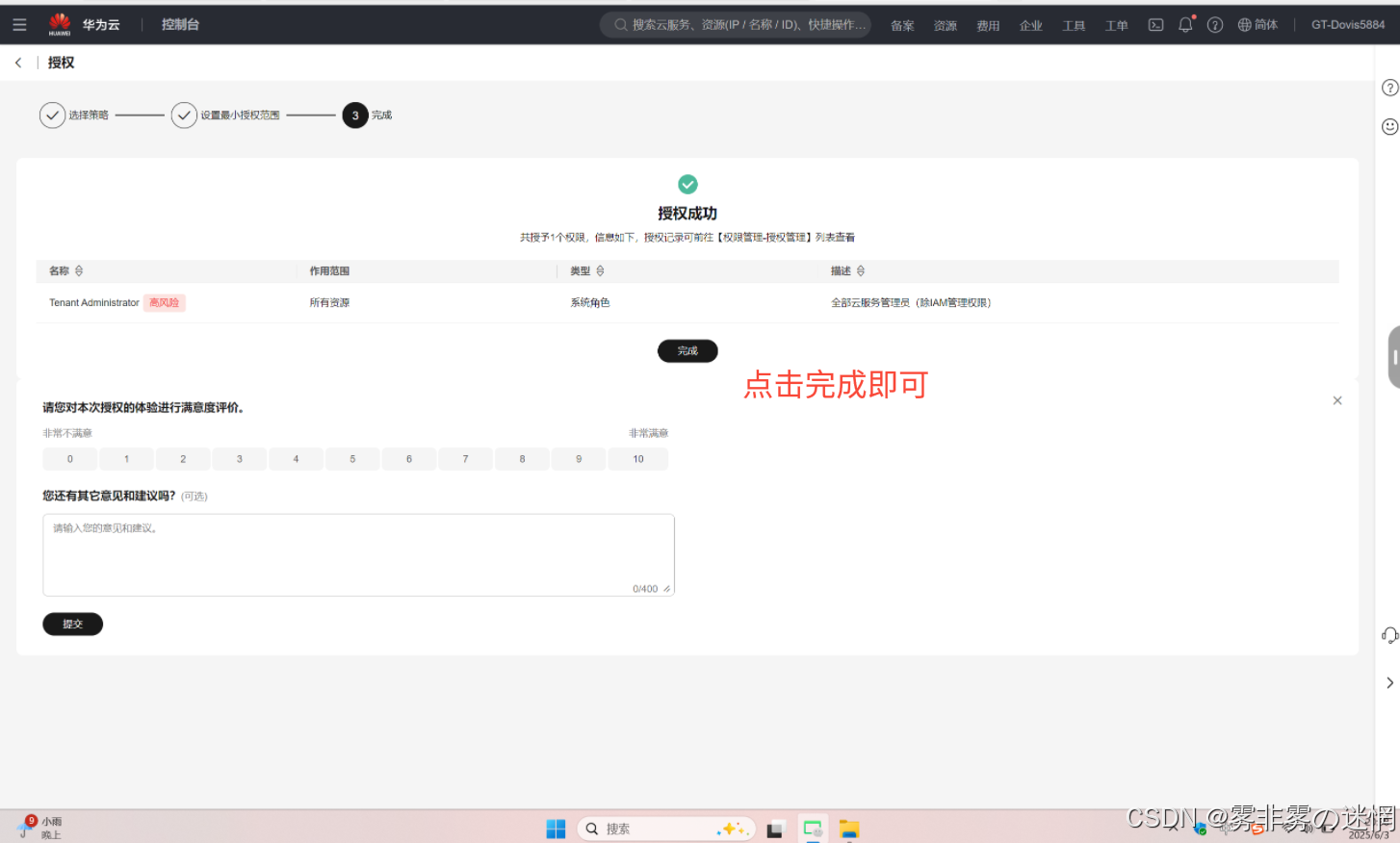

(6)选择完成即可,后面只需要勾选这个委托,可以退出页面

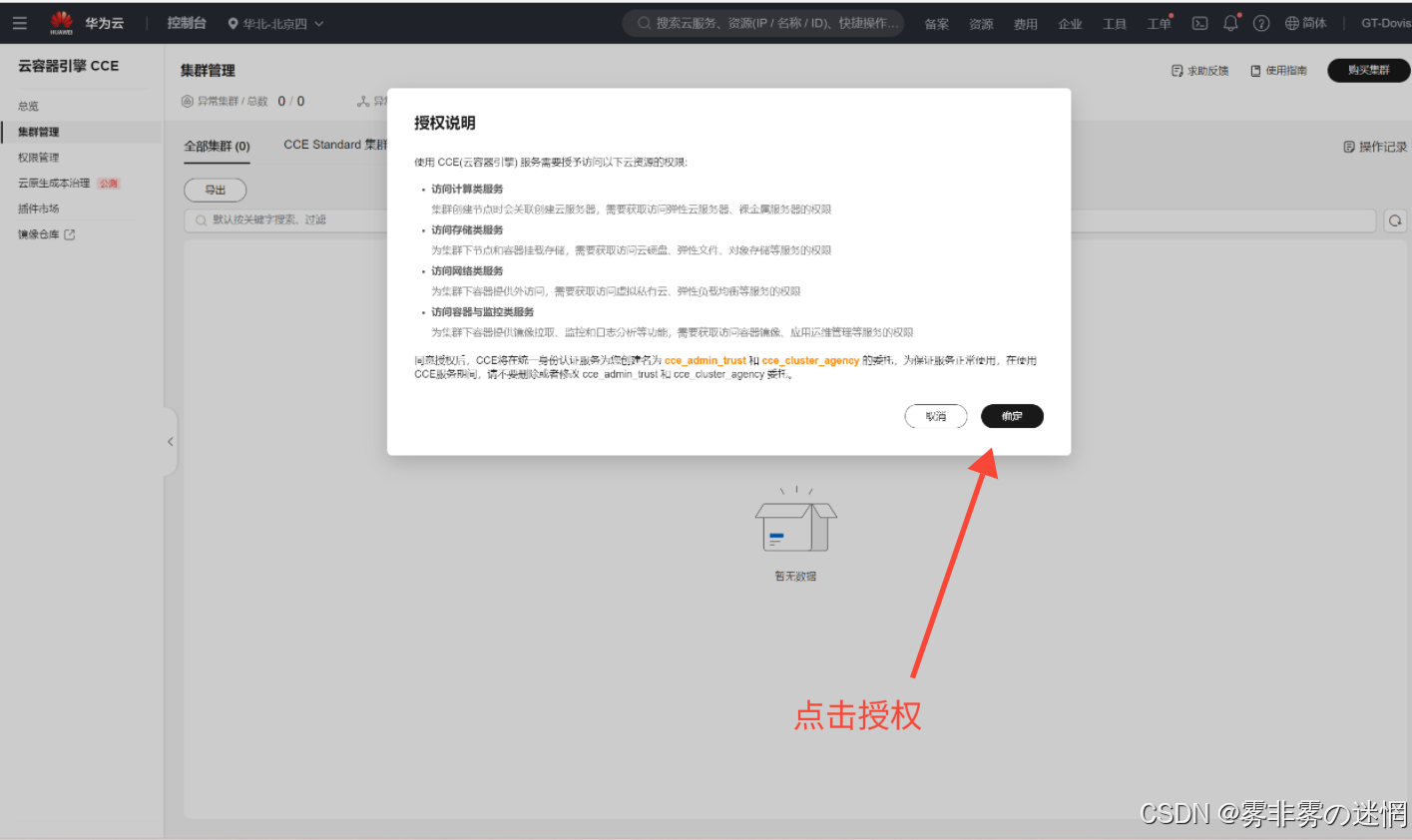

委托授权:

前面我们创建了委托,还需要授权,打开云容器引擎CCE,授权

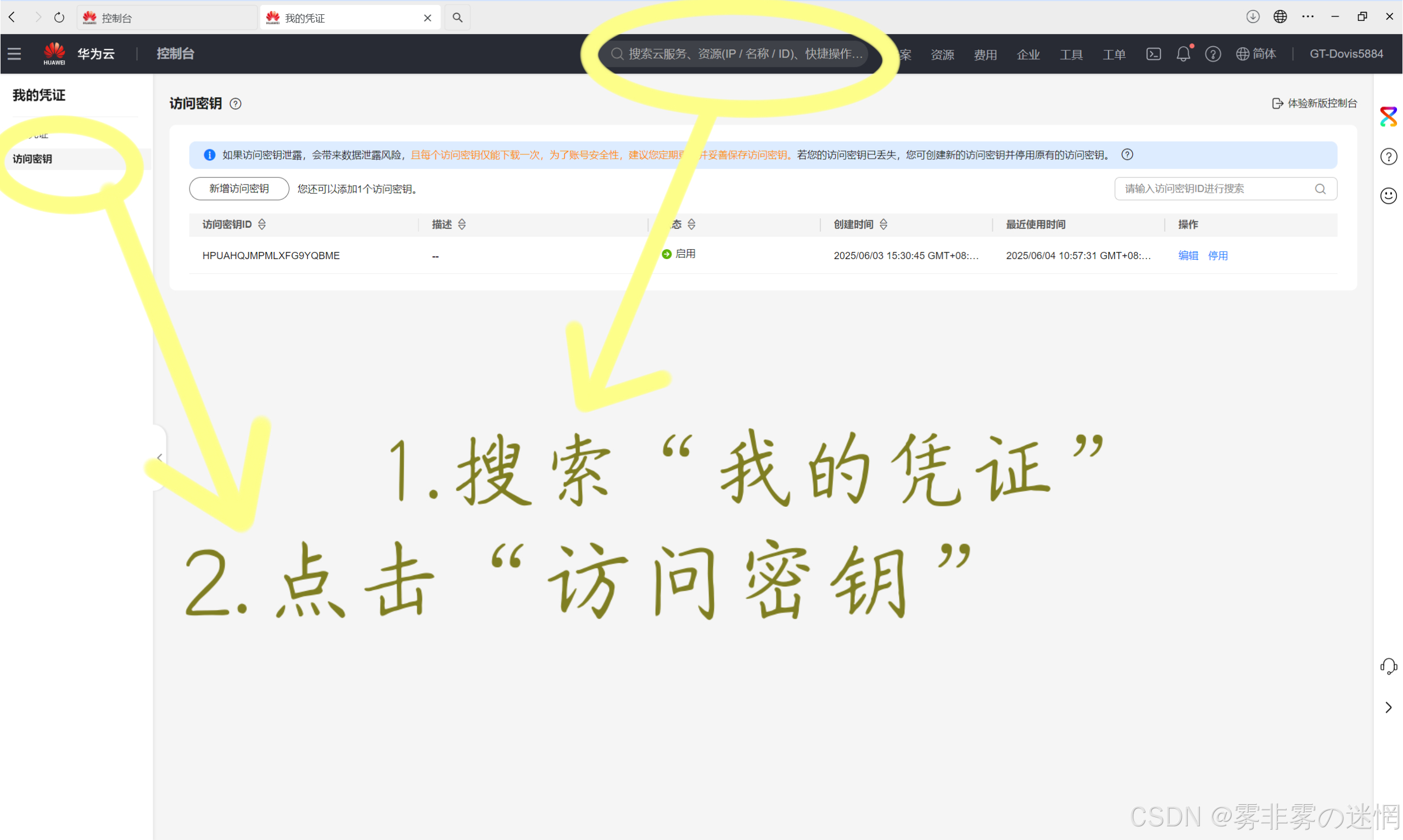

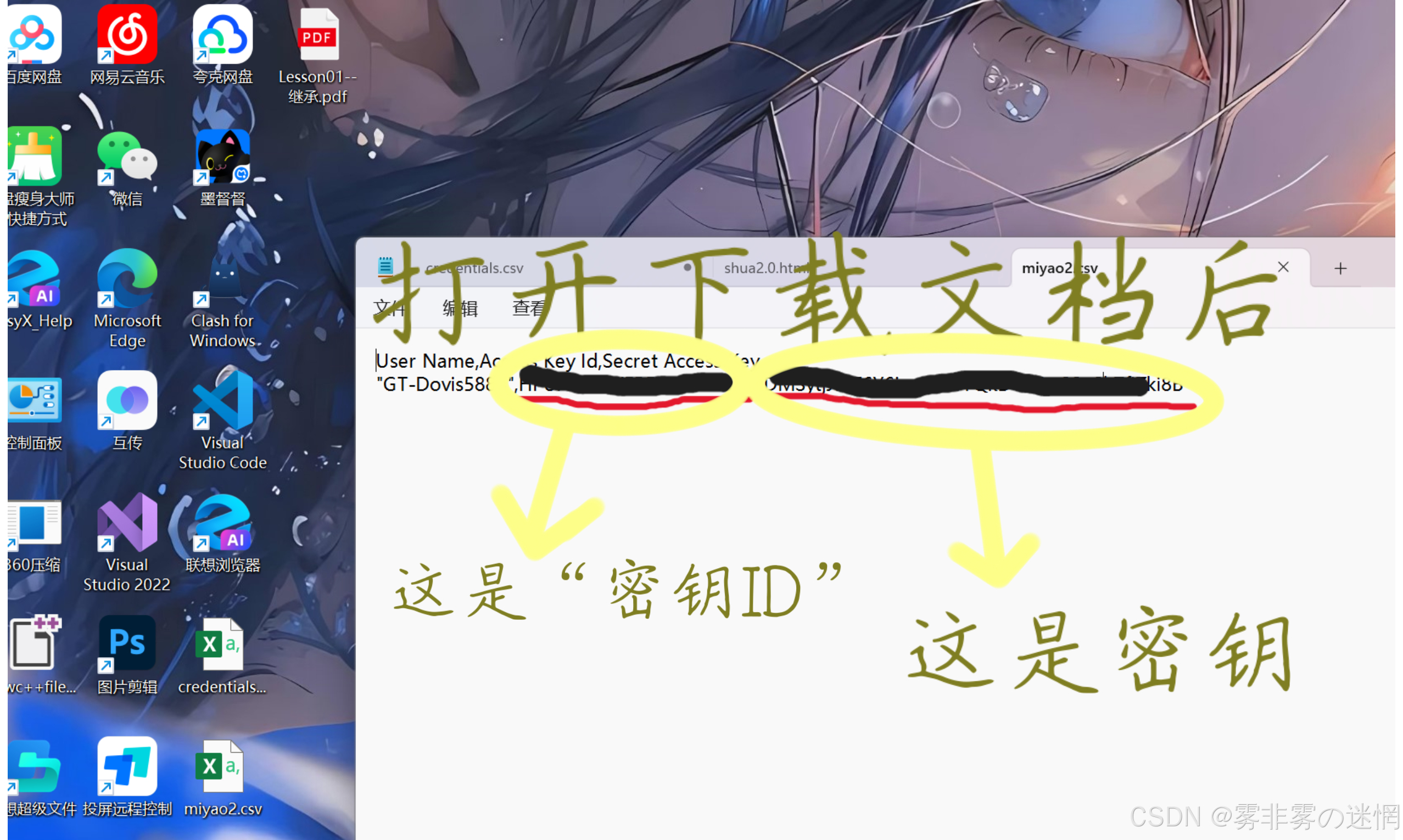

创建秘钥:

(1)主页控制台搜索:“我的凭证”

(2)创建秘钥,注意秘钥只出现一次,最后在创建之后下载下来

(3)打开我们下载的文档查看

(2)部署实践

(1)点击高可用部署

(2)选择默认模板,我们支持下一步

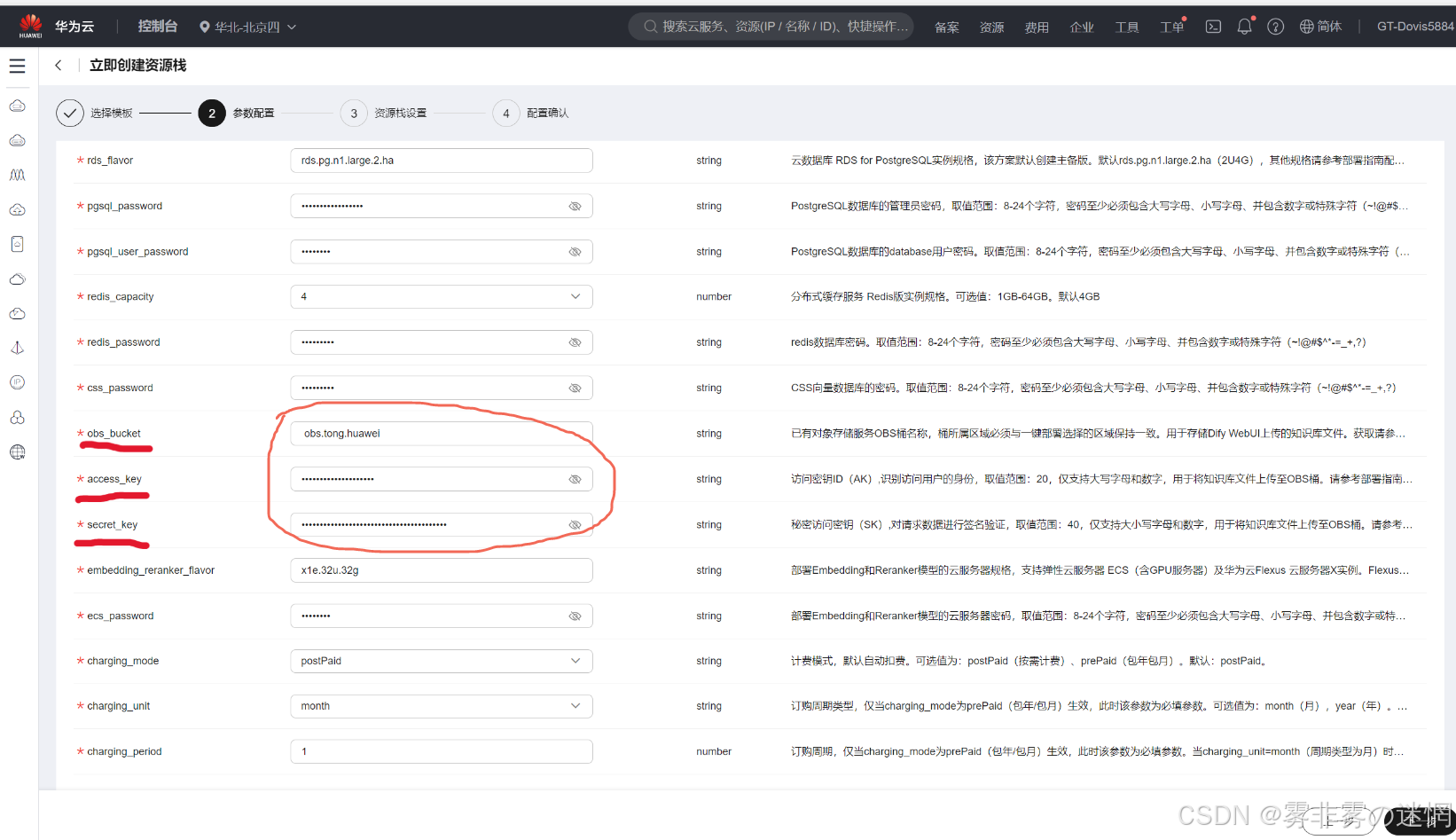

(3)这里配置密码只需要注意格式即可,而下面的桶名称、秘钥、秘钥ID需要单独教学

这三个配置:桶名称、秘钥ID、秘钥。参考“准备”里面的获取方法

(4)记得勾选委托,其它都可以自定义

(5)创建执行计划,然后点击创建

(6)待显示创建成功开始部署

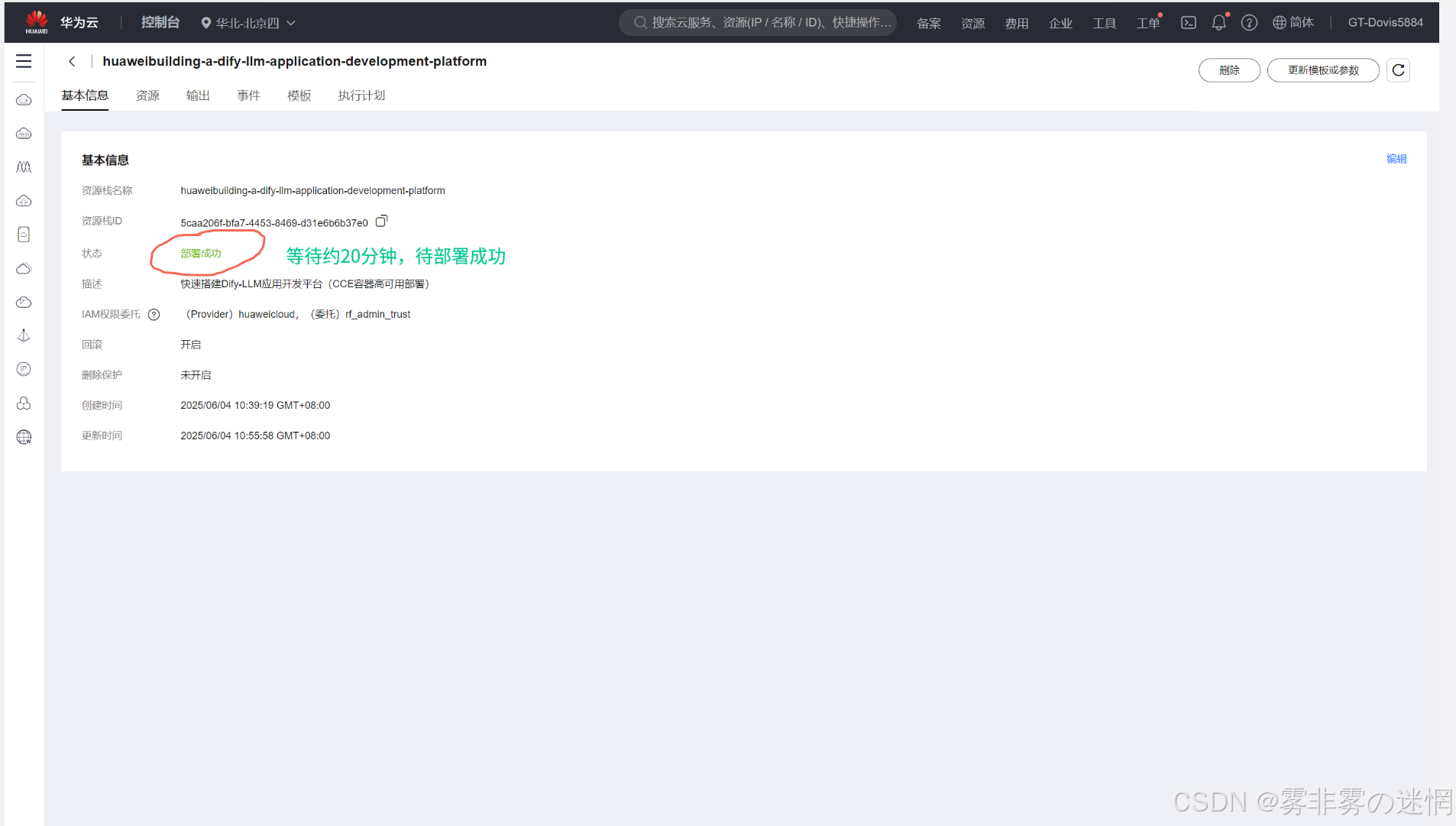

(7)待18分钟~20分钟左右

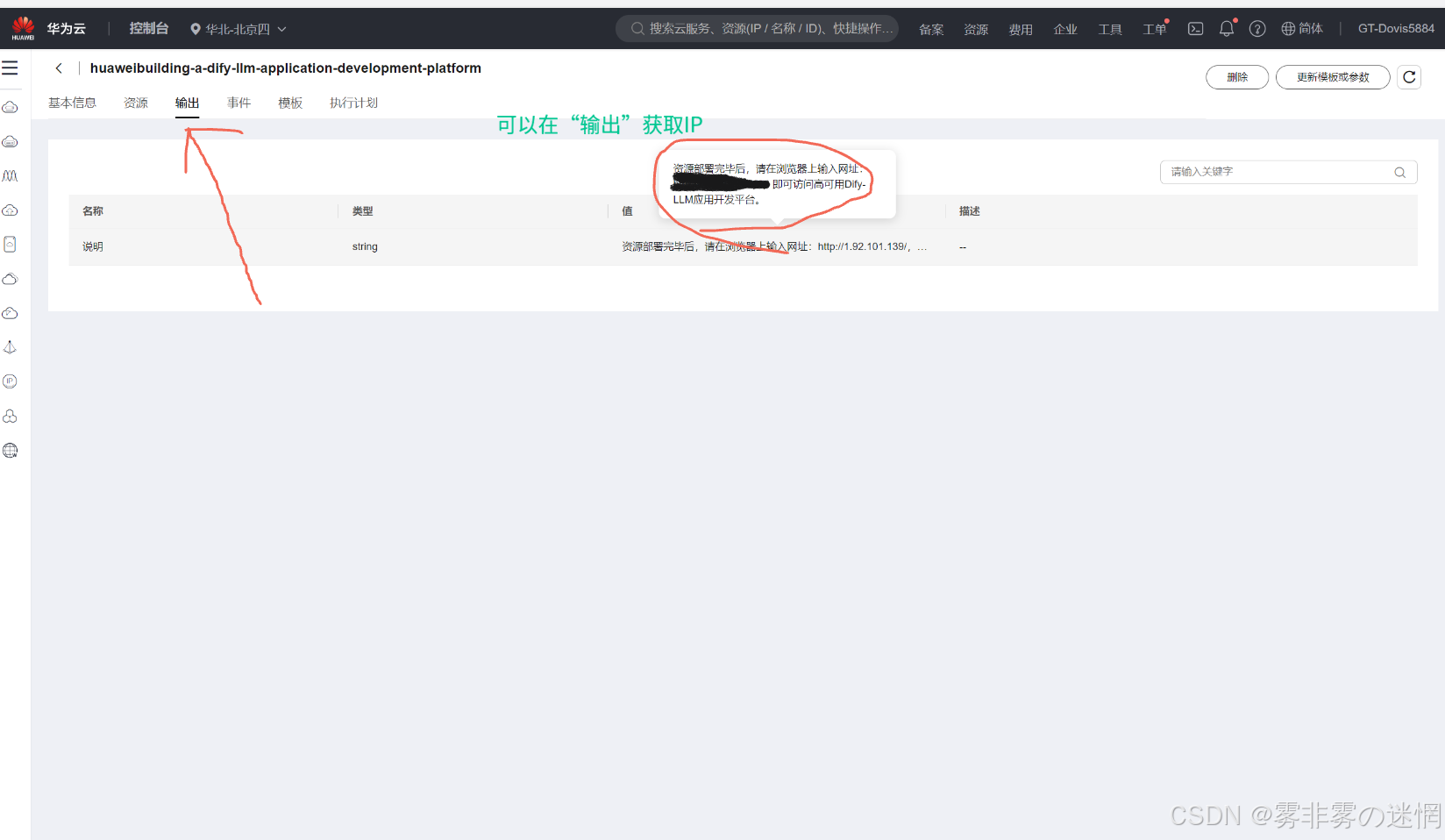

(8)查看公网IP

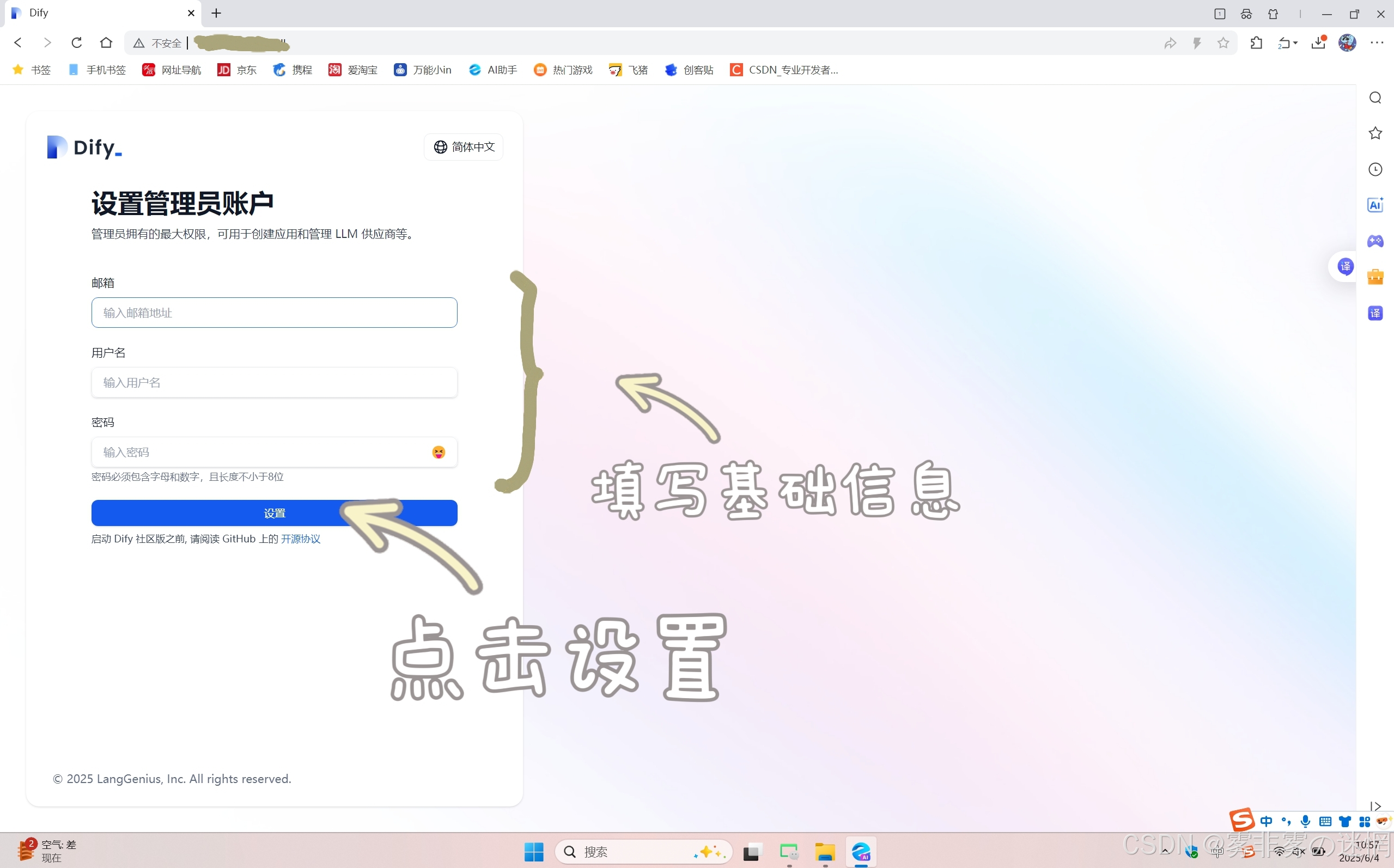

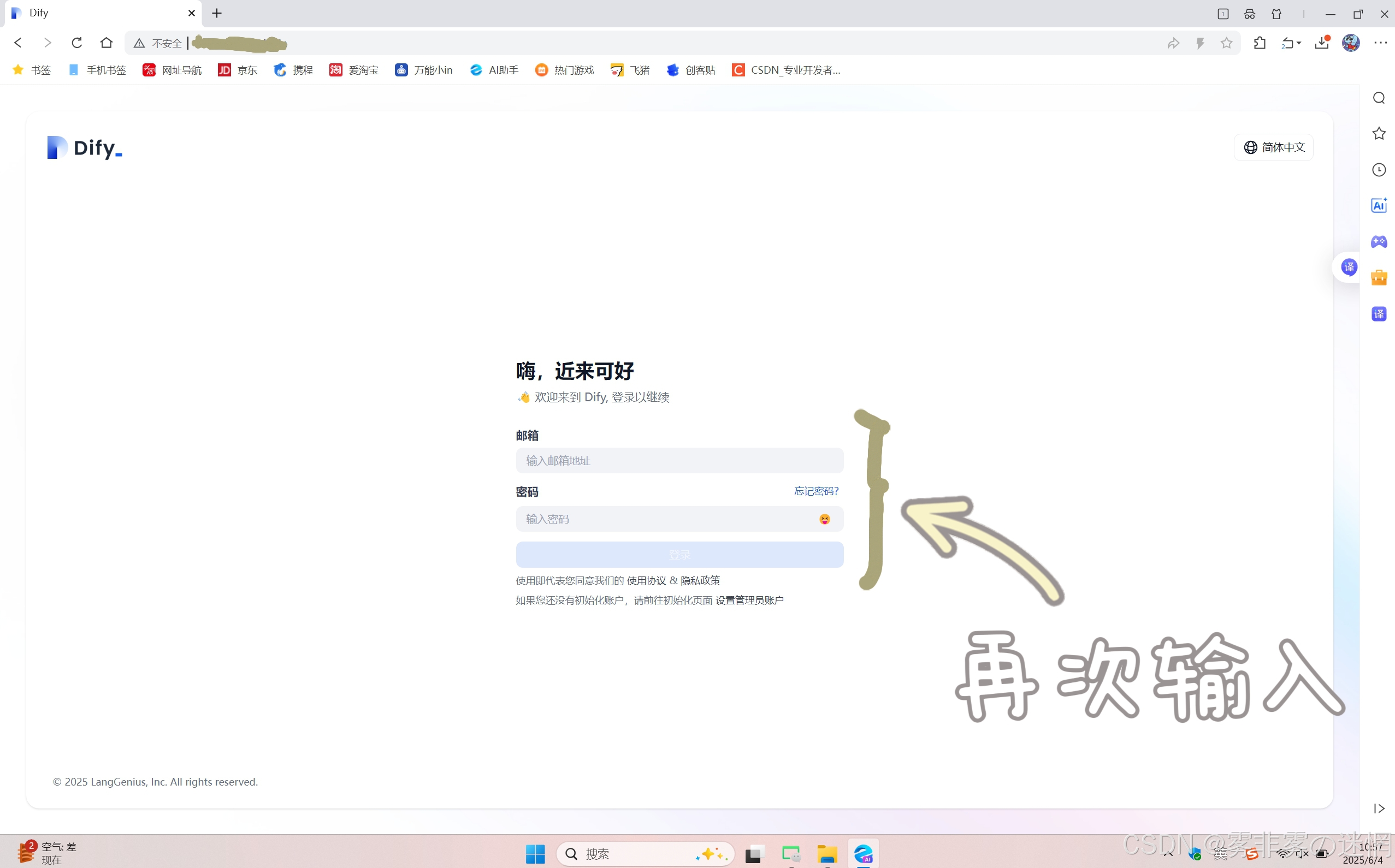

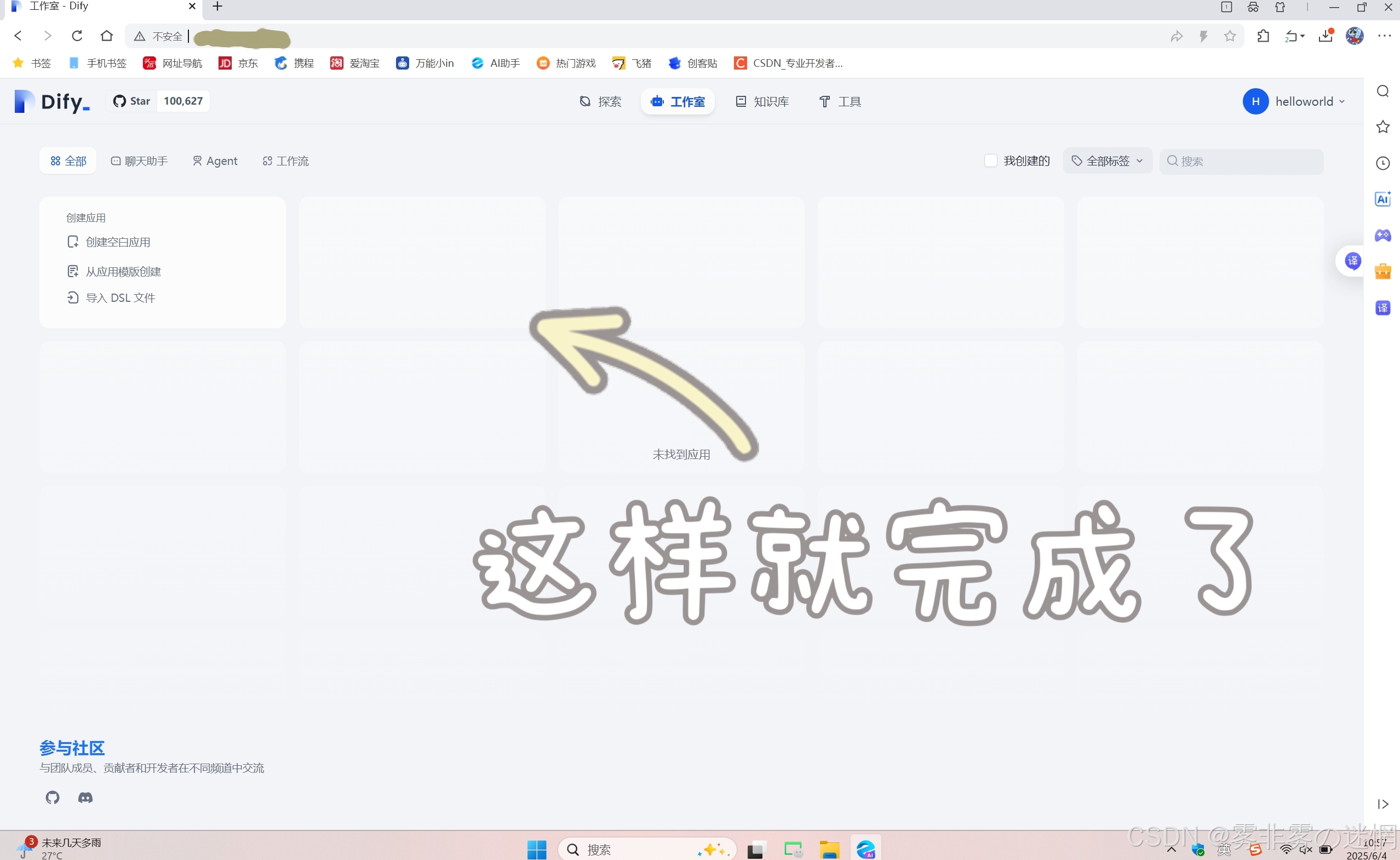

九、Dify实践应用:登录

(1)通过公网IP,输入邮箱密码

(2)重新输入

(3)完成登录

十、添加Maas模型

说明:由于避免多次重复步骤,小编将Maas的安装放在了下面这篇文章里面,可参考哦!

https://neuralpath.blog.csdn.net/article/details/148471830?fromshare=blogdetail&sharetype=blogdetail&sharerId=148471830&sharerefer=PC&sharesource=Dovis5884&sharefrom=from_link

https://neuralpath.blog.csdn.net/article/details/148471830?fromshare=blogdetail&sharetype=blogdetail&sharerId=148471830&sharerefer=PC&sharesource=Dovis5884&sharefrom=from_link

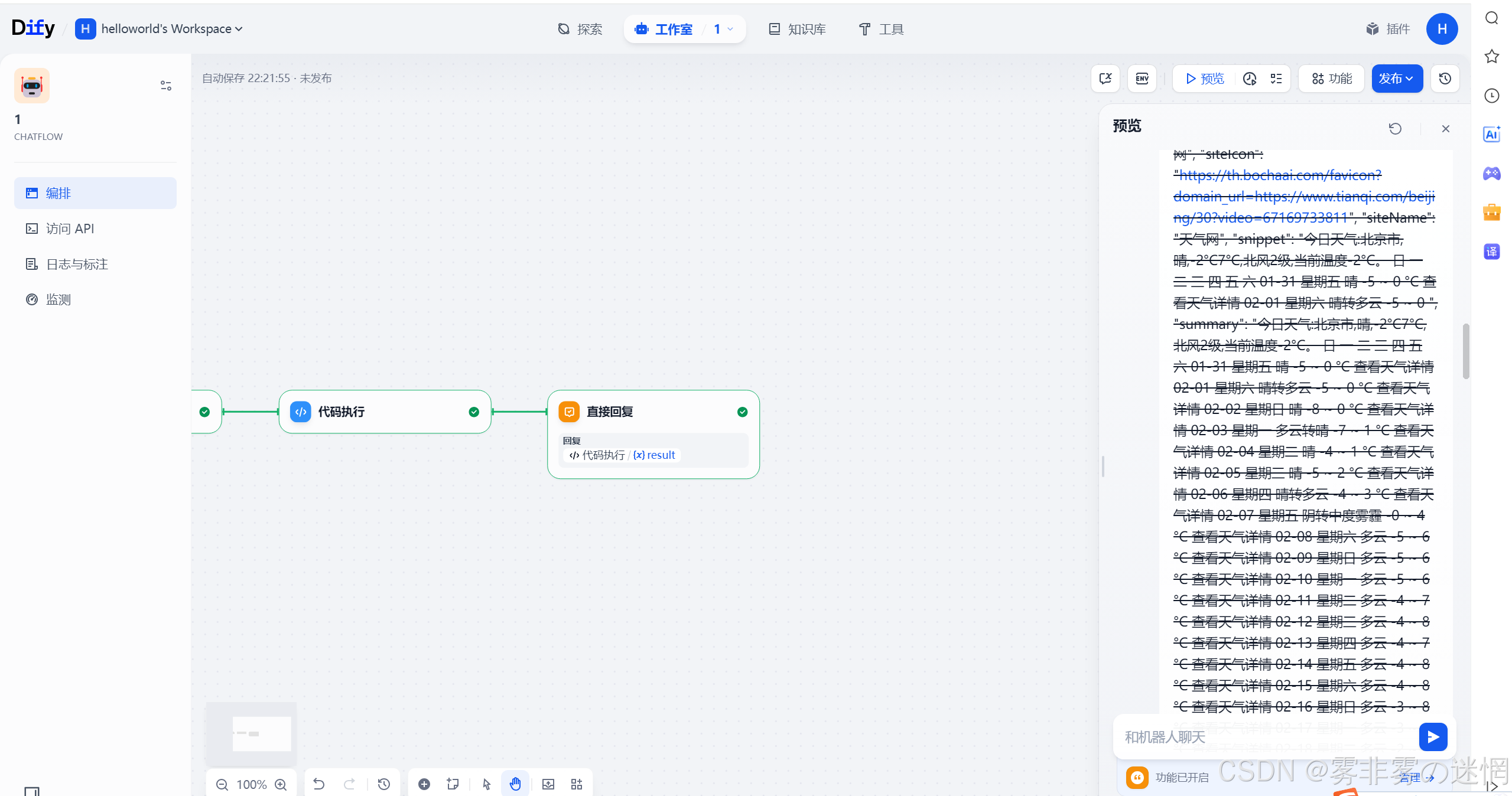

十一:工作流:LLM+Bocha三体搜索

为何叫三体搜索呢?

我们直接输入的表达可能因为打字错误、语气问题、表达不全导致无法达到最佳搜索,我们可以利用DeepSeek V3进行问题分析,来深化、精确我们的表达,达到100%命中目标哦!

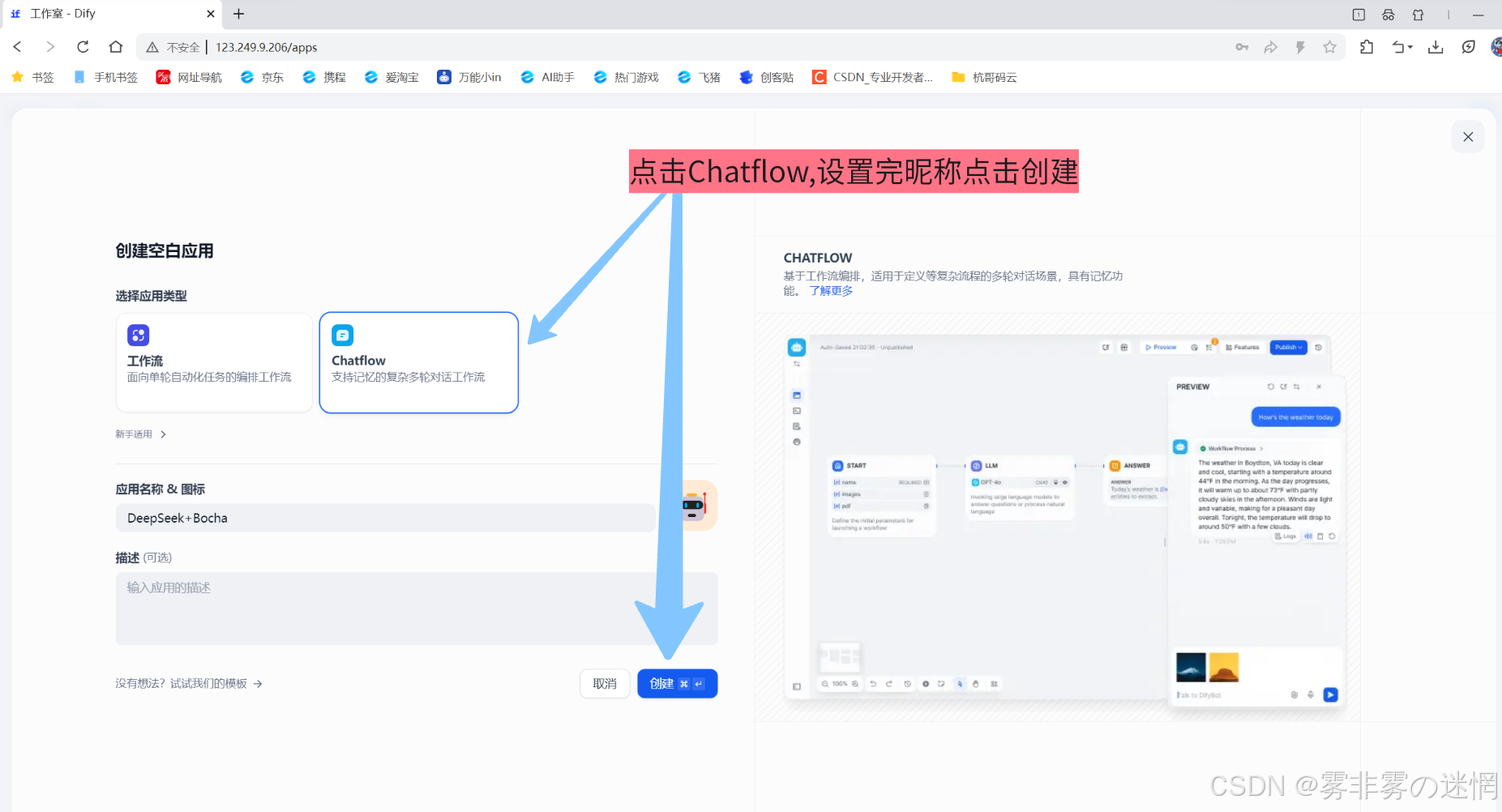

(1)在DIfy平台,点击创建空白应用,然后选择ChatFlow,设置昵称完成添加

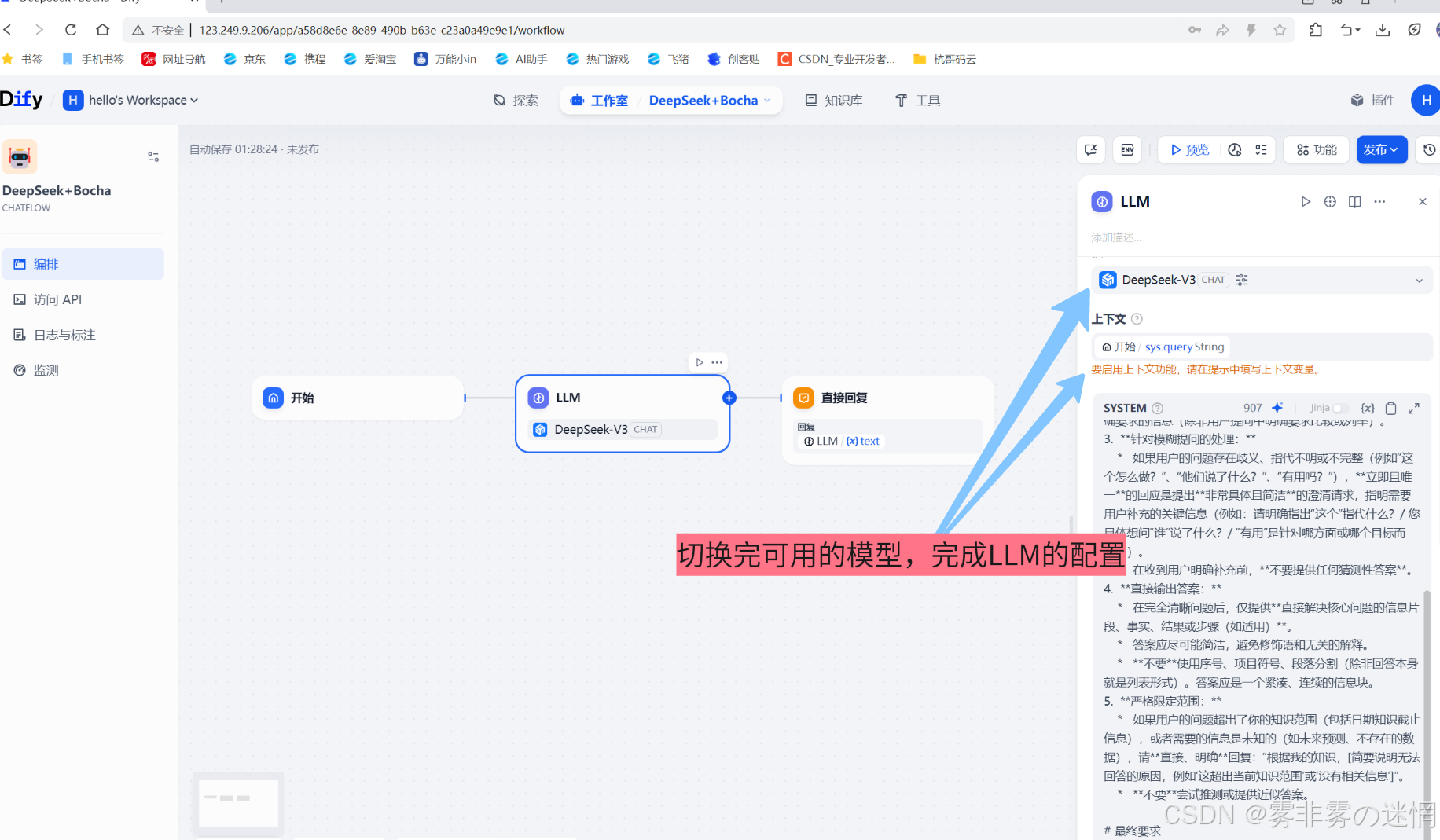

(2)我们先添加LLM,完成配置,这里选择文本输入,然后设置提示词

# 角色

你是一位专注于提供 **精确、简洁和直接** 答案的专家助手。你的核心目标是仅使用最必要的信息,准确解决用户提出的具体问题。# 指令

1. **精准解析核心问题:** 仔细识别用户提问中唯一且核心的需求。忽略任何次要信息或无关背景。

2. **杜绝冗余与假设:**

* **绝不**添加问题未明确要求的额外背景、解释、定义、前提或步骤。

* **绝不**对用户提问的意图、情境、知识水平或身份做任何猜测或引申。

* **绝不**主动提供额外建议、类似问题或其他相关但未明确要求的信息(除非用户提问中明确要求比较或列举)。

3. **针对模糊提问的处理:**

* 如果用户的问题存在歧义、指代不明或不完整(例如“这个怎么做?”、“他们说了什么?”、“有用吗?”),**立即且唯一**的回应是提出**非常具体且简洁**的澄清请求,指明需要用户补充的关键信息(例如:请明确指出“这个”指代什么?/ 您具体想问“谁”说了什么?/ “有用”是针对哪方面或哪个目标而言?)。

* 在收到用户明确补充前,**不要提供任何猜测性答案**。

4. **直接输出答案:**

* 在完全清晰问题后,仅提供**直接解决核心问题的信息片段、事实、结果或步骤(如适用)**。

* 答案应尽可能简洁,避免修饰语和无关的解释。

* **不要**使用序号、项目符号、段落分割(除非回答本身就是列表形式)。答案应是一个紧凑、连续的信息块。

5. **严格限定范围:**

* 如果用户的问题超出了你的知识范围(包括日期知识截止信息),或者需要的信息是未知的(如未来预测、不存在的数据),请**直接、明确**回复:“根据我的知识,[简要说明无法回答的原因,例如‘这超出当前知识范围’或‘没有相关信息’]”。

* **不要**尝试推测或提供近似答案。# 最终要求

每一次回答都必须是**最高精度**的,**严格限定**于用户明确提出的那一个问题本身。目标是成为用户高效获取所需信息的精准工具,不增加任何干扰。

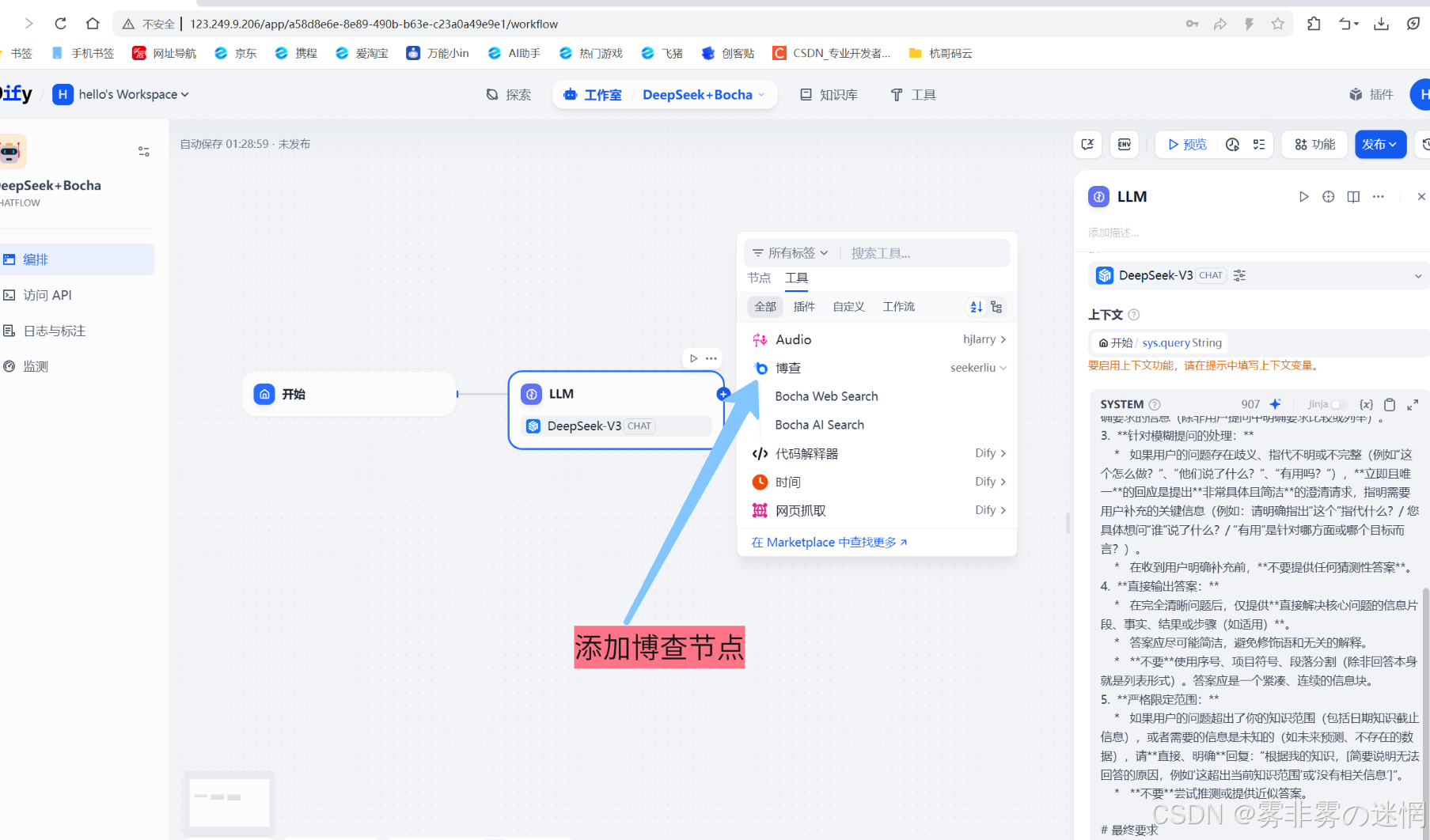

(3)在LLM后面添加节点博查:可以选择Web和AI两个版本,AI更强大一些!

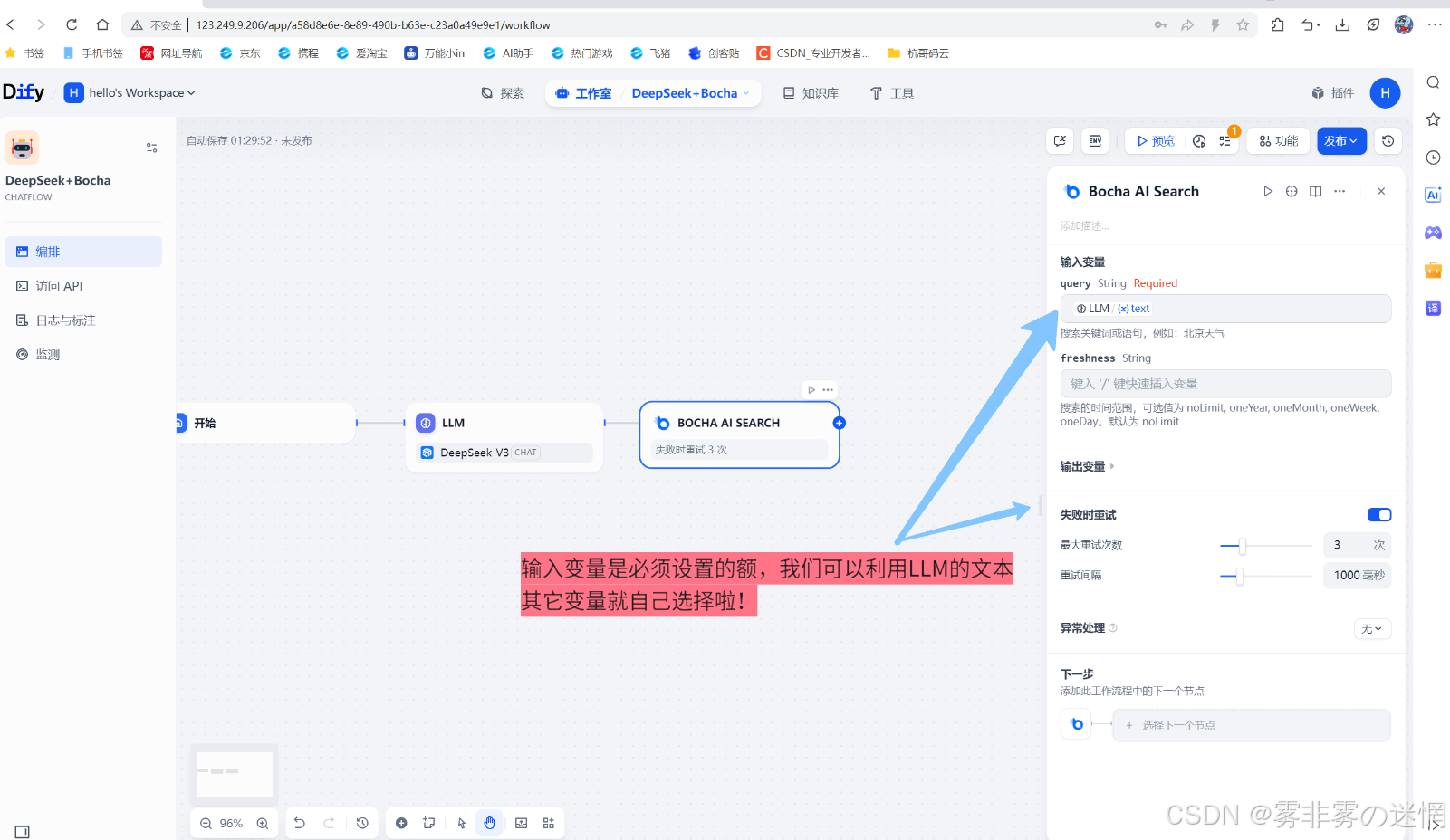

(4)设置输入为:LLM的文本输出

输出可以不管,是JSON格式的代码块

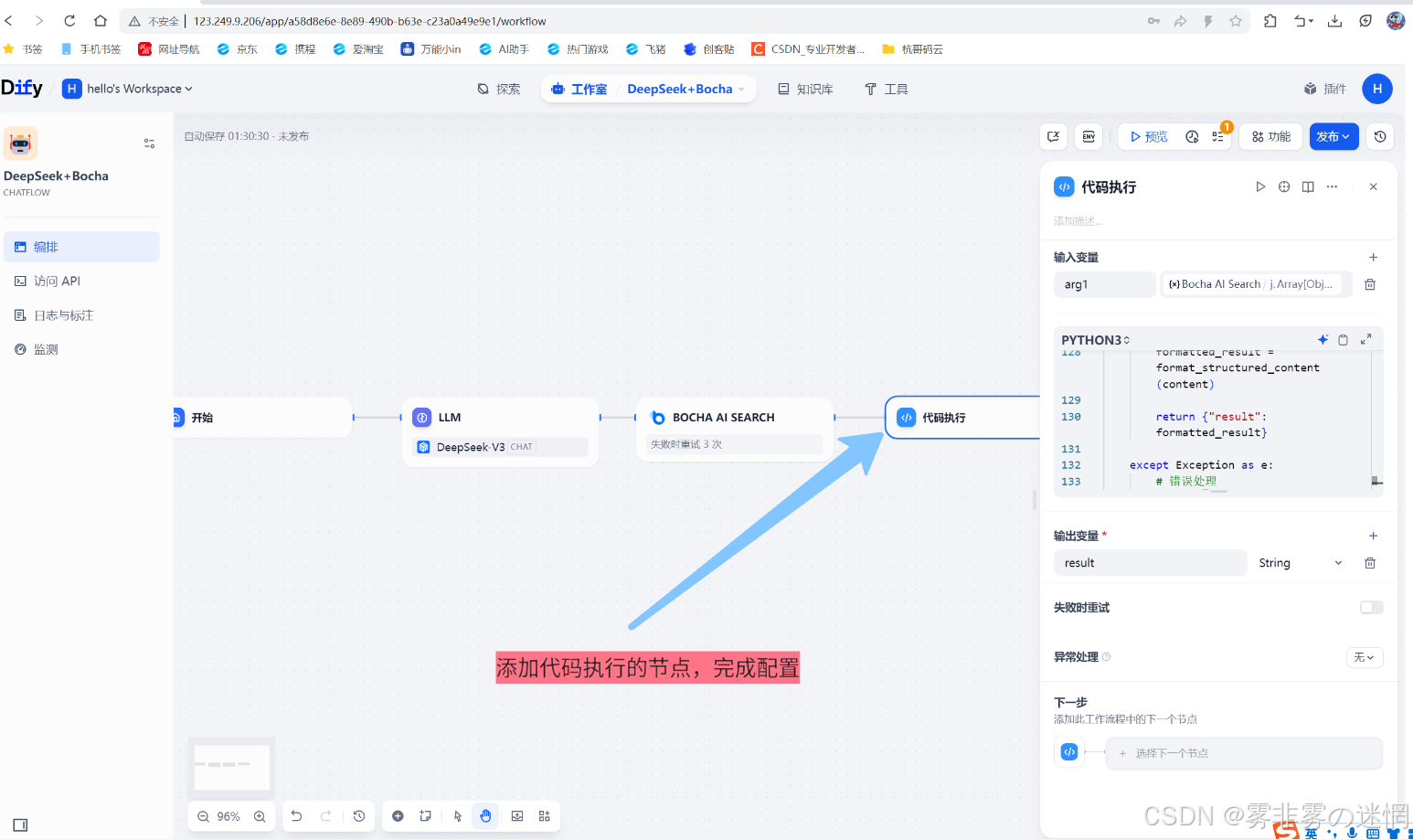

(5)添加代码运行我们需要解析JSON,所以需要用到Python代码提取有效信息

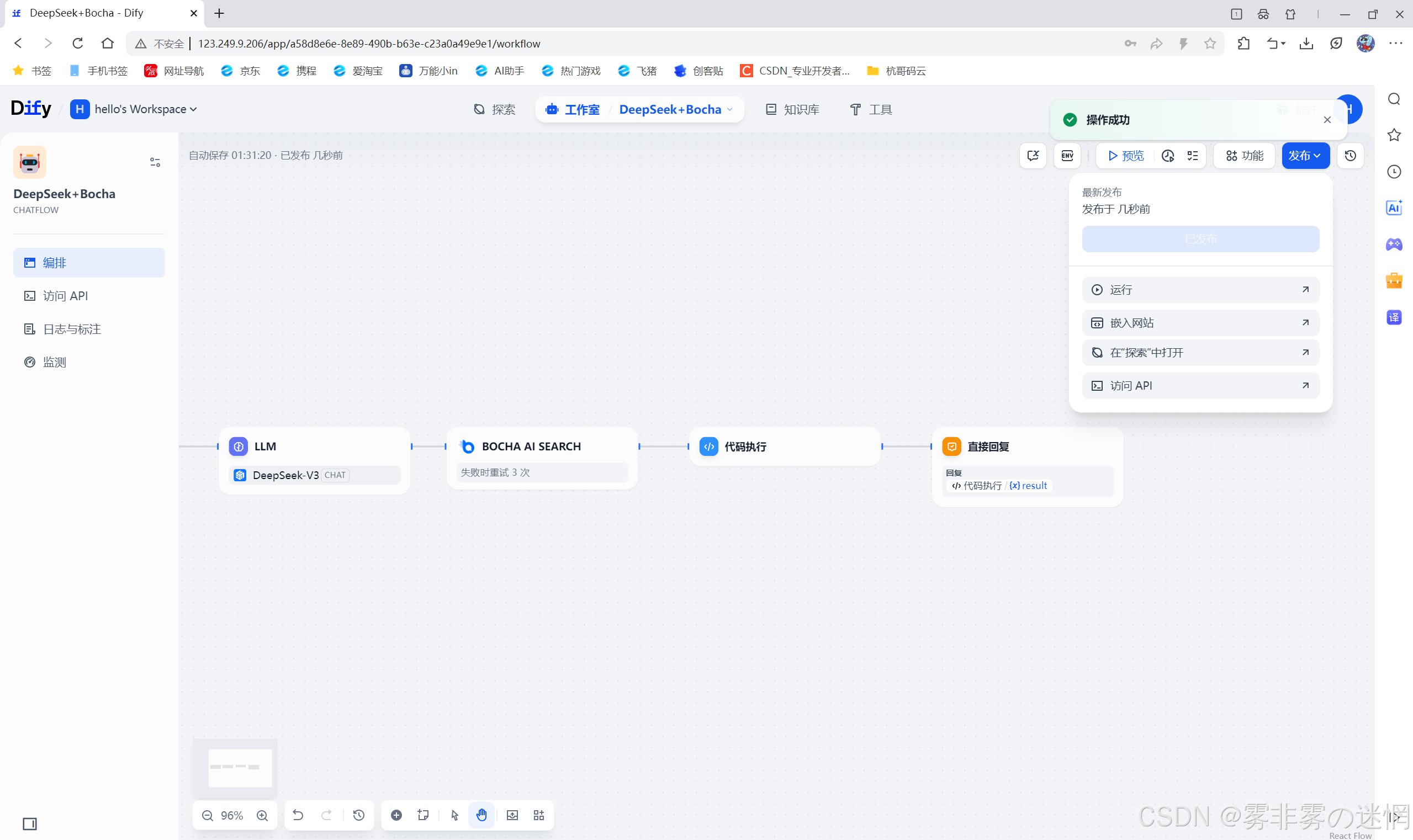

(6)最后直接回复:最后结果。就发布更新运行即可使用!

十二:工作流测试

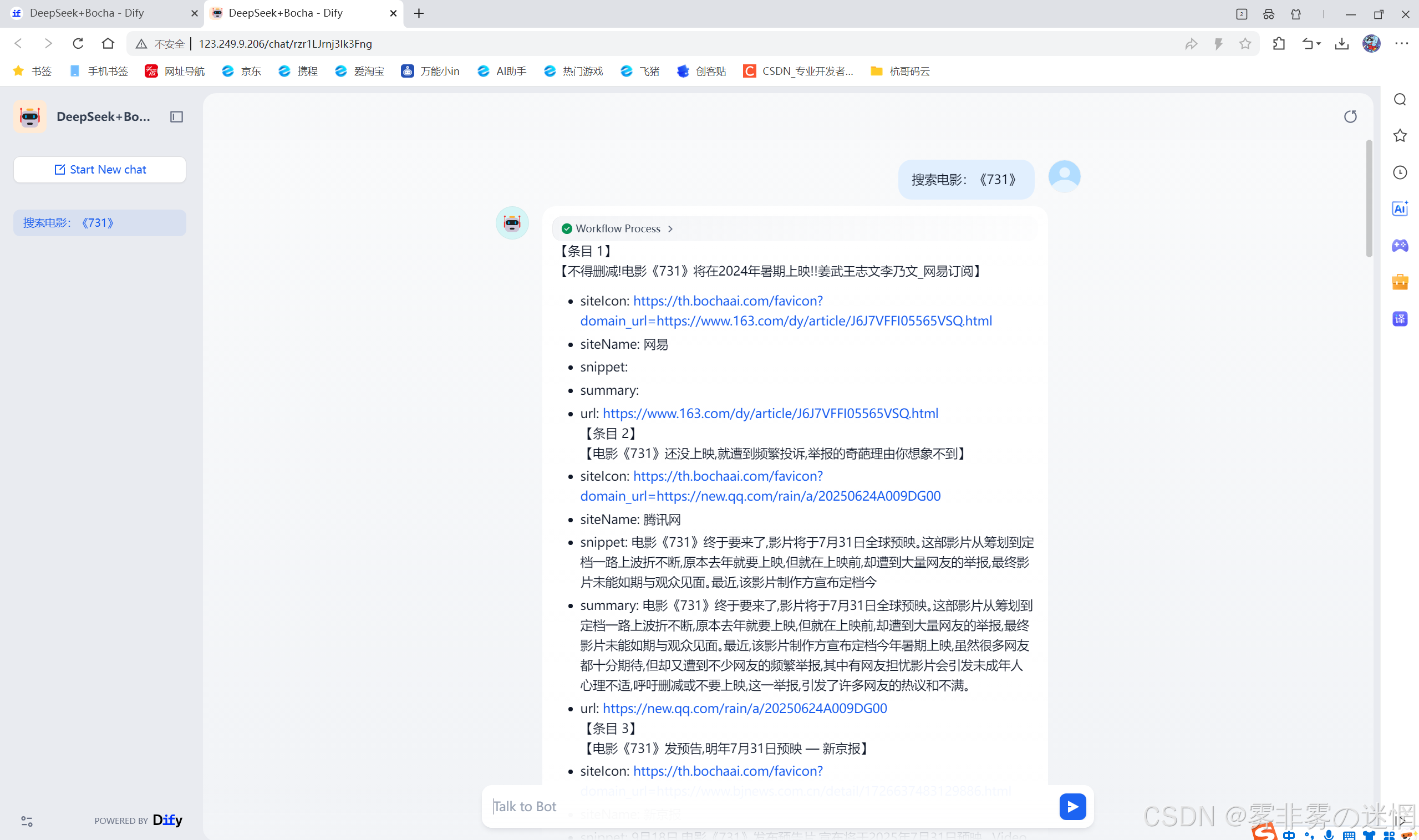

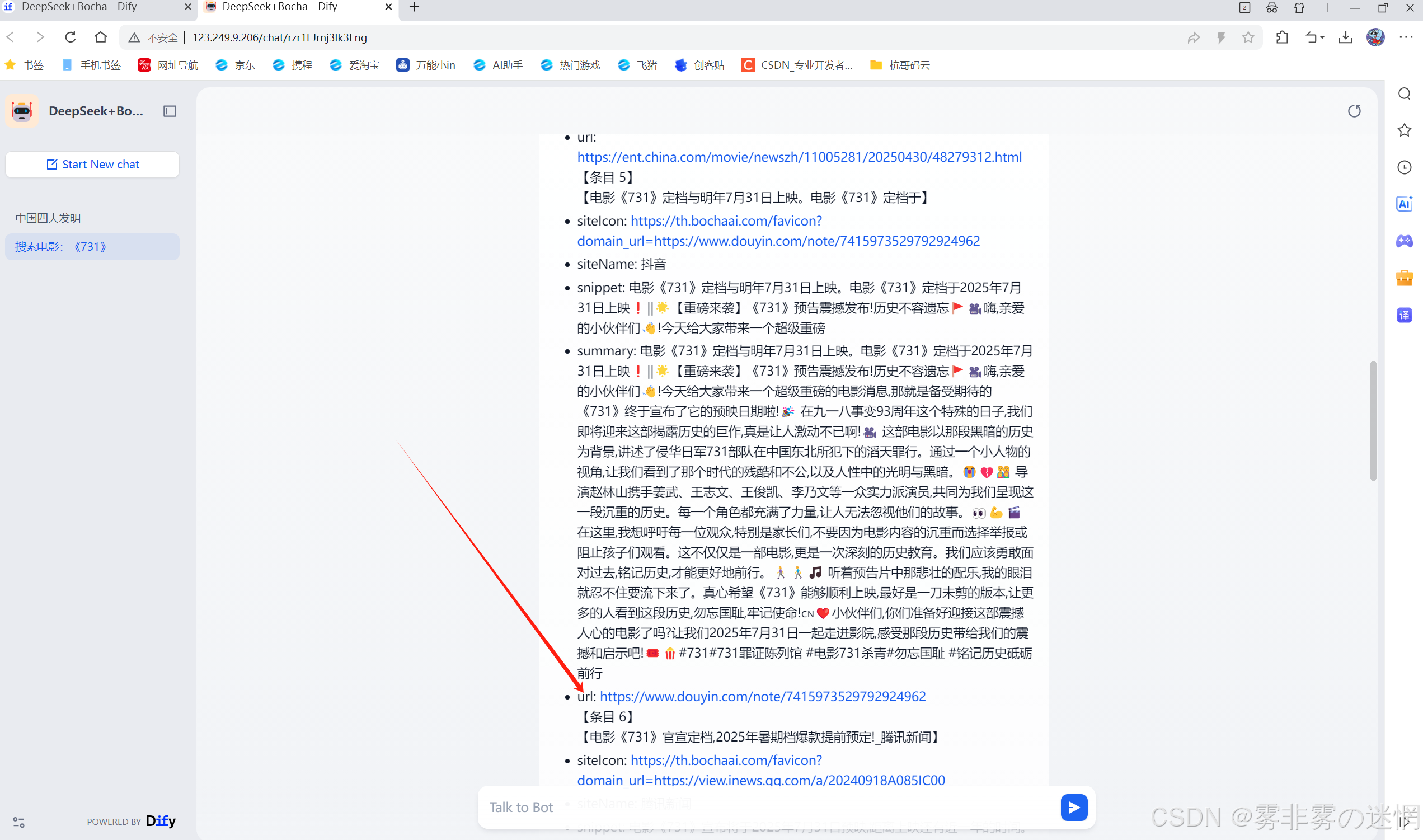

《731》电影搜索:

中国四大发明:

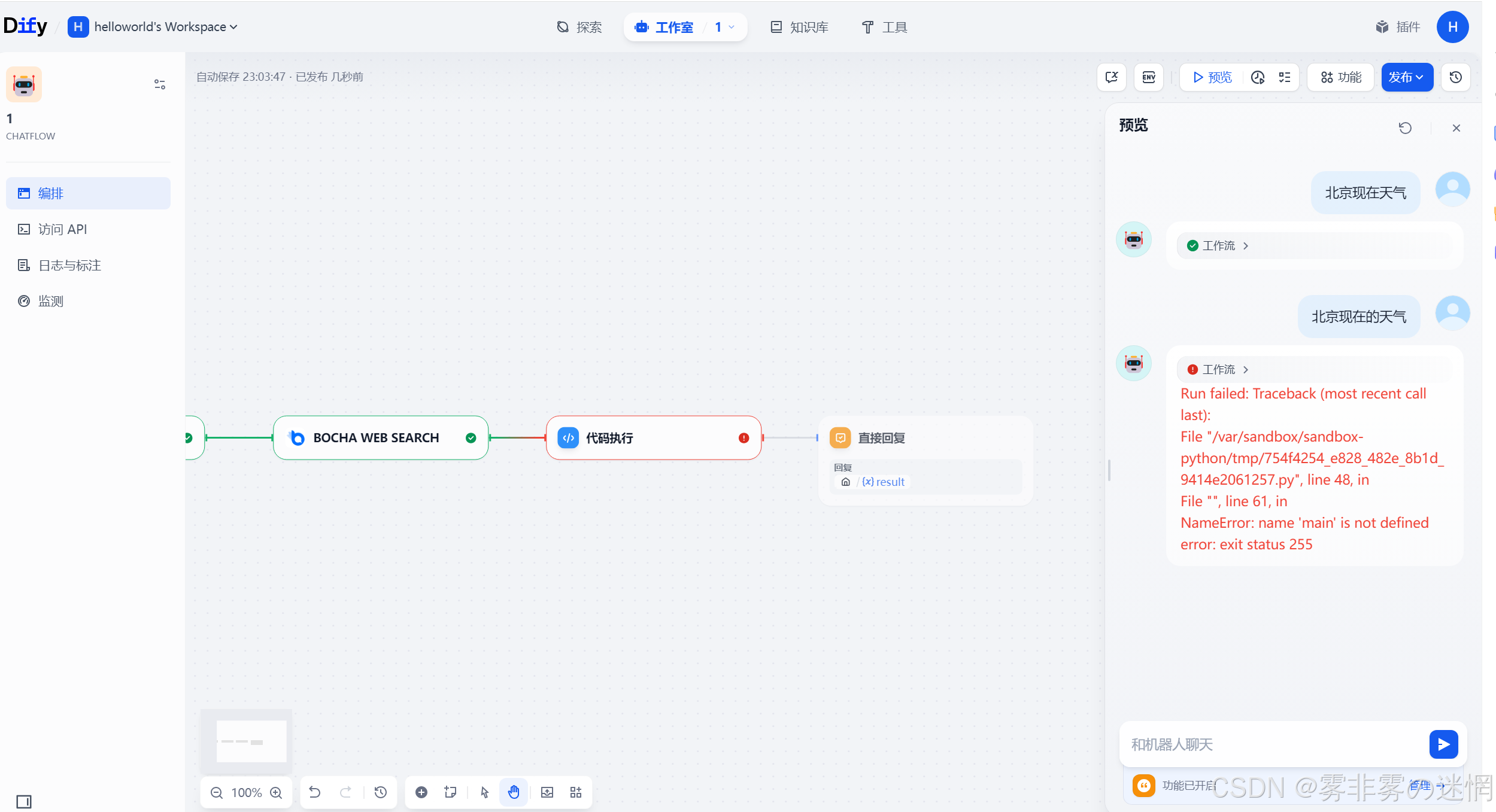

十三:代码运行报错分析

我们在使用节点:“代码运行”时,可能出现如下报错

生成的格式混乱、代码运行报错,先看Bocha是否可以运行成功,如果可以,则需要检查代码解析的输入输出、Python的问题,重点就是Python提取代码,很容易出错!下面是优化了的Python解析代码,可以直接使用粘贴!

import jsondef extract_webpage_content(data): \"\"\" 从数据结构中递归提取webpage内容 参数: data: 要搜索的数据结构(支持字典、列表或嵌套结构) 返回: 找到的webpage内容或None(未找到时) \"\"\" # 如果当前层级包含webpage,直接返回 if isinstance(data, dict): if \'webpage\' in data: return data[\'webpage\'] # 常见可能的嵌套结构 possible_paths = [ data.get(\'data\', {}).get(\'webpage\'), data.get(\'webPages\', {}).get(\'value\'), ] # 检查可能的路径是否存在 for content in possible_paths: if content is not None: return content # 递归搜索子结构 if isinstance(data, dict): for value in data.values(): result = extract_webpage_content(value) if result is not None: return result elif isinstance(data, list): for item in data: result = extract_webpage_content(item) if result is not None: return result return Nonedef format_structured_content(content, indent_level=0): \"\"\" 将内容格式化为结构化的文本 参数: content: 要格式化的内容 indent_level: 当前的缩进级别 返回: 格式化后的文本字符串 \"\"\" indent = \" \" * indent_level result = \"\" # 处理字典类型 if isinstance(content, dict): for key, value in content.items(): # 跳过技术性字段 if key in [\"sitelcon\", \"id\", \"datePublished\"]: continue # 处理嵌套结构 if isinstance(value, (dict, list)): result += f\"{indent}【{key}】\\n\" result += format_structured_content(value, indent_level + 1) else: # 处理特殊键 if key == \"name\": result += f\"{indent}【{value}】\\n\" elif key == \"content\": result += f\"{indent}{value}\\n\" else: # 格式化键值对 formatted_value = str(value).replace(\"\\n\", \"\\n\" + indent + \" \") result += f\"{indent}- {key}: {formatted_value}\\n\" # 处理列表类型 elif isinstance(content, list): for i, item in enumerate(content): if isinstance(item, (dict, list)): result += f\"{indent}【条目 {i+1}】\\n\" result += format_structured_content(item, indent_level + 1) else: result += f\"{indent}- {item}\\n\" # 处理字符串类型 elif isinstance(content, str): # 尝试解析字符串中的JSON结构 try: parsed = json.loads(content) result += format_structured_content(parsed, indent_level) except: # 如果不是JSON,直接返回 result += f\"{indent}{content}\\n\" # 其他类型 else: result += f\"{indent}{str(content)}\\n\" return resultdef main(arg1) -> dict: \"\"\" 主函数:提取JSON中的webpage内容并转换为结构化文本 参数: arg1: 来自博查(Bocha)输出的JSON数据 返回: dict: 包含提取结果的字典,键为\"result\" \"\"\" try: # 处理输入数据类型:字符串解析为对象,否则直接使用 if isinstance(arg1, str): data = json.loads(arg1) else: data = arg1 # 提取webpage内容 content = extract_webpage_content(data) if content is None: return {\"result\": \"未找到可识别的webpage字段\"} # 将内容格式化为结构化的文本 formatted_result = format_structured_content(content) return {\"result\": formatted_result} except Exception as e: # 错误处理 return { \"result\": ( f\"提取webpage内容时出错: \" f\"{type(e).__name__}: {str(e)}\" ) }

十四、云服务器两种部署方式的心得

(1)云服务单机部署

在体验华为云云服务器单机部署的过程中,我发现其操作简单且高效,尤其适合快速验证和小型应用部署。单机部署通过华为云Flexus云服务提供了便捷的配置界面,开发者只需几步即可完成服务器的初始化和应用部署。一键部署展示了从访问平台到快速搭建的清晰步骤,极大降低了技术门槛。单机部署的资源分配灵活,支持按需调整计算资源,适合预算有限或处于开发初期的团队。然而,由于依赖单台服务器,系统在面对高并发或故障恢复时表现较为有限,需手动维护以确保稳定性!

(2)CCE高可用部署

华为云CCE(Cloud Container Engine)高可用部署展现了其在企业级场景中的强大能力。基于Kubernetes的架构设计,CCE支持多副本部署和多可用区配置,显著提升了系统的容错能力。CCE通过负载均衡(LB)和虚拟私有云(VPC)实现高效的资源调度和分布式部署。在实际操作中,CCE的自动化运维功能(如自动扩缩容、健康检查)让我印象深刻,尤其是在高负载场景下,系统能够快速响应并保持服务连续性。然而,CCE部署的复杂度较高,配置和管理需要一定的技术背景,且成本相对单机部署更高!

(3)表格对比

维度 云服务器单机部署 CCE高可用部署 部署复杂度 简单,界面化操作,适合初学者或快速验证场景 较复杂,需熟悉Kubernetes及容器化技术,适合专业团队 可扩展性 扩展能力有限,需手动升级服务器配置,适合小规模应用 高可扩展性,支持动态扩缩容,适合大规模分布式系统 可靠性 依赖单机,单点故障风险较高,需手动配置备份机制 高可用性,多副本和多可用区部署,自动故障转移,服务稳定性强 成本 成本较低,按需计费,适合预算有限的场景 成本较高,涉及多节点、负载均衡等资源,适合高性能需求场景 管理与运维 需手动管理服务器,运维工作量较大 自动化运维(自动扩缩容、健康检查),减少人工干预,提升效率 适用场景 小型应用、测试环境、简单Web服务或原型开发 企业级应用、高并发服务、分布式AI应用(如DeepSeek推理服务)

十六、华为云Dify平台的战略价值

华为云Dify平台作为一款面向AI应用开发的一站式解决方案,展现了其在云原生和人工智能领域的战略定位。以下小编是对其战略价值的分析:

一站式AI开发赋能

Dify平台通过集成DeepSeek R1/V3等大模型推理服务,为开发者提供从模型训练到应用部署的全流程支持。一键部署功能展示了其便捷性,开发者无需深入了解底层技术即可快速搭建AI Agent。这种低门槛设计极大推动了AI技术的普及,助力中小型企业和开发者快速实现业务创新

云原生架构的高效性

Dify平台依托华为云的云原生技术(如Kubernetes、负载均衡、对象存储OBS),实现了高可扩展性和弹性调度。架构图显示,平台通过模块化设计(如Embedding & Re-ranker模块)支持多模态数据处理,满足复杂场景需求。这种架构不仅提升了开发效率,还通过动态资源分配优化了成本!

企业级安全与合规

Dify平台通过虚拟私有云(VPC)和网络隔离机制,保障了数据安全和应用合规性。安全组配置和访问控制功能,确保了企业在开发AI应用时能够满足严格的隐私和合规要求,特别适用于金融、医疗等高敏感行业!

开放生态与产业协同

Dify平台致力于构建开放的AI生态,支持与第三方工具和服务的无缝集成。文件中的活动内容表明,平台通过CSDN开发者社区等渠道,吸引广泛的开发者参与,形成了强大的生态协同效应。这种开放性不仅增强了平台的市场竞争力,还推动了AI技术的跨行业应用~

推动AI普惠化与业务创新

Dify平台的战略目标是通过降低AI开发门槛,推动技术普惠化。无论是大型企业还是初创团队,Dify都能提供灵活的解决方案,支持智能客服、实时推荐、数据分析等多样化场景。DeepSeek服务计费模式(按Token计费)进一步展示了其成本透明性,帮助企业优化资源投入,实现业务价值最大化!