SpatialLM:群核科技开源大模型,3D空间理解精度86.5%、零样本学习能力惊艳_群核科技开源spatiallm 安装使用

目录

- 前言

- 一、模型概述

- 二、技术创新

- 三、功能亮点

-

- (一)高精度的空间布局估计

- (二)强大的3D物体检测能力

- (三)零样本学习能力

- 四、应用场景

-

- (一)增强现实(AR)

- (二)机器人导航

- (三)场景编辑

- 五、快速使用

-

- (一)环境搭建

- (二)数据准备

- (三)模型推理

- (四)结果可视化

- 六、结语

- 七、项目地址

前言

在人工智能领域,3D空间理解一直是研究的热点和难点。随着大语言模型(LLMs)的发展,如何将其强大的语言理解和生成能力扩展到3D空间理解任务中,成为了一个重要的研究方向。近日,SpatialLM项目发布了首份技术报告,展示了其在3D空间理解领域的重大突破,为这一领域的发展带来了新的希望和机遇。

一、模型概述

SpatialLM是一个开源的大型语言模型,专注于处理3D点云数据并生成结构化的3D场景理解输出。它能够识别室内场景中的建筑元素(如墙壁、门窗)和3D物体的边界框及其语义类别。与传统方法不同,SpatialLM采用标准的多模态LLM架构,并直接从开源LLM进行微调。通过大规模、高质量的合成数据集训练,SpatialLM在空间布局估计和3D物体检测任务上均达到了全球领先水平,为增强现代LLM的空间理解能力开辟了新路径。

二、技术创新

(一)将LLM应用于3D空间理解

SpatialLM首次将大语言模型(LLMs)扩展到3D空间理解任务中。它将结构化场景描述视为通用语言(如Python)的脚本,并以文本形式进行预测。这种设计不仅易于人类理解和编辑,还可以轻松扩展到新类别,同时利用了预训练LLM的强大编码能力。这一创新打破了传统任务专属架构的限制,为3D空间理解任务提供了一种全新的解决方案。

(二)大规模合成数据集的构建

为了训练SpatialLM,研究团队构建了一个大规模、高质量的合成数据集,包含12,328个室内场景(54,778个房间)的点云数据和3D结构标注。这些数据均源自真实项目的专业设计模型,经过严格筛选和解析,形成了符合真实世界统计分布的虚拟环境。与现有的真实数据集(如ScanNet)和程序化生成的数据集(如ProcTHOR)相比,SpatialLM的数据集在规模和真实性上都具有显著优势。

(三)点云特征对齐与训练策略

SpatialLM对点云特征对齐和训练策略进行了深入研究。它采用了多种点云编码器,并通过实验验证了不同编码器的有效性。此外,SpatialLM还研究了不同训练阶段对模型性能的影响,最终发现单阶段微调能够取得最佳效果。这些研究为如何将点云数据有效地与LLM对齐提供了宝贵的实践经验。

三、功能亮点

(一)高精度的空间布局估计

SpatialLM在空间布局估计任务中达到了86.5%的准确率,这一指标超越了多个代表性专业模型,如RoomFormer和SceneScript。它能够准确地识别室内场景中的墙壁、门窗等建筑元素,并以结构化的方式输出场景描述。

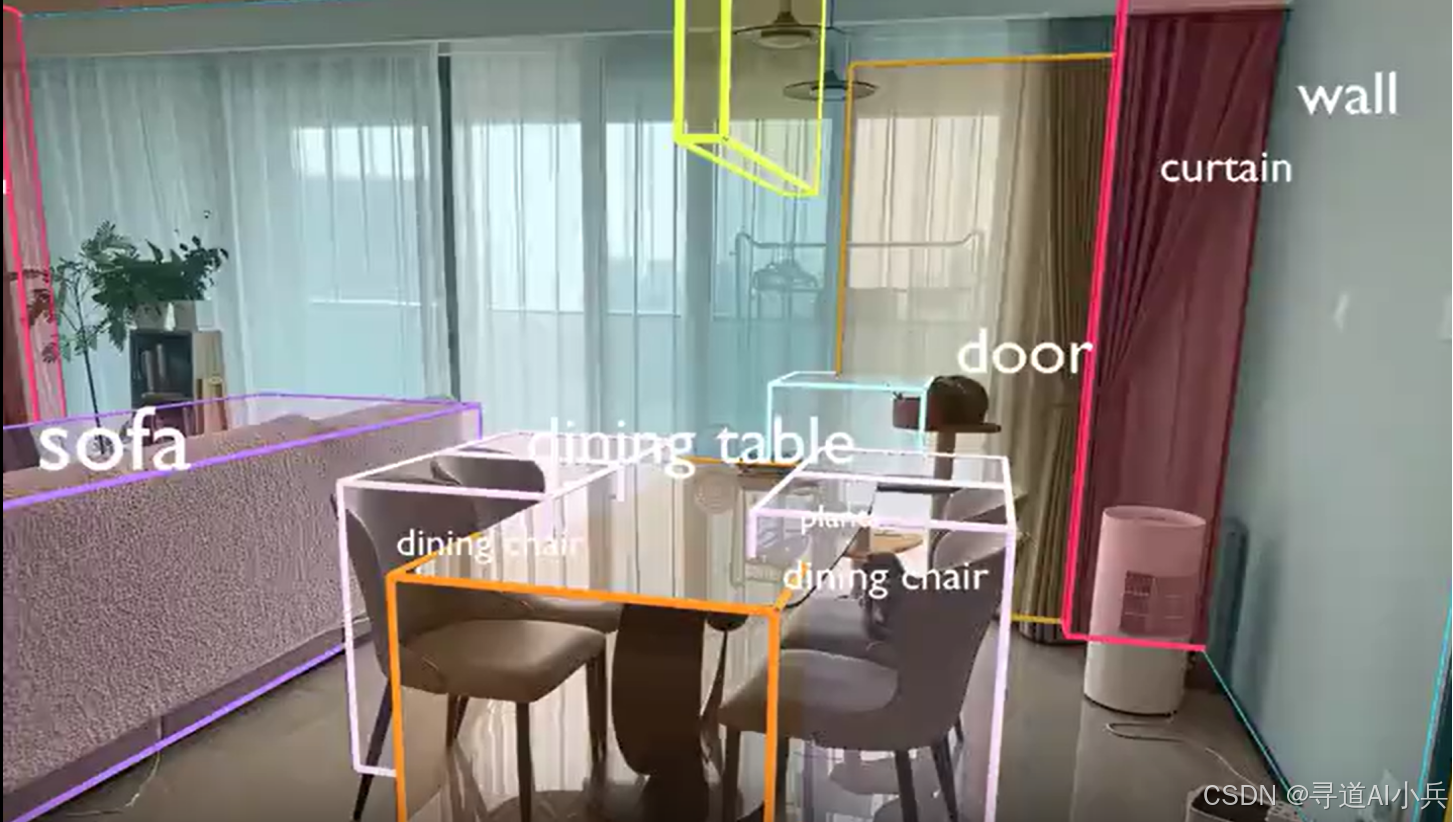

(二)强大的3D物体检测能力

在3D物体检测任务中,SpatialLM取得了65.6%的指标表现,与现有的顶尖模型V-DETR相比具有竞争力。它能够检测出室内场景中的各种物体,并提供其边界框和语义类别。

(三)零样本学习能力

SpatialLM还展示了强大的零样本学习能力。即使在未经过特定数据集微调的情况下,它也能够处理来自不同源的点云数据,如单目视频序列重建的点云。这一特性使得SpatialLM在实际应用中具有广泛的适用性。

四、应用场景

(一)增强现实(AR)

SpatialLM能够为AR应用提供精确的3D场景理解,帮助用户更好地与虚拟内容进行交互。例如,在家居装饰应用中,用户可以通过AR设备查看虚拟家具在真实房间中的摆放效果。

(二)机器人导航

对于机器人导航任务,SpatialLM可以提供详细的室内环境信息,帮助机器人更好地规划路径和避开障碍物。其高精度的空间布局估计和3D物体检测能力使得机器人能够更准确地感知周围环境。

(三)场景编辑

SpatialLM的结构化场景描述输出形式使其能够方便地应用于场景编辑任务。用户可以通过修改生成的脚本来调整场景中的元素,如移动物体、改变墙壁的位置等,从而实现对3D场景的快速编辑。

五、快速使用

(一)环境搭建

SpatialLM的部署需要一定的计算资源和软件环境。建议使用以下配置:

- 操作系统:Linux或MacOS

- Python版本:3.11

- PyTorch版本:2.4.1

- CUDA版本:12.4

可以通过以下命令安装必要的依赖:

git clone https://github.com/manycore-research/SpatialLM.gitcd SpatialLMconda create -n spatiallm python=3.11conda activate spatiallmconda install -y nvidia/label/cuda-12.4.0::cuda-toolkit conda-forge::sparsehashpip install poetry && poetry config virtualenvs.create false --localpoetry installpoe install-torchsparse(二)数据准备

SpatialLM支持多种点云数据源,包括RGBD扫描、单目视频重建等。可以从Hugging Face下载预处理好的测试数据集:

huggingface-cli download manycore-research/SpatialLM-Testset pcd/scene0000_00.ply --repo-type dataset --local-dir .(三)模型推理

运行以下命令进行模型推理:

python inference.py --point_cloud pcd/scene0000_00.ply --output scene0000_00.txt --model_path manycore-research/SpatialLM-Llama-1B(四)结果可视化

可以使用rerun工具将预测结果可视化:

python visualize.py --point_cloud pcd/scene0000_00.ply --layout scene0000_00.txt --save scene0000_00.rrdrerun scene0000_00.rrd六、结语

SpatialLM的发布为3D空间理解领域带来了新的突破。它不仅在技术上实现了多项创新,还在实际应用中展现了强大的性能。通过开源的方式,SpatialLM为研究人员和开发者提供了一个强大的工具,加速了3D空间理解技术的发展和应用。未来,随着技术的不断升级和社区的持续贡献,SpatialLM有望在更多领域发挥更大的作用。

七、项目地址

- GitHub地址:https://github.com/manycore-research/SpatialLM

- 论文地址:https://arxiv.org/abs/2506.07491

- Hugging Face地址:https://huggingface.co/manycore-research/SpatialLM1.1-Qwen-0.5B

🎯🔖更多专栏系列文章:AI大模型提示工程完全指南、AI大模型探索之路(零基础入门)、AI大模型预训练微调进阶、AI大模型开源精选实践、AI大模型RAG应用探索实践🔥🔥🔥 其他专栏可以查看博客主页📑

😎 作者介绍:资深程序老猿,从业10年+、互联网系统架构师,目前专注于AIGC的探索(CSDN博客之星|AIGC领域优质创作者)

📖专属社群:欢迎关注【小兵的AI视界】公众号或扫描下方👇二维码,回复‘入群’ 即刻上车,获取邀请链接。

💘领取三大专属福利:1️⃣免费赠送AI+编程📚500本,2️⃣AI技术教程副业资料1套,3️⃣DeepSeek资料教程1套🔥(限前500人)

如果文章内容对您有所触动,别忘了点赞、⭐关注,收藏!加入我们,一起携手同行AI的探索之旅,开启智能时代的大门!