Unity AR与商汤SenseAR集成教程

本文还有配套的精品资源,点击获取

简介:本教程详细解读了Unity AR和商汤SenseAR的结合使用,旨在指导开发者如何通过这两个平台创建创新的增强现实应用。内容涵盖了Unity AR基础、SenseAR SDK集成、AR场景构建、人脸追踪与识别、物体识别与追踪、用户交互与动画、性能优化与调试以及发布与部署等关键环节。通过本教程,开发者将能够熟练地利用这些工具开发出富有互动性的AR应用,适用于多种领域。

1. Unity AR基础介绍

随着增强现实(AR)技术的迅猛发展,Unity作为主流的游戏和应用开发平台,其AR开发工具和框架逐步成熟,支持开发者创建沉浸式的交互体验。本章将探讨Unity AR技术的历史背景、发展现状以及未来趋势,为读者揭示Unity在AR开发中的关键角色和潜力。

Unity AR技术的历史背景

Unity自2005年推出以来,已成为全球开发者广泛使用的多平台游戏引擎。随着移动设备的普及,用户对交互体验的要求越来越高,Unity抓住机遇,迅速拓展其AR开发工具,如ARFoundation和Vuforia,这些工具为AR应用的开发提供了强大的支持。

发展现状

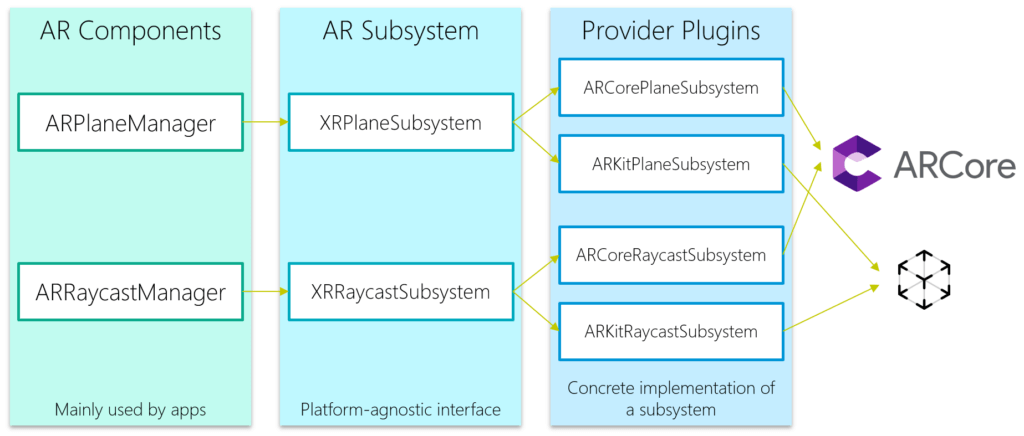

目前,Unity支持多种AR平台,包括iOS的ARKit、Android的ARCore等,能够为开发者提供全面的AR开发解决方案。通过这些工具,Unity已经助力多个行业领域的AR应用开发,例如零售、教育、医疗等。

未来趋势

未来,Unity AR的发展趋势将朝着更高的互动性、更强的真实感和更优的性能优化方向发展。技术进步如空间计算、机器学习的融合,将使得AR体验更加自然和智能。同时,随着5G网络的普及,Unity AR在实时远程协作和云渲染等方面的应用将更加广泛。

2. 商汤SenseAR SDK集成方法

2.1 商汤SenseAR SDK概览

2.1.1 SDK的功能特点与组件构成

商汤科技推出的SenseAR SDK是一个集成了先进的人脸追踪与识别、物体识别、手势识别等多模态交互技术的软件开发工具包。它旨在简化AR应用的开发流程,并且提供了丰富的接口供开发者调用,使得开发者能够快速构建出具备交互性的增强现实应用。

- 人脸追踪与识别 :SenseAR提供精准的人脸追踪功能,结合商汤的深度学习算法,可以识别并追踪用户的脸部特征,为AR效果的渲染提供了可能。

- 物体识别与追踪 :用户可以与现实世界中的物体进行互动,SDK支持识别2D和3D物体,为多种交互场景提供了技术支持。

- 手势识别 :手势作为非接触式的交互方式,在AR应用中具有广泛应用前景。SenseAR实现了对手势动作的识别,方便用户进行直观操作。

- 环境感知 :SenseAR SDK集成了环境光检测、空间遮挡等多种技术,使得AR体验更加自然和沉浸。

2.1.2 支持的平台与环境要求

SenseAR SDK支持在多种主流平台和设备上部署与运行。对于开发者来说,这意味着他们可以在广泛的用户群体中推广他们的应用。

- 移动平台 :SenseAR支持iOS和Android两大移动操作系统的AR应用开发。

- 硬件要求 :为了保证AR体验的流畅性,推荐的硬件设备需具备良好的性能,例如拥有足够处理能力的CPU、GPU以及一定的内存和存储空间。

- 软件环境 :开发者需要使用Unity 3D作为开发环境,以及相应的SDK开发套件。

2.2 SDK的安装与配置步骤

2.2.1 Unity项目中的安装流程

在开始使用SenseAR SDK之前,首先需要在Unity项目中进行安装,下面是详细的步骤:

- 导入SDK资源包 :

- 下载最新的SenseAR SDK资源包。

-

打开Unity编辑器,并选择\"Assets\" -> \"Import Package\" -> \"Custom Package...\",然后选择下载的SDK包进行导入。

-

添加必要的脚本 :

- 导入SDK后,将SenseAR相关的脚本拖拽到相应的GameObject上,完成基本的配置。

2.2.2 环境配置与SDK版本管理

在安装SDK后,接下来是环境配置,这涉及到SDK依赖项的安装以及版本管理。

- 配置依赖项 :

- 在Unity项目的

Packages目录下创建manifest.json文件,通过配置来管理SDK的依赖关系。json { \"dependencies\": { \"com.sensetime.unity-ar-sdk\": \"1.0.0\", // 其他依赖项... } } -

使用命令

Unity.exe -executeMethod UnityEditor.PlayerSettings.SetApiCompatibilityLevel来设置兼容级别。 -

版本控制 :

- 在开发过程中,可以通过Git等版本控制系统来管理不同版本的SDK,确保项目稳定迭代。

2.3 SDK集成的验证方法

2.3.1 示例项目创建与运行

为了验证SDK是否成功集成并正常工作,开发者可以创建一个示例项目来测试。

- 创建示例项目 :

- 在Unity编辑器中创建一个新的项目,并在项目中导入SenseAR SDK。

-

按照SenseAR提供的示例工程模板进行设置。

-

运行与测试 :

- 在编辑器和实际设备上分别运行项目,检查人脸追踪、物体识别等功能是否按预期工作。

- 对于遇到的问题,可以查看SenseAR官方文档获取解决方案。

2.3.2 功能测试与调试指南

在测试过程中,开发者可能需要进行一些调试操作以确保功能的正确实现。

- 调试工具 :

- 使用Unity的调试工具如Console窗口来查看日志输出,定位问题。

-

SenseAR SDK可能提供一些调试接口或日志输出,用于辅助开发者诊断问题。

-

性能调优 :

- 根据SenseAR SDK提供的性能数据来调优应用,确保应用运行流畅。

通过上述的安装和测试步骤,开发者可以确保SDK已成功集成到项目中,并且所有功能都能按预期工作,为开发高质量的AR应用打下坚实基础。

3. AR场景构建步骤

在探讨如何构建一个高质量的增强现实(AR)场景之前,我们需要明确构建AR场景时所依赖的基础要素,并且了解如何通过添加交互式元素和优化渲染技术来提高用户体验。接下来,将详细介绍AR场景构建的三个主要步骤。

3.1 AR场景的基础要素

3.1.1 场景设计原则与内容构建

构建AR场景的第一步是确保场景设计遵循特定的原则,以创造出沉浸式体验。这些原则包括场景的吸引力、用户交互的直观性,以及与现实世界的无缝集成。要实现这些原则,首先需要确定场景的目的和目标受众。例如,一个教育应用的AR场景可能会强调信息传递的清晰度,而一个游戏应用的AR场景则可能更侧重于趣味性和可玩性。

在内容构建方面,场景中的元素需要与实际环境相融合。这涉及到3D模型、纹理、光照和声音等多媒体元素的合理运用。3D模型和纹理应能增强场景的真实感,同时也要考虑到模型的复杂度,以确保流畅的性能表现。设计师和开发人员需要紧密合作,以确保场景不仅在视觉上吸引人,而且功能上也能满足交互需求。

3.1.2 使用3D模型和纹理增强场景真实感

为了使AR场景更加生动和真实,使用高质量的3D模型和纹理是必不可少的。3D模型不仅需要展现出物体的形状和细节,还要能够适应不同的光照条件。例如,模型在阳光直射和阴暗处的表现应有所不同。此外,纹理的使用能够为3D模型添加额外的质感和色彩,使场景更加丰富和有层次感。

在Unity中,可以通过导入外部的3D模型和纹理资源来构建AR场景。例如,使用Blender、Maya等3D建模软件创建模型,然后利用Photoshop、Substance Painter等工具为其添加纹理。导入Unity后,可以利用光照效果来模拟不同时间的光线变化,增强场景的真实感。

// 示例代码块:在Unity中使用脚本控制模型的旋转,提升真实感using UnityEngine;public class RotateModel : MonoBehaviour{ public float rotationSpeed = 30f; // 控制旋转速度 void Update() { transform.Rotate(Vector3.up, rotationSpeed * Time.deltaTime); // 每帧围绕Y轴旋转 }}以上脚本展示了如何使用Unity C#脚本让3D模型围绕Y轴旋转,模拟真实世界物体的自然动作,增强AR场景的真实感和动态感。

3.2 交互式元素的添加与管理

3.2.1 实现场景中元素的基本交互

一个成功的AR应用往往需要用户与场景元素进行互动。基本的交互包括点击、拖动、缩放等。为了实现场景中元素的这些基本交互,开发者需要在Unity中编写相应的脚本来响应用户的输入。此外,还需要为模型添加碰撞器(Collider)组件,以便能够捕捉到用户输入的动作。

例如,可以使用Unity的EventSystems来检测用户输入,并编写相应的函数来响应点击事件。下面是一个简单的代码示例,展示了如何在点击3D模型时使其执行一个动作。

using UnityEngine;using UnityEngine.EventSystems; // 引入事件系统命名空间public class ClickableModel : MonoBehaviour, IPointerClickHandler{ public void OnPointerClick(PointerEventData eventData) { Debug.Log(\"Model has been clicked!\"); // 这里可以添加点击后的行为,比如旋转、缩放等 }}3.2.2 管理复杂场景中的用户交互逻辑

在复杂的AR场景中,可能会有很多元素需要处理用户的交互。例如,一个场景可能包含多个可交互的物体,每个物体又可能有不同的交互逻辑。为了有效地管理这些交互,建议将每种交互逻辑分离到不同的脚本中,并使用Unity的事件驱动架构来实现交互逻辑之间的通信。

此外,为了提高代码的可读性和可维护性,可以在Unity的Inspector面板中为每个元素添加组件,通过这种方式将不同的交互逻辑分配给不同的组件。开发者可以通过编写中央控制器脚本来管理和协调这些组件之间的交互。

// 示例代码块:使用组件化的方式管理和响应用户交互using UnityEngine;public class InteractionManager : MonoBehaviour{ public ClickableModel[] clickableModels; void Update() { foreach(var model in clickableModels) { // 在Update中不断检查用户输入,并调用模型的交互方法 if (Input.GetMouseButtonDown(0)) // 假设左键点击 { model.OnPointerClick(null); } } }} 在上述代码中, InteractionManager 脚本遍历一个 ClickableModel 数组,并在每次更新中检查用户是否进行了左键点击操作。如果是,则对每个模型调用其 OnPointerClick 方法。这样的管理方式可以使得复杂场景中的用户交互逻辑条理清晰,易于调试和扩展。

3.3 场景优化与渲染技术

3.3.1 场景渲染效率提升方法

渲染效率对于AR应用的性能至关重要。高质量的场景渲染可能会对移动设备的GPU和CPU造成巨大压力。因此,开发者需要采取多种方法来提升渲染效率。

一种常见的优化方式是通过限制场景中模型和纹理的数量和复杂度来减少渲染负担。例如,可以使用LOD(Level of Detail)技术,只在用户接近物体时显示高多边形模型,远离时则显示低多边形模型。另一个方法是利用遮挡剔除(Occlusion Culling),避免渲染被其他物体遮挡的模型。

Unity提供了许多内置的渲染优化工具,如HDRP(High Definition Render Pipeline)和URP(Universal Render Pipeline),开发者可以根据项目需求选择合适的渲染管线来优化性能。

3.3.2 基于性能考虑的资源优化策略

除了渲染优化外,资源优化也是确保AR场景流畅运行的关键。这包括合理分配场景的网格(Mesh)和材质(Material)资源,以及使用高效的资源压缩技术。

在Unity中,可以使用ProBuilder等工具创建高效的网格,并且通过材质的共享来减少内存占用。对于纹理资源,应该使用适当大小的纹理,避免不必要的高分辨率。纹理压缩技术,如DXT和PVRTC,可以在不显著降低视觉质量的前提下减少纹理文件的大小。

graph LRA[开始优化] --> B[确定性能瓶颈]B --> C[渲染优化]C --> D[LOD技术]C --> E[遮挡剔除]B --> F[资源优化]F --> G[网格和材质共享]F --> H[纹理资源压缩]D --> I[选择合适的渲染管线]H --> J[使用压缩纹理格式]I --> K[最终效果评估]J --> K在上述的流程图中,我们可以看到优化AR场景性能的一个基本流程。首先,需要确定性能瓶颈,然后分别进行渲染优化和资源优化。在渲染优化阶段,可以应用LOD技术和遮挡剔除。资源优化则涉及网格和材质的共享以及纹理资源的压缩。优化完成后,还需要评估最终效果,以确保优化措施达到预期目标。

结合本章节的内容,开发者应该能掌握如何构建一个基础AR场景,包括场景设计原则、基本交互实现和渲染技术优化。以上内容为AR场景构建提供了理论基础和实践指南,为创造高质量的AR体验奠定了基础。

4. 人脸追踪与识别技术

人脸追踪与识别是增强现实(AR)应用中的关键技术之一。人脸追踪允许AR技术准确地识别和跟踪用户的脸部位置及表情变化,而人脸识别则用于确认特定用户的身份,为个性化交互和内容定制提供可能。商汤SenseAR SDK为开发者提供了完善的人脸追踪和识别解决方案。本章将从人脸追踪技术的基本原理出发,深入探讨面部特征点检测与处理,并详细介绍人脸识别在AR中的高级应用场景及其优化实现。

4.1 人脸追踪技术的基本原理

人脸追踪技术是计算机视觉领域的研究热点之一,它涉及到从二维图像或视频中实时定位和跟踪人脸,提取出重要的面部特征点,并进一步分析面部表情和头部姿态。人脸追踪技术的应用场景非常广泛,例如在AR游戏、直播滤镜、社交应用以及安全验证等场景中,都能发现人脸追踪技术的踪迹。

4.1.1 跟踪技术的分类与应用场景

人脸追踪技术大致可分为基于模型的方法和基于学习的方法。基于模型的方法通常采用预先定义的3D模型来拟合观察到的人脸图像。这种方法的优点在于计算效率较高,适合实时处理;缺点是模型的通用性和适应性可能受限。而基于学习的方法则依赖于深度学习框架,通过大量的训练样本来学习人脸的特征表达,从而获得更高的准确率和鲁棒性。学习型方法适用于需要极高精度的场景,但其计算成本较高。

在实际应用中,如社交应用的实时表情滤镜往往采用基于模型的跟踪技术,因为其响应速度快,能够满足实时互动的需求。在银行或支付系统的安全验证中,则可能采用基于学习的方法,以确保识别的准确性和安全性。

4.1.2 商汤SenseAR中的人脸追踪技术解析

商汤SenseAR SDK中集成了先进的人脸追踪技术,该技术通过实时捕捉用户的面部表情和头部姿态,允许开发者创建更为自然和互动的AR体验。SenseAR使用的是基于深度学习的方法来增强追踪的准确度和适应性,它可以稳定地识别和追踪用户的面部特征,即使在低光照、快速移动或表情变化较大的情况下也能保持良好的追踪效果。

SenseAR SDK还提供了丰富的接口供开发者调用,开发者可以利用这些接口获取实时的面部特征数据,从而设计出个性化的交互效果,比如动态改变AR滤镜的表情效果,或者根据用户的面部动作来触发特定的虚拟物体互动等。

接下来,我们将深入探讨面部特征点检测及其处理方法。

4.2 面部特征点检测与处理

面部特征点检测是人脸追踪技术的核心环节之一。通过检测面部关键点,系统能够实现对面部表情和头部动作的精确理解。面部特征点的数量和位置对于后续的处理和应用有着至关重要的作用。

4.2.1 特征点检测的准确性与稳定性分析

面部特征点检测的准确性对于人脸追踪和识别至关重要。检测过程需要在各种不同条件下,如不同的光照、表情和头部姿态下,都能够稳定地工作。为了提高检测的准确性,算法通常需要经过大量的训练以识别和适应各种面部差异。

稳定性的分析则关注于特征点检测在长时间运行或面对复杂场景时的表现。这意味着算法不仅要能够实时更新面部特征点的位置,还要能应对遮挡、快速运动或视角变化等挑战。在商汤SenseAR中,该技术通过持续学习和优化算法模型来保证特征点检测的稳定性和准确性。

4.2.2 特征点数据的处理与应用

获取到准确的面部特征点数据后,如何进行处理和应用成为了关键。在AR应用中,特征点数据通常用于驱动虚拟对象与用户表情之间的同步,或者根据用户的头部动作来改变虚拟物体的视角。

为了更好地使用这些数据,开发者可以借助SDK提供的API来访问和操作特征点数据。例如,通过分析特征点的变化,开发者可以模拟出用户头部的旋转角度,并将这个角度应用到AR场景中的虚拟相机上,从而实现视角的自然转换。

在下一节中,我们将讨论人脸识别技术在AR应用中的高级应用和优化实现。

4.3 人脸识别的高级应用

人脸识别技术通过提取和分析人脸图像中的特征信息,可以完成对个体身份的识别。这项技术在AR应用中有着广泛的应用前景,例如虚拟试妆、个性化推荐、用户身份验证等。

4.3.1 人脸识别在AR中的应用场景

在AR领域,人脸识别技术可以应用于多种场景中。例如,虚拟试妆应用可以利用人脸识别技术来检测用户的面部特征,并将口红、眼影等化妆品以AR的方式虚拟地展示在用户的脸上,提供试妆体验。通过识别和分析用户的面部特征,AR应用还可以提供个性化的内容推荐,如根据用户的年龄、性别和面部表情来推荐特定的商品或内容。

在安全性要求较高的场景中,如银行或支付应用中,人脸识别技术还可以用于验证用户身份。用户可以通过AR应用进行面部识别来快速登录或授权交易,大大提高了应用的安全性和便捷性。

4.3.2 人脸识别技术的优化与实现

为了在AR应用中实现高效的人脸识别,开发人员需要优化算法以适应移动设备的计算限制。商汤SenseAR SDK通过提供优化后的深度学习模型和高效的计算流程,简化了开发者在集成人脸识别功能时的工作。同时,SDK还内置了多种预处理和特征提取技术,能够快速地进行人脸检测和识别。

优化人脸识别技术的另一个重点是提升其在各种环境下的适应性和鲁棒性。例如,SenseAR SDK可以处理不同光照条件下的图像,并保持较好的识别率。此外,通过结合用户的行为习惯和上下文信息,可以进一步提高识别的准确性和效率。

本章详细介绍了人脸追踪与识别技术在AR应用中的实现方法和优化策略,通过商汤SenseAR SDK的应用示例,展示了如何将这些技术应用于实际开发中。下一章将介绍物体识别与追踪技术,这是AR应用中另一个重要的技术领域。

5. 物体识别与追踪方法

5.1 物体识别技术的基本概念

物体识别技术是让计算机能够通过图像、视频或传感器数据识别和定位现实世界中物体的技术。它是增强现实(AR)和计算机视觉领域的一个重要组成部分。物体识别的关键技术和流程包括图像预处理、特征提取、物体检测、分类器训练、以及后续的物体追踪。

5.1.1 物体识别的关键技术和流程

物体识别的流程一般始于图像的采集,通常涉及使用相机或传感器。图像预处理阶段可能包括颜色校正、去噪等操作。接下来是特征提取,这涉及到从图像中提取能够代表物体的特征,如边缘、角点、轮廓等。基于提取的特征,物体检测算法会确定物体的位置和大小。在分类器训练阶段,算法学习区分不同物体的特征,以便能够准确识别它们。最后,物体追踪会在连续的视频帧之间保持对已识别物体的跟踪。

5.1.2 商汤SenseAR物体识别技术详解

商汤SenseAR的物体识别技术结合了深度学习和传统的计算机视觉技术,可以实现高准确度的物体检测和识别。SenseAR利用先进的卷积神经网络(CNN)模型进行特征提取,能够高效地处理图像数据并识别出各种物体。SenseAR的物体识别支持多种物体类别,并且能够适应不同的光照和环境条件,保证在各种应用场景中稳定工作。

5.2 物体追踪的实现与挑战

物体追踪是物体识别之后的自然延伸,目的是在视频序列中持续地定位和跟踪特定物体的位置和运动。物体追踪的实现涉及到诸多挑战,包括遮挡、快速运动、光照变化等因素,这些都可能影响追踪的准确性。

5.2.1 精确追踪的关键因素分析

精确的物体追踪依赖于稳定且鲁棒的特征点匹配。为了应对遮挡和快速运动问题,追踪算法需要能够从连续帧中预测物体的位置,并使用动态模型来预测其未来位置。此外,算法需要具备一定的学习能力,通过持续的样本训练提高自身在不同场景下的适应能力。

5.2.2 实现高效物体追踪的方法

高效物体追踪算法应当尽量减少计算资源的消耗,同时保持追踪的准确性。商汤SenseAR采用多种优化策略,比如使用轻量级深度学习模型和快速特征点提取算法,以减少计算时间。此外,采用多线程或异步处理技术来并行处理数据,也能有效地提升追踪效率。

5.3 物体识别与追踪的综合应用

物体识别与追踪技术的综合应用可以在多种AR应用中提供丰富的互动体验。例如,在AR游戏、教育应用和零售展示中,物体识别和追踪可以用于创建更加直观和互动的内容。

5.3.1 AR应用中的物体互动示例

在AR应用中,物体识别与追踪可以被用来创建虚拟物品与现实世界物体之间的互动。例如,用户可以通过放置一个现实世界的玩具模型来激活一个虚拟的互动故事。这种互动不仅增加了用户的参与度,而且提高了AR应用的教育和娱乐价值。

5.3.2 物体追踪与用户交互的结合

结合物体追踪和用户交互是AR应用的高级功能。利用物体追踪技术,应用能够响应用户对现实世界物体的实际操作。这可能包括调整虚拟物体的大小和角度来匹配用户持有的现实物体,或者在游戏中模拟物理互动。通过这种方式,物体追踪技术与用户交互的结合为AR体验增加了更多的真实感和沉浸感。

graph LR A[开始] --> B{物体识别} B --> C{特征提取} C --> D{物体检测} D --> E[物体定位] E --> F{物体追踪} F --> G[追踪优化] G --> H[结束]在上述流程图中,我们可以看到物体识别和追踪的综合应用需要经过多个步骤的处理。首先进行物体识别,接着进行特征提取,然后是物体检测,以此来精确定位物体。一旦识别并定位了物体,物体追踪就开始发挥作用,并且在整个过程中需要不断的追踪优化以确保准确追踪。

物体识别与追踪技术不仅在技术上具有挑战性,而且在实现用户友好和互动性强的AR应用中扮演着关键角色。随着技术的不断进步,我们可以期待更加复杂和直观的物体识别与追踪应用出现在未来的AR体验中。

6. 用户交互和动画设计

用户交互和动画设计是增强AR应用沉浸感和吸引力的关键组成部分。它们不仅需要符合用户的直觉,而且需要在技术实现上保证流畅和高效率。本章节将探索用户交互设计的理论与实践,以及动画设计在AR中的应用,最后提出优化这两者的策略。

6.1 用户交互设计的理论与实践

6.1.1 用户体验的重要性与设计原则

用户体验(UX)是任何交互式系统成功与否的关键因素。在AR应用中,良好的用户体验不仅依赖于技术实现的高效,更需要注重用户的情感反应、认知需求和交互流畅性。设计原则包括但不限于一致性、直观性和及时反馈。

一致性 要求应用内的交互和视觉元素保持一致,让用户能够快速熟悉并预测应用行为。 直观性 意味着操作应该符合用户的自然思维和行为模式。 及时反馈 则是指系统在用户的操作后应该立即给出响应,即使是在后台进行复杂的处理。

6.1.2 商汤SenseAR中的交互式功能开发

在商汤SenseAR框架中,实现交互式功能开发需要考虑用户与虚拟对象之间的交互逻辑。利用SenseAR的API,开发者可以构建手势识别、视线追踪以及面部表情捕捉等交互方式。

以手势识别为例,开发者可以通过SenseAR的SDK获取手部关键点数据,并在此基础上编写逻辑,控制AR场景中的虚拟对象跟随手势动作。这不仅需要对SenseAR的API有深入理解,还需要结合用户研究来设计直观、有趣的交互形式。

6.2 动画设计在AR中的应用

6.2.1 动画技术在AR中的作用与影响

动画技术在AR中扮演着重要的角色,它通过动态的视觉效果为用户提供了丰富的信息和感官体验。在AR应用中,动画可以用来指导用户的注意力,展示交互流程,以及传达复杂的信息和故事。

恰当的动画设计能够增强用户的参与感和沉浸感。例如,通过动画效果模拟真实世界中物体的运动规律,让用户感觉自然和亲切。

6.2.2 创建逼真的AR动画效果

要创建逼真的AR动画效果,首先需要对现实世界的物理运动有深入的了解。随后,应用3D动画软件(如Blender或Maya)来创建精细的动画。在此过程中,开发者需要关注动画的细节,如光照、阴影和反射等,以增强真实性。

在Unity中,可以使用Mecanim动画系统来控制3D模型的动画播放。通过编写脚本来控制动画状态机(Animator Controller)的转换,可以实现复杂的动画交互逻辑。例如,当用户与AR物体交互时,触发一个动画状态的转换,从而展示物体的响应动作。

6.3 用户交互和动画设计的优化策略

6.3.1 提升用户体验的交互设计技巧

为了提升用户体验,交互设计应保持简洁且直观。避免过度复杂的交互逻辑,因为这可能导致用户的困惑和挫败感。使用用户研究来测试设计假设,收集反馈,并不断迭代改进,是优化交互设计的有效方法。

此外,确保交互元素在AR场景中清晰可见,避免用户因为找不到交互点而感到沮丧。根据用户的行为模式合理布局交互按钮或对象,可以有效提升用户的操作效率。

6.3.2 动画效果的性能优化方法

动画效果虽然能够提升用户体验,但过度复杂的动画会降低渲染性能,影响整体的AR体验。为了优化动画性能,开发者需要在动画的精度与性能之间找到平衡点。

首先,避免在动画中使用过多的顶点或复杂的骨骼动画系统,这会增加计算负担。其次,可以使用动画剪辑(Animation Clip)和动画状态机的优化技术,比如使用LOD(Level of Detail)技术动态调整模型和动画的复杂度。

此外,利用Unity的Animator Controller中的条件分支和参数状态机,可以减少不必要的动画计算,从而提升性能。开发者可以设置动画过渡条件,仅在需要时触发更复杂的动画。

以上章节内容详细介绍了用户交互和动画设计在Unity AR应用开发中的重要性、实现方法及优化策略。这些策略和技巧,无论对于初学者还是经验丰富的开发者,都是提升AR应用体验的重要参考。在下一章节中,我们将探索AR应用的性能优化和调试技巧,进一步提升应用的质量和性能。

本文还有配套的精品资源,点击获取

简介:本教程详细解读了Unity AR和商汤SenseAR的结合使用,旨在指导开发者如何通过这两个平台创建创新的增强现实应用。内容涵盖了Unity AR基础、SenseAR SDK集成、AR场景构建、人脸追踪与识别、物体识别与追踪、用户交互与动画、性能优化与调试以及发布与部署等关键环节。通过本教程,开发者将能够熟练地利用这些工具开发出富有互动性的AR应用,适用于多种领域。

本文还有配套的精品资源,点击获取