AutoDL 环境+ PyCharm 配置教程:实现 GPU 加速与远程开发_autodl pycharm

简介

在本文中,我们将深入讲解如何通过 AutoDL 租用 GPU 服务器,并利用 Conda 配置 Python 环境。接着,我们将配置 PyCharm 与 AutoDL 实例进行远程开发,帮助你高效进行深度学习模型的训练与部署。无论是配置 Jupyter 内核,还是在 PyCharm 中进行代码开发和调试,本教程都将手把手教你如何操作,让你的开发过程更加流畅。

目录

-

-

-

- 一、AutoDL 环境配置

-

- 1.1 租用 AutoDL 服务器

- 1.2 进入终端并配置 Conda

-

- 1.2.1 配置Conda 环境

- 1.2.2 创建 Python 环境

- 1.2.3 安装 PyTorch 和其他依赖

- 1.3 更新 Jupyter 内核页面

- 二、在 PyCharm 中配置 AutoDL

-

- 2.1 连接 AutoDL 实例

- 2.2 配置 SSH 连接

- 2.3 配置远程 Python 解释器

- 2.4 配置项目映射和文件同步

- 三、PyCharm 与 AutoDL 交互

-

- 3.1 配置自动上传与远程资源管理

- 3.2 下载远程模型和数据

- 总结

-

-

一、AutoDL 环境配置

在使用 AutoDL 租用 GPU 时,首先需要通过 Conda 配置 Python 环境。以下是详细的配置步骤。

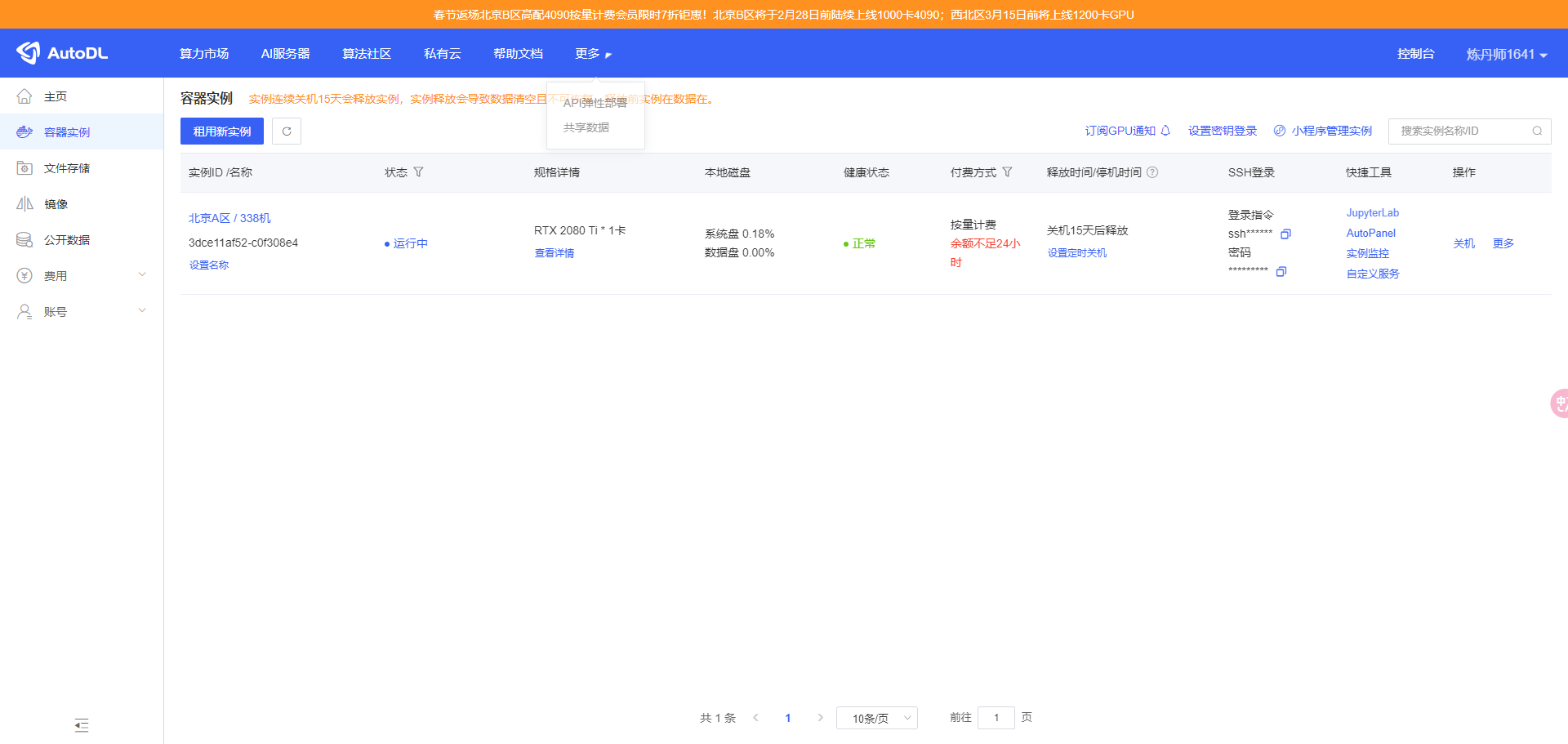

1.1 租用 AutoDL 服务器

- 访问 AutoDL 平台并租用 GPU 服务器,确保你的租用实例具备所需的显卡支持。

1.2 进入终端并配置 Conda

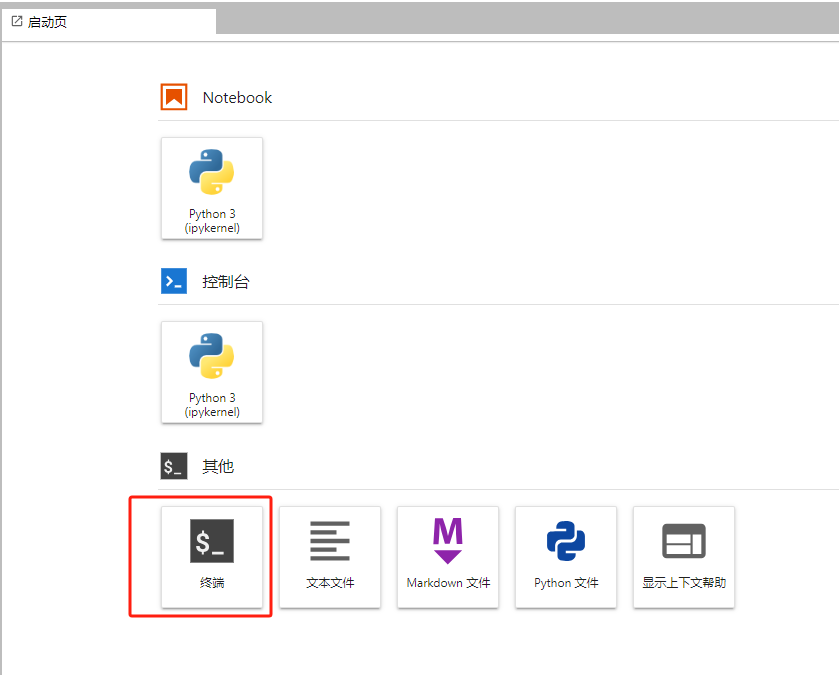

通过 JupyterLab 进入终端并配置 Conda 环境。

-

点击 JupyterLab 进入终端:

-

使用

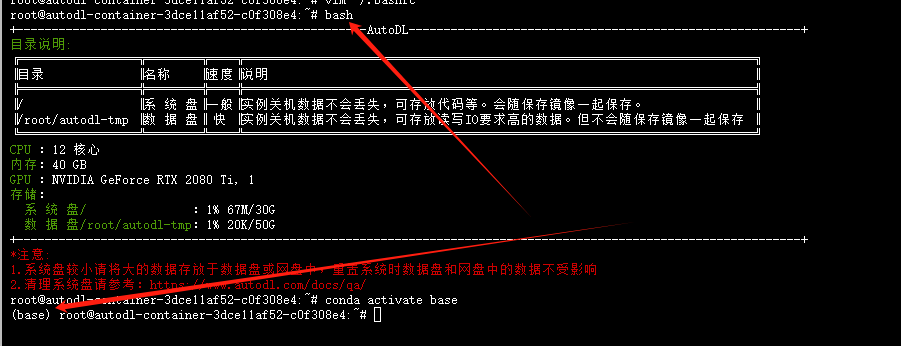

conda activate base命令激活环境,但可能会遇到命令无法识别的错误。接下来我们来配置 Conda。

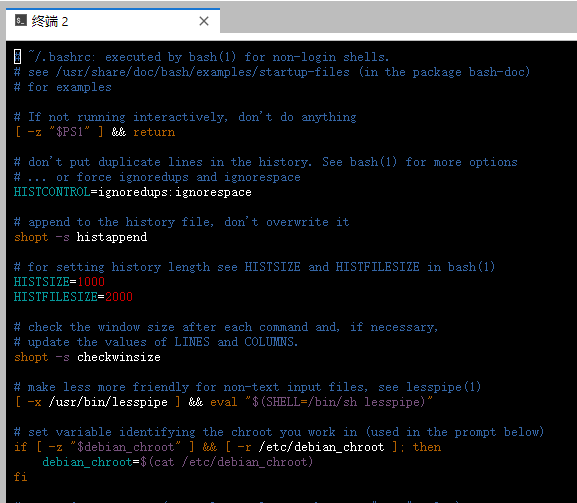

1.2.1 配置Conda 环境

-

输入

vim ~/.bashrc,打开配置文件

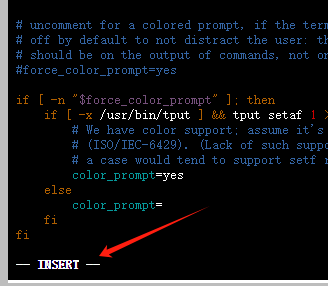

-

键盘输入

i(一定保证是英文i) 开始编辑

-

在文件末尾添加以下路径:

source /root/miniconda3/etc/profile.d/conda.sh -

按 Esc,然后输入

:wq保存退出。 -

输入

bash命令重启终端,或直接关闭终端重新打开。 -

再次使用

conda activate base命令,即可成功激活环境。

1.2.2 创建 Python 环境

创建一个新的 Python 环境:

conda create -n py38 python=3.8

conda activate py38

1.2.3 安装 PyTorch 和其他依赖

根据显卡的 CUDA 版本,安装适合的 PyTorch 版本。

-

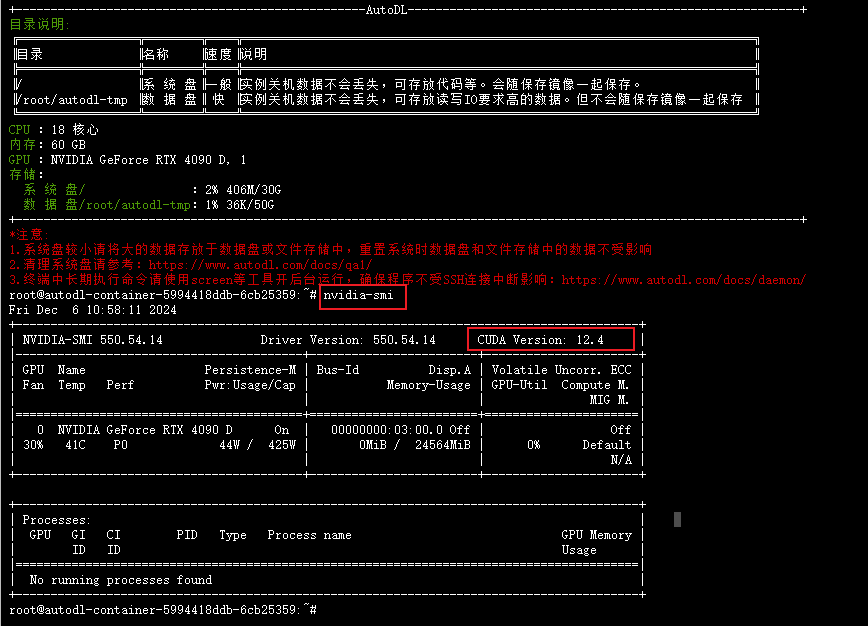

输入

nvidia-smi查询你的显卡支持的 CUDA 版本:例如这是RTX 4090D 的显卡,最高支持12.4的CUDA

-

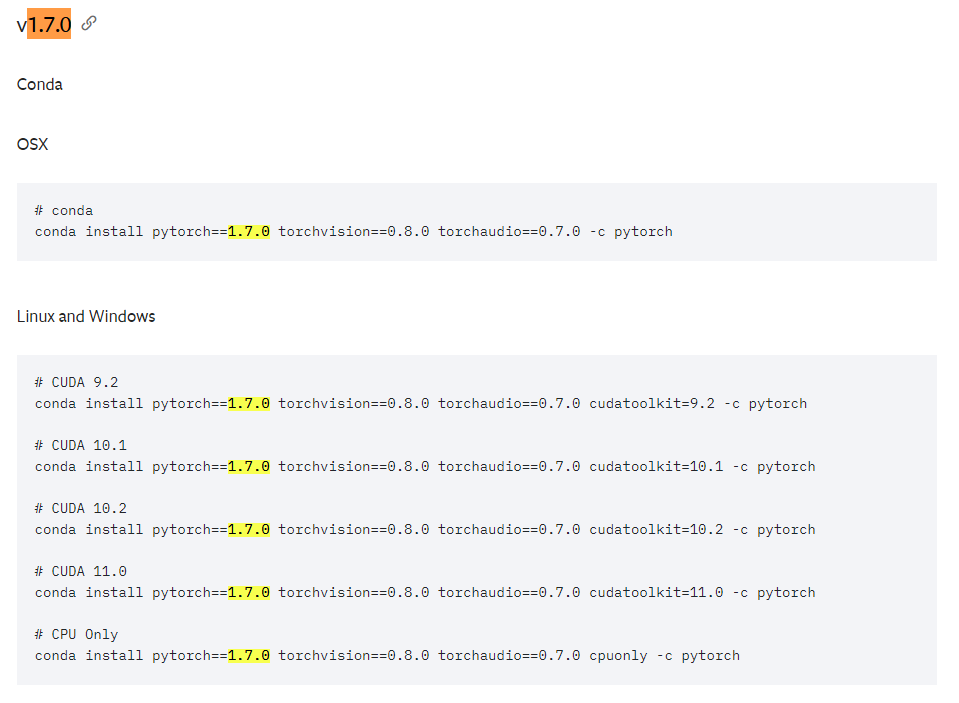

安装 PyTorch,进入官网找到对应历史版本

以我的主机参数:2080Ti 显卡,conda 10.1,python3.8环境为例——查询到使用1.7.0版本,CUDA选择10.1 的pytorch

conda install pytorch==1.7.0 torchvision==0.8.0 torchaudio==0.7.0 cudatoolkit=10.1 -c pytorch

本人的UNet项目开发环境——RTX 3090 显卡,conda 10.1,python3.8 (ubuntu18.04)环境为例, CUDA 11.3 的pytorch (正在使用)

pip install torch==1.13.1+cu117 torchvision==0.14.1+cu117 torchaudio==0.13.1 --extra-index-url https://download.pytorch.org/whl/cu117

安装其他必需的包:

pip install jupyter d2l

1.3 更新 Jupyter 内核页面

-

在创建的环境中安装 Jupyter 内核:

在创建的 py38环境中,输入

conda install ipykernel -

使用以下命令更新内核:

输入:

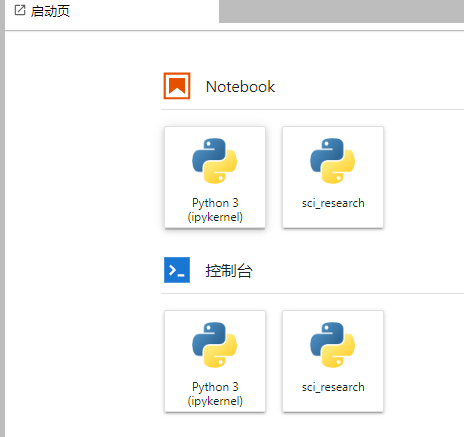

ipython kernel install --user --name=sci_research,成功之后刷新页面,如下:

刷新页面,新的内核配置就会出现在 Jupyter 页面中。

二、在 PyCharm 中配置 AutoDL

2.1 连接 AutoDL 实例

登录 AutoDL 后复制 SSH 指令,连接到实例:

例如SSH指令: ssh -p 20777 root@region-77.seetacloud.com

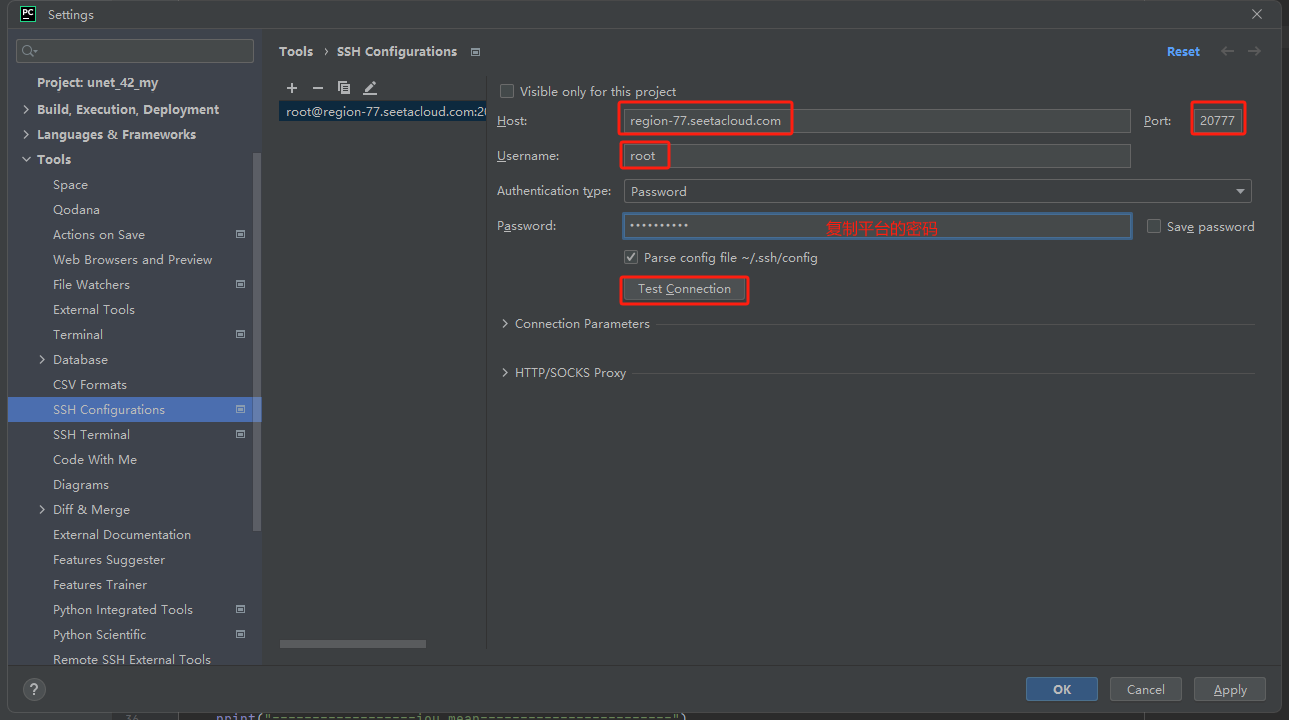

2.2 配置 SSH 连接

-

打开 PyCharm,进入 Settings -> Tool -> SSH Configurations。

-

填入 SSH 信息并点击 Test Connection 测试连接。

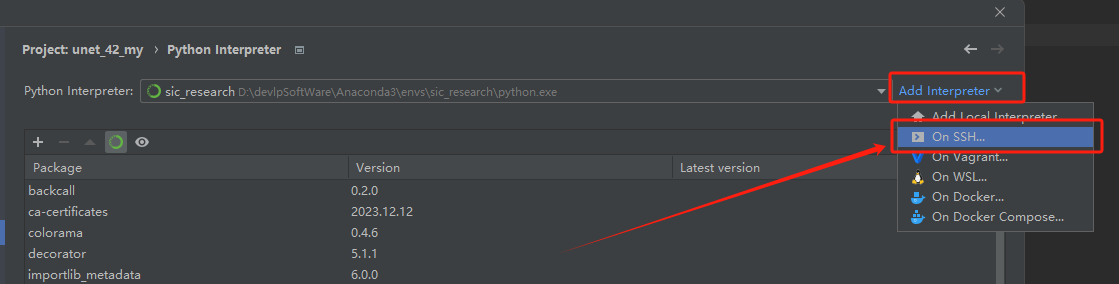

2.3 配置远程 Python 解释器

-

在 Settings -> Project -> Python Interpreter 中添加远程解释器。

-

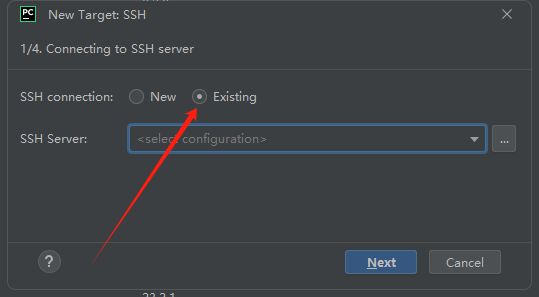

选择Existing

-

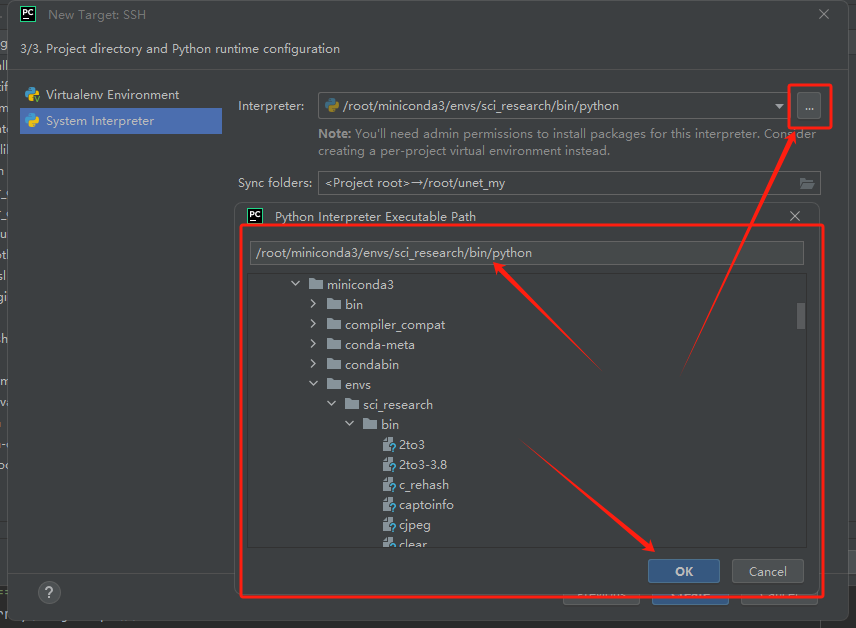

配置远程解释器路径

可以通过在远程cmd终端输入

whereis python,查找miniconda的环境所在路径

默认是在/root/miniconda3/bin/python,自定义创建的新环境就会在 miniconda下的envs文件夹中(例如小编的路径为:/root/miniconda3/envs/py38/bin/python)

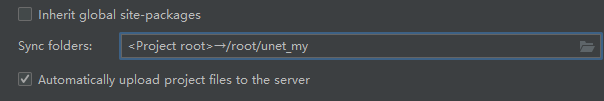

2.4 配置项目映射和文件同步

-

在根目录下创建一个新的项目文件夹,以便管理。

root目录为 根目录,为了便于管理,那就在root目录下创建新的项目目录(小编创建了root/unet_my文件夹)

-

在 PyCharm 中配置项目映射,将本地文件与远程服务器同步。

三、PyCharm 与 AutoDL 交互

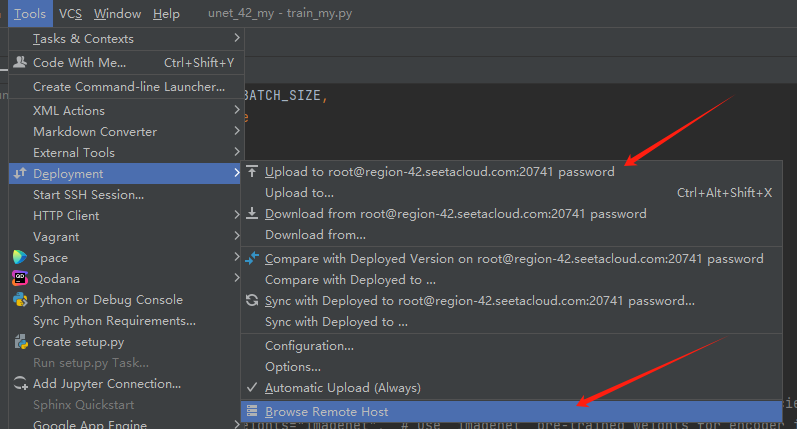

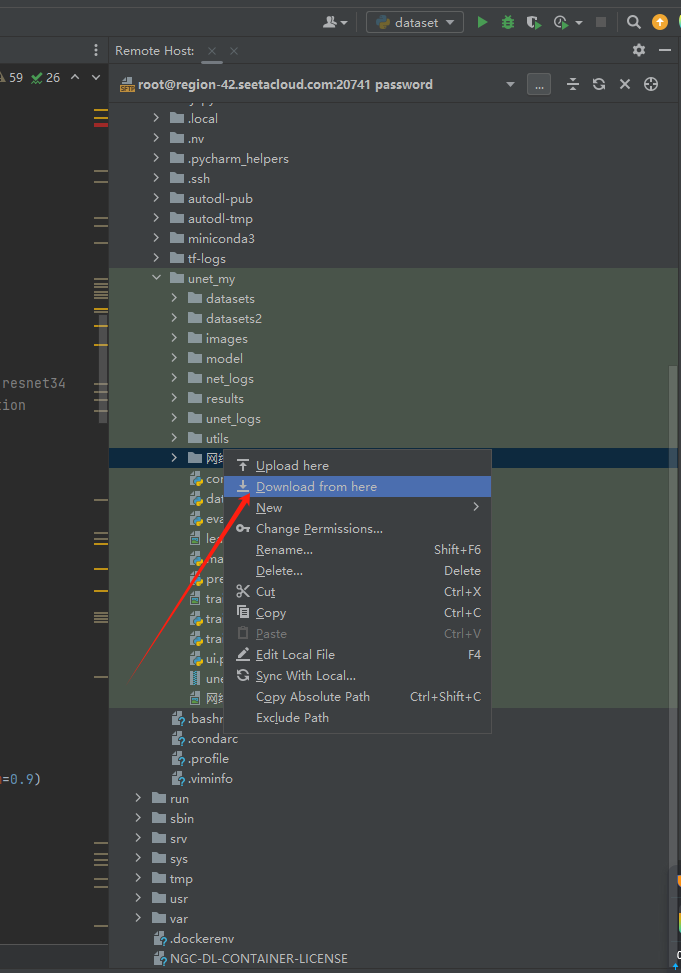

3.1 配置自动上传与远程资源管理

通过 Tools -> Deployment 配置自动上传和远程资源管理。

在 Browse Remote Host 中管理远程资源,下载训练好的模型到本地。

3.2 下载远程模型和数据

使用 Automatic Upload (Always) 将代码自动上传到远程服务器。

提醒:远程交互也可以使用XShell、FinalShell等远程工具灵活使用。

总结

通过本文的详细步骤,你已经成功配置了 AutoDL 环境并在 PyCharm 中实现了远程开发与 GPU 加速。无论是通过 JupyterLab 进行实验,还是在 PyCharm 中开发、调试与训练模型,都能有效提高你的工作效率。借助 Conda 和 PyTorch 的强大支持,你将能够快速搭建深度学习环境,并专注于模型的训练与优化。